Clear Sky Science · es

Creación de un mapa de cuadrícula 2D basado en datos de cámara RGBD y LiDAR

Mapas robóticos más inteligentes para espacios cotidianos

Desde robots de almacén que esquivan palés hasta robots domésticos que sortear muebles, las máquinas que se mueven por el entorno necesitan buenos mapas para mantenerse seguras. Sin embargo, los sensores que usan para percibir —escáneres láser y cámaras de profundidad— tienen puntos ciegos. Este estudio muestra cómo combinar un escáner láser sencillo con una cámara de profundidad económica, y corregir automáticamente en tiempo real los errores de la cámara, puede proporcionar a robots pequeños de interior mapas más claros y seguros de su entorno.

Por qué un solo sensor no basta

Hoy los robots suelen confiar en una cámara de profundidad (que capta color y distancia) o en un escáner láser (que mide distancia con pulsos de luz). Las cámaras de profundidad son baratas y compactas, pero se complican con poca luz, deslumbramientos intensos o más allá de unos pocos metros, y sus lecturas de distancia tienden a desviarse conforme aumenta el rango. Los escáneres láser, en cambio, son extremadamente precisos y funcionan en la oscuridad, pero por lo general sólo detectan una delgada rebanada horizontal del mundo y pueden pasar por alto objetos que estén por encima o por debajo de ese plano, como palés bajos, estanterías salientes o estructuras huecas. Además, los sistemas láser suelen ser más caros y exigir más cálculo. Por sí solos, ninguno de los dos tipos de sensor ofrece la vista rica y de confianza necesaria para espacios estrechos y centros logísticos interiores concurridos.

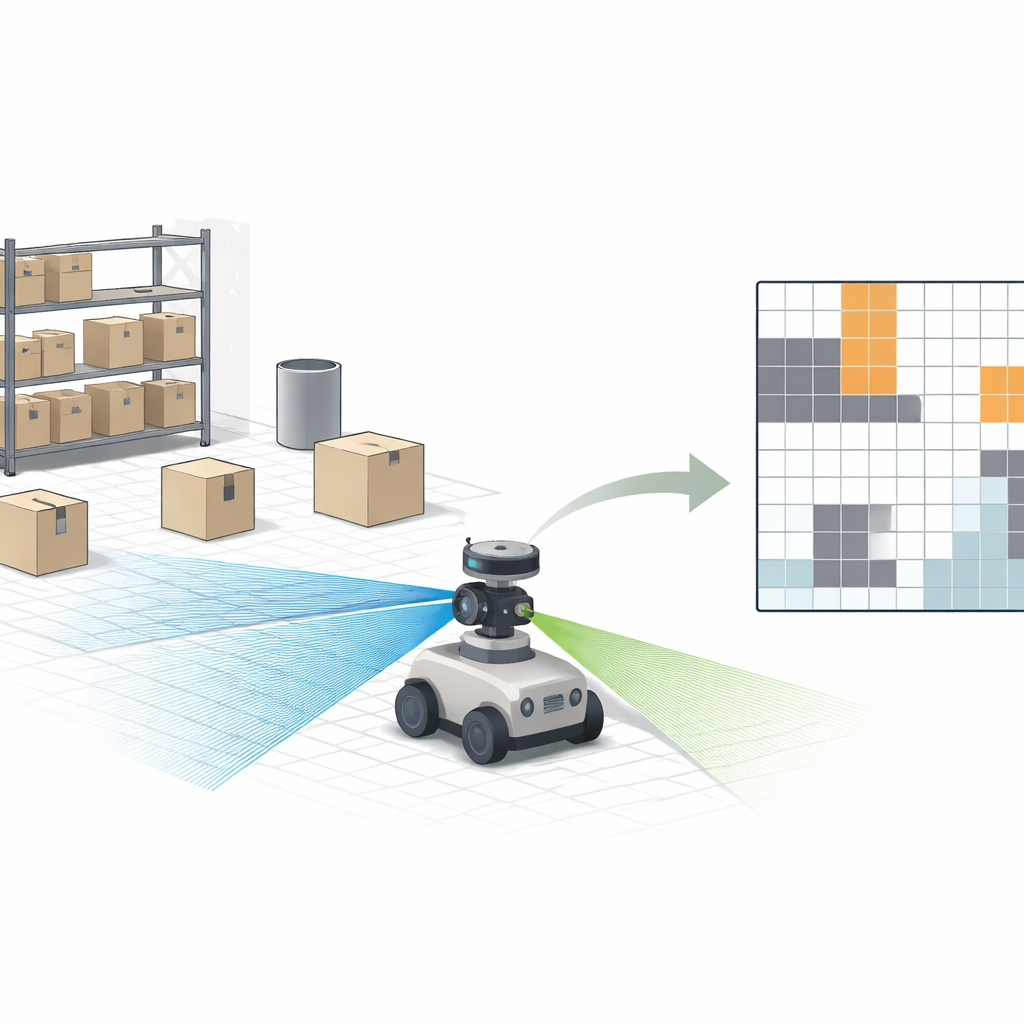

Fusionando dos vistas en una imagen nítida

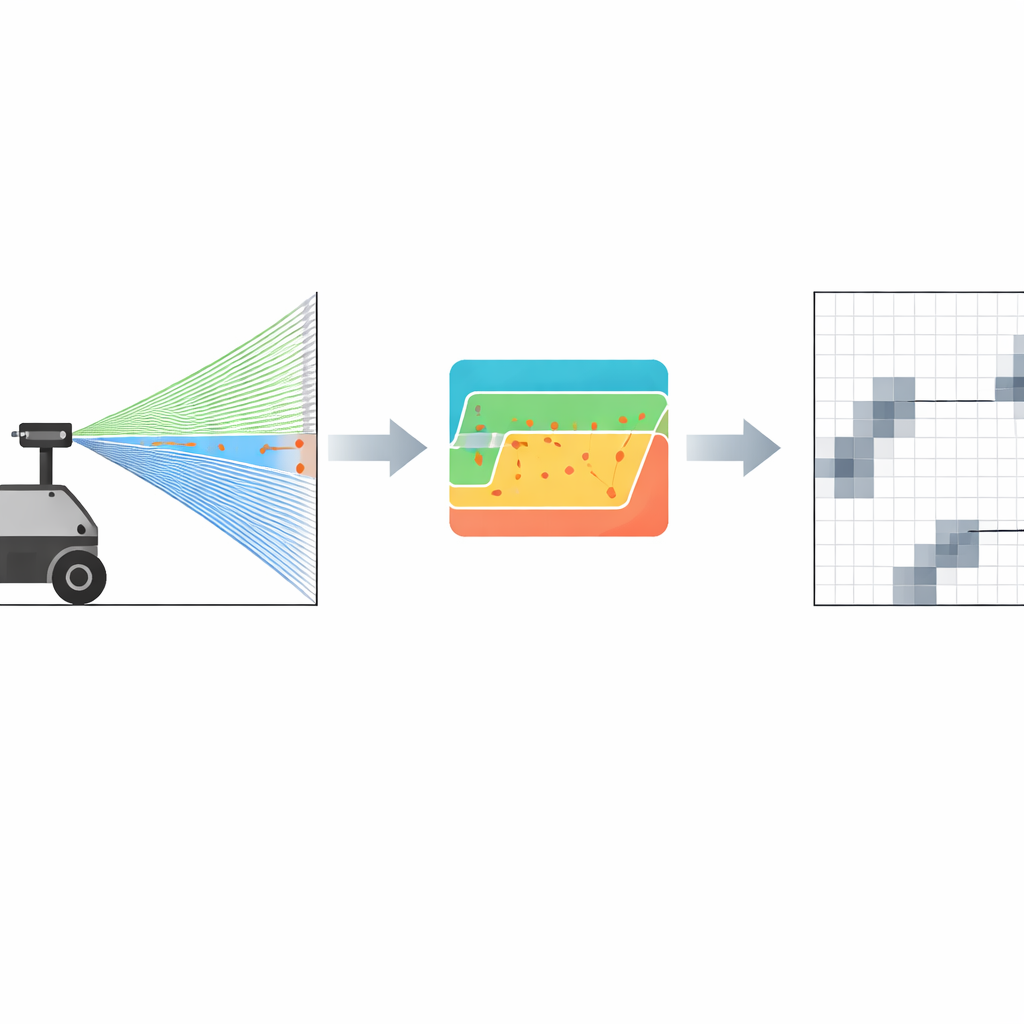

Los autores abordan esta carencia fusionando las fortalezas de ambos sensores en un único mapa de cuadrícula 2D —el tipo de mapa donde el suelo se divide en pequeñas celdas que se marcan como libres u ocupadas. Su robot porta una cámara RGBD (color más profundidad) de bajo coste y un escáner LiDAR planar. Primero, alinean todas las mediciones en un marco de referencia común, de modo que un punto visto por la cámara o por el láser termine en el mismo lugar del mapa. Luego, en lugar de mantener un modelo 3D completo, proyectan únicamente los puntos 3D relevantes sobre el plano del suelo, filtrando el ruido del techo y el suelo. Un esquema probabilístico actualiza cada celda de la cuadrícula según la confianza en cada sensor a una distancia dada: las lecturas del láser se tratan como altamente fiables en el rango de trabajo, mientras que la influencia de la cámara se atenúa con la distancia a medida que su ruido crece.

Permitir que el láser corrija la cámara

Una innovación clave es un paso de calibración ligero que permite al robot corregir continuamente el sesgo de profundidad de la cámara en campo. Cuando el robot se enfrenta a una pared plana, usa la distancia milimétrica del láser como "verdad de referencia". Un procedimiento de ajuste robusto estima la distancia precisa a esa pared a partir de los datos del láser, incluso en presencia de ruido. El sistema compara esto con lo que informa la cámara y ajusta un único offset de profundidad para que la lectura media de la cámara coincida con la del láser. Es crucial que este proceso no requiera patrones de tablero de ajedrez elaborados, brazos con control de movimiento ni una calibración completa de seis grados de libertad; puede activarse rápidamente en un almacén real siempre que haya una superficie plana adecuada en vista. Esta sintonización en tiempo real reduce directamente errores sistemáticos de la cámara que de otro modo harían que el robot juzgara mal la posición de los obstáculos.

De una profundidad más limpia a trayectorias más seguras

Los investigadores evaluaron su método en un robot de estilo almacén equipado con dos escáneres láser económicos y una cámara de profundidad Intel RealSense. En pruebas controladas frente a la verdad de referencia del láser, el error de distancia de la cámara cayó drásticamente después de la calibración —por ejemplo, a unos 2,16 metros, el error medio bajó de 0,604 metros a 0,340 metros, una reducción aproximada del 43 por ciento. Al comparar diferentes modos de mapeo, una configuración solo con cámara no logró construir un mapa estable, e incluso una fusión ingenua de datos de cámara sin corregir con LiDAR produjo muchos falsos obstáculos, ya que el suelo se marcaba erróneamente como ocupado. La fusión calibrada, sin embargo, generó mapas más nítidos con menor incertidumbre, detectó obstáculos finos y bajos que el láser solo no veía y mejoró la precisión del cierre de bucle, todo ello funcionando lo bastante rápido para la navegación en tiempo real.

Lo que esto significa para robots en el mundo real

En términos prácticos, el trabajo ofrece una receta sencilla para hacer los robots de interior más seguros y fiables sin recurrir a sensores caros y de gama alta. Permitiendo que un láser preciso pero limitado "enseñe" discretamente a una cámara de profundidad más barata, y luego combinando sus lecturas en una cuadrícula 2D común, el robot obtiene una visión más veraz de su entorno —especialmente para características complicadas como estanterías huecas, mallas de alambre y objetos bajos. Aunque esta inteligencia adicional requiere algo de potencia de cálculo y no resuelve completamente problemas como condiciones de iluminación extremas, acerca a los robots de bajo coste al tipo de percepción robusta y fiable necesaria en almacenes, fábricas y otros espacios interiores concurridos donde personas y máquinas deben compartir el suelo de forma segura.

Cita: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Palabras clave: mapeo robótico, fusión de sensores, LiDAR, cámara de profundidad, navegación en interiores