Clear Sky Science · fr

Création de cartes en grille 2D basée sur des données de caméra RGBD et LiDAR

Des cartes robotisées plus intelligentes pour les espaces du quotidien

Des robots d’entrepôt évitant les palettes aux robots domestiques se faufilant autour des meubles, les machines qui se déplacent ont besoin de bonnes cartes pour rester en sécurité. Pourtant, les capteurs qu’ils utilisent pour percevoir — scanners laser et caméras de profondeur — ont chacun des zones d’ombre. Cette étude montre comment la combinaison d’un scanner laser simple avec une caméra de profondeur peu coûteuse, et la correction automatique en temps réel des erreurs de la caméra, peut fournir aux petits robots d’intérieur des cartes de leur environnement plus nettes et plus sûres.

Pourquoi un seul capteur ne suffit pas

Les robots actuels s’appuient souvent soit sur une caméra de profondeur (qui voit la couleur et la distance), soit sur un scanner laser (qui mesure la distance par impulsions lumineuses). Les caméras de profondeur sont bon marché et compactes, mais elles peinent par faible luminosité, en cas d’éblouissement ou au-delà de quelques mètres, et leurs mesures de distance dérivent progressivement avec l’augmentation de la portée. Les scanners laser, en revanche, sont extrêmement précis et fonctionnent dans l’obscurité, mais ils ne sondent généralement qu’une fine tranche horizontale du monde et peuvent manquer des objets situés au-dessus ou en dessous de ce plan, comme des palettes basses, des étagères en surplomb ou des structures creuses. De plus, les systèmes laser tendent à être plus coûteux et exigeants en calcul. Pris séparément, aucun des deux types de capteurs n’offre la vue riche et fiable nécessaire pour évoluer dans des espaces restreints et des hubs logistiques intérieurs encombrés.

Fusionner deux points de vue pour obtenir une image claire

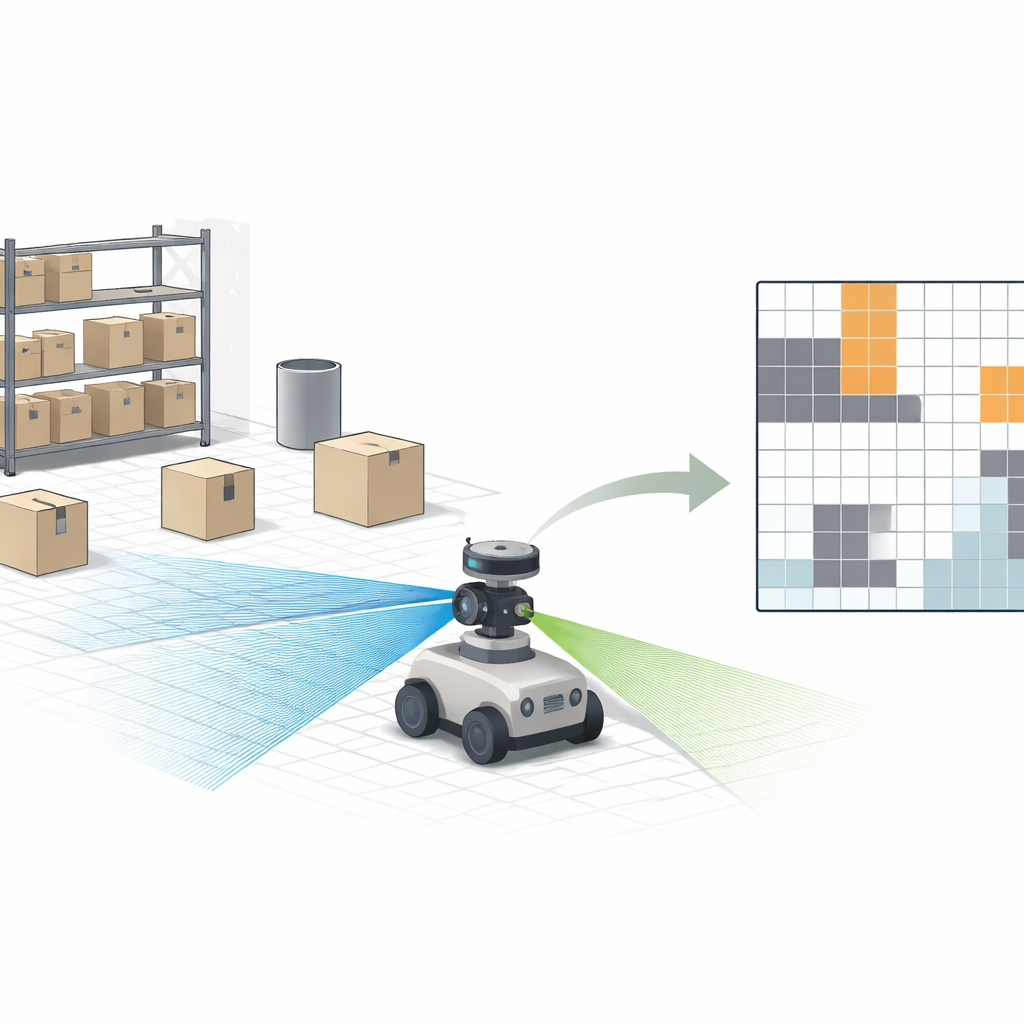

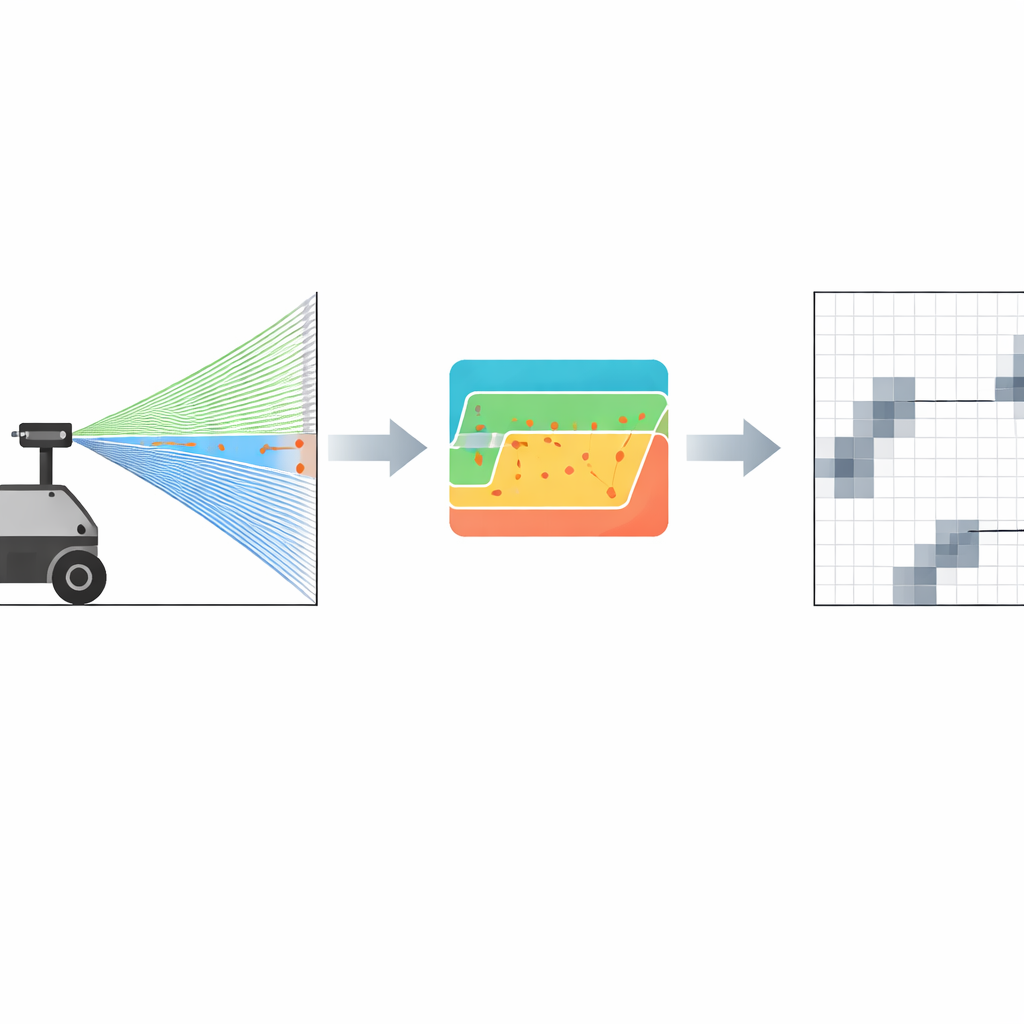

Les auteurs comblent cette lacune en fusionnant les forces des deux capteurs dans une carte en grille 2D — le type de carte où le sol est divisé en petites cases marquées comme libres ou occupées. Leur robot embarque une caméra RGBD (couleur plus profondeur) à bas coût et un scanner LiDAR plan. D’abord, ils alignent toutes les mesures dans un même cadre de référence, de sorte qu’un point vu par la caméra ou par le laser se retrouve au même endroit sur la carte. Ensuite, au lieu de conserver un modèle 3D complet, ils projettent uniquement les points 3D pertinents sur le plan du sol, en filtrant le désordre provenant du plafond et du plancher. Un schéma probabiliste met à jour chaque cellule de la grille en fonction de la fiabilité de chaque capteur à une distance donnée : les mesures laser sont considérées comme très fiables sur la plage de travail, tandis que l’influence de la caméra décroît progressivement avec la distance à mesure que son bruit augmente.

Laisser le laser corriger la caméra

Une innovation clé est une étape d’étalonnage légère qui permet au robot de corriger en continu le biais de profondeur de la caméra sur le terrain. Lorsque le robot fait face à un mur plat, il utilise la distance au millimètre du laser comme « vérité de terrain ». Une procédure d’ajustement robuste estime la distance précise à ce mur à partir des données laser, même en présence de bruit. Le système compare alors cette valeur à celle fournie par la caméra et ajuste un seul décalage de profondeur pour que la lecture moyenne de la caméra corresponde à celle du laser. Crucialement, ce processus ne nécessite pas de motifs en damier élaborés, de bras à mouvements contrôlés ou d’étalonnage complet à six degrés de liberté ; il peut être déclenché rapidement dans un entrepôt réel dès qu’une surface plane appropriée est visible. Cet ajustement à la volée réduit directement les erreurs systématiques de la caméra qui, autrement, amèneraient le robot à mal évaluer la position des obstacles.

De meilleures mesures de profondeur à des trajectoires plus sûres

Les chercheurs ont évalué leur méthode sur un petit robot de type entrepôt équipé de deux scanners laser peu coûteux et d’une caméra de profondeur Intel RealSense. Dans des tests contrôlés comparés à la vérité de terrain laser, l’erreur de distance de la caméra a chuté fortement après étalonnage — par exemple, à environ 2,16 mètres, l’erreur moyenne est passée de 0,604 mètre à 0,340 mètre, soit une réduction d’environ 43 %. Lorsque l’équipe a comparé différents modes de cartographie, une configuration basée uniquement sur la caméra n’a pas réussi à construire une carte stable, et même une fusion naïve des données de caméra non corrigées avec le LiDAR a produit de nombreux faux obstacles, le sol étant marqué à tort comme occupé. La fusion calibrée, en revanche, a produit des cartes plus nettes avec une incertitude réduite, détecté des obstacles minces et bas que le laser seul manquait, et amélioré la précision de la fermeture de boucles, le tout en s’exécutant suffisamment vite pour la navigation en temps réel.

Ce que cela signifie pour les robots en conditions réelles

Concrètement, ce travail propose une recette simple pour rendre les robots d’intérieur plus sûrs et plus fiables sans recourir à des capteurs coûteux et haut de gamme. En laissant un laser précis mais limité « enseigner » discrètement une caméra de profondeur moins chère, puis en combinant leurs mesures dans une grille 2D commune, le robot obtient une image plus fidèle de son environnement — en particulier pour des éléments délicats comme les rayonnages creux, les grillages et les objets bas. Bien que cette intelligence supplémentaire exige un peu de puissance de calcul et ne résolve pas entièrement des problèmes comme des conditions d’éclairage extrêmes, elle rapproche les robots à bas coût d’une perception robuste et digne de confiance, nécessaire dans des entrepôts, des usines et autres espaces intérieurs fréquentés par des humains et des machines partageant le même sol.

Citation: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Mots-clés: cartographie robotique, fusion de capteurs, LiDAR, caméra de profondeur, navigation intérieure