Clear Sky Science · ru

Создание 2D-карт на основе данных RGBD-камеры и LiDAR

Умные карты для повседневных пространств

От складских роботов, маневрирующих между паллетами, до домашних машин, избегающих мебели — мобильным роботам нужны хорошие карты, чтобы оставаться в безопасности. Однако используемые ими сенсоры — лазерные сканеры и камеры глубины — имеют собственные «слепые зоны». В этом исследовании показано, как сочетание простого лазерного сканера с недорогой камерой глубины и автоматическая корректировка ошибок камеры в реальном времени позволяют небольшим роботам в помещениях получать более чёткие и безопасные карты окружения.

Почему одного сенсора бывает мало

Современные роботы часто полагаются либо на камеру глубины (которая фиксирует цвет и расстояние), либо на лазерный сканер (измеряющий расстояние световыми импульсами). Камеры глубины недороги и компактны, но испытывают трудности при слабом свете, при ярких бликах или на больших расстояниях, и их показания расстояния с увеличением дальности склонны к систематическому смещению. Лазерные сканеры, напротив, исключительно точны и работают в темноте, но обычно дают измерения только в тонком горизонтальном сечении и могут пропускать объекты, находящиеся выше или ниже этой плоскости — например, низкие паллеты, нависающие полки или полые конструкции. К тому же лазерные системы часто дороже и требовательнее к вычислениям. По отдельности ни один тип сенсора не даёт богатого и надёжного обзора, необходимого для стеснённых пространств и загруженных внутренних логистических узлов.

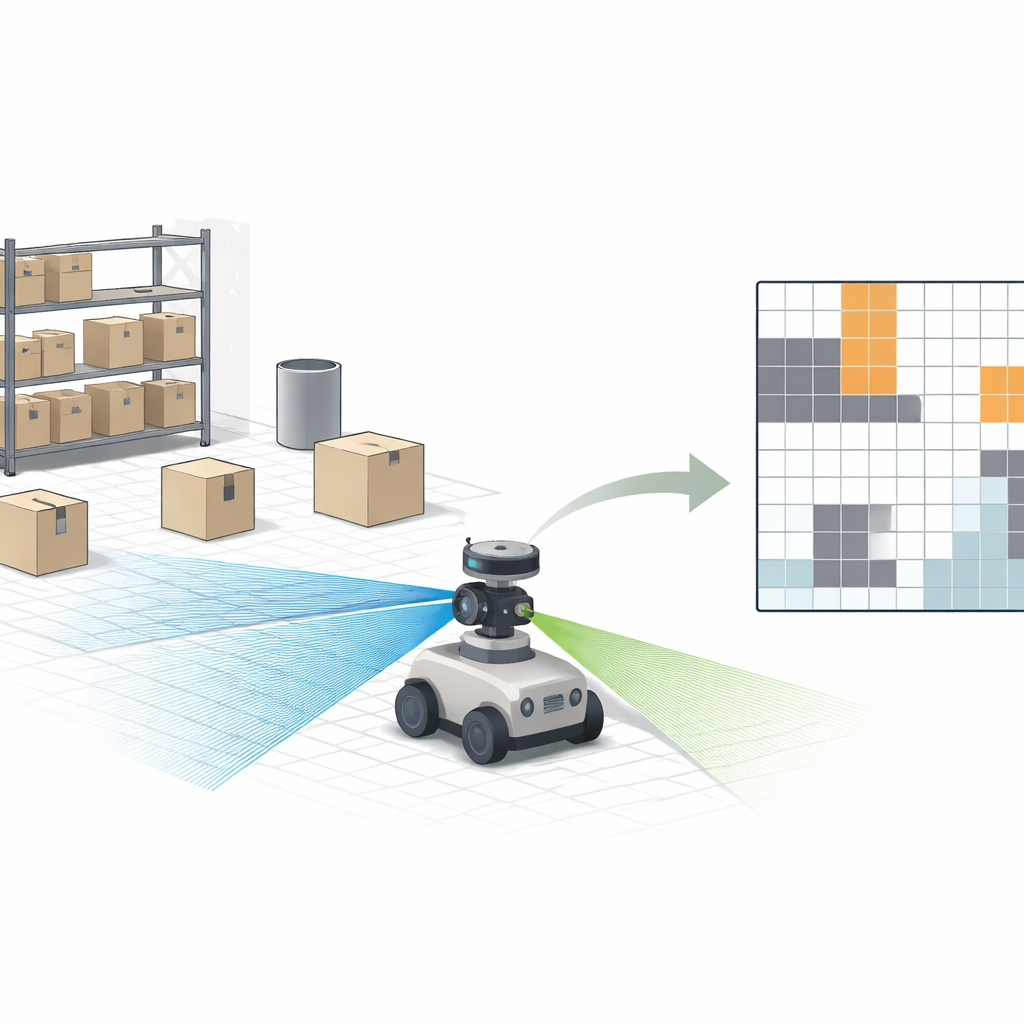

Слияние двух видов данных в одно ясное представление

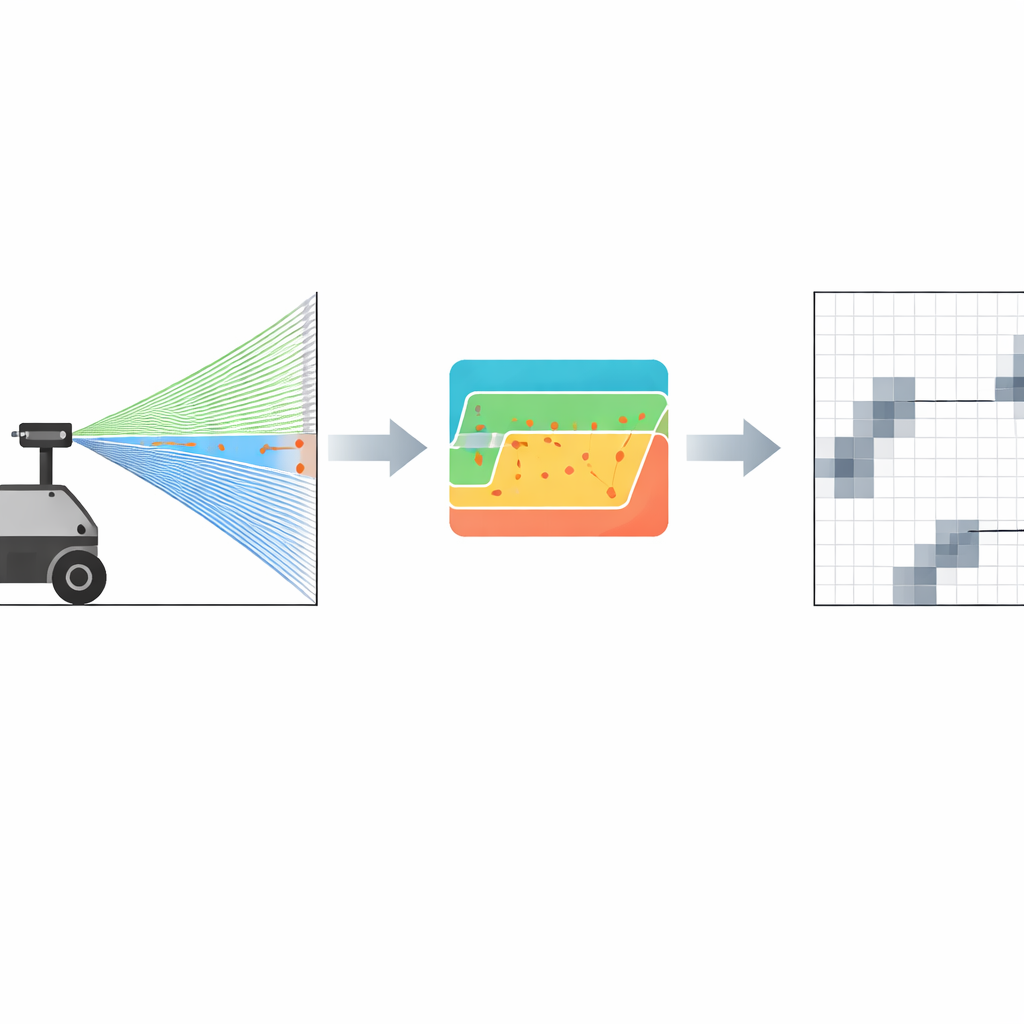

Авторы устраняют этот разрыв, объединяя сильные стороны обоих сенсоров в единую 2D-сеточную карту — карту, где пол делится на маленькие клетки, помечаемые как свободные или занятые. Робот несёт недорогую RGBD-камеру (цвет плюс глубина) и планарный LiDAR-сканер. Сначала все измерения приводят к общей системе координат, чтобы точка, увиденная камерой или лазером, оказалась в одном и том же месте на карте. Затем, вместо попыток поддерживать полный 3D-модель, проектируют только релевантные 3D-точки на плоскость пола, отфильтровывая завалы на потолке и полу. Вероятностная схема обновляет каждую ячейку сетки в зависимости от надёжности каждого сенсора на данном расстоянии: показания лазера рассматриваются как высоконадежные в рабочем диапазоне, тогда как влияние камеры плавно уменьшается с ростом расстояния по мере увеличения её шума.

Позвольте лазеру корректировать камеру

Ключевым нововведением является лёгкий шаг калибровки, который позволяет роботу непрерывно корректировать смещение глубины камеры в поле. Когда робот сталкивается с ровной стеной, он использует миллиметрово-точное расстояние лазера как «истину». Робустная процедура подгонки оценивает точное расстояние до стены по данным лазера, даже в присутствии шума. Система затем сравнивает это значение с показаниями камеры и корректирует единый смещающий коэффициент глубины так, чтобы среднее значение камеры совпало с лазерным. Важно, что этот процесс не требует сложных шахматных шаблонов, манипуляторов с контролируемым движением или полной шестистепенной калибровки; его можно быстро запустить в реальном складе, когда в поле зрения появляется подходящая ровная поверхность. Такая оперативная подстройка напрямую уменьшает систематические ошибки камеры, которые в противном случае заставили бы робота ошибочно оценивать положение препятствий.

От более чистой глубины к более безопасным маршрутам

Исследователи оценили свой метод на небольшом роботе складского типа, оснащённом двумя недорогими лазерными сканерами и камерой Intel RealSense. В контролируемых тестах относительно лазерной «эталонной» меры ошибка расстояния камеры значительно сократилась после калибровки — например, на примерно 2.16 метра средняя ошибка упала с 0.604 м до 0.340 м, что составляет примерно 43% сокращения. При сравнении различных режимов картографирования установка «только камера» не смогла построить стабильную карту, а даже наивное слияние некорректных данных камеры с LiDAR давало множество ложных препятствий — пол неверно помечался как занятый. Калиброванное слияние, однако, давало более чёткие карты с меньшей неопределённостью, обнаруживало тонкие и низко расположенные препятствия, которые лазер пропускал, и улучшало точность замыкания петель, при этом работая достаточно быстро для навигации в реальном времени.

Что это значит для реальных роботов

В практическом смысле работа предлагает простой рецепт для повышения безопасности и надёжности внутренних роботов без обращения к дорогим датчикам высокого класса. Позволяя точному, но ограниченному лазеру «обучать» более дешёвую камеру глубины и затем объединяя их показания в общую 2D-сетку, робот получает более правдоподобное представление об окружении — особенно для сложных объектов вроде пустотелых стеллажей, проволочных сеток и низких предметов. Хотя эта дополнительная интеллигенция требует некоторой вычислительной мощности и не полностью решает проблемы вроде экстремального освещения, она приближает недорогих роботов к надёжному восприятию, необходимому для загруженных складов, фабрик и других помещений, где люди и машины должны безопасно делить пространство пола.

Цитирование: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Ключевые слова: картирование роботов, слияние датчиков, LiDAR, камера глубины, навигация в помещении