Clear Sky Science · de

Erstellung einer 2D-Gitterkarte basierend auf RGBD-Kamera- und LiDAR-Daten

Intelligentere Karten für Alltagsräume

Von Lagerrobotern, die Paletten ausweichen, bis zu Haushaltsrobotern, die um Möbel manövrieren: mobile Maschinen benötigen zuverlässige Karten, um sicher zu funktionieren. Die für die Wahrnehmung eingesetzten Sensoren — Laserscanner und Tiefenkameras — haben jedoch jeweils blinde Flecken. Diese Studie zeigt, wie die Kombination eines einfachen Laserscanners mit einer kostengünstigen Tiefenkamera und die automatische Korrektur der Kamera-Fehler in Echtzeit kleinen Innenraumrobotern klarere und sicherere Karten ihrer Umgebung liefern kann.

Warum einzelne Sensoren nicht ausreichen

Heutige Roboter verlassen sich oft entweder auf eine Tiefenkamera (die Farbe und Entfernung erfasst) oder auf einen Laserscanner (der Entfernung mit Lichtimpulsen misst). Tiefenkameras sind günstig und kompakt, haben aber Probleme bei schwachem Licht, starkem Gegenlicht oder jenseits weniger Meter; ihre Distanzmessungen driften mit wachsender Entfernung zunehmend von der Realität ab. Laserscanner sind dagegen extrem präzise und funktionieren im Dunkeln, messen jedoch meist nur eine dünne horizontale Ebene und können Objekte ober- oder unterhalb dieser Ebene übersehen, etwa niedrige Paletten, hervorstehende Regalböden oder hohle Strukturen. Außerdem sind Lasersysteme oft teurer und rechenintensiver. Allein liefern die Sensoren nicht die detaillierte, verlässliche Sicht, die für enge Räume und belebte Indoor-Logistikumgebungen nötig ist.

Zwei Perspektiven zu einem klaren Bild verschmelzen

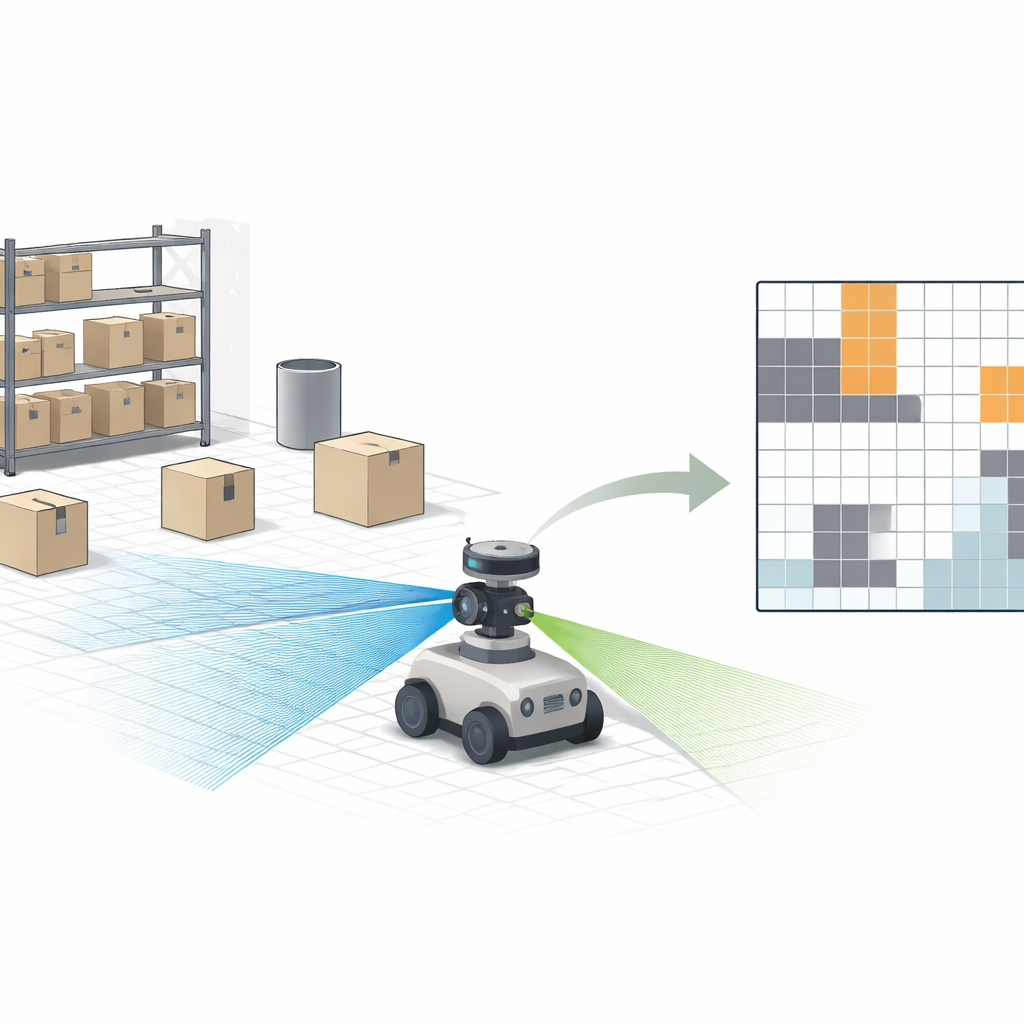

Die Autoren schließen diese Lücke, indem sie die Stärken beider Sensoren zu einer einzigen 2D-Gitterkarte verschmelzen — einer Karte, bei der der Boden in kleine Quadrate eingeteilt wird, die als frei oder belegt markiert sind. Ihr Roboter trägt eine kostengünstige RGBD-(Farbe plus Tiefe)-Kamera und einen planaren LiDAR-Scanner. Zuerst bringen sie alle Messungen in einen gemeinsamen Referenzrahmen, sodass ein Punkt, der von der Kamera oder dem Laser gesehen wurde, an derselben Stelle auf der Karte landet. Statt ein vollständiges 3D-Modell zu pflegen, projizieren sie nur die relevanten 3D-Punkte auf die Bodenebene und filtern Decken- und Bodenstörungen heraus. Ein probabilistisches Schema aktualisiert jede Gitterzelle basierend auf der Vertrauenswürdigkeit der jeweiligen Sensoren in der gegebenen Entfernung: Laserwerte gelten im Arbeitsbereich als sehr zuverlässig, während der Einfluss der Kamera mit der Entfernung und dem zunehmenden Rauschen sanft abnimmt.

Die Laserhilfe zur Korrektur der Kamera

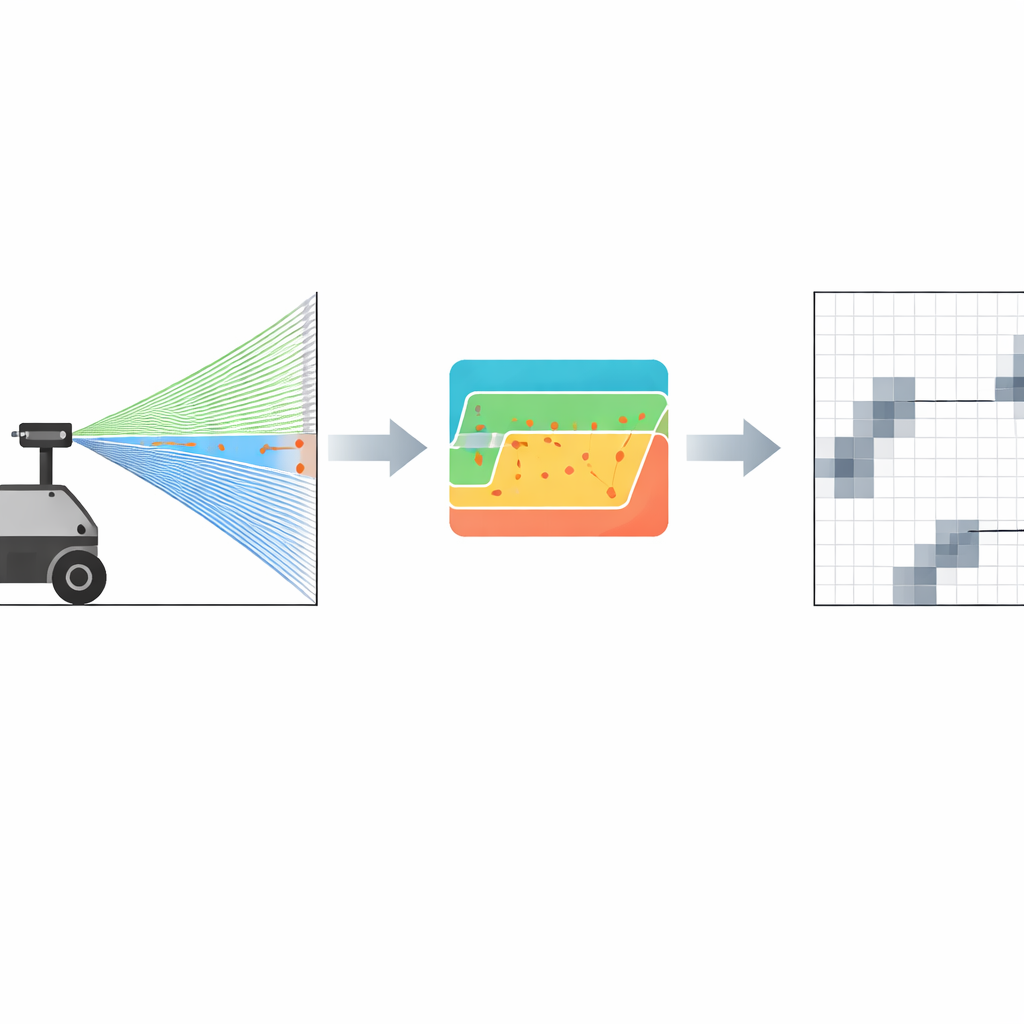

Eine zentrale Neuerung ist ein leichtgewichtiger Kalibrierungsschritt, der dem Roboter erlaubt, den Tiefen-Bias der Kamera kontinuierlich im Feld zu korrigieren. Wenn der Roboter auf eine ebene Wand blickt, nutzt er die millimetergenaue Laserentfernung als „Ground Truth“. Ein robuster Anpassungsprozess schätzt die genaue Distanz zu dieser Wand aus den Laserdaten, selbst bei vorhandenem Rauschen. Das System vergleicht diese Messung anschließend mit den Kamerawerten und passt einen einzelnen Tiefenoffset so an, dass der durchschnittliche Kamerawert mit dem Laser übereinstimmt. Entscheidend ist, dass dieser Prozess keine aufwändigen Schachbrettmuster, bewegungskontrollierte Arme oder vollständige sechs Freiheitsgrade umfassende Kalibrierungen erfordert; er lässt sich schnell in einem realen Lager auslösen, sobald eine geeignete ebene Fläche im Blick ist. Diese Echtzeit-Anpassung reduziert systematische Kamerafehler direkt, die ansonsten dazu führen würden, dass der Roboter Hindernisse falsch lokalisierte.

Von sauberer Tiefe zu sichereren Fahrpfaden

Die Forschenden evaluierten ihre Methode auf einem kleinen lagerähnlichen Roboter, ausgestattet mit zwei kostengünstigen Laserscannern und einer Intel RealSense-Tiefenkamera. In kontrollierten Tests gegenüber dem Laser-Ground-Truth sank der Distanzfehler der Kamera nach der Kalibrierung deutlich — zum Beispiel bei etwa 2,16 Metern fiel der mittlere Fehler von 0,604 Metern auf 0,340 Meter, eine Reduktion von rund 43 Prozent. Beim Vergleich verschiedener Kartierungsmodi scheiterte ein reines Kamera-Setup daran, eine stabile Karte aufzubauen, und selbst eine naive Fusion unkalibrierter Kameradaten mit LiDAR erzeugte viele Fehlhindernisse, da der Boden fälschlich als belegt markiert wurde. Die kalibrierte Fusion hingegen lieferte schärfere Karten mit geringerer Unsicherheit, erkannte dünne und niedrig liegende Hindernisse, die der Laser allein verpasste, und verbesserte die Loop-Closure-Genauigkeit — und das alles bei Rechenzeiten, die für Echtzeit-Navigation ausreichend sind.

Was das für Roboter im realen Einsatz bedeutet

Praktisch gesehen bietet die Arbeit ein einfaches Rezept, um Innenraumroboter sicherer und verlässlicher zu machen, ohne auf teure High-End-Sensorik zurückzugreifen. Indem ein präziser, aber eingeschränkter Laser einer günstigeren Tiefenkamera „leise“ das richtige Maß beibringt und die Messwerte zu einer gemeinsamen 2D-Gitterkarte kombiniert werden, erhält der Roboter ein ehrlicheres Bild seiner Umgebung — insbesondere bei schwierigen Merkmalen wie hohlen Regalen, Drahtgittern und niedrigen Objekten. Zwar erfordert diese zusätzliche Intelligenz etwas Rechenleistung und löst nicht alle Probleme wie extreme Beleuchtungsverhältnisse vollständig, sie bringt kostengünstige Roboter jedoch näher an die robuste, vertrauenswürdige Wahrnehmung, die für stark frequentierte Lagerhallen, Fabriken und andere Innenräume nötig ist, in denen Menschen und Maschinen den Boden sicher teilen müssen.

Zitation: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Schlüsselwörter: Roboterkartierung, Sensorfusion, LiDAR, Tiefenkamera, Indoor-Navigation