Clear Sky Science · it

Creazione di mappe a griglia 2D basata su dati di fotocamera RGBD e LiDAR

Mappe robotiche più intelligenti per gli spazi di tutti i giorni

Dai robot di magazzino che schivano i pallet ai robot domestici che si muovono tra i mobili, le macchine che si spostano nel mondo hanno bisogno di buone mappe per restare sicure. Tuttavia, i sensori con cui vedono — scanner laser e fotocamere di profondità — hanno ciascuno punti ciechi. Questo studio mostra come combinare un semplice scanner laser con una fotocamera di profondità economica, correggendo automaticamente gli errori della fotocamera in tempo reale, possa fornire ai piccoli robot per interni mappe dell’ambiente più chiare e sicure.

Perché un singolo sensore non basta

I robot odierni spesso si affidano a una fotocamera di profondità (che vede colore e distanza) o a uno scanner laser (che misura la distanza con impulsi di luce). Le fotocamere di profondità sono economiche e compatte, ma faticano in condizioni di scarsa luce, con riflessi intensi o oltre pochi metri, e le loro misure di distanza si discostano progressivamente dalla realtà all’aumentare della portata. Gli scanner laser, al contrario, sono estremamente precisi e funzionano al buio, ma in genere rilevano solo una sottile fetta orizzontale del mondo e possono non vedere oggetti sopra o sotto quel piano, come pallet bassi, scaffali sporgenti o strutture cavi. Inoltre, i sistemi laser tendono a essere più costosi e onerosi dal punto di vista computazionale. Da soli, né l’uno né l’altro sensore offrono la vista ricca e affidabile necessaria per spazi ristretti e hub logistici indoor affollati.

Fondere due prospettive in un’unica immagine chiara

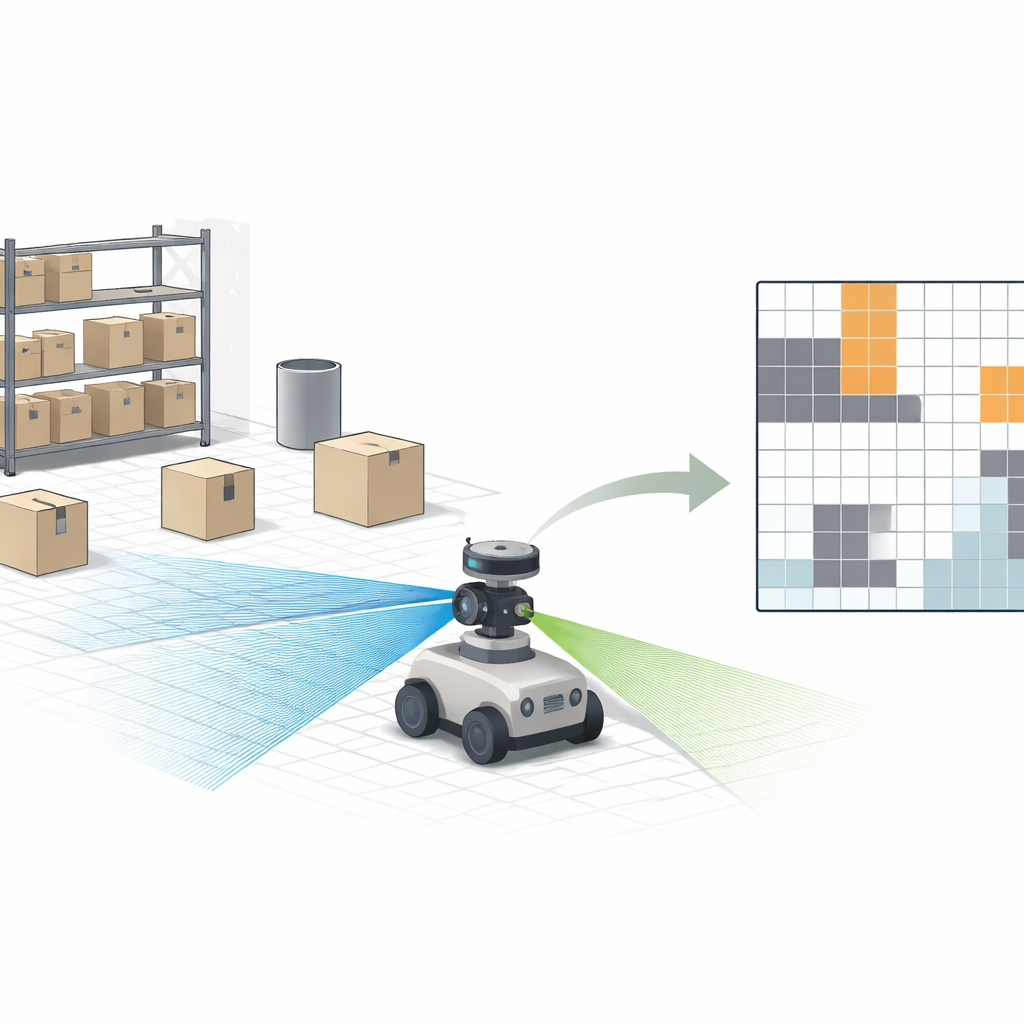

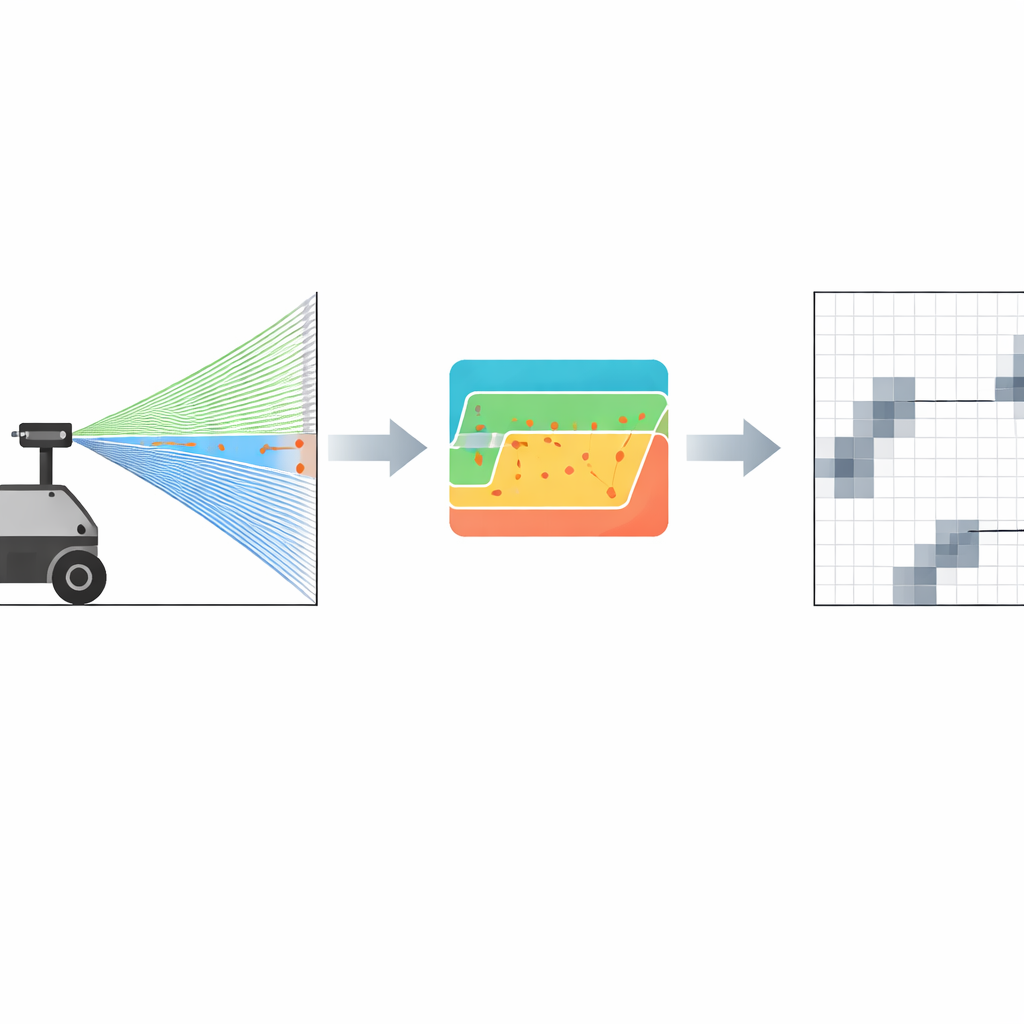

Gli autori colmano questo divario fondendo i punti di forza di entrambi i sensori in una singola mappa a griglia 2D — il tipo di mappa in cui il pavimento è diviso in piccole celle contrassegnate come libere o occupate. Il loro robot porta una fotocamera RGBD a basso costo (colore più profondità) e uno scanner LiDAR planare. Innanzitutto, allineano tutte le misurazioni in un riferimento comune, così che un punto visto dalla fotocamera o dal laser finisca nello stesso punto sulla mappa. Poi, invece di mantenere un modello 3D completo, proiettano solo i punti 3D rilevanti sul piano del pavimento, filtrando il rumore proveniente da soffitto e altre superfici. Uno schema probabilistico aggiorna ciascuna cella della griglia basandosi sull’affidabilità di ogni sensore a una data distanza: le letture laser sono trattate come altamente affidabili nell’intervallo operativo, mentre l’influenza della fotocamera si affievolisce con la distanza man mano che il suo rumore aumenta.

Lasciare che il laser correzioni la fotocamera

Un’innovazione chiave è una fase di calibrazione leggera che permette al robot di correggere continuamente lo bias di profondità della fotocamera in campo. Quando il robot si trova di fronte a una parete piana, utilizza la distanza al millimetro fornita dal laser come “verità di riferimento”. Una procedura di fitting robusta stima la distanza precisa a quella parete dai dati laser, anche in presenza di rumore. Il sistema confronta quindi questa misura con quanto riporta la fotocamera e aggiusta un singolo offset di profondità in modo che la lettura media della fotocamera corrisponda a quella del laser. Fondamentale è che questo processo non richiede schemi a scacchiera elaborati, bracci con controllo di movimento o una calibrazione completa a sei gradi di libertà; può essere attivato rapidamente in un magazzino reale ogni volta che è visibile una superficie piana adatta. Questa messa a punto in tempo reale riduce direttamente gli errori sistematici della fotocamera che altrimenti porterebbero il robot a giudicare male la posizione degli ostacoli.

Dalla profondità ripulita a percorsi più sicuri

I ricercatori hanno valutato il loro metodo su un piccolo robot in stile magazzino equipaggiato con due scanner laser a basso costo e una fotocamera Intel RealSense. Nei test controllati rispetto alla verità di riferimento laser, l’errore di distanza della fotocamera è diminuito bruscamente dopo la calibrazione — per esempio, a circa 2,16 metri l’errore medio è passato da 0,604 metri a 0,340 metri, una riduzione di circa il 43 percento. Confrontando diverse modalità di mappatura, una configurazione con sola fotocamera non è riuscita a costruire una mappa stabile, e persino una fusione ingenua di dati della fotocamera non corretti con il LiDAR ha prodotto molti falsi ostacoli, poiché il pavimento veniva segnato ingiustamente come occupato. La fusione calibrata, invece, ha generato mappe più nitide con minore incertezza, ha rilevato ostacoli sottili e bassi che il solo laser perdeva e ha migliorato la precisione nella chiusura dei loop, il tutto funzionando abbastanza velocemente per la navigazione in tempo reale.

Cosa significa per i robot nel mondo reale

In termini pratici, il lavoro offre una ricetta semplice per rendere i robot per interni più sicuri e affidabili senza ricorrere a sensori costosi e di fascia alta. Lasciando che un laser preciso ma limitato “insegni” silenziosamente a una fotocamera di profondità più economica, e combinando poi le loro misure in una griglia 2D comune, il robot ottiene un quadro più veritiero del suo intorno — soprattutto per caratteristiche difficili come scaffalature cave, reti metalliche e oggetti bassi. Sebbene questa intelligenza aggiuntiva richieda una certa potenza di calcolo e non risolva completamente problemi come condizioni di luce estreme, avvicina i robot a basso costo al tipo di percezione robusta e affidabile necessaria per magazzini, fabbriche e altri spazi interni affollati dove persone e macchine devono condividere il pavimento in sicurezza.

Citazione: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Parole chiave: mappatura robotica, fusione di sensori, LiDAR, fotocamera di profondità, navigazione indoor