Clear Sky Science · sv

Skapande av 2D-rutnätskartor baserat på RGBD-kamera och LiDAR-data

Smartare robotkartor för vardagsmiljöer

Från lagerrobotar som undviker pallar till hemrobotar som slingrar sig förbi möbler — maskiner som rör sig i världen behöver bra kartor för att vara säkra. Men sensorerna de använder för att se — laserskannrar och djuppkameror — har vardera blinda fläckar. Denna studie visar hur kombinationen av en enkel laserskanner med en billig djuppkamera, tillsammans med automatisk korrigering av kamerans fel under drift, kan ge små inomhusrobotar klarare och säkrare kartor över deras omgivning.

Varför enskilda sensorer inte räcker

Dagens robotar förlitar sig ofta antingen på en djuppkamera (som ser färg och avstånd) eller en laserskanner (som mäter avstånd med ljuspulser). Djuppkameror är billiga och kompakta, men de har problem i svagt ljus, stark bländning eller på flera meters avstånd, och deras avståndsmätningar driver långsamt ifrån sanningen när räckvidden ökar. Laserskannrar, däremot, är extremt precisa och fungerar i mörker, men de registrerar vanligtvis bara ett smalt horisontellt snitt av världen och kan missa objekt som befinner sig över eller under det planet, som låga pallar, hängande hyllor eller ihåliga strukturer. Dessutom tenderar lasersystem att vara dyrare och kräva mer beräkningskraft. Var för sig ger ingen av sensortyperna den rika, tillförlitliga bild som krävs i trånga utrymmen och fulla inomhuslogistikmiljöer.

Sammansmälta två vyer till en tydlig bild

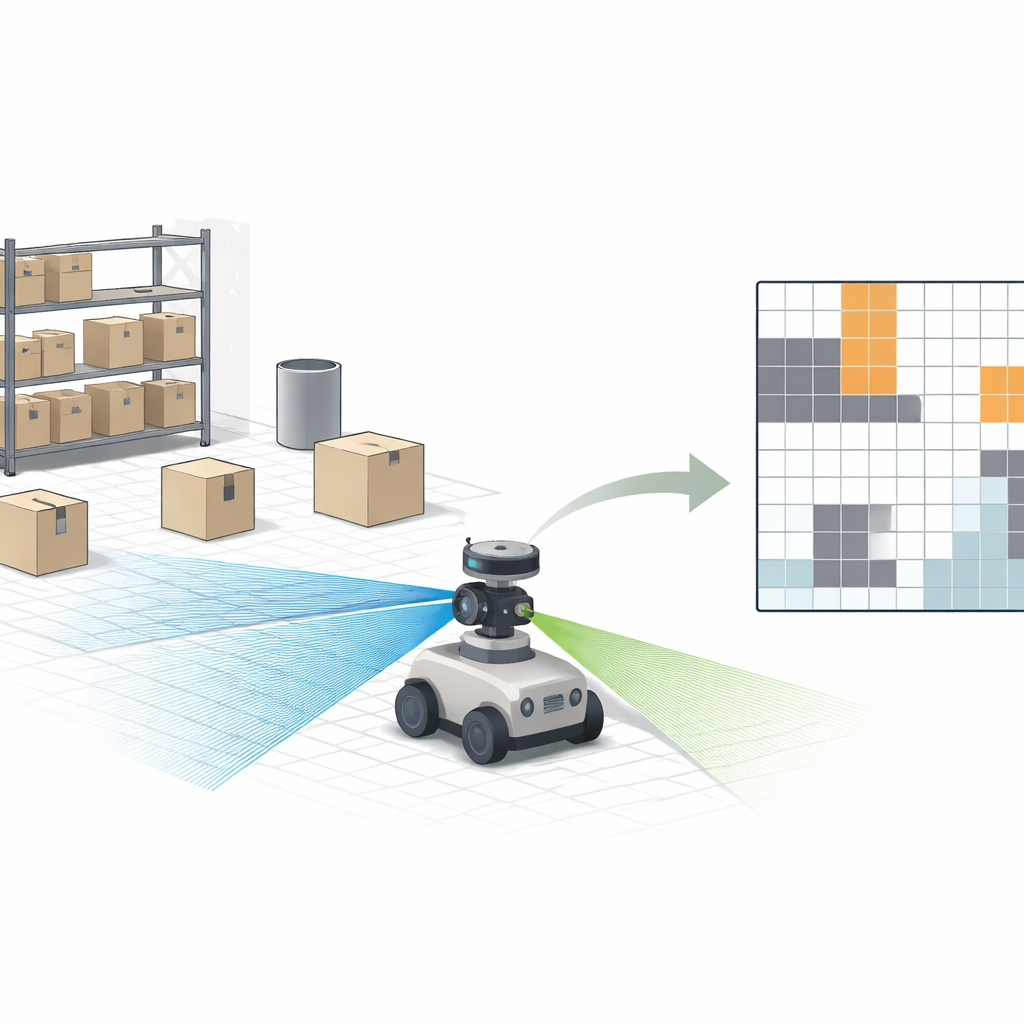

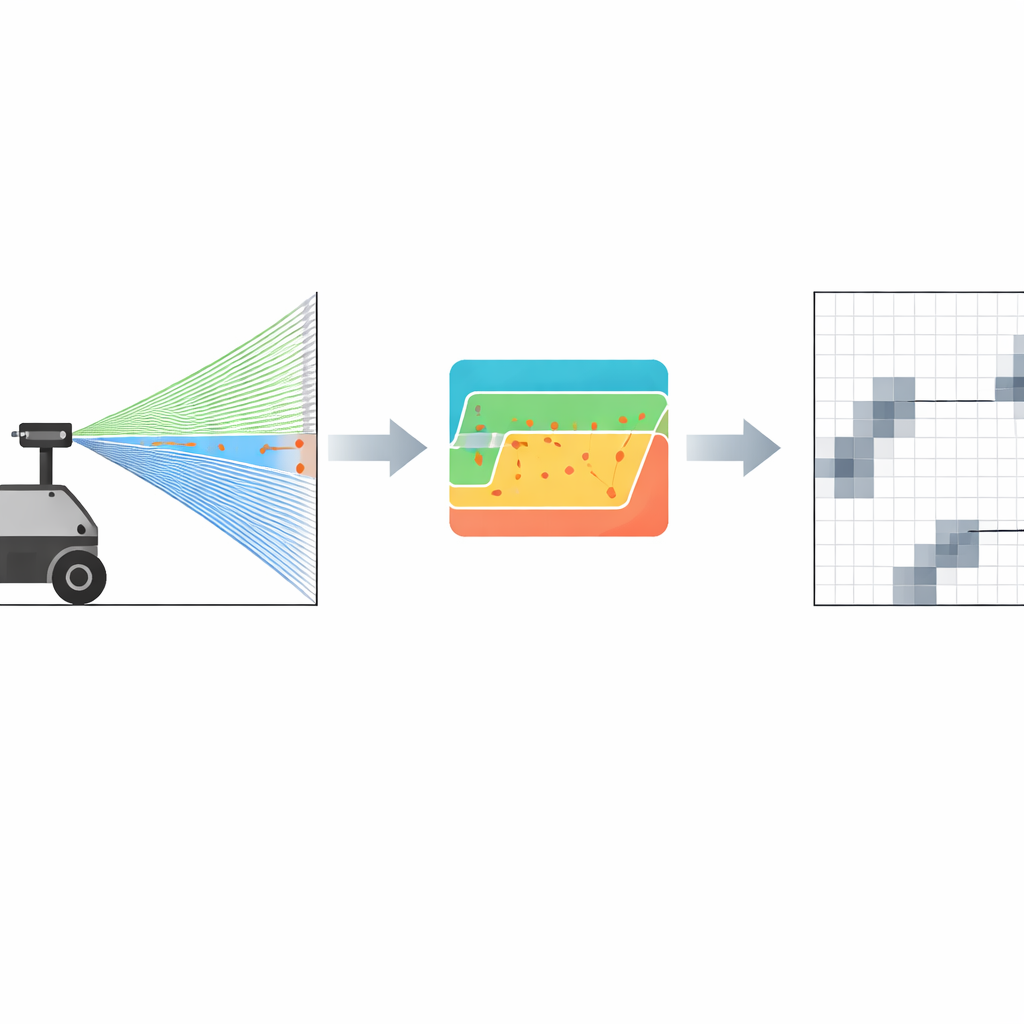

Författarna hanterar denna brist genom att förena styrkorna hos båda sensorerna i en enda 2D-rutnätskarta — den typ av karta där golvet delas in i små rutor som markeras som fria eller upptagna. Deras robot bär en lågkostnads RGBD-kamera (färg plus djup) och en plan LiDAR-skanner. Först justerar de alla mätningar till ett gemensamt referenssystem, så att en punkt som ses av kameran eller lasern hamnar på samma plats på kartan. Istället för att försöka bibehålla en full 3D-modell projicerar de sedan bara de relevanta 3D-punkterna ned på golvplanet och filtrerar bort tak- och golbrot. Ett probabilistiskt schema uppdaterar varje rutcell baserat på hur pålitlig varje sensor är vid ett givet avstånd: laseravläsningarna behandlas som mycket tillförlitliga inom arbetsområdet, medan kamerans inflytande avtar med avståndet när dess brus ökar.

Låt lasern rätta kameran

En nyckelinnovation är ett lättviktigt kalibreringssteg som låter roboten kontinuerligt korrigera kamerans djupbias i fält. När roboten står mot en plan vägg använder den laserns millimeternoga avstånd som “sanningen”. En robust anpassningsprocedur uppskattar det exakta avståndet till väggen från laserdata, även i närvaro av brus. Systemet jämför detta med vad kameran rapporterar och justerar ett enda djuppoffset så att kamerans genomsnittliga mätning matchar laserns. Viktigt är att denna process inte kräver invecklade schackrutemönster, rörelsekontrollerade armar eller full kalibrering i sex frihetsgrader; den kan triggas snabbt i ett verkligt lager när en lämplig plan yta finns i sikte. Denna snabba fininställning reducerar direkt systematiska kamerafel som annars skulle få roboten att felbedöma var hinder finns.

Från renare djupdata till säkrare rutter

Forskarna utvärderade sin metod på en liten lagerliknande robot utrustad med två lågkostnads laserskannrar och en Intel RealSense-djuppkamera. I kontrollerade tester mot laser-sanningen minskade kamerans avståndsfel kraftigt efter kalibrering — till exempel vid cirka 2,16 meter föll genomsnittsfel från 0,604 meter till 0,340 meter, en minskning på ungefär 43 procent. När teamet jämförde olika kartläggningslägen misslyckades enbart kamera med att bygga en stabil karta, och även en naiv fusion av okorrigerade kameradata med LiDAR gav många falska hinder eftersom golvet felaktigt markerades som upptaget. Den kalibrerade fusionen gav däremot skarpare kartor med lägre osäkerhet, upptäckte tunna och lågt liggande hinder som lasern ensam missade, och förbättrade loop-closure-precisionen — allt medan den körde tillräckligt snabbt för navigering i realtid.

Vad detta betyder för verkliga robotar

I praktiska termer erbjuder arbetet ett enkelt recept för att göra inomhusrobotar säkrare och mer tillförlitliga utan att behöva använda dyra, högpresterande sensorer. Genom att låta en precis men begränsad laser tyst "lära" en billigare djuppkamera, och sedan kombinera deras mätningar i ett gemensamt 2D-rutnät, får roboten en ärligare bild av sin omgivning — särskilt för knepiga detaljer som ihåliga ställ, trådnät och låga objekt. Även om denna extra intelligens kräver viss beräkningskraft och inte helt löser problem som extrem belysning, för den lågkostnadsrobotar närmare den robusta, pålitliga perception som behövs i hektiska lager, fabriker och andra inomhusmiljöer där människor och maskiner måste dela golvytan säkert.

Citering: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Nyckelord: robotkartläggning, sensorfusion, LiDAR, djuppkamera, inomhusnavigation