Clear Sky Science · pt

Criação de mapa em grade 2D baseada em dados de câmera RGBD e LiDAR

Mapas Robóticos Mais Inteligentes para Espaços do Dia a Dia

De robôs de depósito desviando paletes a robôs domésticos contornando móveis, máquinas que se movem pelo ambiente precisam de bons mapas para operar com segurança. Ainda assim, os sensores que usam para “ver” — scanners a laser e câmeras de profundidade — têm pontos cegos. Este estudo mostra como combinar um scanner a laser simples com uma câmera de profundidade de baixo custo, corrigindo automaticamente os erros da câmera em tempo real, pode fornecer a robôs pequenos em ambientes internos mapas mais claros e seguros do entorno.

Por que Sensores Isolados Não Bastam

Os robôs atuais costumam depender ou de uma câmera de profundidade (que captura cor e distância) ou de um scanner a laser (que mede distância por pulsos de luz). Câmeras de profundidade são baratas e compactas, mas têm problemas em luz fraca, em presença de brilho intenso ou além de alguns metros, e suas leituras de distância tendem a se desgarrar da verdade conforme o alcance aumenta. Scanners a laser, por outro lado, são extremamente precisos e funcionam no escuro, mas normalmente capturam apenas uma fatia horizontal fina do mundo e podem deixar de detectar objetos acima ou abaixo desse plano, como paletes baixos, prateleiras salientes ou estruturas ocos. Além disso, sistemas a laser costumam ser mais caros e exigentes em processamento. Isoladamente, nenhum dos dois tipos de sensor oferece a visão rica e confiável necessária para espaços apertados e centros logísticos internos lotados.

Unindo Duas Visões em Uma Imagem Clara

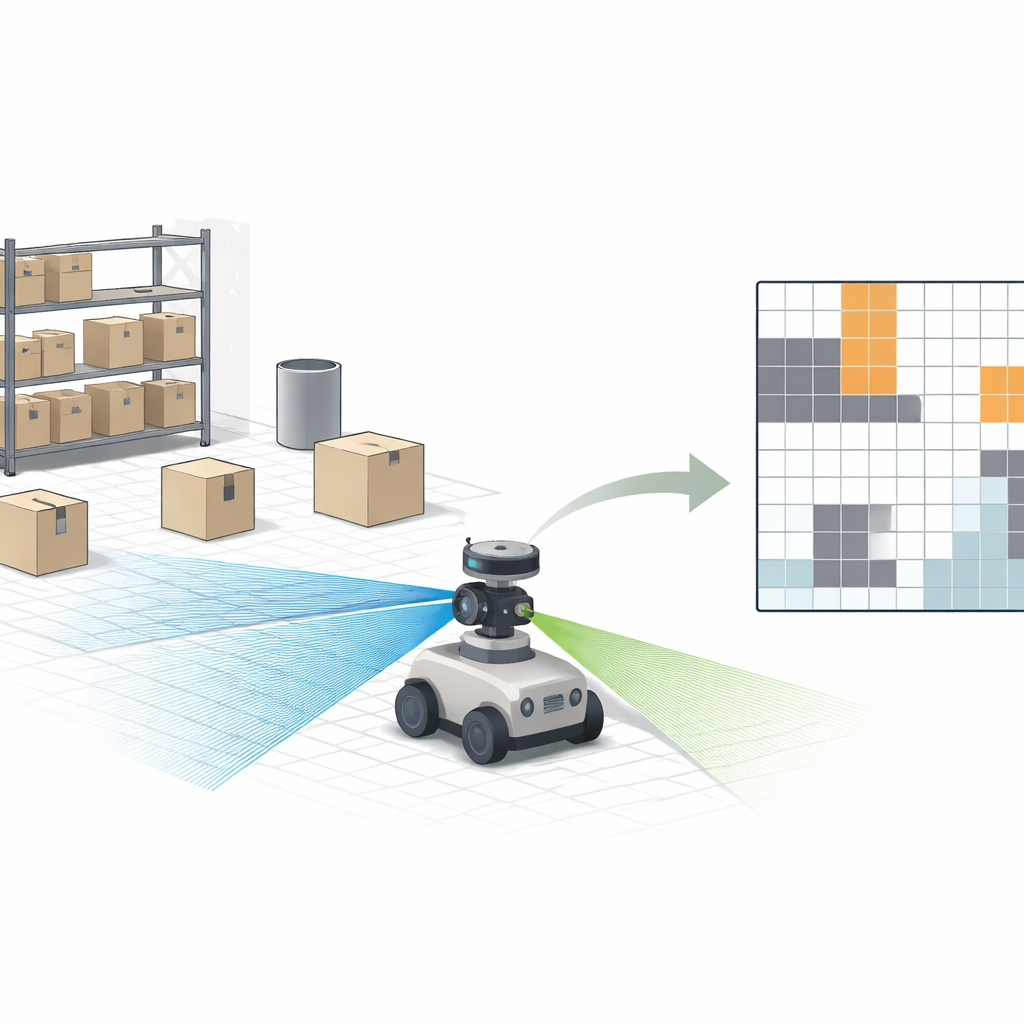

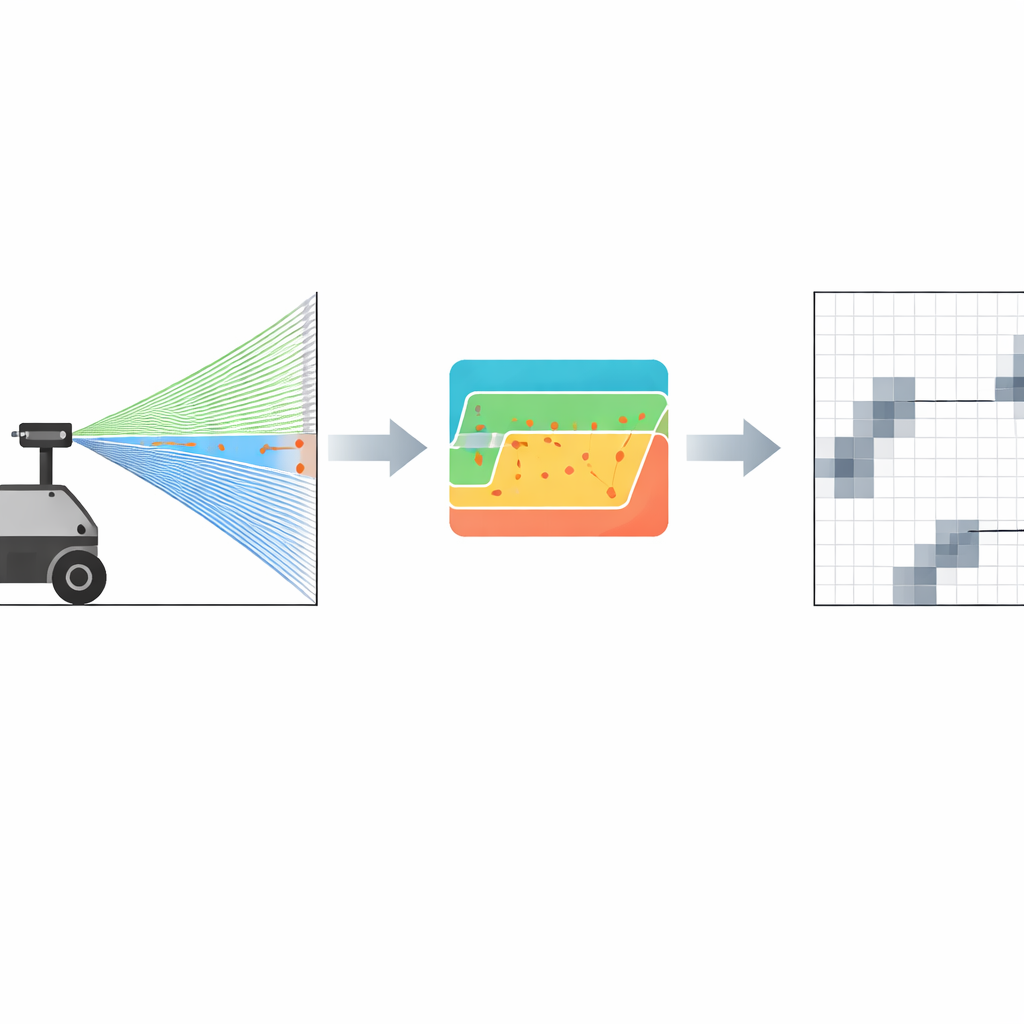

Os autores abordam essa lacuna fundindo as virtudes de ambos os sensores em um único mapa em grade 2D — o tipo de mapa em que o piso é dividido em pequenas células quadradas marcadas como livres ou ocupadas. O robô carrega uma câmera RGBD (cor mais profundidade) de baixo custo e um scanner LiDAR planar. Primeiro, eles alinham todas as medições em um referencial comum, de modo que um ponto visto pela câmera ou pelo laser termine no mesmo lugar no mapa. Depois, em vez de manter um modelo 3D completo, projetam apenas os pontos 3D relevantes no plano do piso, filtrando ruídos do teto e do próprio chão. Um esquema probabilístico atualiza cada célula da grade com base em quão confiável cada sensor é a uma dada distância: as leituras do laser são tratadas como altamente confiáveis dentro da faixa operacional, enquanto a influência da câmera decai suavemente com a distância à medida que seu ruído aumenta.

Deixando o Laser Corrigir a Câmera

Uma inovação chave é uma etapa de calibração leve que permite ao robô corrigir continuamente o viés de profundidade da câmera em campo. Quando o robô se depara com uma parede plana, ele usa a distância milimétrica do laser como “verdade de referência”. Um procedimento de ajuste robusto estima a distância precisa daquela parede a partir dos dados do laser, mesmo na presença de ruído. O sistema então compara isso com o que a câmera reporta e ajusta um único deslocamento de profundidade para que a leitura média da câmera coincida com a do laser. Crucialmente, esse processo não requer padrões de xadrez elaborados, braços de controle de movimento ou calibração completa em seis graus de liberdade; pode ser acionado rapidamente em um depósito real sempre que uma superfície plana adequada estiver visível. Esse ajuste em tempo real reduz diretamente erros sistemáticos da câmera que, de outra forma, fariam o robô avaliar incorretamente a posição de obstáculos.

Da Profundidade Mais Limpa a Trajetórias Mais Seguras

Os pesquisadores avaliaram seu método em um pequeno robô no estilo depósito equipado com dois scanners a laser de baixo custo e uma câmera de profundidade Intel RealSense. Em testes controlados contra a verdade de referência do laser, o erro de distância da câmera caiu abruptamente após a calibração — por exemplo, a cerca de 2,16 metros, o erro médio caiu de 0,604 metros para 0,340 metros, uma redução de aproximadamente 43 por cento. Quando a equipe comparou diferentes modos de mapeamento, uma configuração apenas com câmera não conseguiu construir um mapa estável, e mesmo uma fusão ingênua de dados de câmera não corrigidos com LiDAR produziu muitos falsos obstáculos, pois o piso foi erroneamente marcado como ocupado. A fusão calibrada, porém, gerou mapas mais nítidos com menor incerteza, detectou obstáculos finos e baixos que o laser sozinho perdeu, e melhorou a precisão no fechamento de laços, tudo isso rodando rápido o suficiente para navegação em tempo real.

O Que Isso Significa para Robôs no Mundo Real

Na prática, o trabalho oferece uma receita simples para tornar robôs internos mais seguros e confiáveis sem recorrer a sensores caros e de alto padrão. Ao permitir que um laser preciso, mas limitado, “ensine” silenciosamente uma câmera de profundidade mais barata, e então combinar suas leituras em uma grade 2D comum, o robô ganha uma imagem mais fiel do entorno — especialmente para características problemáticas como estantes ocas, malhas metálicas e objetos baixos. Embora essa inteligência adicional consuma algum poder computacional e não resolva completamente problemas como iluminação extrema, ela aproxima robôs de baixo custo do tipo de percepção robusta e confiável necessária para depósitos movimentados, fábricas e outros espaços internos onde pessoas e máquinas precisam compartilhar o piso com segurança.

Citação: Delhibabu, R., Zhukova, N.A. & Gizzatov, A. 2D grid map creation based on RGBD-camera and LiDAR data. Sci Rep 16, 10591 (2026). https://doi.org/10.1038/s41598-026-42698-3

Palavras-chave: mapeamento de robôs, fusão de sensores, LiDAR, câmera de profundidade, navegação interna