Clear Sky Science · zh

F-Transformer:一种用于高效且保护隐私的序列生成的联邦变换器

为何更小、更安全的语言工具很重要

每当你输入消息、在网上搜索或对手机语音输入时,软件都在后台尝试预测并生成自然流畅的语言。然而,今天最强大的语言模型体积庞大,对计算资源需求高,且通常需要将敏感文本发送到集中服务器。本文提出了一种新的构建方式,使语言模型既足够轻量以运行在有限硬件上,又尊重用户隐私,同时在性能上能与或优于当下的一些头条级系统。

从巨型模型到精简机器

现代语言工具通常基于变换器——一类擅长处理长句子与细微词间关系的神经网络。像 GPT-2 和 BERT 这样的著名系统包含数亿到数十亿参数,这使它们功能强大但也难以在日常设备上运行。它们通常在需收集大量文本的集中数据中心训练,这引发了隐私和数据所有权的担忧。作者认为,许多现实场景——从医院到移动设备——需要更小、需求更低且能在不集中原始数据的情况下学习的语言模型。

在不共享秘密的前提下共同学习

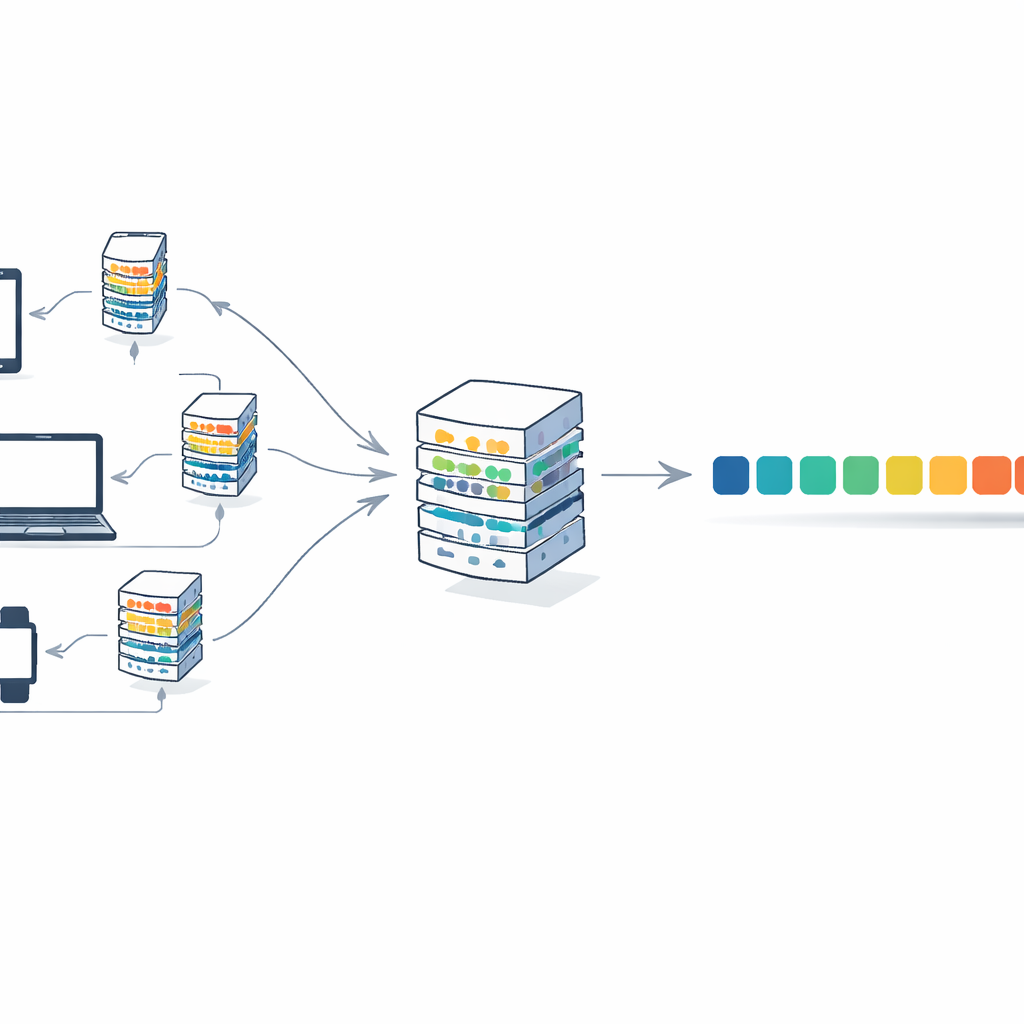

为了解决这些问题,论文将变换器与一种称为联邦学习的训练策略相结合。在该设置中,多个客户端——例如机构或设备——在本地保留其文本。每个客户端在私有数据上训练其模型副本,仅将更新后的模型权重(而非文本本身)发送到中央服务器。服务器将这些更新平均为单一的全局模型并返回给客户端。经过多轮迭代,模型通过汇集来自不同来源的知识而改进,但原始文档始终留在各自位置。这既降低了隐私风险,又将计算负担分摊到各个客户端,而不是依赖一台大型机器。

为共享而构建的紧凑设计

作者提出了 F-Transformer,一种为分布式、注重隐私的环境从头设计的变换器架构。他们不是简单地缩小现有的巨型模型,而是选择精简配置:仅 4 个注意力头、4 层和 64 维的词表征,总计约 0.87 百万可训练参数。他们概述了一个三层框架:负责本地文本和分词的数据层、运行紧凑变换器和联邦平均过程的人工智能层,以及可支持文本生成、翻译和问答等应用的应用层。作者还提出了一个数学目标函数,理论上将准确性与隐私融合为单一训练目标,通过抑制可能泄露单条记录太多信息的更新来兼顾两者。

更低算力与内存下的性能

为验证 F-Transformer,作者使用了广泛研究的 WikiText-2 维基百科文章集合,重点考察模型预测序列中下一个词的能力。他们不仅评估预测质量,还比较了处理器负载与内存使用,将集中式训练与联邦设置进行对比。尽管体积微小,F-Transformer 在验证困惑度(一种衡量模型预测文本能力的标准)上击败了若干知名且远大于它的模型,包括 BERT-Large 和 GPT-2 的某些变体(在数字归一化到相同尺度时)。同时,联邦版在处理器使用上约节省 40%,内存消耗约减少 34%,相较于可比的集中式基线。小模型尺寸还大幅降低了通信成本:在客户端与服务器之间传输模型更新的开销比 GPT-2 small 便宜一百多倍。

这对日常 AI 使用意味着什么

简单来说,该研究表明可以构建从众多分散数据源学习、保持原始文本私密并能在有限硬件上运行的语言模型——而不牺牲性能。F-Transformer 证明了经过精心设计的紧凑变换器能够与或超越更大系统,同时更易于部署在手机、边缘设备或敏感机构网络上。尽管论文的隐私保障主要体现在架构层面而非形式化度量,且在更多不同数据上的真实世界测试尚待开展,但结果指向这样一个未来:高质量的语言生成不再需要依赖庞大、集中且可能具有侵入性的 AI 基础设施。

引用: Patel, N., Brahmbhatt, S., Ramoliya, F. et al. F-Transformer: a federated transformer for efficient and privacy-preserving sequence generation. Sci Rep 16, 14093 (2026). https://doi.org/10.1038/s41598-026-40881-0

关键词: 联邦学习, 变换器语言模型, 保护隐私的人工智能, 轻量级自然语言处理, 序列生成