Clear Sky Science · de

F-Transformer: ein föderierter Transformer für effiziente und datenschutzfreundliche Sequenzgenerierung

Warum kleinere, sicherere Sprachwerkzeuge wichtig sind

Jedes Mal, wenn Sie eine Nachricht tippen, im Web suchen oder Ihrem Telefon diktieren, versucht Software im Stillen, natürliche Sprache vorherzusagen und zu erzeugen. Die derzeit leistungsstärksten Sprachmodelle sind jedoch riesig, ressourcenhungrig und erfordern oft das Senden sensibler Texte an zentrale Server. Dieses Paper stellt eine neue Methode vor, Sprachmodelle zu bauen, die sowohl leicht genug für bescheidene Hardware sind als auch die Privatsphäre der Nutzer respektieren, während sie dennoch die Leistung einiger heute viel beachteter Systeme erreichen oder übertreffen.

Von riesigen Modellen zu schlanken Maschinen

Moderne Sprachwerkzeuge basieren typischerweise auf Transformern, einer Familie neuronaler Netze, die darin brillieren, lange Sätze und subtile Wortbeziehungen zu verarbeiten. Bekannte Systeme wie GPT-2 und BERT beruhen auf hunderten Millionen bis Milliarden interner Parameter, was sie zwar mächtig, aber auch schwer auf Alltagsgeräten einsetzbar macht. Sie werden meist in zentralen Rechenzentren trainiert, die große Textmengen sammeln müssen, was Bedenken hinsichtlich Privatsphäre und Datenhoheit weckt. Die Autorinnen und Autoren argumentieren, dass viele reale Einsatzszenarien — von Krankenhäusern bis zu Mobilgeräten — Sprachmodelle brauchen, die deutlich kleiner, weniger anspruchsvoll und in der Lage sind, zu lernen, ohne alle Rohdaten an einen Ort zu ziehen.

Gemeinsam lernen, ohne Geheimnisse zu teilen

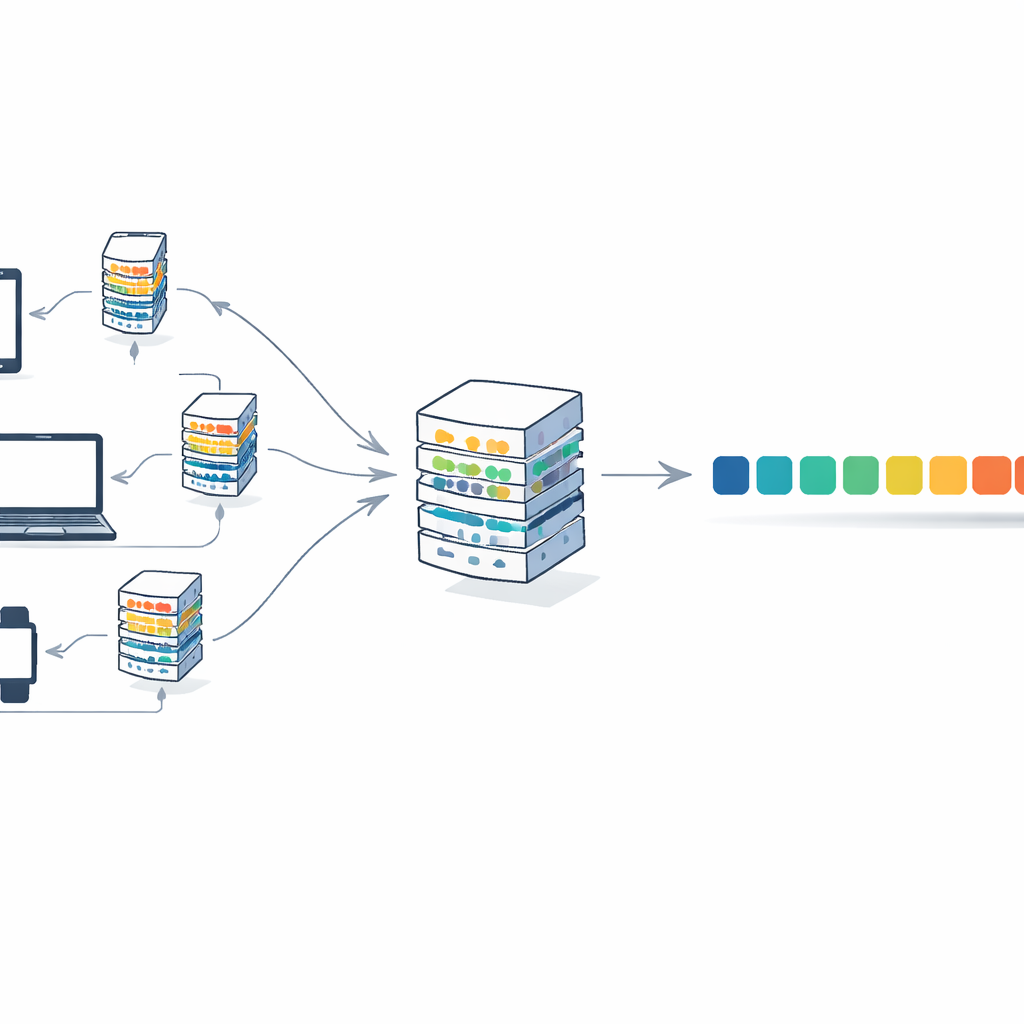

Um dem zu begegnen, kombiniert das Paper Transformer mit einer Trainingsstrategie namens föderiertes Lernen. In diesem Setup behalten viele Clients — etwa Institutionen oder Geräte — ihre Texte lokal. Jeder Client trainiert eine lokale Kopie des Modells auf seinen privaten Daten und sendet nur die aktualisierten Modellgewichte, nicht die Texte selbst, an einen zentralen Server. Der Server mittelt diese Updates zu einem globalen Modell und sendet es zurück. Über viele Runden verbessert sich das Modell, indem es Wissen aus verschiedenen Quellen bündelt, während keine Rohdokumente ihren Ursprungsort verlassen. Das reduziert Datenschutzrisiken und verteilt die Rechenlast auf die Clients, anstatt sich auf eine große Maschine zu stützen.

Ein kompakter Entwurf, gebaut fürs Teilen

Die Autorinnen und Autoren stellen den F-Transformer vor, eine Transformer-Architektur, die von Grund auf für diese verteilte, datenschutzbewusste Welt entworfen wurde. Anstatt ein bestehendes Riesenmodell zu verkleinern, wählen sie schlanke Einstellungen: nur 4 Attention-Heads, 4 Schichten und 64-dimensionale Wortrepräsentationen, insgesamt etwa 0,87 Millionen trainierbarer Parameter. Sie skizzieren ein dreischichtiges Rahmenwerk: eine Datenschicht, die lokale Texte und Tokenisierung verwaltet, eine KI-Schicht, die den kompakten Transformer und das föderierte Mittelungsverfahren ausführt, und eine Anwendungsschicht, die Einsatzfälle wie Textgenerierung, Übersetzung und Fragebeantwortung über viele Organisationen hinweg unterstützen kann. Außerdem präsentieren sie ein mathematisches Ziel, das zumindest theoretisch Genauigkeit und Privatsphäre in ein einziges Trainingsziel integriert, indem es Updates entmutigt, die zu viel über einzelne Datensätze verraten.

Leistung bei weniger Rechen- und Speicherbedarf

Um den F-Transformer zu testen, verwenden die Autorinnen und Autoren die weithin untersuchte WikiText-2-Sammlung mit Wikipedia-Artikeln und konzentrieren sich darauf, wie gut das Modell das nächste Wort in einer Sequenz vorhersagt. Sie bewerten nicht nur die Vorhersagequalität, sondern auch Prozessorlast und Speicherverbrauch und vergleichen zentrales Training mit ihrem föderierten Setup. Trotz seiner winzigen Größe erreicht der F-Transformer eine Validierungs-Perplexität — ein gängiges Maß dafür, wie gut ein Modell Text antizipiert —, die mehrere bekannte, deutlich größere Modelle übertrifft, einschließlich BERT-Large und Varianten von GPT-2, wenn die Zahlen auf dieselbe Skala normiert werden. Gleichzeitig senkt die föderierte Version den Prozessorverbrauch um etwa 40 Prozent und den Speicherbedarf um etwa 34 Prozent gegenüber einer vergleichbaren zentralen Basislinie. Die geringe Modellgröße reduziert zudem die Kommunikationskosten: das Übertragen von Modellupdates zwischen Clients und Server ist über hundertmal günstiger als bei GPT-2 small.

Was das für den Alltag der KI bedeutet

Kurz gesagt zeigt die Studie, dass es möglich ist, Sprachmodelle zu bauen, die von vielen verstreuten Datenquellen lernen, Rohtexte privat halten und auf bescheidener Hardware laufen — ohne Leistungseinbußen. Der F-Transformer beweist, dass ein sorgfältig gestalteter, kompakter Transformer mit deutlich größeren Systemen konkurrieren oder sie übertreffen kann und gleichzeitig einfacher auf Telefonen, Edge-Geräten oder in sensiblen institutionellen Netzen einsetzbar ist. Obwohl die Privatsphäregarantien des Papers eher architektonischer Natur sind und nicht formal gemessen wurden und Feldtests mit vielfältigeren Daten noch ausstehen, weisen die Ergebnisse auf eine Zukunft hin, in der qualitativ hochwertige Sprachgenerierung keine massive, zentralisierte und potenziell intrusive KI-Infrastruktur mehr erfordert.

Zitation: Patel, N., Brahmbhatt, S., Ramoliya, F. et al. F-Transformer: a federated transformer for efficient and privacy-preserving sequence generation. Sci Rep 16, 14093 (2026). https://doi.org/10.1038/s41598-026-40881-0

Schlüsselwörter: föderiertes Lernen, Transformer-Sprachmodell, datenschutzfreundliche KI, leichtgewichtige NLP, Sequenzgenerierung