Clear Sky Science · ar

F-Transformer: محول اتحادي لتوليد التسلسل بكفاءة وحفاظ على الخصوصية

لماذا تهم أدوات اللغة الأصغر والأكثر أمانًا

في كل مرة تكتب رسالة، أو تبحث على الويب، أو تملي على هاتفك، يحاول البرمجيات بهدوء التنبؤ وتوليد لغة تبدو طبيعية. لكن نماذج اللغة الأقوى اليوم ضخمة وتستهلك موارد حوسبة كبيرة، وغالبًا ما تتطلب إرسال نصوص حساسة إلى خوادم مركزية. يقدم هذا البحث طريقة جديدة لبناء نماذج لغوية خفيفة بما يكفي لمعدات متواضعة وتحترم خصوصية المستخدم، مع الحفاظ على أداء يضاهي أو يتفوق على بعض الأنظمة البارزة الحالية.

من النماذج العملاقة إلى آلات نحيفة

تعتمد أدوات اللغة الحديثة عادة على المحولات، وهي عائلة من الشبكات العصبية المتفوقة في التعامل مع الجمل الطويلة والعلاقات الدقيقة بين الكلمات. تعتمد أنظمة مشهورة مثل GPT-2 وBERT على مئات الملايين إلى بلايين المعاملات الداخلية، مما يجعلها قوية لكنه يصعّب تشغيلها على أجهزة يومية. غالبًا ما تُدرّب هذه النماذج في مراكز بيانات مركزية تتطلب جمع كميات كبيرة من النصوص، مما يثير مخاوف بشأن الخصوصية وملكية البيانات. يرى المؤلفون أن العديد من الاستخدامات الواقعية، من المستشفيات إلى الهواتف المحمولة، تحتاج إلى نماذج لغوية أصغر بكثير، وأقل تطلبًا، وقادرة على التعلم من دون سحب كل البيانات الخام إلى مكان واحد.

التعلم المشترك دون مشاركة الأسرار

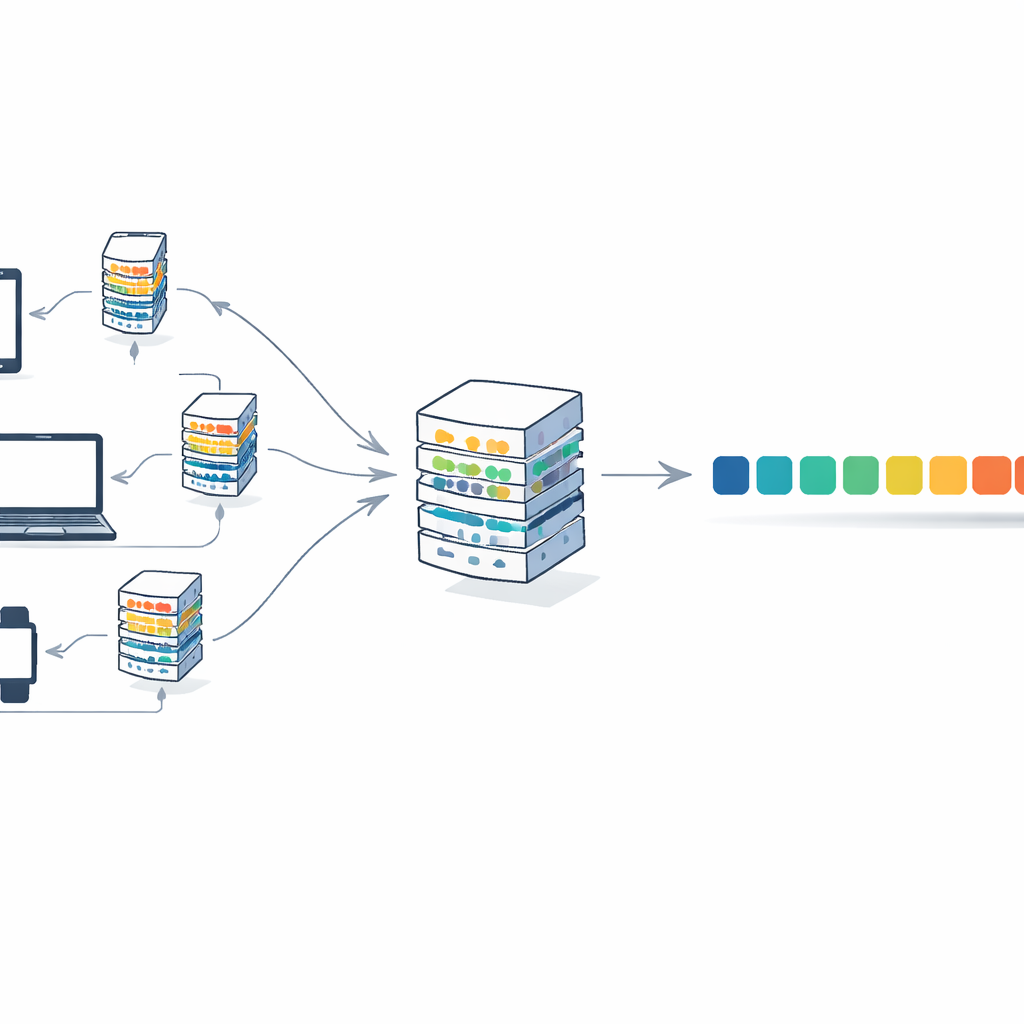

لمعالجة ذلك، يجمع البحث بين المحولات وإستراتيجية تدريب تُسمى التعلّم الفيدرالي. في هذا الإعداد، يحتفظ العديد من العملاء — مثل المؤسسات أو الأجهزة — بنصوصهم محليًا. يدرب كل عميل نسخة من النموذج على بياناته الخاصة ويرسل فقط أوزان النموذج المحدثة، لا النص نفسه، إلى خادم مركزي. يقوم الخادم بمتوسط هذه التحديثات في نموذج عالمي واحد ويرسله مرة أخرى. على مدار جولات متعددة، يتحسن النموذج بتجميع المعرفة من مصادر متنوعة، مع بقاء المستندات الخام في مواقعها الأصلية. هذا يقلل مخاطر الخصوصية كما يوزّع عبء الحوسبة عبر العملاء بدلاً من الاعتماد على آلة كبيرة واحدة.

تصميم مدمج مبني للمشاركة

يقدّم المؤلفون F-Transformer، وهو بنية محول صممت من الأساس لهذا العالم الموزع الواعي بالخصوصية. بدلاً من تصغير نموذج عملاق قائم، اختاروا إعدادات نحيفة: فقط 4 رؤوس انتباه، و4 طبقات، وتمثيلات كلمات بأبعاد 64، بإجمالي حوالي 0.87 مليون معلمة قابلة للتدريب. يشرحون إطارًا ثلاثي الطبقات: طبقة بيانات تتعامل مع النص المحلي والتقطيع إلى رموز، وطبقة ذكاء اصطناعي تُشغّل المحول المدمج وإجراء المتوسط الفيدرالي، وطبقة تطبيق يمكن أن تدعم استخدامات مثل توليد النص، والترجمة، والإجابة على الأسئلة عبر مؤسسات متعددة. كما يقدمون هدفًا رياضيًا يجمع، على الأقل نظريًا، الدقة والخصوصية في هدف تدريبي واحد عن طريق تثبيط التحديثات التي تكشف الكثير عن سجلات فردية.

أداء بأقل طاقة وذاكرة

لاختبار F-Transformer، يستخدم المؤلفون مجموعة WikiText-2 المعروفة من مقالات ويكيبيديا، مع التركيز على مدى جودة النموذج في التنبؤ بالكلمة التالية في تسلسل. يقيمون ليس فقط جودة التنبؤ ولكن أيضًا حمل المعالج واستهلاك الذاكرة، بمقارنة التدريب المركزي مع إعدادهم الفيدرالي. على الرغم من حجمه الصغير، يحقق F-Transformer ارتباك تحقق (validation perplexity) — مقياس قياسي لمدى توقع النموذج للنص — يتفوق على عدة نماذج أكبر بكثير ومعروفة، بما في ذلك BERT-Large ونسخ GPT-2، عند توحيد الأرقام على نفس المقياس. في الوقت نفسه، يقلّل الإصدار الفيدرالي استخدام المعالج بنحو 40 بالمئة واستهلاك الذاكرة بنحو 34 بالمئة مقارنة بخط أساس مركزي مماثل. كما أن صغر حجم النموذج يخفض تكاليف التواصل: نقل تحديثات النموذج بين العملاء والخادم أرخص بأكثر من مائة مرة مقارنةً بـ GPT-2 صغير.

ما معناه هذا لاستخدام الذكاء الاصطناعي اليومي

بعبارة بسيطة، تُظهر الدراسة أنه من الممكن بناء نماذج لغوية تتعلم من مصادر بيانات مبعثرة عديدة، وتحتفظ بالنصوص الخام خاصة، وتعمل على أجهزة متواضعة — دون التضحية بالأداء. يبرهن F-Transformer أن محولًا مضغوطًا مصممًا بعناية يمكن أن ينافس أو يتفوق على أنظمة أكبر بكثير مع سهولة أكبر في النشر على الهواتف والأجهزة الطرفية أو الشبكات المؤسسية الحساسة. رغم أن ضمانات الخصوصية في الورقة تظل في الغالب معمارية أكثر منها مقاسة رسميًا، وأن اختبارات العالم الحقيقي على بيانات أكثر تنوعًا ما تزال مطلوبة، تشير النتائج إلى مستقبل يمكن أن يوفر توليد لغة عالي الجودة دون الحاجة إلى بنية AI مركزية ضخمة وربما متطفلة.

الاستشهاد: Patel, N., Brahmbhatt, S., Ramoliya, F. et al. F-Transformer: a federated transformer for efficient and privacy-preserving sequence generation. Sci Rep 16, 14093 (2026). https://doi.org/10.1038/s41598-026-40881-0

الكلمات المفتاحية: التعلّم الفيدرالي, نموذج لغة المحول, الذكاء الاصطناعي المحافظ على الخصوصية, معالجة اللغة الخفيفة, توليد التسلسل