Clear Sky Science · pt

F-Transformer: um transformer federado para geração de sequência eficiente e que preserva a privacidade

Por que ferramentas de linguagem menores e mais seguras importam

Cada vez que você digita uma mensagem, pesquisa na web ou dita para o telefone, um software tenta silenciosamente prever e gerar linguagem que soe natural. No entanto, os modelos de linguagem mais poderosos de hoje são enormes, exigem muito poder computacional e frequentemente implicam o envio de textos sensíveis para servidores centrais. Este artigo apresenta uma nova forma de construir modelos de linguagem que são suficientemente leves para hardware modesto e respeitosos da privacidade do usuário, ao mesmo tempo em que igualam ou superam o desempenho de alguns dos sistemas em destaque atualmente.

De modelos gigantes a máquinas enxutas

Ferramentas de linguagem modernas normalmente se baseiam em transformers, uma família de redes neurais que se destaca no tratamento de frases longas e nas relações sutis entre palavras. Sistemas famosos como GPT-2 e BERT dependem de centenas de milhões a bilhões de parâmetros internos, o que os torna poderosos, mas também difíceis de executar em dispositivos do dia a dia. Eles costumam ser treinados em data centers centralizados que precisam coletar grandes volumes de texto, levantando preocupações sobre privacidade e propriedade dos dados. Os autores argumentam que muitos usos no mundo real, de hospitais a telefones móveis, precisam de modelos de linguagem muito menores, menos exigentes e capazes de aprender sem reunir todos os dados brutos em um único lugar.

Aprendendo juntos sem compartilhar segredos

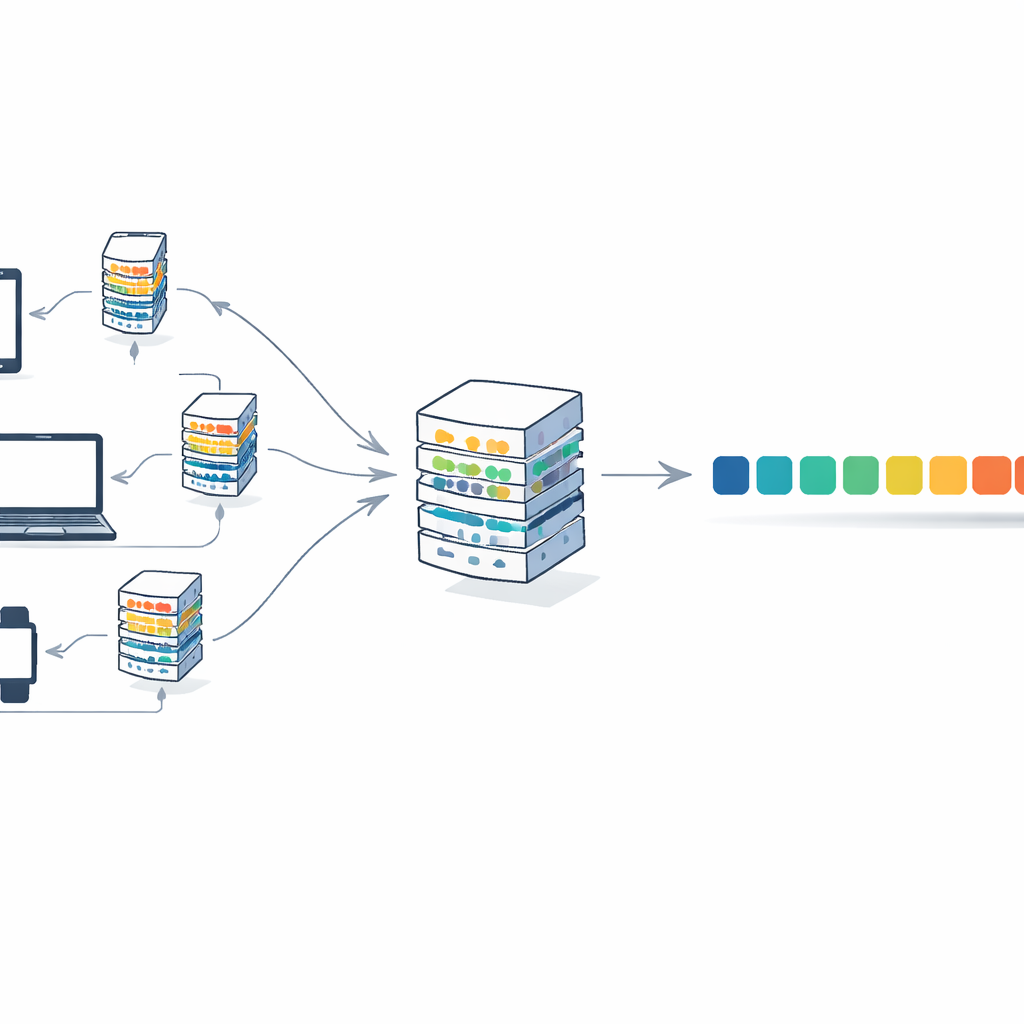

Para enfrentar isso, o artigo combina transformers com uma estratégia de treinamento chamada aprendizado federado. Nesse arranjo, muitos clientes — como instituições ou dispositivos — mantêm seus textos localmente. Cada cliente treina sua própria cópia do modelo em seus dados privados e envia apenas os pesos atualizados do modelo, não o texto em si, para um servidor central. O servidor faz a média dessas atualizações em um único modelo global e o devolve. Ao longo de várias rodadas, o modelo melhora ao agregar conhecimento de fontes diversas, sem que documentos brutos saiam de seus locais de origem. Isso reduz os riscos à privacidade e também distribui a carga computacional entre os clientes em vez de depender de uma máquina grande única.

Um projeto compacto feito para compartilhar

Os autores apresentam o F-Transformer, uma arquitetura transformer projetada desde o início para esse mundo distribuído e atento à privacidade. Em vez de encolher um modelo gigante existente, eles escolhem configurações enxutas: apenas 4 cabeças de atenção, 4 camadas e representações de palavras de 64 dimensões, totalizando cerca de 0,87 milhão de parâmetros treináveis. Eles delineiam uma estrutura em três camadas: uma camada de dados que trata do texto local e da tokenização, uma camada de inteligência artificial que executa o transformer compacto e o procedimento de média federada, e uma camada de aplicação que pode suportar usos como geração de texto, tradução e resposta a perguntas em várias organizações. Também apresentam um objetivo matemático que, ao menos em teoria, combina precisão e privacidade em uma única meta de treinamento, desencorajando atualizações que revelem demais sobre registros individuais.

Desempenho com menos potência e memória

Para testar o F-Transformer, os autores usam a conhecida coleção WikiText-2 de artigos da Wikipedia, focando em quão bem o modelo prevê a próxima palavra em uma sequência. Eles avaliam não apenas a qualidade da previsão, mas também a carga do processador e o uso de memória, comparando o treinamento centralizado com seu arranjo federado. Apesar de seu tamanho diminuto, o F-Transformer alcança uma perplexidade de validação — uma medida padrão de quão bem um modelo antecipa o texto — que supera vários modelos bem conhecidos e muito maiores, incluindo variantes do BERT-Large e do GPT-2, quando os números são normalizados para a mesma escala. Ao mesmo tempo, a versão federada reduz o uso do processador em cerca de 40% e o consumo de memória em cerca de 34% em relação a uma linha de base centralizada comparável. O pequeno tamanho do modelo também reduz drasticamente os custos de comunicação: mover atualizações do modelo entre clientes e servidor é mais de cem vezes mais barato do que com o GPT-2 small.

O que isso significa para o uso cotidiano de IA

Em termos simples, o estudo mostra que é possível construir modelos de linguagem que aprendem a partir de muitas fontes de dados dispersas, mantêm o texto bruto privado e rodam em hardware modesto — sem abrir mão do desempenho. O F-Transformer demonstra que um transformer compactamente projetado pode rivalizar ou superar sistemas muito maiores, ao mesmo tempo em que é mais fácil de implantar em telefones, dispositivos de borda ou redes institucionais sensíveis. Embora as garantias de privacidade do artigo sejam principalmente arquitetônicas em vez de formalmente medidas, e testes no mundo real com dados mais variados ainda sejam necessários, os resultados apontam para um futuro em que geração de linguagem de alta qualidade não exige uma infraestrutura de IA massiva, centralizada e potencialmente intrusiva.

Citação: Patel, N., Brahmbhatt, S., Ramoliya, F. et al. F-Transformer: a federated transformer for efficient and privacy-preserving sequence generation. Sci Rep 16, 14093 (2026). https://doi.org/10.1038/s41598-026-40881-0

Palavras-chave: aprendizado federado, modelo de linguagem transformer, IA que preserva a privacidade, PNL leve, geração de sequência