Clear Sky Science · fr

F-Transformer : un transformeur fédéré pour une génération de séquences efficace et respectueuse de la vie privée

Pourquoi des outils de langage plus petits et plus sûrs comptent

Chaque fois que vous tapez un message, effectuez une recherche sur le web ou dictez à votre téléphone, des logiciels tentent discrètement de prédire et de générer un langage naturel. Les modèles de langage les plus puissants aujourd’hui sont toutefois énormes, gourmands en ressources de calcul et exigent souvent l’envoi de textes sensibles vers des serveurs centraux. Cet article présente une nouvelle façon de concevoir des modèles de langage à la fois suffisamment légers pour du matériel modeste et respectueux de la vie privée des utilisateurs, tout en égalant ou surpassant les performances de certains systèmes médiatisés actuels.

Des modèles géants aux machines compactes

Les outils de langage modernes reposent généralement sur des transformeurs, une famille de réseaux neuronaux qui excellent pour traiter de longues phrases et des relations lexicales subtiles. Des systèmes célèbres comme GPT-2 et BERT s’appuient sur des centaines de millions à des milliards de paramètres internes, ce qui les rend puissants mais difficiles à exécuter sur des appareils du quotidien. Ils sont souvent entraînés dans des centres de données centralisés qui doivent collecter de grands volumes de texte, soulevant des questions de confidentialité et de propriété des données. Les auteurs soutiennent que de nombreux usages réels, des hôpitaux aux téléphones mobiles, nécessitent des modèles de langage beaucoup plus petits, moins exigeants et capables d’apprendre sans rassembler toutes les données brutes au même endroit.

Apprendre ensemble sans partager de secrets

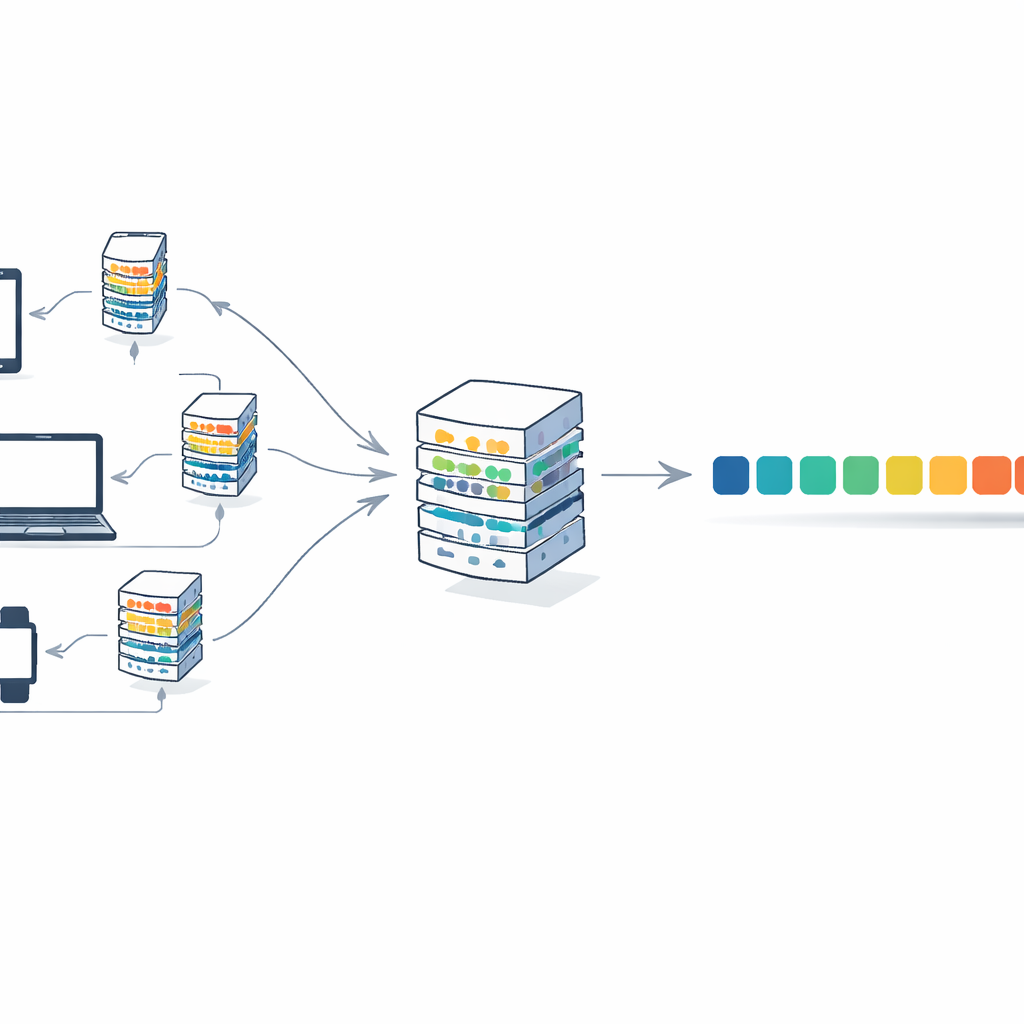

Pour répondre à cela, l’article combine les transformeurs avec une stratégie d’entraînement appelée apprentissage fédéré. Dans ce dispositif, de nombreux clients — tels que des institutions ou des appareils — conservent leurs textes localement. Chaque client entraîne sa propre copie du modèle sur ses données privées et n’envoie que les poids de modèle mis à jour, pas les textes eux‑mêmes, à un serveur central. Le serveur agrége ces mises à jour pour former un modèle global unique et le renvoie. Au fil de nombreuses itérations, le modèle s’améliore en regroupant des connaissances issues de sources diverses, sans qu’aucun document brut ne quitte son emplacement d’origine. Cela réduit les risques pour la vie privée et répartit aussi la charge de calcul entre les clients plutôt que de dépendre d’une seule machine massive.

Un design compact pensé pour le partage

Les auteurs présentent F-Transformer, une architecture de transformeur conçue dès le départ pour cet environnement distribué et conscient de la vie privée. Plutôt que de réduire un modèle géant existant, ils choisissent des réglages sobres : seulement 4 têtes d’attention, 4 couches et des représentations de mots en dimension 64, pour un total d’environ 0,87 million de paramètres entraînables. Ils décrivent un cadre en trois couches : une couche de données qui gère le texte local et la tokenisation, une couche d’intelligence artificielle qui exécute le transformeur compact et la procédure d’agrégation fédérée, et une couche applicative pouvant supporter des usages comme la génération de texte, la traduction et la réponse aux questions à travers de nombreuses organisations. Ils proposent aussi un objectif mathématique qui, du moins en théorie, combine précision et confidentialité en décourageant les mises à jour qui révèleraient trop d’informations sur des enregistrements individuels.

Performance avec moins de puissance et de mémoire

Pour évaluer F-Transformer, les auteurs utilisent la collection WikiText-2 largement étudiée d’articles Wikipédia, en se concentrant sur la qualité de la prédiction du mot suivant dans une séquence. Ils mesurent non seulement la qualité de prédiction mais aussi la charge processeur et l’utilisation mémoire, en comparant l’entraînement centralisé à leur configuration fédérée. Malgré sa taille minime, F-Transformer atteint une perplexité de validation — une mesure standard de la capacité d’un modèle à anticiper le texte — qui surpasse plusieurs modèles bien connus et beaucoup plus grands, y compris des variantes de BERT-Large et GPT-2, lorsque les chiffres sont normalisés à la même échelle. Parallèlement, la version fédérée réduit l’utilisation processeur d’environ 40 % et la consommation mémoire d’environ 34 % par rapport à une référence centralisée comparable. La petite taille du modèle réduit aussi drastiquement les coûts de communication : le transfert des mises à jour de modèle entre clients et serveur est plus de cent fois moins coûteux que pour GPT-2 small.

Ce que cela signifie pour l’utilisation quotidienne de l’IA

Concrètement, l’étude montre qu’il est possible de construire des modèles de langage qui apprennent à partir de nombreuses sources de données dispersées, préservent le texte brut et tournent sur du matériel modeste — sans sacrifier les performances. F-Transformer démontre qu’un transformeur compact et soigneusement conçu peut rivaliser ou dépasser des systèmes bien plus volumineux tout en étant plus facile à déployer sur des téléphones, des dispositifs en périphérie ou des réseaux institutionnels sensibles. Bien que les garanties de confidentialité exposées dans l’article soient surtout architecturales plutôt que formellement mesurées, et que des tests en conditions réelles sur des données plus variées restent à conduire, les résultats ouvrent la voie à un avenir où la génération de langage de haute qualité n’exige pas d’infrastructures d’IA massives, centralisées et potentiellement intrusives.

Citation: Patel, N., Brahmbhatt, S., Ramoliya, F. et al. F-Transformer: a federated transformer for efficient and privacy-preserving sequence generation. Sci Rep 16, 14093 (2026). https://doi.org/10.1038/s41598-026-40881-0

Mots-clés: apprentissage fédéré, modèle de langage transformeur, IA respectueuse de la vie privée, TAL léger, génération de séquences