Clear Sky Science · pl

F-Transformer: federacyjny transformer do wydajnego i chroniącego prywatność generowania sekwencji

Dlaczego mniejsze, bezpieczniejsze narzędzia językowe mają znaczenie

Za każdym razem, gdy piszesz wiadomość, przeszukujesz sieć albo dyktujesz telefonowi, oprogramowanie dyskretnie próbuje przewidzieć i wygenerować język brzmiący naturalnie. Najpotężniejsze dziś modele językowe są jednak ogromne, wymagają dużej mocy obliczeniowej i często wymagają wysyłania wrażliwych tekstów do centralnych serwerów. W artykule przedstawiono nowy sposób budowy modeli językowych, które są na tyle lekkie, by działać na skromnym sprzęcie, i jednocześnie respektują prywatność użytkownika, przy czym potrafią dorównać lub przewyższyć wydajność niektórych z głośniejszych systemów obecnych w mediach.

Od gigantycznych modeli do szczupłych maszyn

Współczesne narzędzia językowe zwykle opierają się na transformerach, rodzinie sieci neuronowych świetnie radzących sobie z długimi zdaniami i subtelnymi zależnościami między słowami. Znane systemy, takie jak GPT-2 i BERT, korzystają ze setek milionów aż po miliardy parametrów wewnętrznych, co czyni je potężnymi, ale też trudnymi do uruchomienia na urządzeniach codziennego użytku. Zwykle trenuje się je w scentralizowanych centrach danych, które muszą gromadzić ogromne ilości tekstu, co rodzi obawy o prywatność i własność danych. Autorzy argumentują, że wiele zastosowań w praktyce — od szpitali po telefony komórkowe — potrzebuje modeli językowych znacznie mniejszych, mniej wymagających i zdolnych do uczenia się bez zbierania wszystkich surowych danych w jednym miejscu.

Wspólne uczenie bez ujawniania sekretów

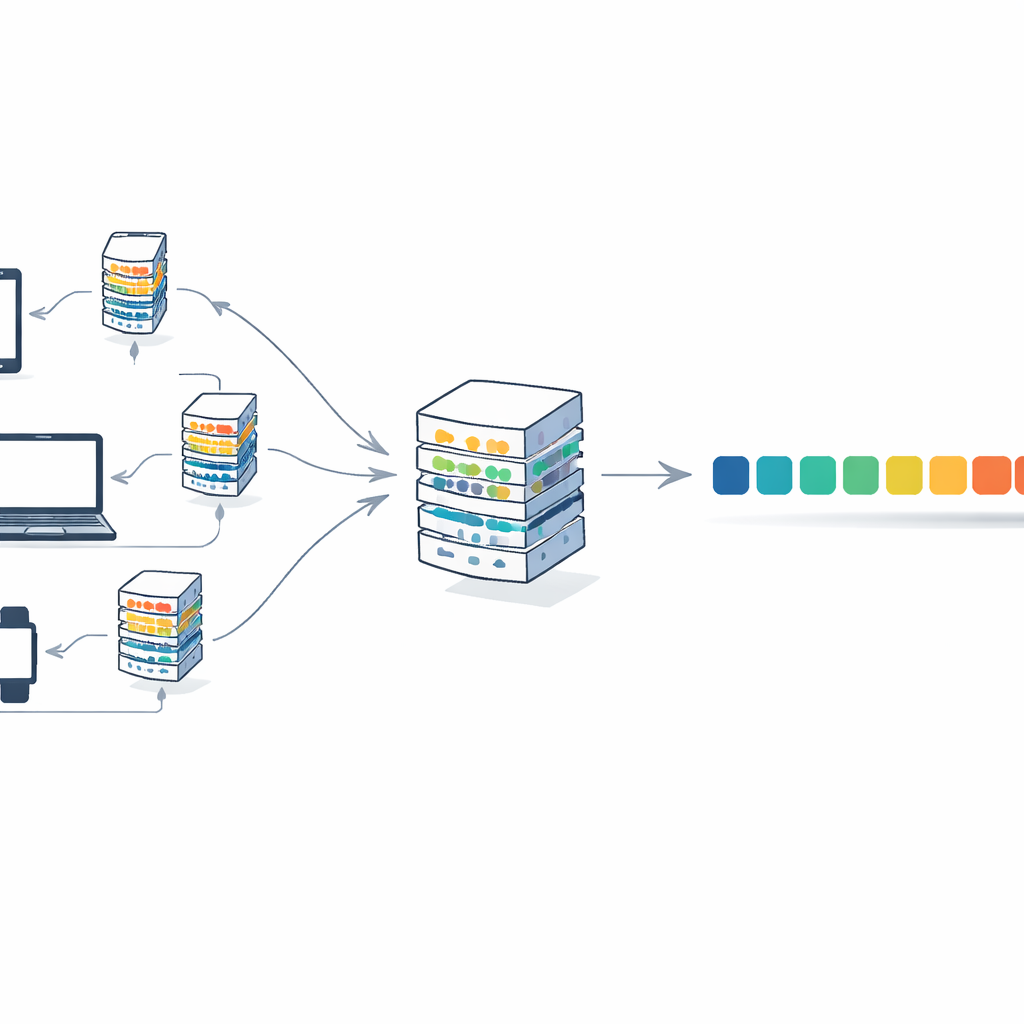

Aby temu sprostać, artykuł łączy transformatory ze strategią treningową zwaną uczeniem federacyjnym. W tym scenariuszu wielu klientów — takich jak instytucje czy urządzenia — przechowuje swoje teksty lokalnie. Każdy klient trenuje własną kopię modelu na prywatnych danych i wysyła jedynie zaktualizowane wagi modelu, a nie same teksty, do centralnego serwera. Serwer uśrednia te aktualizacje w jeden globalny model i odsyła go z powrotem. W kolejnych rundach model poprawia się, czerpiąc wiedzę z różnych źródeł, a surowe dokumenty nigdy nie opuszczają swoich pierwotnych lokalizacji. To zmniejsza ryzyko naruszeń prywatności i rozkłada obciążenie obliczeniowe na klientów, zamiast polegać na jednej dużej maszynie.

Kompaktowa konstrukcja zaprojektowana do współdzielenia

Autorzy przedstawiają F-Transformer — architekturę transformera zaprojektowaną od podstaw pod kątem tego rozproszonego, świadomego prywatności środowiska. Zamiast zmniejszać istniejący gigantyczny model, wybierają oszczędne ustawienia: zaledwie 4 głowy uwagi, 4 warstwy i 64-wymiarowe reprezentacje słów, co daje łącznie około 0,87 miliona uczonych parametrów. Nakreślają trójwarstwowe ramy: warstwę danych obsługującą lokalny tekst i tokenizację, warstwę sztucznej inteligencji uruchamiającą kompaktowy transformer i procedurę uśredniania federacyjnego oraz warstwę aplikacji, która może wspierać zastosowania takie jak generowanie tekstu, tłumaczenie i odpowiadanie na pytania w różnych organizacjach. Prezentują też matematyczny cel treningowy, który przynajmniej w teorii łączy dokładność i prywatność w jednym zadaniu treningowym, zniechęcając aktualizacje ujawniające zbyt wiele o pojedynczych rekordach.

Wydajność przy mniejszej mocy i pamięci

Aby przetestować F-Transformer, autorzy użyli powszechnie badanej kolekcji WikiText-2 artykułów z Wikipedii, koncentrując się na tym, jak dobrze model przewiduje następne słowo w sekwencji. Oceniali nie tylko jakość predykcji, lecz także obciążenie procesora i wykorzystanie pamięci, porównując trening scentralizowany z ich federacyjnym podejściem. Pomimo niewielkiego rozmiaru, F-Transformer osiąga walidacyjną perplexity — standardową miarę tego, jak dobrze model przewiduje tekst — która przewyższa kilka dobrze znanych, znacznie większych modeli, w tym warianty BERT-Large i GPT-2, gdy liczby są znormalizowane do tej samej skali. Jednocześnie wersja federacyjna obniża zużycie procesora o około 40 procent i zużycie pamięci o około 34 procent w porównaniu z porównywalnym scentralizowanym punktem odniesienia. Mały rozmiar modelu znacznie obniża również koszty komunikacji: przesyłanie aktualizacji modelu między klientami a serwerem jest ponad sto razy tańsze niż w przypadku GPT-2 small.

Co to oznacza dla codziennego użycia AI

Mówiąc prosto, badanie pokazuje, że można zbudować modele językowe, które uczą się z wielu rozproszonych źródeł danych, zachowują prywatność surowych tekstów i działają na skromnym sprzęcie — bez utraty wydajności. F-Transformer dowodzi, że starannie zaprojektowany, kompaktowy transformer może dorównać lub przewyższyć znacznie większe systemy, a przy tym być łatwiejszy do wdrożenia na telefonach, urządzeniach brzegowych czy w sieciach instytucji o podwyższonej wrażliwości. Chociaż gwarancje prywatności przedstawione w artykule są głównie architektoniczne, a nie formalnie zmierzone, i wciąż potrzeba testów w praktyce na bardziej zróżnicowanych danych, wyniki wskazują na przyszłość, w której wysokiej jakości generowanie języka nie wymaga masywnej, scentralizowanej i potencjalnie inwazyjnej infrastruktury AI.

Cytowanie: Patel, N., Brahmbhatt, S., Ramoliya, F. et al. F-Transformer: a federated transformer for efficient and privacy-preserving sequence generation. Sci Rep 16, 14093 (2026). https://doi.org/10.1038/s41598-026-40881-0

Słowa kluczowe: uczenie federacyjne, model językowy transformer, Sztuczna inteligencja chroniąca prywatność, lekki NLP, generowanie sekwencji