Clear Sky Science · nl

F-Transformer: een gefedereerde transformer voor efficiënte en privacybeschermende sequentiegeneratie

Waarom kleinere, veiligere taalhulpmiddelen er toe doen

Elke keer dat u een bericht typt, op internet zoekt of naar uw telefoon dicteert, probeert software stilletjes natuurlijke taal te voorspellen en te genereren. De krachtigste taalmodellen van vandaag zijn echter enorm, vergen veel rekenkracht en vereisen vaak het versturen van gevoelige tekst naar centrale servers. Dit artikel presenteert een nieuwe manier om taalmodellen te bouwen die licht genoeg zijn voor bescheiden hardware en het gebruikersprivacy respecteren, terwijl ze nog steeds de prestaties van sommige van de huidige koplopers evenaren of overtreffen.

Van gigantische modellen naar slanke machines

Moderne taalhulpmiddelen zijn doorgaans gebaseerd op transformers, een familie neurale netwerken die uitblinken in het verwerken van lange zinnen en subtiele woordrelaties. Bekende systemen zoals GPT-2 en BERT vertrouwen op honderden miljoenen tot miljarden interne parameters, wat ze krachtig maakt maar ook moeilijk uitvoerbaar op alledaagse apparaten. Ze worden meestal getraind in gecentraliseerde datacenters die grote hoeveelheden tekst moeten verzamelen, wat zorgen oproept over privacy en eigendom van gegevens. De auteurs betogen dat veel praktische toepassingen, van ziekenhuizen tot mobiele telefoons, taalmodellen nodig hebben die veel kleiner zijn, minder eisen stellen en kunnen leren zonder alle ruwe data op één plek te verzamelen.

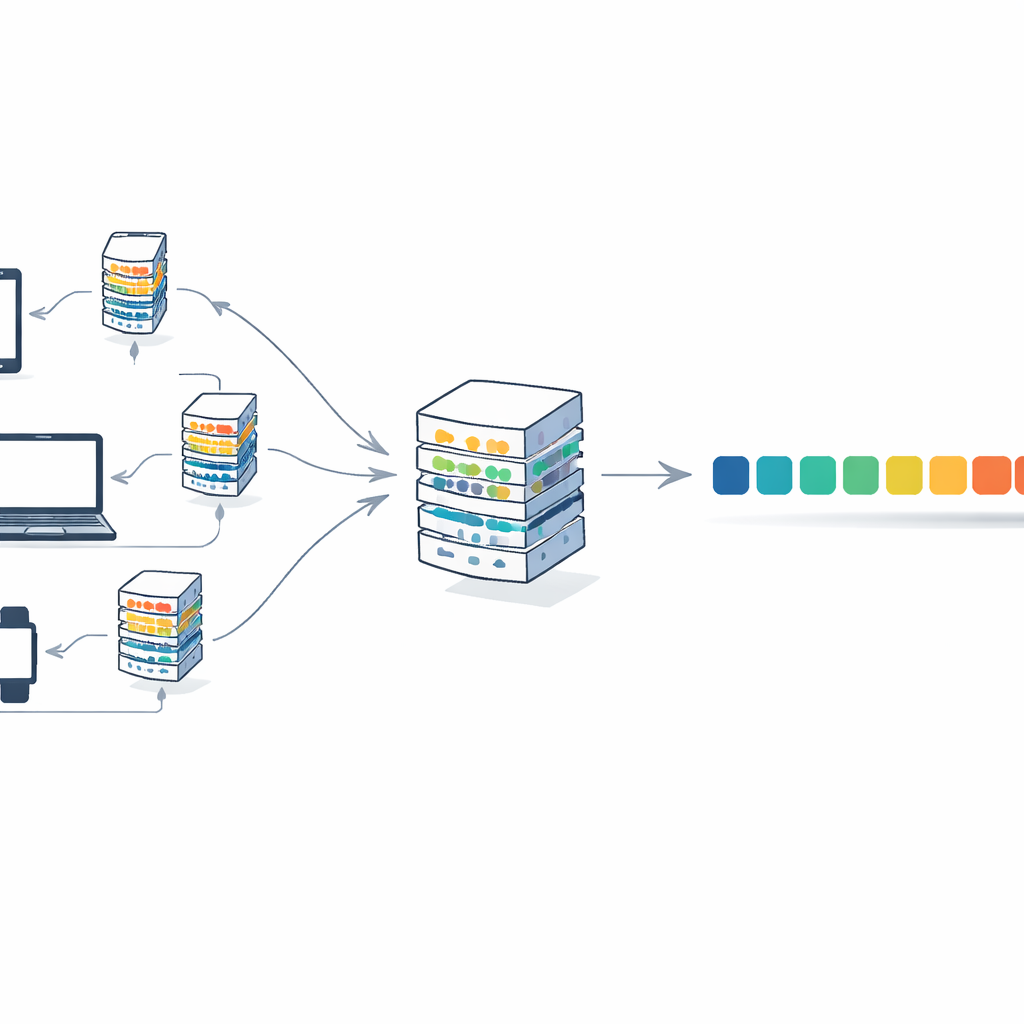

Samen leren zonder geheimen te delen

Om dit aan te pakken combineren de auteurs transformers met een trainingsstrategie genaamd gefedereerd leren. In deze opzet bewaren veel cliënten — zoals instellingen of apparaten — hun tekst lokaal. Elke cliënt traint zijn eigen kopie van het model op de privégegevens en stuurt alleen de bijgewerkte modelgewichten, niet de tekst zelf, naar een centrale server. De server gemiddeldeert deze updates tot één globaal model en stuurt dat terug. Over veel ronden verbetert het model door kennis te bundelen uit diverse bronnen, terwijl er nooit ruwe documenten hun oorspronkelijke locaties verlaten. Dit vermindert privacyrisico’s en spreidt ook de rekenbelasting over cliënten in plaats van te vertrouwen op één grote machine.

Een compact ontwerp gebouwd voor delen

De auteurs introduceren F-Transformer, een transformer-architectuur die van de grond af is ontworpen voor deze gedistribueerde, privacybewuste wereld. In plaats van een bestaand gigantisch model te verkleinen, kiezen ze voor zuinige instellingen: slechts 4 attention heads, 4 lagen en 64-dimensionale woordrepresentaties, voor in totaal ongeveer 0,87 miljoen trainbare parameters. Ze schetsen een drielaags raamwerk: een datalaag die lokale tekst en tokenisatie afhandelt, een AI-laag die de compacte transformer en het gefedereerde averageerproces uitvoert, en een applicatielaag die toepassingen als tekstgeneratie, vertaling en vraagbeantwoording over meerdere organisaties kan ondersteunen. Daarnaast presenteren ze een wiskundig doel dat, althans in theorie, nauwkeurigheid en privacy in één trainingsdoel verenigt door updates die te veel prijsgeven over individuele records te ontmoedigen.

Prestaties met minder vermogen en geheugen

Om F-Transformer te testen gebruiken de auteurs de veel bestudeerde WikiText-2-collectie van Wikipedia-artikelen, met de focus op hoe goed het model het volgende woord in een reeks voorspelt. Ze evalueren niet alleen de voorspellingskwaliteit maar ook processorbelasting en geheugenverbruik, en vergelijken gecentraliseerde training met hun gefedereerde opzet. Ondanks zijn kleine omvang behaalt F-Transformer een validatieperplexity — een standaardmaat voor hoe goed een model tekst anticipeert — die meerdere bekende, veel grotere modellen verslaat, waaronder BERT-Large en varianten van GPT-2, wanneer de aantallen op dezelfde schaal genormaliseerd worden. Tegelijkertijd verlaagt de gefedereerde versie het processorverbruik met ongeveer 40 procent en het geheugenverbruik met ongeveer 34 procent ten opzichte van een vergelijkbare gecentraliseerde baseline. De kleine modelgrootte vermindert ook communicatiekosten: het verplaatsen van modelupdates tussen cliënten en server is meer dan honderd keer goedkoper dan bij GPT-2 small.

Wat dit betekent voor dagelijks AI-gebruik

Simpel gezegd toont de studie aan dat het mogelijk is om taalmodellen te bouwen die leren van vele verspreide gegevensbronnen, ruwe tekst privé houden en op bescheiden hardware draaien — zonder in te leveren op prestaties. F-Transformer bewijst dat een zorgvuldig ontworpen, compact transformer kan concurreren met of zelfs beter kan presteren dan veel grotere systemen, terwijl hij gemakkelijker te implementeren is op telefoons, edge-apparaten of gevoelige institutionele netwerken. Hoewel de privacygaranties van het artikel vooral architectonisch zijn in plaats van formeel gemeten, en tests in de echte wereld op gevarieerdere data nog moeten volgen, wijzen de resultaten op een toekomst waarin hoogwaardige taalgeneratie geen massieve, gecentraliseerde en mogelijk indringende AI-infrastructuur vereist.

Bronvermelding: Patel, N., Brahmbhatt, S., Ramoliya, F. et al. F-Transformer: a federated transformer for efficient and privacy-preserving sequence generation. Sci Rep 16, 14093 (2026). https://doi.org/10.1038/s41598-026-40881-0

Trefwoorden: gefedereerd leren, transformer-taalmodel, privacybewuste AI, lichtgewicht NLP, sequentiegeneratie