Clear Sky Science · zh

用于东巴单字数据集构建的新型跨模态对齐学习框架

拯救一种活的文字化石

中国纳西族的东巴文常被称为文字的“活化石”:它是为数不多仍在宗教手稿中使用的象形文字系统之一。然而,仅有少数年长的仪式专家会读这种文字,且大部分幸存文本仅以脆弱的手写页形式存在。本研究引入了一种由人工智能驱动的新方法,将这些日渐老化的手稿转化为丰富且可检索的单字符数据库,帮助保护这一了解人类历史的独特窗口。

为什么古老的图像对计算机很难

乍一看,让计算机识别东巴文似乎和识别其他手写体没什么两样。但以往的尝试主要依赖志愿者用现代笔或手写笔描摹字符,或对这些干净的图像进行自动“拉伸”和扭曲。这些整洁的仿制品与真实的笔墨或刻写的古书字符差异很大。墨色浓淡不一,笔画断裂或融合,书写者会即兴改变形状。因此,在人工样本上训练的系统在真实手稿上表现不佳,尤其在遇到罕见或未记录过的符号时。同时,能够手工标注成千上万个字符的专家非常稀缺,形成了保存工作的瓶颈。

让图像与含义一起学习

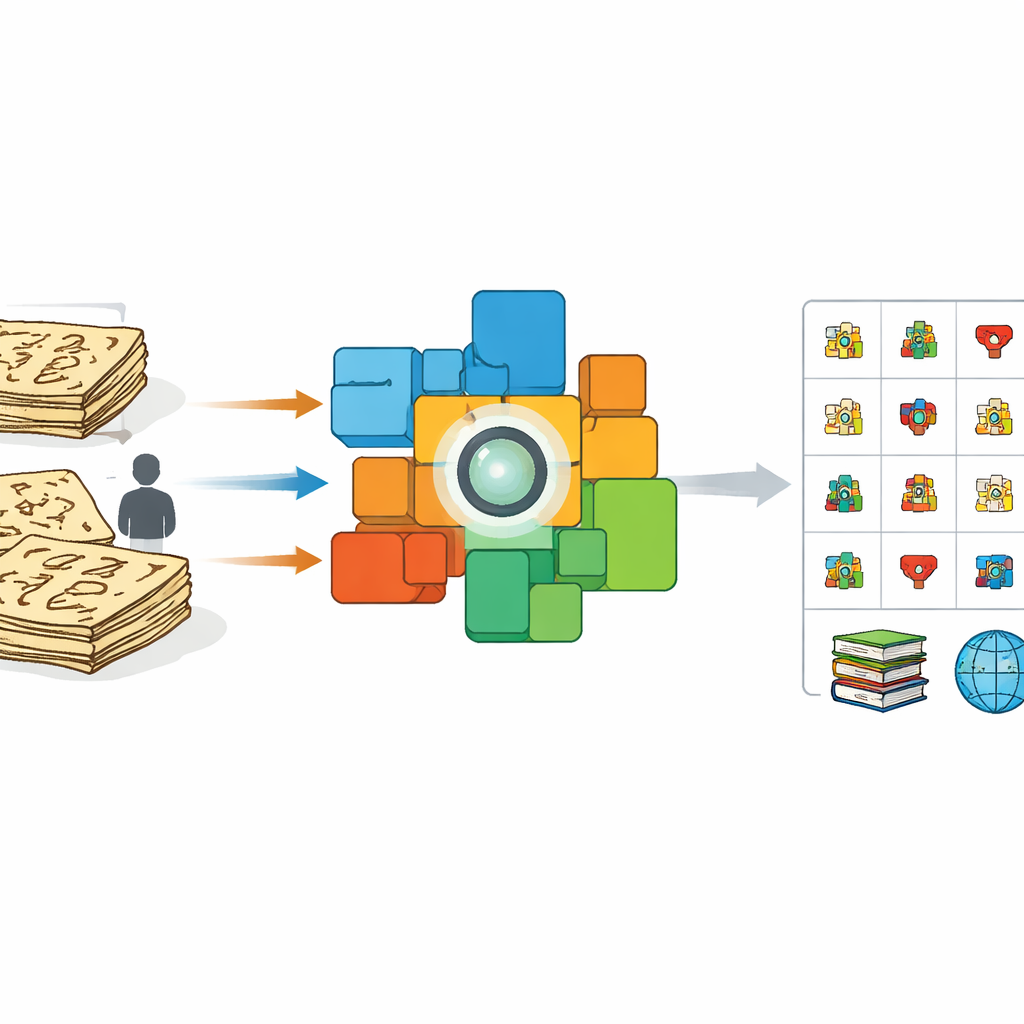

作者采用了不同的策略:他们不要求专家逐一标注每个字符,而是利用已经带有逐行中文译文的整页文本。从一套100卷的东巴文学术版本中,他们扫描句子图像并将每个图像与相应的现代解释配对。随后,他们对一种被称为CLIP的强大视觉-语言模型进行微调,使得在共享的数学空间里,东巴句子的图像被拉近到其翻译文本,并远离无关的文本。这种跨模态训练促使图像编码器关注承载语义的视觉细节,并忽略笔触或版式的杂乱变化。

从整页到单个字符

在模型学会了整句与解释的关联之后,团队转向单个字符。他们直接从手稿中裁切出数以万计的单字图像,保留其不规则且历经时光磨损的外观。与此同时,他们构建了一个参考“词典”,汇集来自专家著作的字符图像,并为每个图像链接一则简短的中文释义。利用训练好的图像编码器,他们将每个裁切出的手稿字符与该词典进行比对。如果手稿图像与词典图像极为相似,就将其归入已知类别;若不相似,系统将其视为可能的新变体,将其特征加入参考样本池,并标记供专家检查。这种动态的“锚点扩展”逐步扩展了可识别形式的范围,甚至发现了现有词典中缺失的字符。

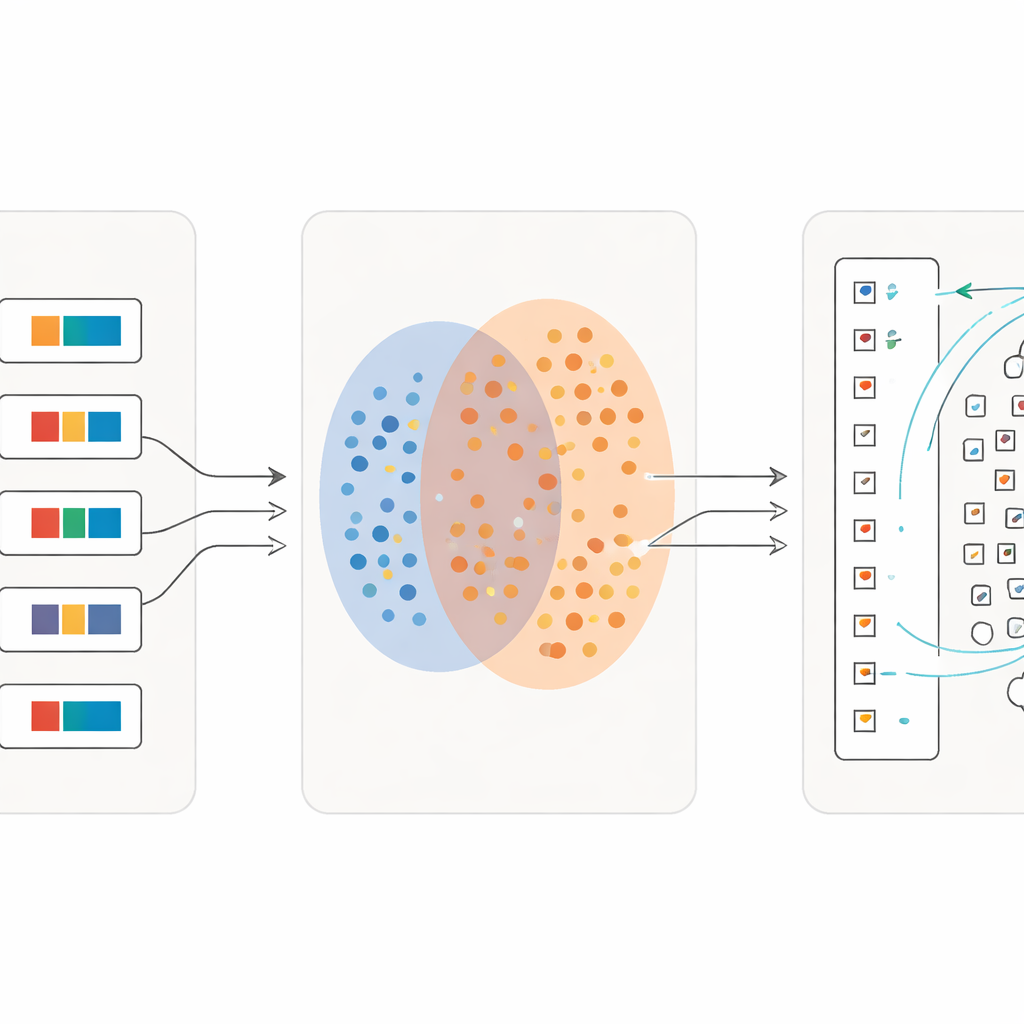

以更细致的层次学习

一项关键创新是这一过程并不会在一次迭代后停止。当第一波字符被可靠匹配后,研究者将这些匹配结果转化为新的训练材料:针对每个单字符,他们使用词典释义创建一条简短的描述性短语。然后,他们在整句与这些细粒度字符描述的混合数据上对模型进行再训练。随着每一轮迭代,系统对视觉上相似符号之间微妙差别的敏感度提高,同时对潦草书写保持鲁棒性。经过若干轮,分类准确率从略高于一半提升到超过97%,即便是许多只拥有少量样本的罕见符号也能达到这一水平。

面向未来的新数字档案

最终,团队产出名为 Dongba_1512 的大规模数据集,包含来自真实历史手稿的705,058张单字符图像,分为1,512个类别。该集合包括252个未出现在现有参考著作中的字符,为语言学家和历史学家提供了新的研究资料。在该数据集上训练的现代图像识别系统表现出高度准确性,而仅在人工手写样本上训练的模型在真实手稿面前则表现很差。研究表明,通过让图像与含义相互引导,人工智能能够帮助挽救缺乏广泛注释的濒危文字,同样策略也可应用于诸如水、彝等其他象形文字传统。归根结底,这项工作将脆弱的仪式书籍转变为面向文化传承与学术发现的可靠数字资源。

引用: Xing, J., Bi, X. & Qiao, W. A novel cross-modal alignment learning framework for Dongba single-character dataset construction. npj Herit. Sci. 14, 208 (2026). https://doi.org/10.1038/s40494-026-02494-8

关键词: 东巴文, 古代文字, 数字化保存, 视觉-语言模型, 字符识别