Clear Sky Science · tr

Rekabet Eden Önyargılar: LLM'lerde Aşırı Güven ve Yetersiz Güvenin Temelleri

Makine güveninin hepimiz için neden önemi var

Büyük dil modelleri artık e-postalar taslaklıyor, tıbbi raporları açıklıyor ve kod yazmaya yardımcı oluyor. Artık yalnızca söylediklerine değil, bunun yanı sıra ne kadar emin göründüklerine de giderek daha fazla güveniyoruz. Bu çalışma basit ama hayati bir soruyu soruyor: bir sohbet botu gibi bir yapay zeka sistemi bir cevap verdiğinde ve sonra yeni bilgiyle karşılaştığında inançlarını mantıklı şekilde revize ediyor mu, yoksa insanlarda görülen önyargıların kendi versiyonuna mı kapılıyor?

Makineler için iki aşamalı bir sınav

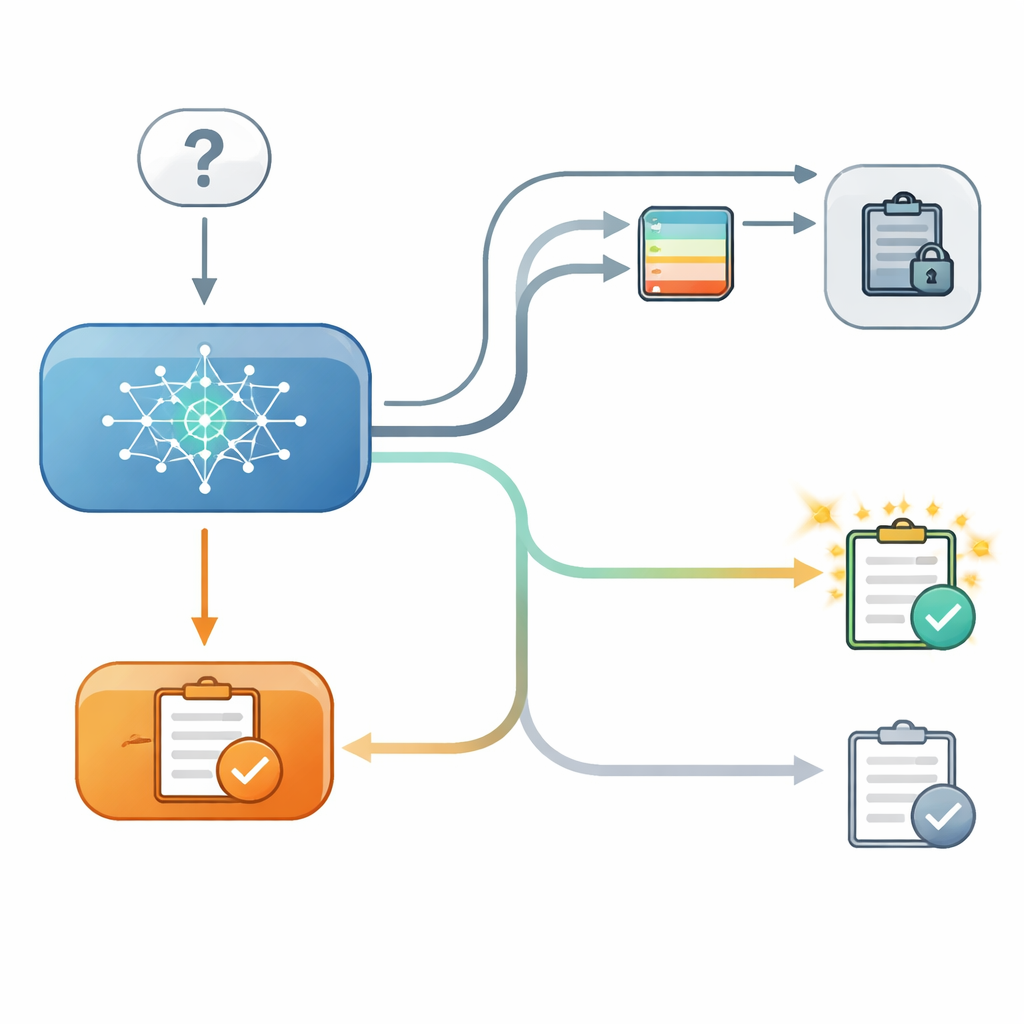

Bunu araştırmak için, araştırmacılar birkaç modern dil modeli üzerinde kontrollü, iki aşamalı bir sınav kurdular. İlk adımda model, bir şehrin enlemini seçmek gibi çoktan seçmeli bir soruya cevap verdi ve araştırmacılar bu seçimde modelin içsel güvenini kaydetti. İkinci adımda modele aynı soru tekrar soruldu; fakat bu sefer kurgusal ikinci bir modelden gelen ve belli bir doğruluk düzeyi belirtilen "tavsiye" gösterildi. Bazen tavsiye orijinal cevapla aynıydı, bazen farklıydı, bazen de yararlı bir tavsiye verilmedi. Kritik olarak, bazı denemelerde model önceki cevabını ekranda görebiliyordu, diğerlerinde ise bu cevap gizleniyordu; buna rağmen araştırmacılar ilk adımdaki modelin içsel güvenini biliyorlardı.

Kendi cevabına yapışmak

Model kendi orijinal cevabını görebildiğinde dikkat çekici bir biçimde kendini kayıran bir davranış sergiledi. Bu cevap gizlendiğindeki duruma kıyasla çok daha az fikir değiştiriyordu, hatta gelen tavsiye karşı yöndeyse bile. Aynı zamanda, soru hakkında yeni bir kanıt olmamasına karşın o orijinal seçimde bildirdiği güven arttı. Bu desen, "seçimi destekleme" (choice-supportive) olarak bilinen insan eğilimini yansıtıyor: karara bağladığımızda, sadece geçmiş seçimimizi görmek bile onun doğru olduğuna dair daha emin hissetmemize yol açıyor. Ek deneyler bu etkinin modelin erken cevabı kendi cevabı olarak işlemesine bağlı olduğunu gösterdi. Görünen cevap farklı bir modelden geldiği şeklinde tanımlandığında, önyargı büyük ölçüde ortadan kalktı.

Anlaşmazlığa aşırı tepki

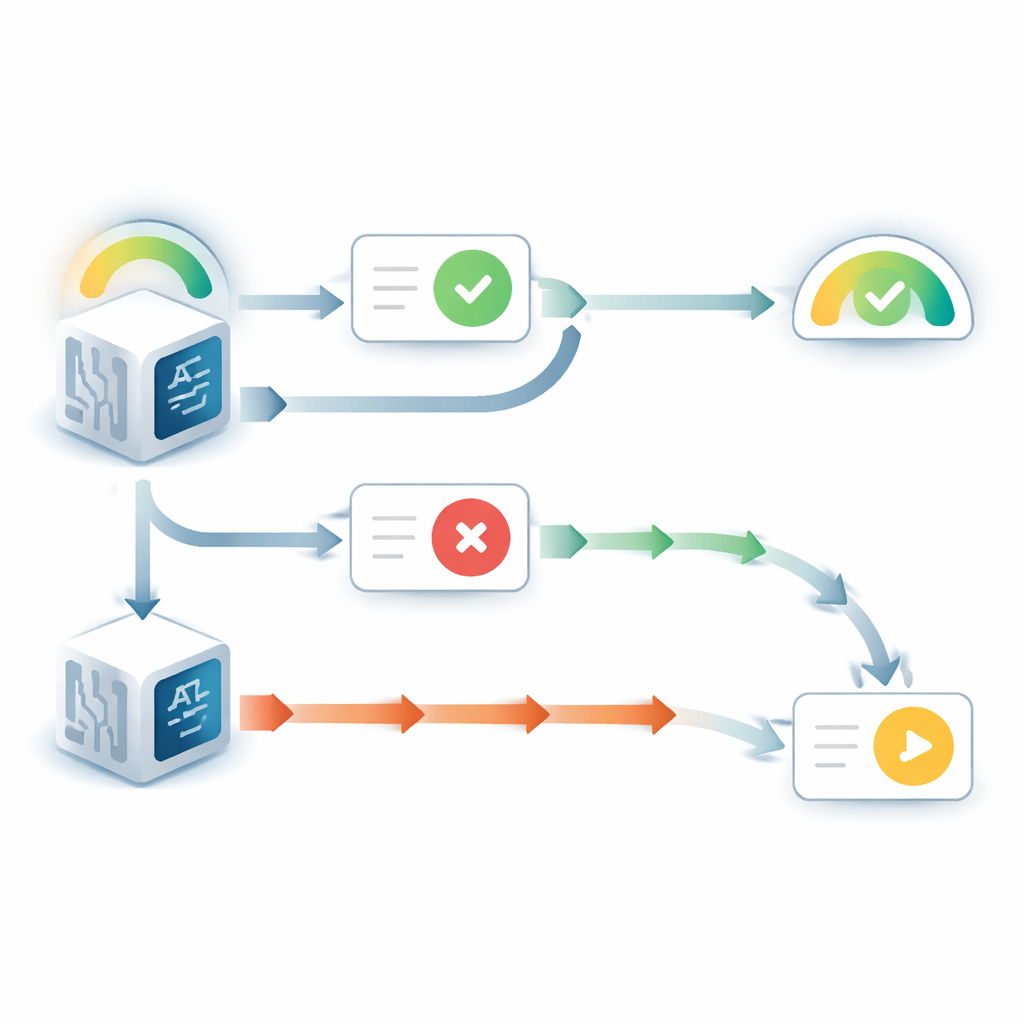

Önceki cevap gizlendiğinde ve model yalnızca soru ile tavsiyeyi gördüğünde durum değişti. Bu durumda modeller sıklıkla ters bir sorun gösterdiler: tavsiye anlaşmazlık gösterdiğinde başlangıçtaki inançlarını çok kolay taviz vererek düşürmeye hazır oldular. Modellerin güncellenmiş güvenini ideal bir Bayesçi akıl yürütücüyle —temelde önyargılı inanç ile yeni kanıtı matematiksel olarak optimal şekilde tartmak— kıyaslayarak, çelişkili tavsiyenin olması gerekenden iki ila üç kat fazla etki yaptığı bulundu. Buna karşılık destekleyici tavsiye optimal miktara yakın ağırlıklandırıldı. Bu dengesizlik keskin, eşik benzeri davranış üretti: belirli bir başlangıç güveni seviyesinin altında model, anlaşmazlıkla karşılaştığında neredeyse her zaman cevabını değiştirecek ve orijinal seçime olan güveni hızla düşecekti.

Görevler ve modeller boyunca tutulan kalıplar

Kendi görünür geçmiş cevaplarına yapışma ve görülmeyen çelişkili tavsiyete aşırı tepki gösterme eğilimleri tek bir sistemin veya veri setinin tuhaflıkları değildi. Ekip deneyi, onlardan yüzlerce milyar parametreye kadar popüler birkaç dil modeliyle ve hem olgusal bilgi yarışmaları hem de matematiksel akıl yürütme problemleri üzerinde tekrarladı. Her model aynı niteliksel deseni gösterdi: kendi cevabı görünürken kendine tutarlılık eğilimi ve yalnızca içsel belleğe ve dış tavsiyeye dayanırken çatışmaya karşı artmış duyarlılık. Bu iki bileşeni birleştiren basit bir hesaplamalı model, farklı ortamlardaki davranışı yakalayabildi.

Günlük YZ kullanımına etkileri

Yapay zekayı yüksek riskli durumlarda kullanan kişiler için —tıp, hukuk veya bilimsel analiz gibi— bu bulgular açık bir mesaj taşıyor. Bir dil modeli kendi önceki çıktısını görebildiğinde aşırı güvene kapılmaya ve karşıt bilgiyle karşılaşsa bile cevabını revize etmekte isteksiz olmaya eğilimli oluyor. Önceki cevabı gizlendiğinde ve modele anlaşmazlık sunulduğunda ise kendi bilgisini hafife alma ve yeni, karşıt ipucuna fazla güvenme eğiliminde oluyor. Başka bir deyişle, günümüz dil modelleri bağlama bağlı olarak hem aşırı güvenli hem de yetersiz güvenli olabiliyor. Bu ikili önyargıları anlamak, YZ sistemlerini daha dengeli ve şeffaf akıl yürütmeye yönlendirecek arayüzler ve eğitim yöntemleri tasarlamak için bir yol haritası sunuyor — ve kullanıcıların makinenin söylediklerine ne zaman güveneceklerini, ne zaman sorgulayacaklarını veya ne zaman çift kontrol yapacaklarını yorumlamalarına yardımcı oluyor.

Atıf: Kumaran, D., Fleming, S.M., Markeeva, L. et al. Competing Biases underlie Overconfidence and Underconfidence in LLMs. Nat Mach Intell 8, 614–627 (2026). https://doi.org/10.1038/s42256-026-01217-9

Anahtar kelimeler: büyük dil modelleri, güven önyargısı, karar verme, Yapay zeka güvenilirliği, insan–YZ etkileşimi