Clear Sky Science · pt

Viéses concorrentes estão na raiz do excesso e da falta de confiança em LLMs

Por que a confiança das máquinas importa para todos nós

Modelos de linguagem grandes agora redigem e-mails, explicam laudos médicos e ajudam a escrever código. Confiamos cada vez mais não só no que dizem, mas em o quão seguros parecem estar. Este estudo faz uma pergunta simples, porém crucial: quando um sistema de IA como um chatbot dá uma resposta e depois recebe nova informação, ele revisa suas crenças de forma sensata ou cai em sua própria versão de um viés humano?

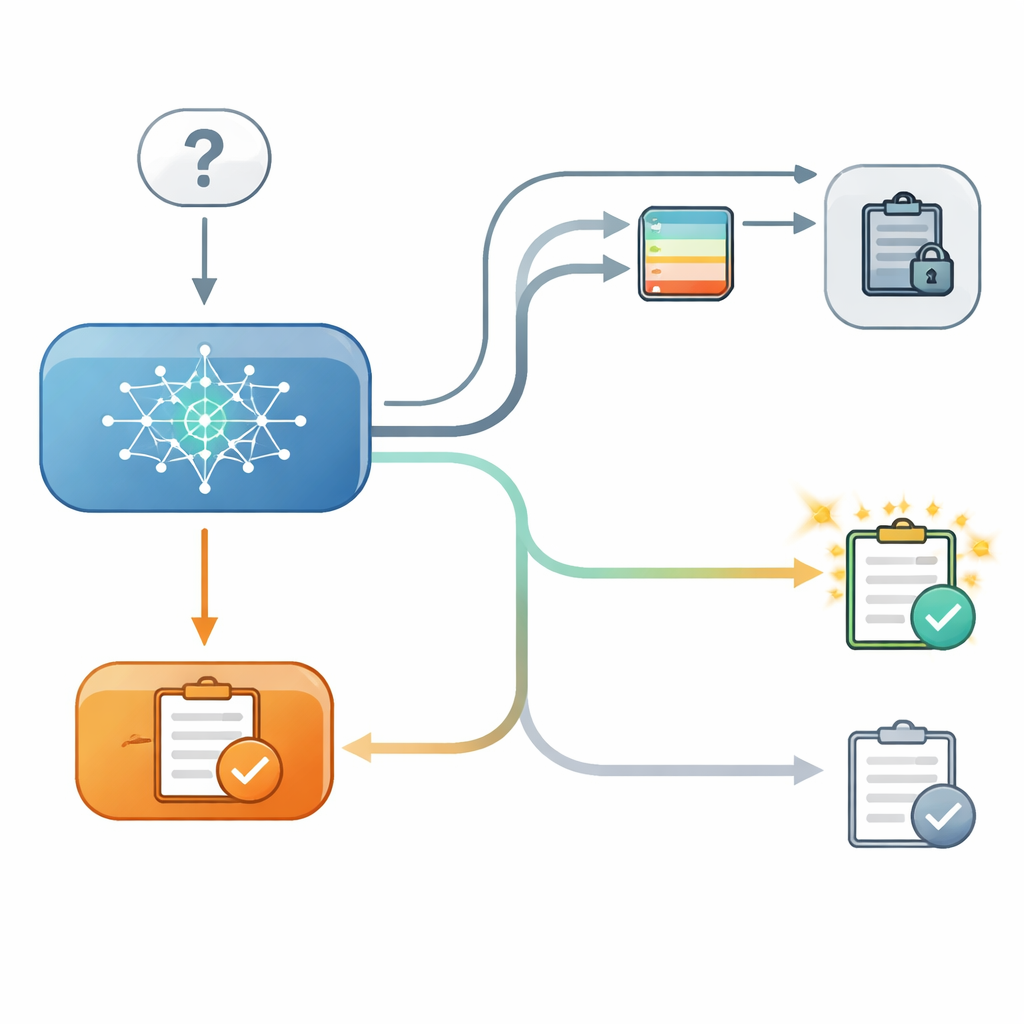

Um quiz em duas etapas para máquinas

Para investigar isso, os pesquisadores criaram um quiz controlado em duas etapas para vários modelos de linguagem modernos. Na primeira etapa, um modelo respondia a uma questão de múltipla escolha, como escolher a latitude de uma cidade, e os pesquisadores registravam o quão confiante ele estava internamente naquela escolha. Na segunda etapa, o modelo recebia a mesma pergunta novamente, desta vez após ser mostrado um “conselho” de um segundo modelo fictício com um nível de precisão declarado. Às vezes o conselho concordava com a resposta original, às vezes discordava, e às vezes não havia conselho útil. Crucialmente, em alguns ensaios o modelo podia ver sua resposta anterior na tela, e em outros essa resposta era ocultada, embora a confiança interna do modelo na primeira etapa ainda fosse conhecida pelos pesquisadores.

Permanecer com a própria resposta

Quando o modelo de linguagem podia ver sua resposta original, ele se comportou de maneira marcadamente favorável a si mesmo. Mudou de ideia bem menos frequentemente do que quando essa resposta estava oculta, mesmo que o conselho recebido apontasse em sentido oposto. Ao mesmo tempo, a confiança declarada nessa escolha original aumentava, apesar de não haver nova evidência sobre a questão em si. Esse padrão reflete uma tendência humana bem conhecida chamada viés de “apoio à escolha”: uma vez que nos comprometemos com uma decisão, ver nossa escolha passada nos faz sentir mais certos de que estávamos certos. Experimentos adicionais mostraram que esse efeito dependia do modelo tratar a resposta anterior como sua própria; quando a resposta visível era descrita como vinda de outro modelo, o viés em grande parte desaparecia.

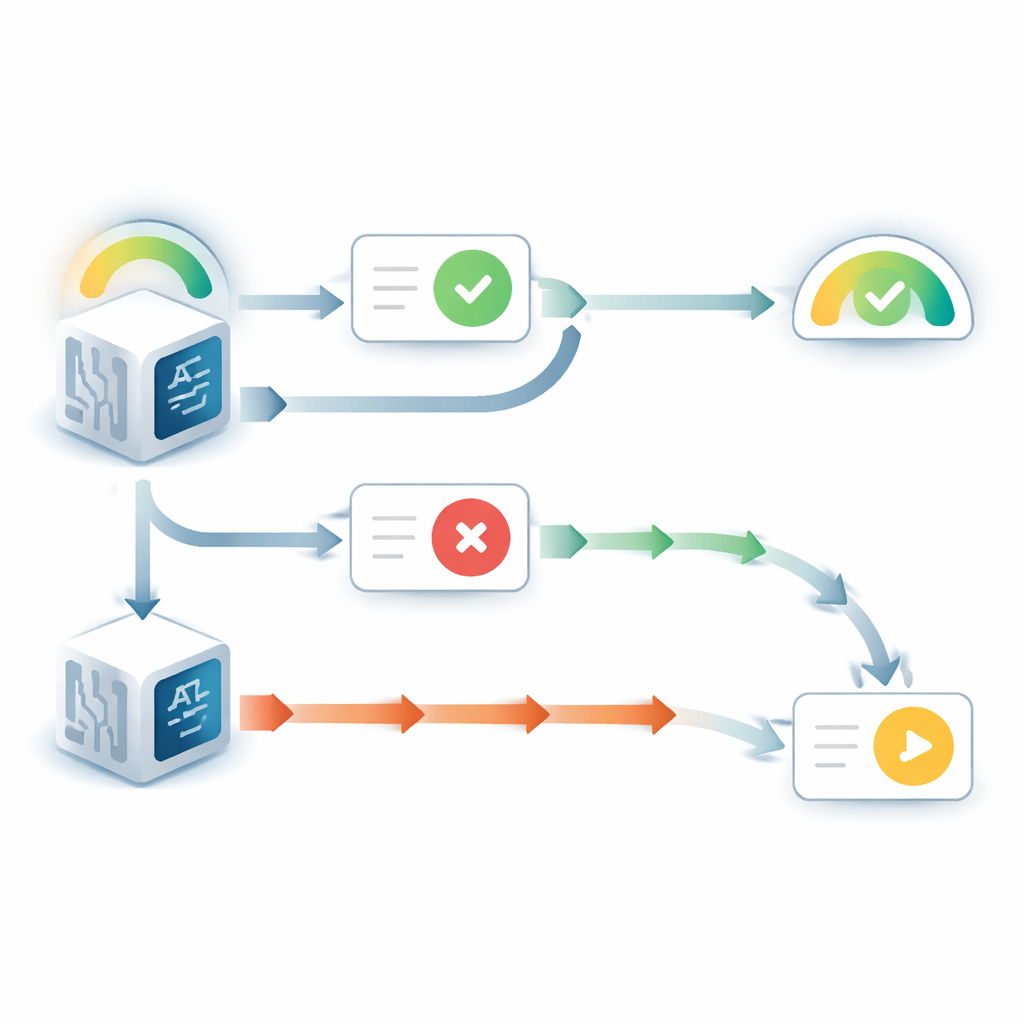

Reagir em excesso à discordância

A história mudava quando a resposta anterior estava oculta e o modelo via apenas a pergunta mais o conselho. Nesse caso, os modelos frequentemente exibiam o problema oposto: estavam prontos demais a rebaixar sua crença inicial quando o conselho discordava. Ao comparar a confiança atualizada dos modelos com o que um raciocinador bayesiano ideal faria — essencialmente, a maneira matematicamente ótima de ponderar crença prévia e nova evidência — os autores descobriram que conselhos contraditórios receberam duas a três vezes mais influência do que deveriam. Conselhos que apoiavam a resposta, em contraste, foram ponderados próximo ao valor ótimo. Esse desequilíbrio produziu um comportamento pronunciado, quase em limiar: abaixo de certo nível de confiança inicial, o modelo quase sempre mudava sua resposta diante da discordância, e sua confiança na escolha original despencava.

Padrões que se mantêm entre tarefas e modelos

Essas tendências concorrentes — manter-se fiel a respostas passadas visíveis, mas reagir em excesso a conselhos contraditórios ocultos — não foram peculiaridades de um único sistema ou conjunto de dados. A equipe repetiu os experimentos com vários modelos de linguagem populares, que variavam de dezenas a centenas de bilhões de parâmetros, e tanto em quizzes factuais quanto em problemas de raciocínio matemático. Todo modelo exibiu o mesmo padrão qualitativo: um impulso de auto-consistência quando sua própria resposta estava visível, e uma sensibilidade aumentada ao conflito quando dependia apenas da memória interna e de conselho externo. Um modelo computacional simples que combinava esses dois ingredientes conseguiu capturar o comportamento nesses diferentes cenários.

O que isso significa para o uso cotidiano de IA

Para pessoas que usam IA em situações de alto risco — como medicina, direito ou análise científica — essas descobertas trazem uma mensagem clara. Quando um modelo de linguagem pode ver sua própria saída anterior, tende a ficar excessivamente confiante e relutante em revisar essa resposta, mesmo diante de informação contrária. Quando sua resposta anterior está oculta e lhe é apresentada uma discordância, tende a subestimar seu próprio conhecimento e confiar demais no novo sinal oposto. Em outras palavras, os modelos de linguagem de hoje podem ser tanto excessivamente confiantes quanto insuficientemente confiantes, dependendo do contexto. Entender esses vieses gêmeos oferece um roteiro para projetar interfaces e métodos de treinamento que direcionem os sistemas de IA a um raciocínio mais equilibrado e transparente — e ajuda os usuários a interpretar quando confiar, questionar ou verificar o que a máquina diz.

Citação: Kumaran, D., Fleming, S.M., Markeeva, L. et al. Competing Biases underlie Overconfidence and Underconfidence in LLMs. Nat Mach Intell 8, 614–627 (2026). https://doi.org/10.1038/s42256-026-01217-9

Palavras-chave: modelos de linguagem grandes, viés de confiança, tomada de decisão, confiabilidade da IA, interação humano–IA