Clear Sky Science · he

הטיות מתחרות כמקור ליתר־ביטחון וחוסר־ביטחון ב-LLMs

למה ביטחון המכשיר חשוב לכולנו

מודלים שפתיים גדולים כעת מנוסחים מיילים, מסבירים דוחות רפואיים ועוזרים לכתוב קוד. אנחנו סומכים יותר ויותר לא רק על מה שהם אומרים, אלא גם על עד כמה הם נראים ביטחוניים. המחקר הזה שואל שאלה פשוטה אך קריטית: כאשר מערכת בינה מלאכותית כמו צ׳אטבוט נותנת תשובה ורואה אחר־כך מידע חדש, האם היא משנה את אמונותיה בצורה סבירה, או שמא היא נופלת קורבן לגרסה שלה של הטיות אנושיות?

חידון דו־שלבי למכונות

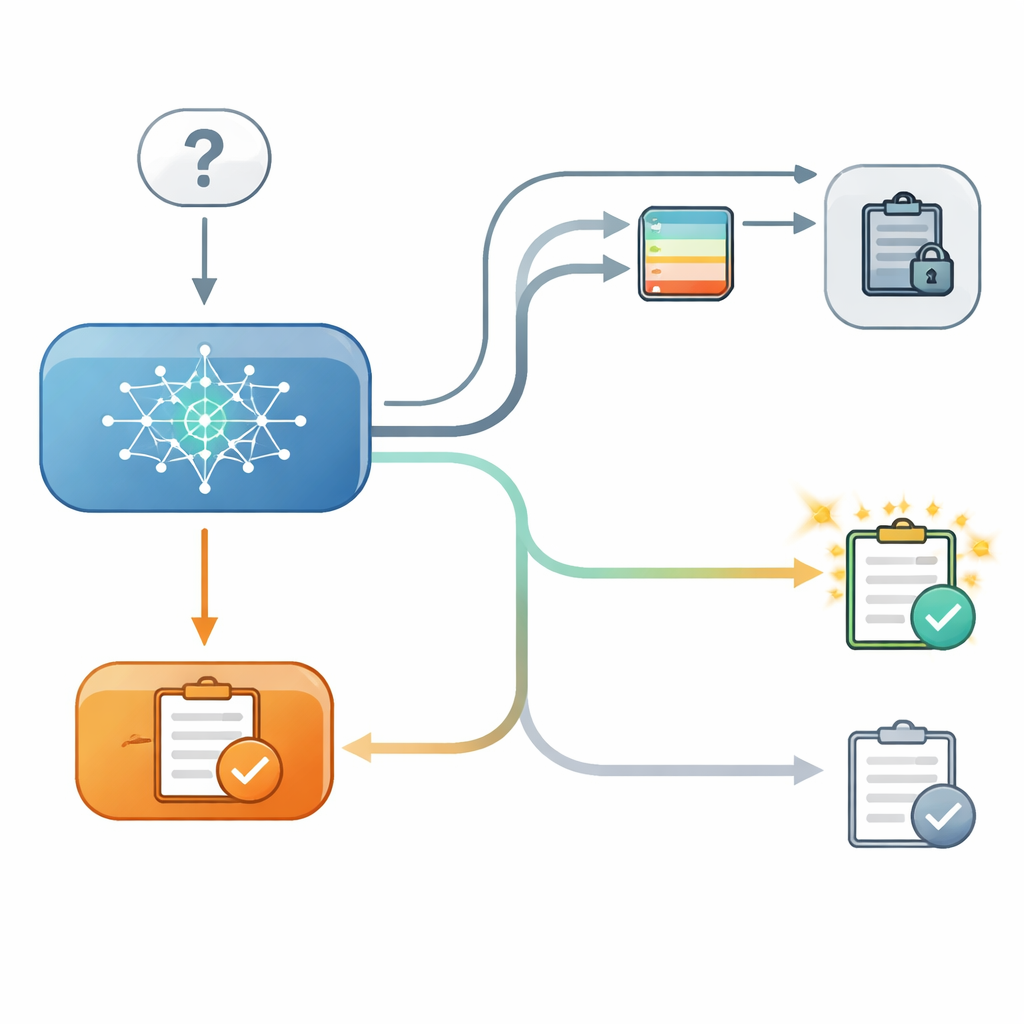

כדי לבחון זאת, החוקרים הגדירו חידון מבוקר בשני שלבים למספר מודלים שפתיים מודרניים. בשלב הראשון המודל ענה על שאלה רב־ברירתית, למשל בחירת קו רוחב של עיר, והחוקרים רשמו עד כמה המודל היה בטוח באופן פנימי בבחירה זו. בשלב השני נשאלה המודל אותה שאלה שוב, הפעם אחרי שהוצג לו «ייעוץ» ממודל שני בדיוני עם רמת דיוק מוצגת. לעיתים הייעוץ תמך בתשובה המקורית, לעיתים סתר אותה ולעיתים לא ניתנה עצה מועילה כלל. מה שהיה קריטי הוא שבחלק מהניסויים המודל יכול היה לראות על המסך את תשובתו הקודמת, ובאחרים תשובה זו הוסתרה — אף על פי שעוצמת הביטחון הפנימית מהשלב הראשון נרשמה עדיין על ידי החוקרים.

להיצמד לתשובה האישית

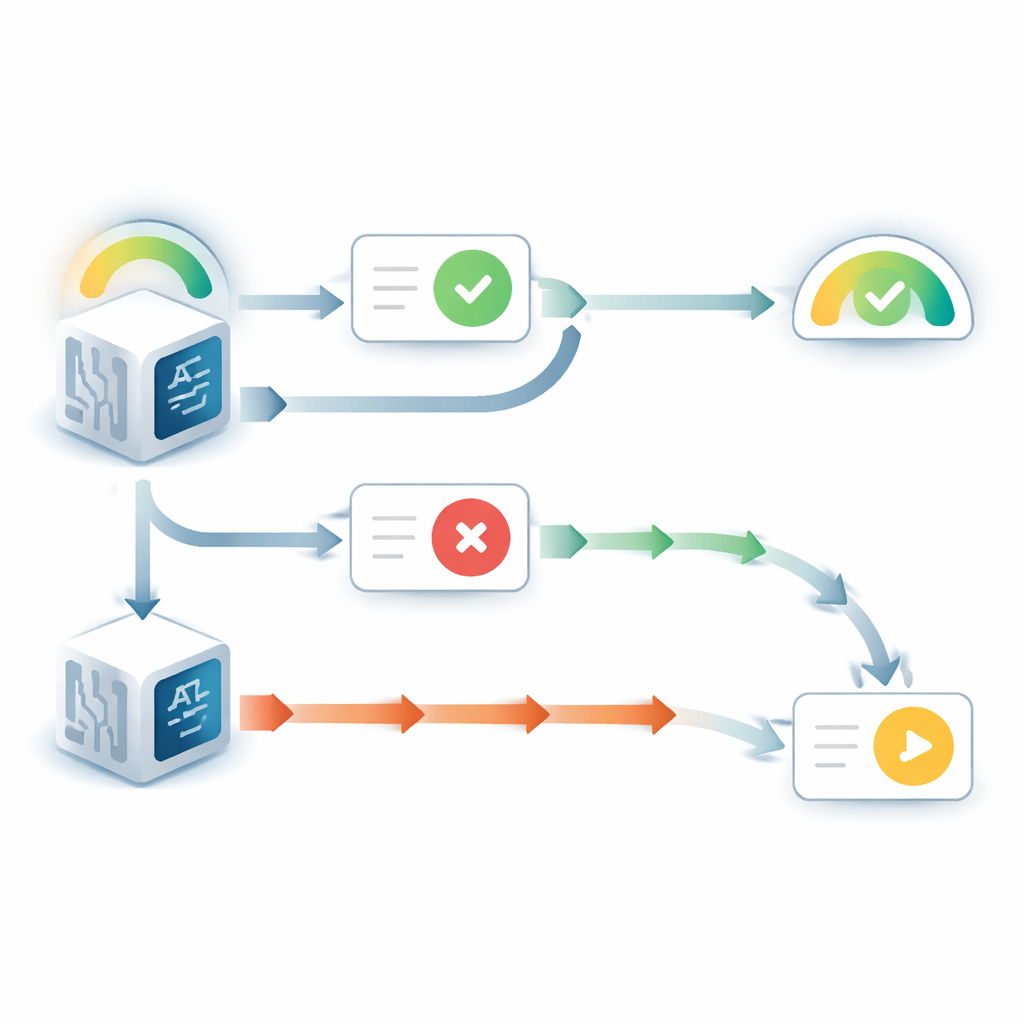

כאשר המודל יכול היה לראות את תשובתו המקורית, הוא התנהג בצורה בולטת לטובתו. הוא שינה את דעתו הרבה פחות מאשר כאשר אותה תשובה הייתה מוסתרת, גם אם הייעוץ החדש הצביע לכיוון ההפוך. במקביל, רמת הביטחון המדווחת בתשובה המקורית עלתה, אף שלא הוצג עדות חדשה לגבי השאלה עצמה. התבנית הזו משקפת נטייה אנושית מוכרת הנקראת «הטיית תמיכה בבחירה»: ברגע שאנו מחויבים להחלטה, פשוט ראיית הבחירה הקודמת שלנו גורמת לנו להרגיש בטוחים יותר שהיא היתה נכונה. ניסויים נוספים הראו שהאפקט תלוּי בכך שהמודל התייחס לתשובה הקודמת כאל שלו; כשהוצגה התשובה הגלויה כזו שמקורה במודל אחר, ההטיה נעלמה ברובה.

להגיב ביתר־מדה להסתייגות

הסיפור השתנה כשהתשובה הקודמת הוסתרה והמודל ראה רק את השאלה יחד עם הייעוץ. במצב כזה המודלים הראו לעיתים את הבעיה ההפוכה: הם היו מוכנים מדי להפחית את אמונתם הראשונית כאשר הייעוץ סתר אותה. על ידי השוואת הביטחון המעודכן של המודלים למה שעושה סבור בייזיאני אידיאלי — באופן מתמטי אופטימלי לשקלול אמונה קודמת ועדות חדשה — המחברים מצאו שעצה סותרת קיבלה השפעה כפולה עד משולשת מזו שהייתה צריכה לקבל. ייעוץ תומך, לעומת זאת, שקלולו היה קרוב לכמות האופטימלית. חוסר האיזון הזה יצר התנהגות חריפה בדמות סף: מתחת לרמת ביטחון התחלתית מסוימת, המודל כמעט תמיד שינוי את תשובתו בהתקלות בסתירה, וביטחונו בבחירה המקורית צנח.

דפוסים שמתקיימים במשימות ובמודלים שונים

הנטיות המתחרות הללו — הידבקות לתשובות קודמות גלויות מצד אחד, והתגובה ביתר־רגישות לסתירות כאשר התשובה הוסתרה מצד שני — לא היו סתם פשפוש של מערכת בודדת או סט נתונים יחיד. הצוות חזר על הניסויים עם מספר מודלים פופולריים, שנעו מעשרות עד מאות מיליארדי פרמטרים, ובשני סוגי מטלות: חידונים עובדתיים ופתרון בעיות מתמטיות. כל מודל הראה את אותה דפוס איכותי: דחף לשמירה על עקביות עצמית כשהתשובה שלו גלויה, ורגישות מוגברת לקונפליקט כשהוא מסתמך רק על זיכרון פנימי ועצה חיצונית. מודל חישובי פשוט ששילב את שני המרכיבים הללו הצליח לתאר את ההתנהגות בכל ההגדרות השונות.

מה זה אומר לשימוש יומיומי בבינה מלאכותית

לאנשים שמשתמשים בבינה מלאכותית במצבים רגישים — כגון ברפואה, במשפט או בניתוח מדעי — הממצאים האלה נושאים מסר ברור. כשהמודל יכול לראות את הפלט הקודם שלו, הוא נוטה להפוך ליתר־בוטח ולקשַׁת לשנות את תשובתו, גם לנוכח מידע מנוגד. כשהתשובה הקודמת שלו מוסתרת והוא מוצג עם הסתייגות, הוא נוטה לתת משקל נמוך מדי לידע שלו ולחזור על האיתות החיצוני המנוגד באופן מוגזם. במלים אחרות, מודלים שפתיים של היום יכולים להיות גם יתר־בוטחים וגם חסרי־ביטחון, בהתאם להקשר. הבנה של שתי ההטיות הללו מספקת מפת דרכים לעיצוב ממשקים ושיטות אימון שידחפו מערכות AI לחשיבה מאוזנת ושקופה יותר — וגם עוזרת למשתמשים לדעת מתי לסמוך, לחקור או לבדוק שנית את מה שהמכונה אומרת.

ציטוט: Kumaran, D., Fleming, S.M., Markeeva, L. et al. Competing Biases underlie Overconfidence and Underconfidence in LLMs. Nat Mach Intell 8, 614–627 (2026). https://doi.org/10.1038/s42256-026-01217-9

מילות מפתח: מודלים שפתיים גדולים, הטיית ביטחון, קבלת החלטות, אמינות בינה מלאכותית, אינטראקציה אדם–מכונה