Clear Sky Science · nl

Een tweedelig mobiliteitsbewust deep-reinforcement-learning‑model voor fouttolerante taak‑offloading in voertuig‑edge‑cloud computing

Slimmere wegen voor datahongerige auto’s

Moderne auto’s veranderen in rijdende computers die continu camerabeelden, sensorgegevens en navigatie-informatie verwerken. Een groot deel van dit werk moet binnen milliseconden gebeuren om bestuurders veilig te houden en diensten responsief. Dit artikel onderzoekt hoe die realtime‑verwerking betrouwbaarder en sneller kan door te coördineren waar de digitale "klusjes" van een voertuig worden uitgevoerd—in de auto zelf, op kleine computers langs de weg of in afgelegen cloudservers—zelfs wanneer het verkeer druk is, verbindingen onstabiel zijn en apparaten af en toe uitvallen.

Waarom auto’s hulp van de weg nodig hebben

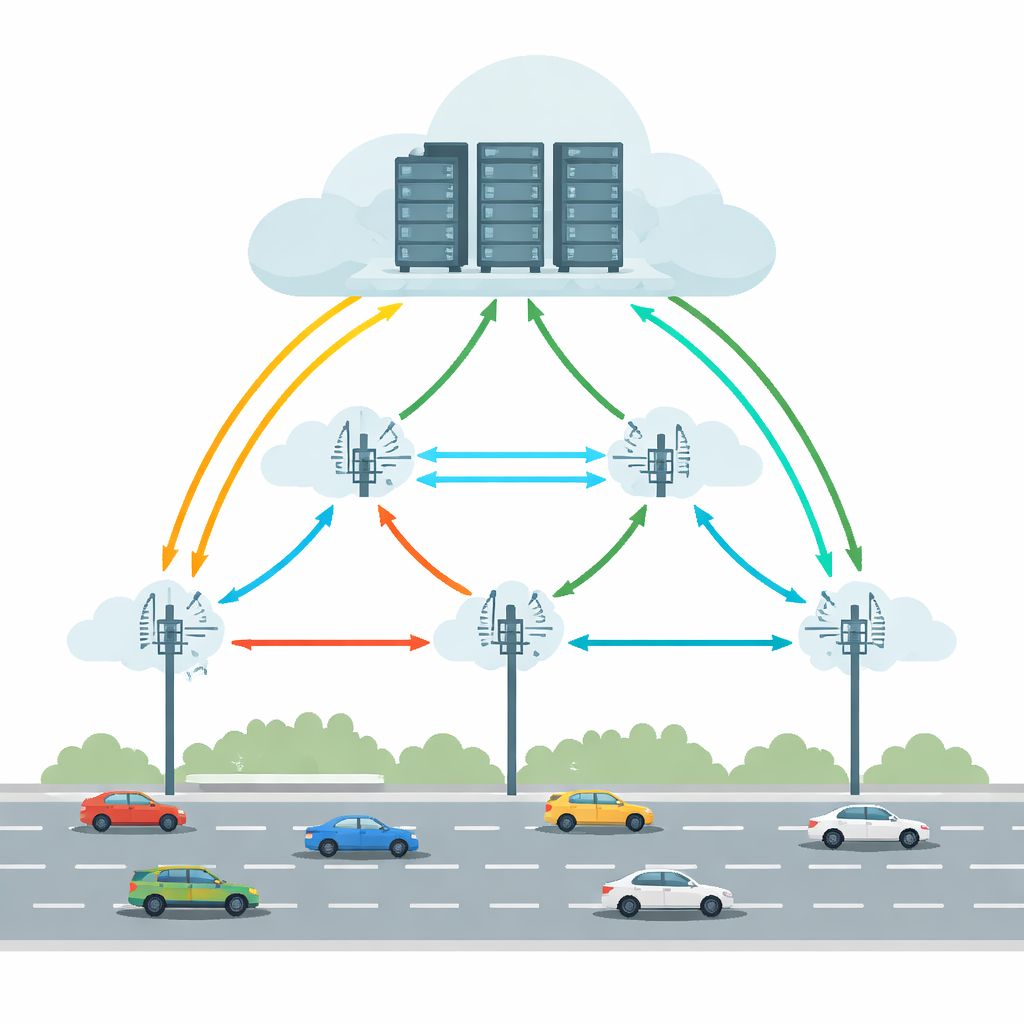

De huidige verbonden en zelfrijdende voertuigen voeren taken uit zoals objectdetectie, koersbehoud en augmented‑reality‑geleiding. Al dit werk uitsluitend in de auto uitvoeren vereist krachtige hardware en veel energie. Vehicular Edge Cloud Computing (VECC) pakt dit aan door voertuigen veeleisende taken te laten uitbesteden aan Roadside Units (RSU’s)—kleine rekenstations langs de weg—die op hun beurt kunnen samenwerken met grotere cloudservers. Maar deze opzet kent praktische problemen: auto’s bewegen snel tussen RSU’s, draadloze verbindingen vallen weg en zowel edge‑ als cloudmachines kunnen overbelast raken of uitvallen. Samen kunnen deze factoren leiden tot lange vertragingen of het volledig mislukken van taken, wat onaanvaardbaar is voor tijdkritische rijtoepassingen.

Beweging, vertragingen en uitval in balans brengen

Veel eerdere systemen probeerden offloading te verbeteren door te voorspellen waar een auto zal zijn, vertraging te minimaliseren of energie te besparen. Meestal zagen ze betrouwbaarheid echter als bijzaak en gingen ze uit van stabiele omstandigheden. De echte weg is rommeliger: draadloze verbindingen kunnen wegvallen, servers kunnen falen en verkeerspatronen kunnen plotseling veranderen. Dit artikel stelt dat een praktische oplossing tegelijk moet kijken naar voertuigmobiliteit, netwerklatenties en het risico op uitval, en dat over meerdere RSU’s heen. Het moet bovendien een centrale "hersenen" vermijden die een bottleneck wordt naarmate het wegennet groeit. Besluitvorming moet gedistribueerd zijn, met lokale eenheden die snel kunnen reageren en toch leren van het bredere systeem.

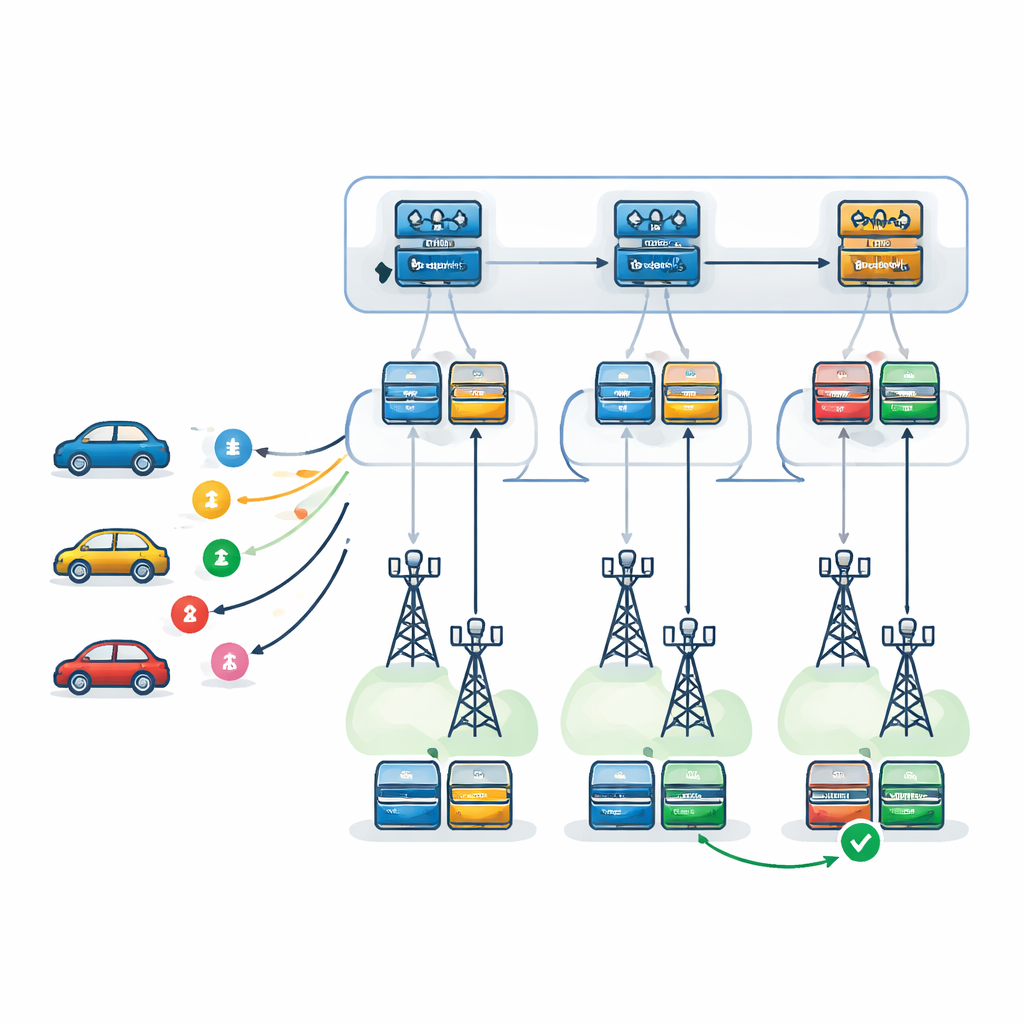

Twee niveaus van lerende "hersenen" langs de weg

De auteurs stellen een tweelaags beslissingskader voor, aangedreven door Deep Q‑Networks, een vorm van deep reinforcement learning die leert via trial‑and‑error. Op het eerste niveau kiest een leeragent—gerepliceerd bij elke RSU—welke RSU het meest geschikt is om elke binnenkomende taak af te handelen. Hij houdt rekening met de belasting van elke RSU, verwerkingskracht, faalpatronen en het verwachte traject van het voertuig, evenals de tijd die nodig is om resultaten terug te sturen langs dat traject. Op het tweede niveau, zodra een RSU is gekozen, bepaalt een lokale agent precies hoe de taak moet worden uitgevoerd: welke server primair moet zijn, welke als back‑up dient en welk fout‑herstelpatroon toegepast wordt. Drie strategieën worden overwogen: opnieuw proberen op dezelfde server, na een fout overschakelen naar een back‑upserver, of primair en back‑up parallel laten draaien en de eerste die klaar is behouden.

Het systeem testen in een virtuele stad

Om te beoordelen hoe goed deze tweelaagse leeropzet werkt, bouwden de onderzoekers een gedetailleerde simulator die een verkeerssysteem (SUMO) koppelt aan een event‑based engine (SimPy). Dit stelde hen in staat rijdende voertuigen, wisselende draadloze omstandigheden en realistische wachtrijen bij edge‑ en cloudservers te modelleren. Ze vergeleken hun methode met verschillende alternatieven: een vergelijkbaar tweelaags systeem dat een andere leeralgoritme gebruikt (Proximal Policy Optimization), een eenvoudige gretige strategie die altijd de op dat moment schijnbaar beste RSU kiest, een no‑forwarding‑opzet waarbij taken alleen door de RSU die ze eerst ontvangt worden verwerkt, en een enkele "platte" leeragent die probeert alle beslissingen in één keer te nemen. Over veel episodes en bij verschillende verkeersintensiteiten maten ze gemiddelde beloningen, totale vertraging en hoe vaak taken faalden of hun deadlines misten.

Wat de resultaten laten zien op drukke wegen

Bij licht verkeer en tamelijk ruime deadlines presteerden de meeste methoden vergelijkbaar omdat middelen onderbenut waren. De verschillen werden duidelijk bij zwaar, onevenwichtig verkeer en strakkere tijdsbeperkingen—precies de stressvolle situaties die ertoe doen. In die omstandigheden verminderde het tweelaagse Deep Q‑Network taakuitval met ongeveer 29% tot 63% vergeleken met de andere benaderingen, en verbeterde het de totale beloning met grofweg 8% tot 38%. De hiërarchische structuur bleek schaalbaarder dan de platte learner naarmate het aantal RSU’s en servers toenam, en bleef robuust zelfs wanneer communicatie tussen RSU’s enigszins onbetrouwbaar was of wanneer voorspellingen over de toekomstige route van een voertuig onvolkomen waren.

Wat dit betekent voor dagelijkse bestuurders

In simpele bewoordingen laat de studie zien dat het wegennet een gelaagd "lerend brein" kan geven om verbonden en autonome voertuigen responsiever en betrouwbaarder te maken. Door eerst de juiste roadside unit voor elke taak te kiezen en vervolgens te plannen hoe die taak vertragingen en uitval moet doorstaan, houdt het systeem reactietijden laag en vergroot het de kans dat antwoorden op tijd aankomen. Hoewel inzet in de echte wereld nog steeds rommelige omstandigheden en veiligheidszorgen moet adresseren, schetst dit werk een pad naar slim, fouttolerant digitale infrastructuur die gelijke tred kan houden met de groeiende rekenkundige eisen van toekomstige auto’s.

Bronvermelding: Babaiyan, V., Bushehrian, O. & Javidan, R. A bi-level mobility-aware deep reinforcement learning approach for fault-tolerant task offloading in vehicular edge-cloud computing. Sci Rep 16, 11703 (2026). https://doi.org/10.1038/s41598-026-45763-z

Trefwoorden: vehicular edge computing, task offloading, deep reinforcement learning, fault tolerance, intelligent transportation systems