Clear Sky Science · es

Evaluación comparativa de sistemas de agentes basados en grandes modelos de lenguaje para tareas de decisión clínica

IA médica más inteligente, ¿pero a qué coste?

La inteligencia artificial se solicita cada vez más para ayudar a los médicos a revisar información compleja y tomar mejores decisiones. Un nuevo estudio plantea una pregunta simple pero vital: ¿rinden realmente mejor los sistemas de IA “agentivos” más avanzados de hoy—diseñados para razonar paso a paso y usar herramientas en línea—que los chatbots estándar en tareas médicas de estilo real, y justifican el tiempo y la potencia de cálculo adicionales que requieren?

De chatbots sencillos a agentes que ejecutan tareas

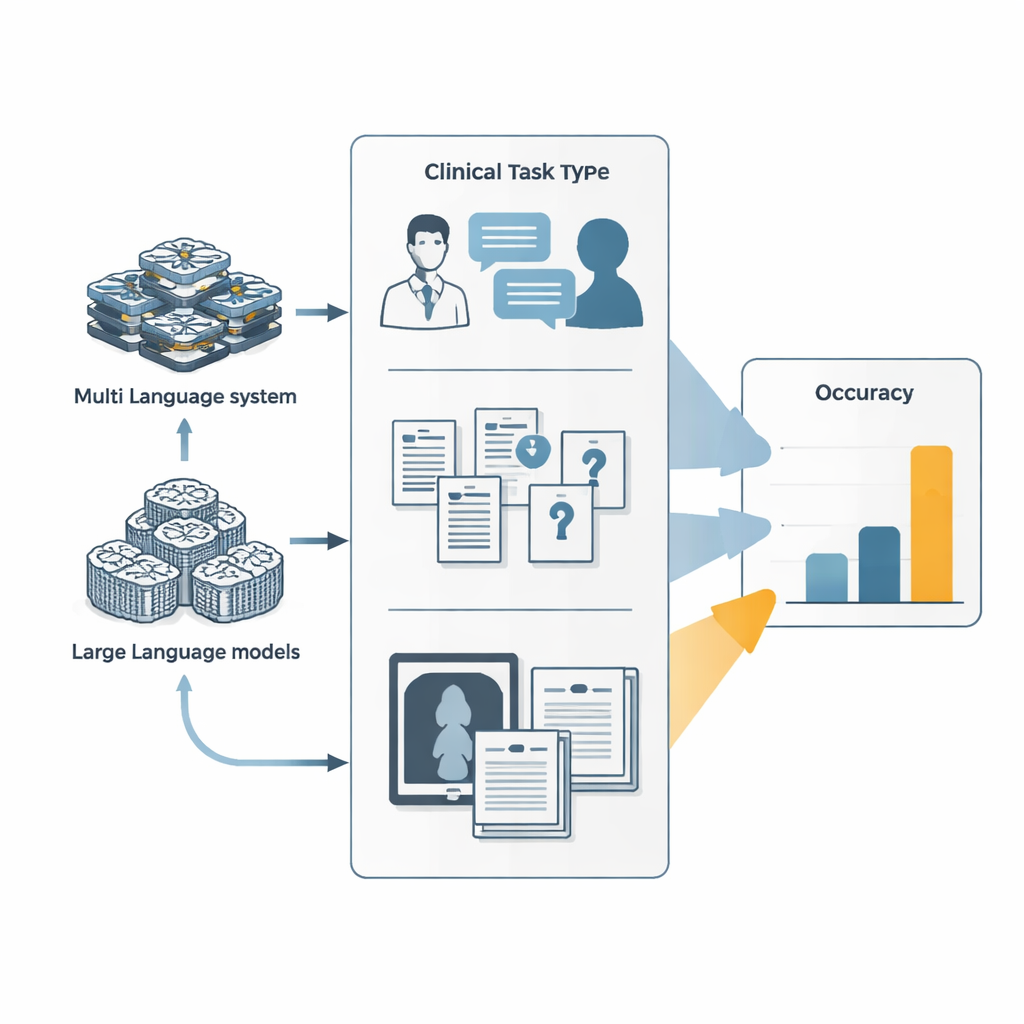

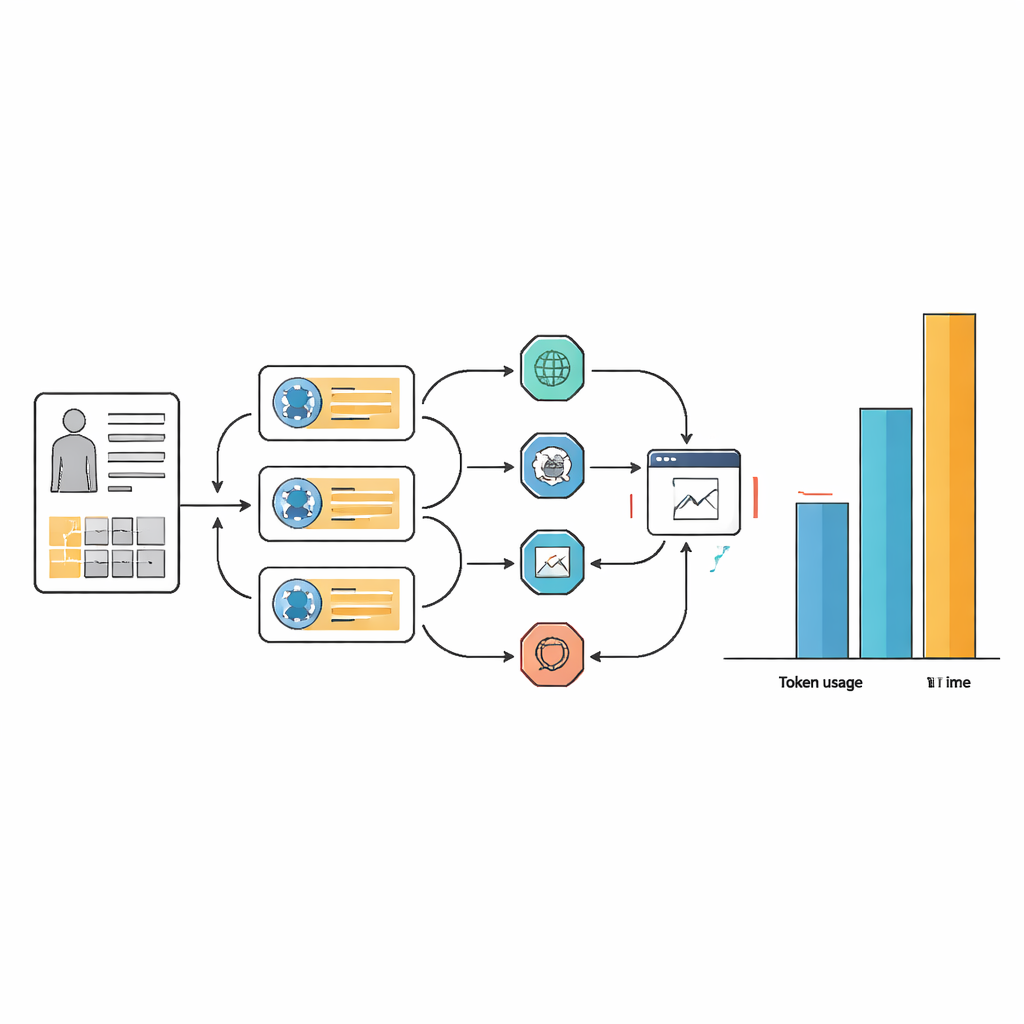

La mayoría de la gente conoce los grandes modelos de lenguaje como chatbots que responden preguntas en un solo paso. Los sistemas agentivos amplían esos modelos convirtiéndolos en trabajadores digitales que pueden planificar, invocar herramientas externas como navegadores web o ejecutores de código, y coordinar varios subagentes especializados. En este estudio, los investigadores compararon dos de esos sistemas de agentes—Manus y su versión de código abierto OpenManus—con modelos de lenguaje líderes de laboratorios de IA importantes. Todos los sistemas afrontaron tres familias de pruebas: visitas simuladas médico–paciente que se desarrollan a lo largo de muchas intervenciones conversacionales, preguntas extremadamente difíciles de exámenes y manuales médicos, y desafíos mixtos de texto e imagen como interpretar fotos clínicas junto con descripciones de casos.

¿Qué rendimiento alcanzaron realmente los agentes?

En estos puntos de referencia, los sistemas de agentes superaron a sus modelos de lenguaje subyacentes, pero solo por un margen pequeño. En conversaciones diagnósticas simuladas, ajustar OpenManus para que actuara como asistente médico y utilizara las herramientas de forma más activa incrementó su precisión en unas 7–9 puntos porcentuales en comparación con su modelo base. En un conjunto exigente de preguntas complejas y ricas en conocimiento, OpenManus volvió a rendir algo mejor que su modelo de referencia y de forma aproximada a los mejores sistemas propietarios. Aun así, las puntuaciones absolutas se mantuvieron modestas: en algunas de las preguntas médicas más difíciles, diseñadas para frustrar atajos, incluso los mejores agentes respondieron correctamente menos de una de cada diez, muy por debajo de lo necesario para un uso no supervisado en clínicas.

El coste oculto: tiempo, complejidad y cómputo

Esas pequeñas ganancias en precisión tuvieron un coste elevado en recursos y en la complejidad del flujo de trabajo. Para muchas tareas, los sistemas de agentes utilizaron de 10 a 100 veces más tokens de texto que el modelo de lenguaje subyacente por sí solo, y con frecuencia tardaron más del doble en responder. Esta sobrecarga proviene de la forma en que los agentes repasan repetidamente planificaciones, búsquedas en la web, extracción de información y reconsideración de sus respuestas. Aunque un diseño de instrucciones cuidadoso hizo los flujos de agentes más depurados y coherentes en la selección de herramientas, no eliminó la necesidad básica de muchos pasos internos. En términos prácticos, un asistente de IA que requiere más de un minuto y un enorme poder de cálculo por caso puede resultar difícil de justificar en hospitales concurridos o en entornos con recursos limitados.

El problema de los detalles inventados

Otra preocupación fue la alucinación—cuando una IA inventa con confianza síntomas del paciente o resultados de pruebas que nunca se proporcionaron. Los investigadores encontraron que casi todos los casos ejecutados por agentes contenían alguna alucinación, especialmente declaraciones del paciente o valores de pruebas fabricados. Añadieron capas de seguridad que postprocesaban la salida de los agentes, reescribieron los prompts para desalentar conjeturas y ofrecieron ejemplos de comportamiento correcto. Estas intervenciones bloquearon casi el 90% del contenido alucinatorio y redujeron la fracción de casos en que las alucinaciones afectaban el diagnóstico final a aproximadamente un tercio. Curiosamente, no hubo una diferencia clara en la precisión global entre casos con y sin alucinaciones, quizá porque los detalles inventados a veces provocaron pasos de comprobación adicionales que corrigieron errores iniciales.

Qué significa esto para la IA futura en las clínicas

Para quienes no son especialistas, la conclusión es que los agentes médicos más elaborados de hoy no son mejoras mágicas frente a chatbots potentes. Se les puede incentivar para que rindan algo mejor razonando en etapas y usando herramientas en línea, pero su precisión actual sigue siendo demasiado baja, y su demanda de tiempo y cómputo demasiado alta, para un uso clínico rutinario sin supervisión humana estrecha. El estudio sostiene que el progreso debería centrarse no solo en aumentar ligeramente las puntuaciones, sino también en hacer los sistemas más rápidos, menos consumidores de recursos, menos propensos a inventar información y mejor fundamentados en datos reales de pacientes. Solo entonces la IA agentiva estará lista para ayudar a los clínicos de forma segura y fiable en la atención cotidiana.

Cita: Liu, Y., Carrero, Z.I., Jiang, X. et al. Benchmarking large language model-based agent systems for clinical decision tasks. npj Digit. Med. 9, 259 (2026). https://doi.org/10.1038/s41746-026-02443-6

Palabras clave: IA clínica, grandes modelos de lenguaje, soporte a la decisión médica, agentes de IA, evaluación en atención sanitaria