Clear Sky Science · de

Benchmarking von agentenbasierten Großsprachmodell-Systemen für klinische Entscheidungsaufgaben

Intelligentere medizinische KI – aber zu welchem Preis?

Künstliche Intelligenz wird zunehmend damit beauftragt, Ärztinnen und Ärzten beim Durchsieben komplexer Informationen zu helfen und bessere Entscheidungen zu treffen. Eine neue Studie stellt eine einfache, aber wesentliche Frage: Erbringen die heute fortschrittlichsten „agentischen“ KI-Systeme – konzipiert, um schrittweise zu schlussfolgern und Online-Tools zu nutzen – tatsächlich bessere Leistungen als herkömmliche Chatbots bei medizinischen Aufgaben im realistischeren Stil, und rechtfertigen sie den zusätzlichen Zeit- und Rechenaufwand?

Von einfachen Chatbots zu aufgabenausführenden Agenten

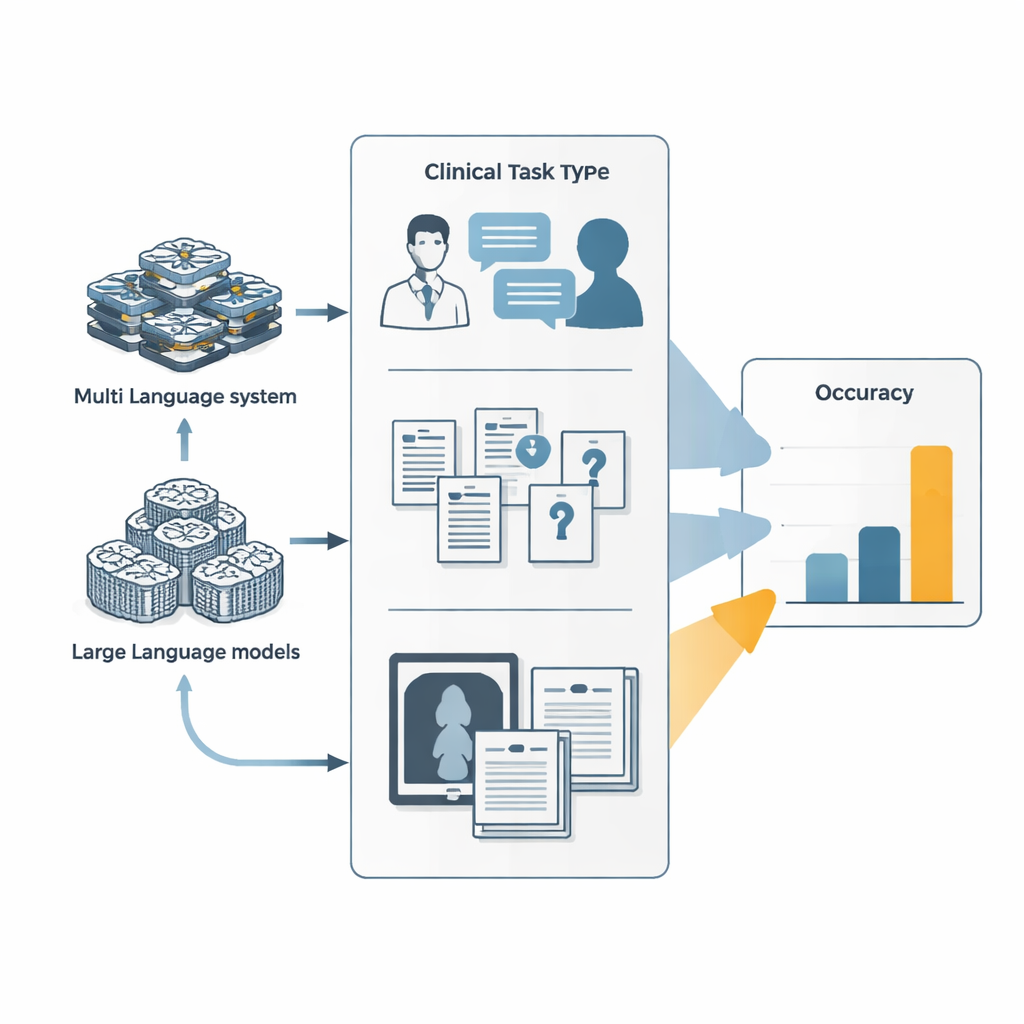

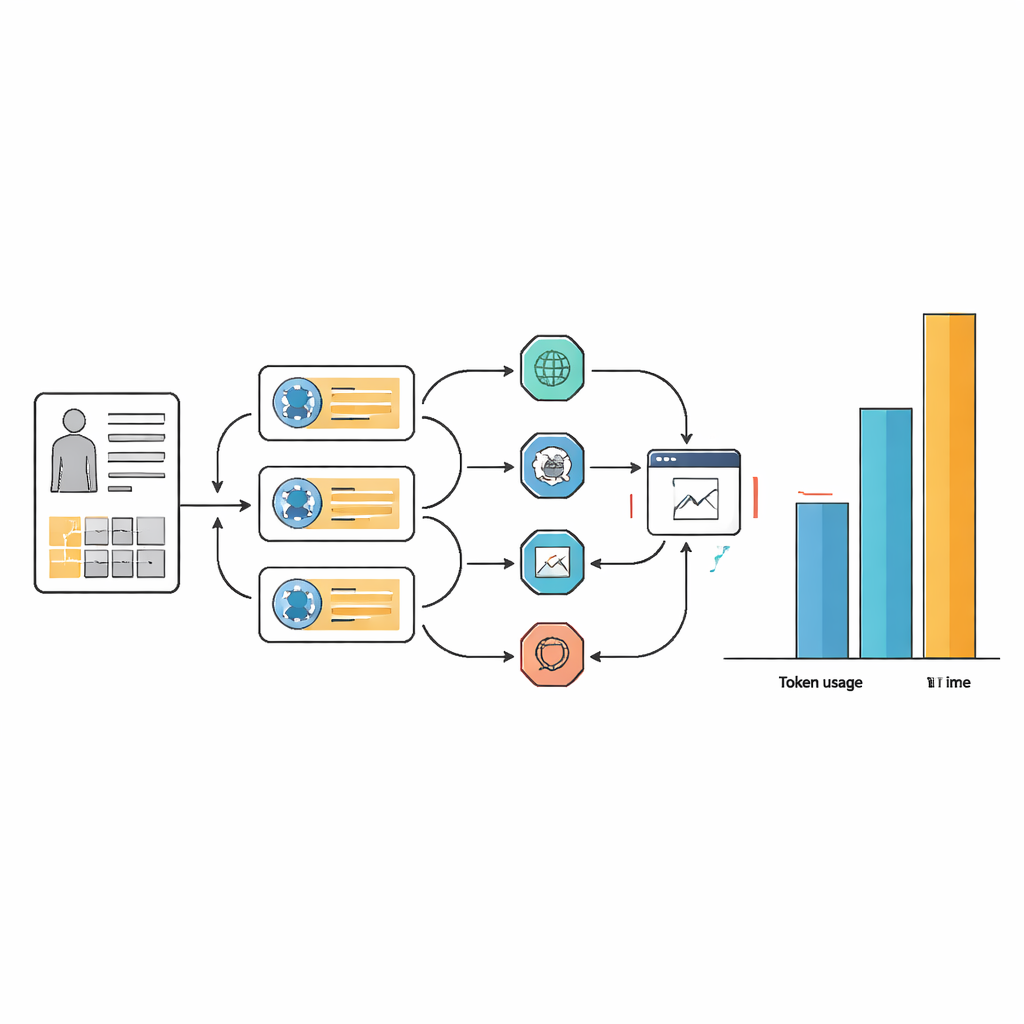

Die meisten Menschen kennen große Sprachmodelle als Chatbots, die Fragen in einem Durchgang beantworten. Agentische Systeme bauen auf diesen Modellen auf, indem sie sie in digitale Arbeitende verwandeln, die planen, externe Werkzeuge wie Browser oder Code-Runner aufrufen und mehrere spezialisierte Subagenten koordinieren können. In der Studie verglichen Forschende zwei solche Agentensysteme – Manus und dessen Open-Source-Verwandten OpenManus – mit führenden Sprachmodellen großer KI-Labore. Alle Systeme bearbeiteten drei Aufgabengruppen: simulierte Arzt–Patienten-Gespräche, die sich über viele Gesprächsrunden entwickeln, extrem schwierige medizinische Prüfungs- und Lehrbuchfragen sowie gemischte Text‑und‑Bild‑Herausforderungen, etwa das Interpretieren klinischer Fotos zusammen mit Fallbeschreibungen.

Wie gut schnitten die Agenten tatsächlich ab?

In diesen Benchmarks lagen die Agentensysteme zwar vor ihren zugrunde liegenden Sprachmodellen, aber nur knapp. Bei simulierten diagnostischen Gesprächen führte das Feinabstimmen von OpenManus auf ein Verhalten wie das einer ärztlichen Assistenz und ein aktiverer Einsatz von Werkzeugen zu einer Genauigkeitssteigerung von etwa 7–9 Prozentpunkten gegenüber dem Basismodell. Bei einer anspruchsvollen Sammlung komplexer, wissensintensiver Fragen schnitt OpenManus erneut etwas besser als sein Backbone-Modell ab und etwa auf Augenhöhe mit führenden proprietären Systemen. Die absoluten Werte blieben jedoch bescheiden: Bei einigen der härtesten medizinischen Fragen, die darauf ausgelegt sind, Abkürzungen zu verhindern, beantworteten selbst die besten Agenten weniger als eine von zehn Fragen korrekt – weit unter dem, was für eine unüberwachte Anwendung in Kliniken nötig wäre.

Der versteckte Preis: Zeit, Komplexität und Rechenaufwand

Diese kleinen Genauigkeitsgewinne hatten einen hohen Preis in Form von Ressourcen- und Workflow-Komplexität. Bei vielen Aufgaben nutzten die Agentensysteme 10‑ bis 100‑mal mehr Texttokens als das zugrundeliegende Sprachmodell allein und benötigten oft mehr als doppelt so lange für eine Antwort. Dieser Overhead entsteht dadurch, dass Agenten wiederholt Planungs‑, Web‑Such‑, Informations‑Extraktions‑ und Neubewertungszyklen durchlaufen. Sorgfältiges Prompt‑Design machte Agenten‑Workflows zwar effizienter und konstanter in der Wahl der Werkzeuge, beseitigte aber nicht die grundsätzliche Notwendigkeit vieler interner Schritte. Praktisch bedeutet das: Eine KI‑Assistenz, die pro Fall über eine Minute und enorme Rechenkapazitäten beansprucht, ist in vielbeschäftigten Krankenhäusern oder ressourcenbegrenzten Umgebungen schwer zu rechtfertigen.

Das Problem erfundener Details

Ein weiteres Problem war Halluzination – wenn eine KI mit großer Sicherheit Patientensymptome oder Laborwerte erfindet, die nie bereitgestellt wurden. Die Forschenden stellten fest, dass in nahezu jedem agentengesteuerten Fall einige Halluzinationen auftraten, insbesondere erfundene Patientenaussagen oder Testergebnisse. Sie fügten Sicherheitsebenen hinzu, die die Agentenausgaben nachbearbeiteten, änderten Prompts, um Raten zu entmutigen, und lieferten Beispiele erwünschten Verhaltens. Diese Interventionen unterdrückten nahezu 90 % der halluzinierten Inhalte und reduzierten den Anteil der Fälle, in denen Halluzinationen die finale Diagnose beeinflussten, auf etwa ein Drittel. Interessanterweise zeigte sich kein klarer Unterschied in der Gesamtgenauigkeit zwischen Fällen mit und ohne Halluzinationen—vielleicht weil erfundene Details manchmal zusätzliche Prüfungen auslösten, die anfängliche Fehler korrigierten.

Was das für die künftige KI in Kliniken bedeutet

Für Nicht‑Spezialisten lautet das Fazit: Die heute elaborierteren medizinischen KI‑Agenten sind keine magischen Verbesserungen gegenüber leistungsfähigen Chatbots. Durch gestuftes Denken und die Nutzung von Online‑Werkzeugen lassen sie sich zu leicht besseren Ergebnissen bewegen, doch ihre aktuelle Genauigkeit ist weiterhin zu niedrig und ihr Bedarf an Zeit und Rechenressourcen zu hoch für den routinemäßigen klinischen Einsatz ohne enge menschliche Aufsicht. Die Studie argumentiert, dass der Fortschritt sich nicht nur auf leichte Score‑Verbesserungen konzentrieren sollte, sondern auch auf schnellere, weniger ressourcenintensive Systeme, die seltener Dinge erfinden und besser in realen Patientendaten verankert sind. Erst dann wird agentische KI bereit sein, Ärztinnen und Ärzte im Alltag sicher und zuverlässig zu unterstützen.

Zitation: Liu, Y., Carrero, Z.I., Jiang, X. et al. Benchmarking large language model-based agent systems for clinical decision tasks. npj Digit. Med. 9, 259 (2026). https://doi.org/10.1038/s41746-026-02443-6

Schlüsselwörter: klinische KI, große Sprachmodelle, medizinische Entscheidungsunterstützung, KI-Agenten, Benchmarking im Gesundheitswesen