Clear Sky Science · ar

أنظمة متعددة الوكلاء وآلية تسجيل متقدمة قائمة على المصداقية في التحقق من الحقائق

لماذا يهم التحقق من الادعاءات على الإنترنت حقًا

كل يوم، تغمرنا الشبكات الاجتماعية وتغذيات الأخبار بادعاءات حول العلم والسياسة والصحة. بعضها دقيق، وبعضها مضلل، وبعضها يمزج بين الحقيقة والزيف بطرق دقيقة. تقدم هذه الورقة طريقة جديدة لتقييم مدى موثوقية مثل هذه النصوص عبر إشراك عدة «مدققي حقائق» رقميين يعملون معًا ثم دمج آرائهم بعناية في درجة موثوقية واحدة.

العديد من الأدوات الحالية تقصر في مهمتها

نما التحقق الآلي من الحقائق بسرعة مع تطور نماذج اللغة الكبيرة، أنظمة الذكاء الاصطناعي التي تقف خلف أدوات مثل الدردشات الحديثة. تركز معظم الأنظمة الحالية على قرار بسيط بنعم أو لا: هل الادعاء صحيح أم خاطئ؟ غالبًا ما تعتمد على مصدر معلومات واحد، أو حتى على معرفة نموذج اللغة نفسه. يؤدي ذلك إلى مشكلتين في النقاشات الإلكترونية الحقيقية. أولًا، تميل نماذج اللغة إلى الثقة المفرطة، فتبدو واثقة حتى عندما تكون خاطئة. ثانيًا، غالبًا ما تمزج المشاركات الحقيقية تصريحات صحيحة وخاطئة، لذا فإن تصنيف نص كامل كتسمية صحيحة/خاطئة واحدة يكون خامًا جدًا ولا يكفي.

العديد من مدققي الحقائق الرقميين بدلًا من واحد

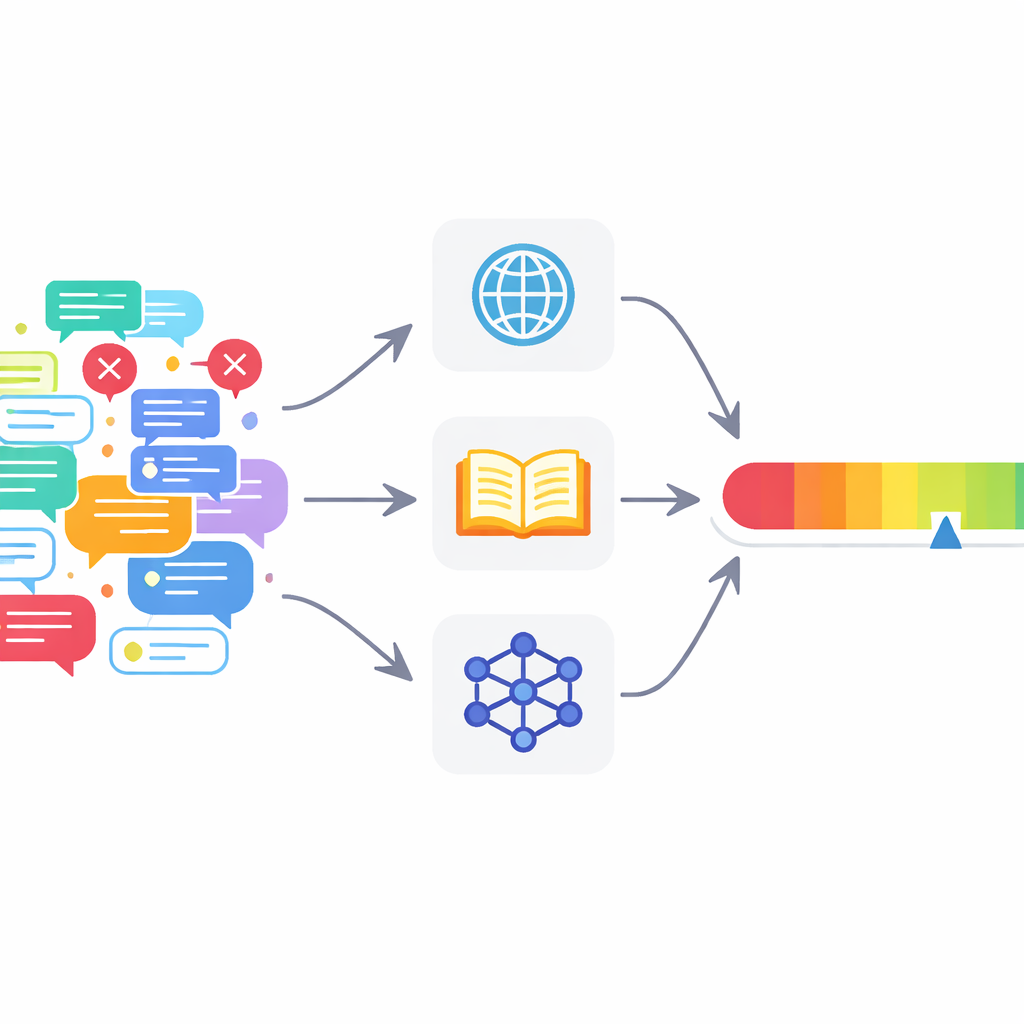

لمعالجة هذه المشكلات، يقترح المؤلفون إطار عمل تحقق من الحقائق متعدد الوكلاء (MAFC). بدلاً من مدقق واحد كلي المعرفة، ينشر النظام عدة وكلاء، كل منهم يستند إلى مصدر معلومات مختلف. يبحث أحد الوكلاء على الويب، ويستعلم آخر ويكيبيديا، ويستخدم ثالث نموذج ذكاء اصطناعي لتوليد ومقارنة إجابات بديلة — تقنية مأخوذة من أبحاث رصد الهلوسة. يُقسّم النص الذي سيُفحَص أولًا إلى ادعاءات موضوعية فردية. يحقق كل وكيل في كل ادعاء، ويقرر ما إذا بدا صحيحًا أم خاطئًا، ويُنتج درجة ثقة بين 0 و1 تعكس مدى قوة اعتقاده بحكمه.

تحويل الآراء المتناثرة إلى درجة واحدة

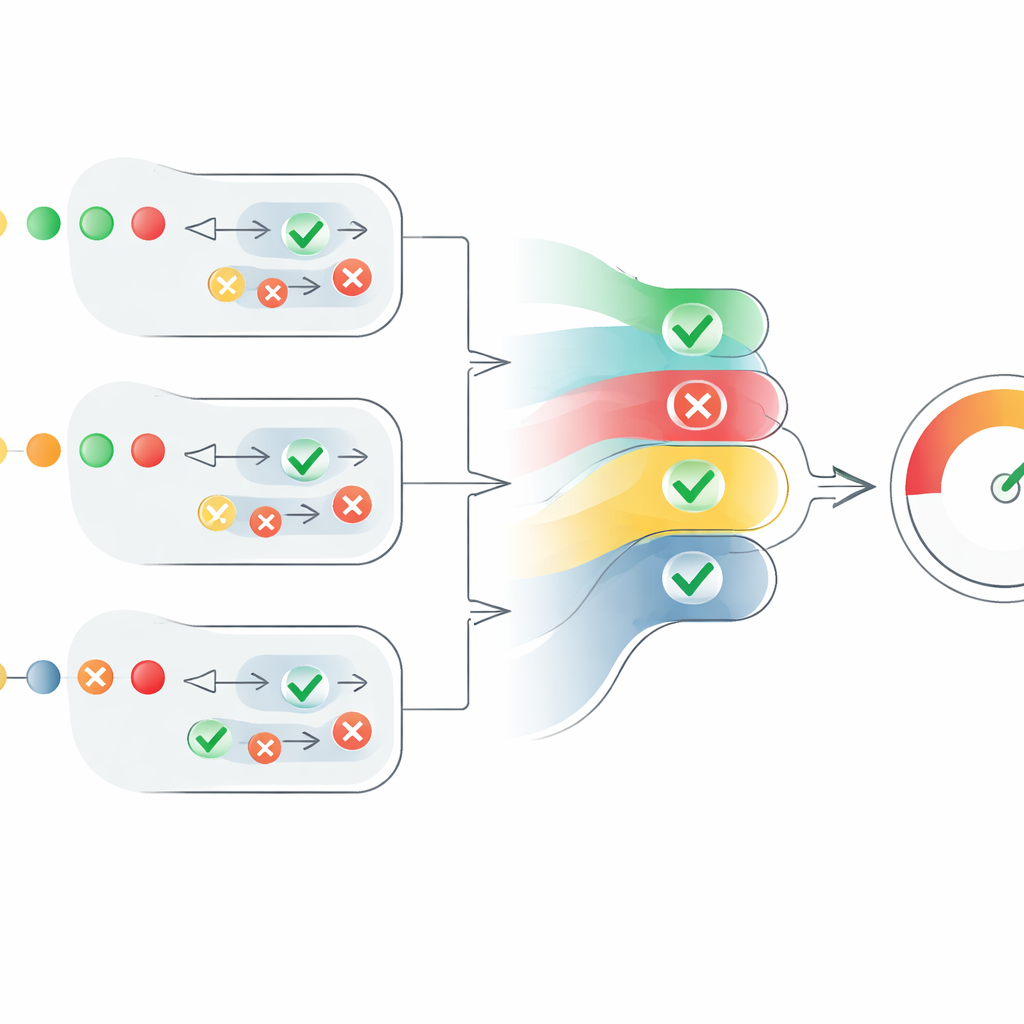

جوهر الورقة هو آلية تسجيل جديدة تحول هذه الآراء المتناثرة للوكيل إلى مقياس واضح للمصداقية. لكل ادعاء، يحول النظام الأحكام «صحيحة» إلى أرقام موجبة و«خاطئة» إلى أرقام سالبة، ثم يوزنها بدرجة ثقة كل وكيل. كما يأخذ في الحسبان عدد الوكلاء المتفقين، لكن بطريقة مُسيطر عليها: موافقة وكلاء إضافيين تساعد، مع أن كل صوت إضافي يضيف قليلًا أقل من الذي قبله. يمنع هذا أن تسود مجموعة كبيرة من الوكلاء الضعفاء وغير اليقين على عدد أصغر من الوكلاء الواثقين تمامًا. النتيجة هي درجة على مستوى الادعاء تتراوح بين 0 و1. تُحسب درجات جميع الادعاءات في نص ما بمعدل وسطي لإنتاج درجة مصداقية على مستوى النص، والتي يمكن تفسيرها على أنها «صحيح بالكامل» أو «صحيح جزئيًا» أو «خاطئ».

اختبار الإطار

قيّم الباحثون نظام MAFC على مجموعات بيانات معتمدة من ادعاءات قصيرة ونصوص مُركبة. استخدموا SciFact، التي تحتوي على بيانات علمية موسومة على أنها مدعومة أو مفندة بأوراق بحثية، وFEVER، مجموعة كبيرة من الادعاءات المبنية على ويكيبيديا. كما بنوا مجموعة بيانات جديدة، SciFact‑Mixed، حيث تتكون النصوص القصيرة من دمج عدة ادعاءات قد تكون كلها صحيحة أو كلها خاطئة أو مزيجًا من الاثنين. قورن أداء MAFC بقاعدة قوية لوكيل واحد وبطرق أبسط لدمج عدة وكلاء، مثل المتوسط البسيط أو جمع درجاتهم.

ماذا تظهر النتائج

عبر هذه التجارب، تفوّق النظام متعدد الوكلاء مع قاعدة التسجيل الجديدة باستمرار على البدائل. كان أكثر دقة من المدقق الأحادي المعتمد على الذكاء الاصطناعي في تحديد ما إذا كان الادعاء صحيحًا أم خاطئًا، وكان قويًا بشكل خاص في التعرف على النصوص صحيحة جزئيًا التي تمزج بيانات دقيقة ومضللة. على مجموعة بيانات FEVER، حقق MAFC دقة تقارن بأنظمة منافسة رفيعة المستوى التي تم تدريبها خصيصًا على تلك البيانات، رغم أن MAFC عمل دون مثل هذا التدريب. يشير المؤلفون إلى أن إطارهم لا يزال له قيود، مثل الاعتماد على نفس نموذج الذكاء الاصطناعي الأساسي لجميع الوكلاء ومواجهة صعوبة مع الادعاءات الحساسة زمنياً، لكنهم يجادلون بأنه يوفر أساسًا صلبًا وشفافًا للتحقق من الحقائق متعدد المستويات والأغنى.

ما الذي يعنيه هذا للقراء العاديين

بالنسبة لشخص يحاول التنقل في مشهد معلوماتي ضوضائي، يشير هذا العمل إلى أدوات تفعل أكثر من وضع ختم بسيط صحيح أو خاطئ على المشاركات. من خلال استحضار الأدلة من عدة مصادر ووزن اتفاقها وثقتها بطريقة مبدئية، يمكن لإطار MAFC تقدير مدى موثوقية نص ما بشكل عام وإبراز متى يكون موثوقًا جزئيًا فقط. رغم أنه لا يزال نموذجًا بحثيًا أوليًا، يمكن أن يساعد مثل هذا النظام في نهاية المطاف القراء والمشرفين ومنصات النقاش على فهم أفضل لمكان المعلومات على الطيف من حقيقة راسخة إلى إشاعة مشكوك فيها.

الاستشهاد: Dong, Y., Ito, T. Multi-agent systems and credibility-based advanced scoring mechanism in fact-checking. Sci Rep 16, 11814 (2026). https://doi.org/10.1038/s41598-026-41862-z

الكلمات المفتاحية: المعلومات المضللة, التحقق من الحقائق, نماذج اللغة الكبيرة, أنظمة متعددة الوكلاء, تقييم المصداقية