Clear Sky Science · ar

كشف استراتيجيات متقدمة لتعلّم النقل لشبكات عصبية عميقة في معالجة اللغة الطبيعية

لماذا تهم أدوات اللغة الأذكى

من فلاتر البريد الإلكتروني إلى الدردشات الآلية وتطبيقات الترجمة، تعتمد العديد من أدوات اليوم الرقمية على حواسيب قادرة على قراءة وكتابة اللغة الإنسانية. تدريب هذه الأنظمة من الصفر مكلف ويحتاج إلى بيانات كثيرة، لذا يبدأ الباحثون غالبًا من نماذج لغوية كبيرة مُدرّبة مسبقًا ويكيّفونها لمهام جديدة — وهي ممارسة تُعرف بتعلّم النقل. تبحث هذه الورقة بشكل منهجي في كيفية أداء طرق التكييف المختلفة، بمقارنة سبع استراتيجيات عبر أنواع متعددة من المهام اللغوية لمعرفة أيها تقدم أفضل توازن بين الدقة والسرعة والعملية في بيئات العالم الحقيقي.

كيف تعيد الآلات استخدام ما تعرفه بالفعل

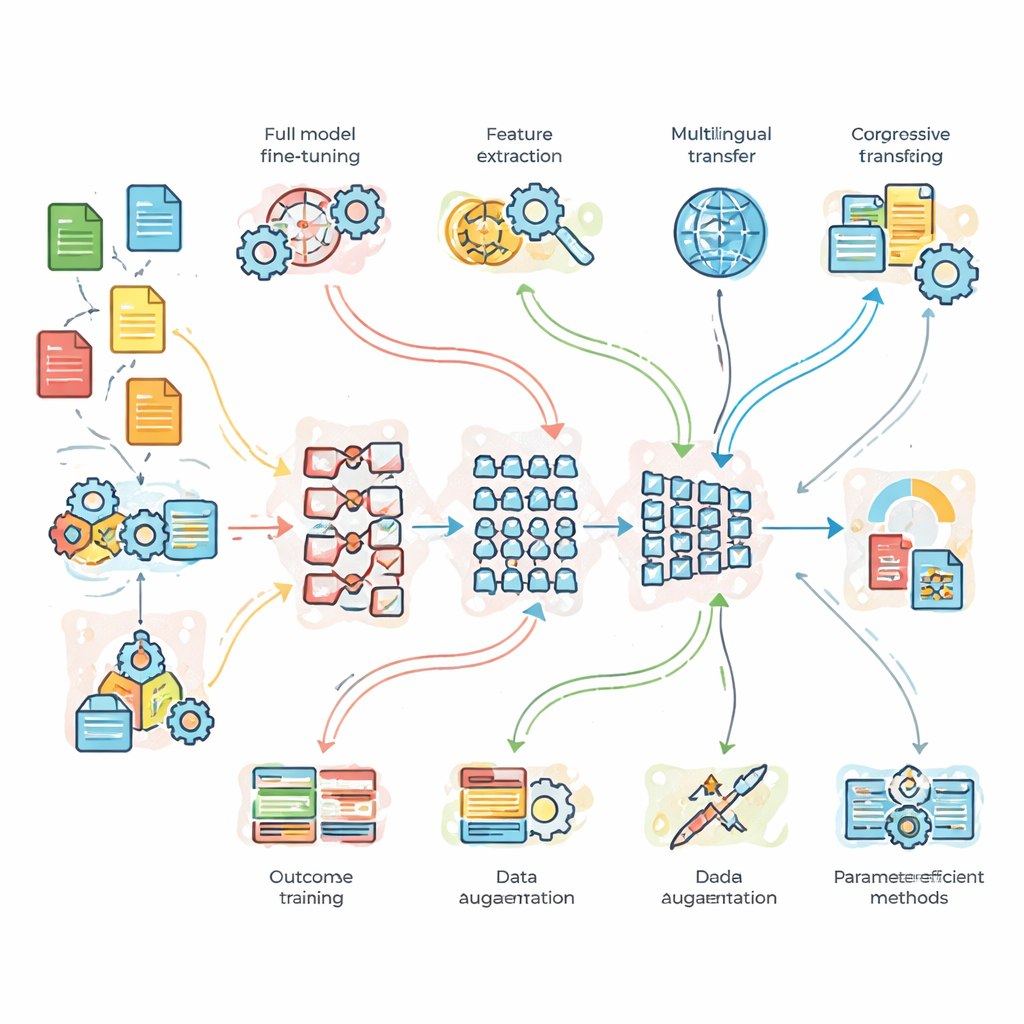

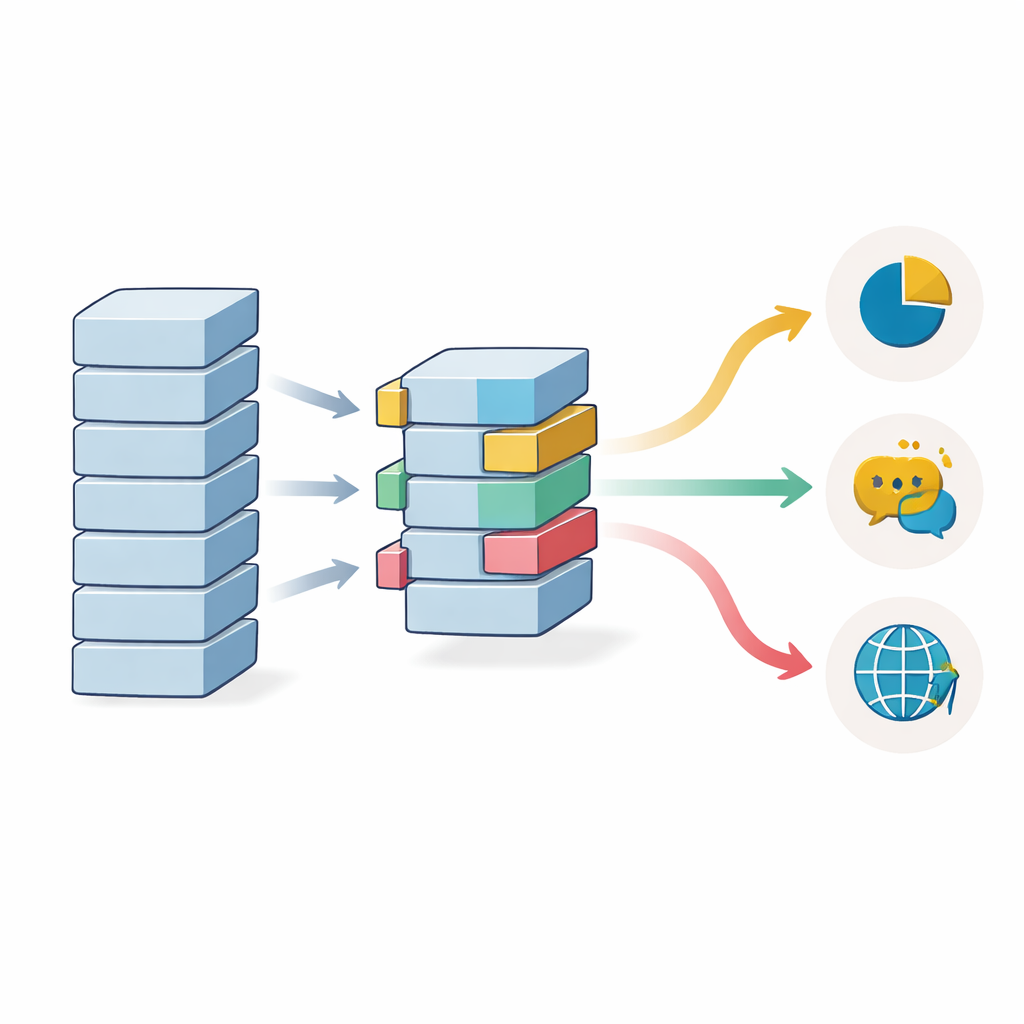

تبدأ الدراسة بشرح كيف تتعلم أنظمة اللغة الحديثة من مجموعات نصية ضخمة ثم تعيد استخدام هذه المعرفة على مهام جديدة. نماذج معروفة مثل BERT وقريبها الأكبر (المسماة BERT-3 في هذا العمل) تتعلم أولًا أنماطًا عامة للكلمات والجمل. لاحقًا يتم توجيهها نحو أهداف محددة مثل تصنيف موضوعات الأخبار، تقييم نبرة منشورات وسائل التواصل، أو الترجمة بين الإنجليزية والفرنسية. يقارن المؤلفون بين «التخصيص الدقيق الكامل»، حيث يُعدَّل كل جزء من النموذج ليتناسب مع المهمة الجديدة، وبين طرق «قائمة على الميزات» التي تتعامل مع النموذج الكبير كأداة استخراج ميزات مجمدة تغذي نموذجًا أصغر وأبسط. كما يبرزون استراتيجيات تغير كيفية عرض البيانات على النموذج، بما في ذلك التدريب التقدمي الذي يبدأ بحالات أسهل ثم ينتقل إلى أصعب.

ما اختبره الباحثون عمليًا

لتخطي النظرية، أجرى الفريق تجارب مضبوطة على ثلاث مسائل معيارية. أولًا، مهمة تصنيف موضوعات الأخبار مع وفرة من البيانات النظيفة؛ ثانيًا، تحليل المشاعر على تغريدات صاخبة ومليئة بالعامية؛ وثالثًا، الترجمة من الإنجليزية إلى الفرنسية. قارنوا شبكة أساسية خفيفة مصممة خصيصًا، وBERT القياسي، ونموذج أعمق BERT-3. وفوق هذه النماذج طبّقوا سبع استراتيجيات تكييف: التخصيص الدقيق الكامل، النقل القائم على الميزات، التدريب التقدمي وتكييف النطاق، التخصيص الدقيق متعدد اللغات، توسيع البيانات (مثل إعادة صياغة الجمل)، وطريقتان حديثتان «فعّالتان من حيث المعاملات» تعدلان فقط جزءًا صغيرًا من أزرار النموذج الداخلية. مكّنهم هذا الإعداد من سؤال ليس فقط أي نموذج أقوى، بل متى تكون التعقيدات أو البيانات الإضافية مجدية حقًا.

أي النماذج والاستراتيجيات تتفوق

تُظهر النتائج نمطًا واضحًا: إن نموذج BERT-3 الأكبر يتفوق باستمرار على كل من BERT القياسي والنموذج الخفيف في المهام الأكثر تطلبًا، خصوصًا تحليل المشاعر والترجمة. مع ذلك، يبقى النموذج البسيط منافسًا بشكل مدهش في تصنيف الأخبار البسيطة، مما يؤكد أن الأكبر ليس دائمًا ضروريًا. من ناحية استراتيجية التدريب، يقدم التخصيص الدقيق التقدمي وتكييف النطاق أفضل النتائج الإجمالية، لا سيما في الأمثلة الأصعب حيث تكون الصياغة أطول أو أكثر تعقيدًا. كما يساعد توسيع البيانات، حيث يعمل مثل الحصول على بيانات تدريب إضافية عن طريق إعادة صياغة العبارات الموجودة. والأهم من ذلك، أن نهجين فعّالين من حيث المعاملات — طبقات المحولات (adapters) وطريقة تُدعى LoRA — يقتربان جدًا من أفضل أداء مع تحديث أقل من خمسة بالمئة من معاملات النموذج، مما يقلص بشكل كبير متطلبات الذاكرة والحوسبة.

لماذا لا تزال كمية البيانات وتنوّع اللغات مهمة

تفحص الدراسة أيضًا مقدار البيانات الموسومة المطلوبة عند استخدام تعلّم النقل. ترتفع الدقة بثبات مع زيادة عينات التدريب، لكن بفضل البدء من نموذج مُدرّب مسبقًا، تصل التجارب حتى مع ألف مثال فقط إلى أداء كان سيحتاج عادة إلى بيانات أكثر بكثير. تبدأ المكاسب في التسطح حول 20,000 عينة على المعايير الأنظف، رغم أن مجموعات البيانات الأكثر تعقيدًا وصخبًا قد تستفيد لا تزال من مجموعات تدريب أكبر. تساعد النماذج متعددة اللغات، التي تُدرّب على لغات عديدة في آن واحد، عندما تكون البيانات الموسومة نادرة في لغة معينة، لكنها قد تتخلف قليلًا عن نماذج أحادية اللغة عندما تتوفر الكثير من الأمثلة الإنجليزية، مما يشير إلى مقايضة بين التغطية الواسعة والتخصص الدقيق.

ماذا يعني هذا لتقنيات اللغة المستقبلية

للقراء خارج الميدان، الخلاصة الرئيسية أن ليست هناك وصفة واحدة «أفضل» لتكييف النماذج اللغوية الكبيرة. تبرز النماذج الأكبر مثل BERT-3 في المهام الصعبة المتعلقة بالفهم والترجمة، بينما قد تكون الشبكات الأصغر كافية تمامًا للوظائف الأبسط. الطرق التي تقدم المهام تدريجيًا أو توسّع مجموعة التدريب بأمثلة معاد صياغتها تُحسّن عادة من متانة الأنظمة، خاصة عندما تكون البيانات محدودة. وربما الأهم من ذلك، أن التقنيات الأحدث التي تعدّل مكوّنات إضافية صغيرة تقدّم دقة تقارب مستوى النخبة بتكلفة أقل بكثير. وتقترح هذه النتائج مستقبلًا يمكن فيه تكييف أدوات لغوية قوية بشكل أكثر دقة لاحتياجات وموارد شركات ولغات وتطبيقات مختلفة، مما يجعل معالجة اللغة الطبيعية المتقدمة أكثر وصولًا وكفاءة.

الاستشهاد: Abbassy, M.M., Ead, W.M., El-Shora, A.I.A. et al. Uncovering advanced transfer learning strategies for deep neural networks in natural language processing. Sci Rep 16, 14698 (2026). https://doi.org/10.1038/s41598-026-39819-3

الكلمات المفتاحية: تعلّم النقل, معالجة اللغة الطبيعية, استراتيجيات التخصيص الدقيق, نماذج لغوية كبيرة, طرق فعّالة من حيث المعاملات