Clear Sky Science · zh

生成式人工智能与大型语言模型在产业中的应用:对14个行业指南和政策声明的文本挖掘分析与批判性评估

这与日常生活的关系

像 ChatGPT 这样的生成式人工智能工具正迅速进入办公室、医院、银行、新闻编辑室,甚至施工现场。它们承诺提供更快的服务、更便宜的产品和新的创造力形式——但也带来关于隐私、安全和公平的棘手问题。本文调查了14个不同行业的大公司如何实际制定这些系统的规则,揭示企业在哪些方面表现谨慎、在哪些方面冒风险,以及这对工人、消费者和公民意味着什么。

公司如何在工作中使用人工智能

在从医疗和金融到出版、时尚和游戏工作室等各个行业,企业正把生成式人工智能和大型语言模型融入日常运营。这些工具有助于回答客户问题、起草文件、支持医生与科学家、标记欺诈、翻译内容和设计产品。作者表明,尽管许多组织对速度和效率的提升感到兴奋,但只有少数企业有超出试验和试点的正式政策。论文引用的调查显示,许多员工已经在工作中使用人工智能,往往未经许可,有时把人工智能生成的材料冒充为自己创作。快速使用与缓慢治理之间的这种差距是研究探讨的核心张力。

研究者做了什么

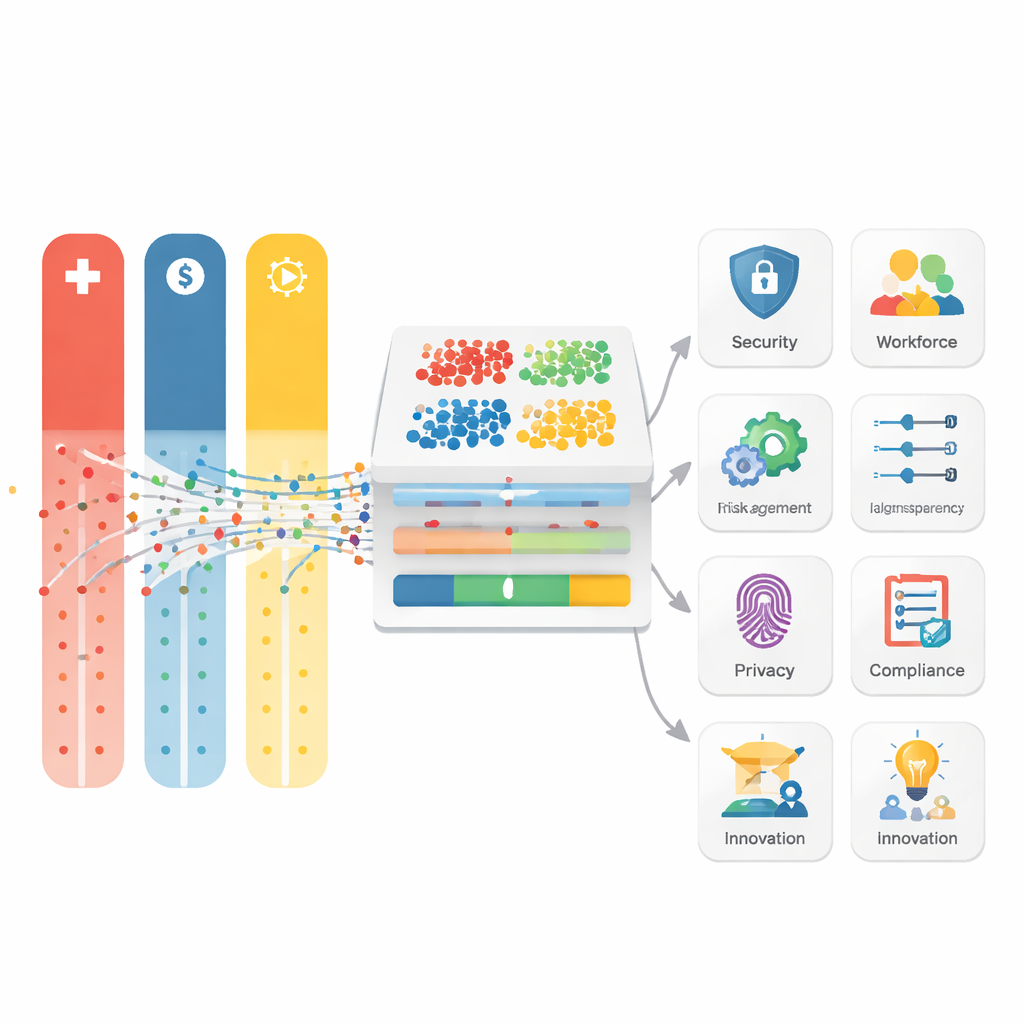

作者没有直接研究技术本身,而是审查了来自全球14个行业大型公司的160份公开指南和政策声明。他们将这些文件视为数据,使用文本挖掘技术查看哪些观点和关切最常出现,以及这些模式如何因行业和地区而异。通过将政策分解为成千上万的词语和短语,然后应用 TF–IDF(一种识别异常重要术语的方法)和 K-Means 聚类(一种对相似文本分组的方法),他们发现了主导企业思维的八大主题:数据与隐私、安全与人为监督、安保与滥用、知识产权与内容完整性、透明度与可解释性、风险与合规、劳动力与变革管理,以及通过受控试验或“沙盒”推动的创新。

为不同风险制定不同规则

研究发现,各行业对人工智能的处理方式并不相同,因为它们的主要担忧各异。医疗和制药关注同意、患者安全以及工具全生命周期的可追溯性,反映出对身体伤害的担忧。银行与金融机构强调模型风险、审计与董事会层面的责任,担心不良的人工智能决策会在经济中传播损失。出版与媒体机构聚焦知识产权、作者身份以及在使用人工智能创作文章或图像时的明确披露。社交媒体和电信公司在巨大的规模下与隐私和用户信任问题博弈,而设计、时尚与娱乐等创意领域则强调“人工智能作为助手”,坚持人工审查以防止自动化削弱原创性或品牌识别。作者认为这些差异是合理的——但它们也形成了可能令公众和监管者困惑的拼接式格局。

文本挖掘揭示了什么

通过量化哪些词语常常一起出现,作者展示了一些观念被高度重视,而另一些则出乎意料地被忽视。“隐私”和“完整性”在各行业中频繁出现,尤其在法律和制药文献中,表明对数据处理和伦理行为的强烈关注。与金融相关的文本对预测分析和市场给予很大权重,凸显了它们在严格控制下对数据驱动决策的需求。然而,与开放性和用户赋权相关的术语——如披露、以人为本的设计、民主化、怀疑主义和错误信息——却较为少见,即便在新闻和社交媒体政策中也是如此。这表明公司更愿意承诺保护数据,而不是承诺解释系统如何工作或与用户分享权力。

迈向更聪明、更公平的人工智能规则

综合这些发现,作者建议采用“模块化”人工智能治理方法。他们主张每个行业应共享一个共同的基线:从一开始就在人工智能系统中构建隐私、公平、透明度和持续监控。在此基础上,各部门可以添加自己的风险模块——例如对医疗人工智能进行严格的安全试验、对银行工具进行压力测试、为创意工作制定清晰的标签与知识产权规则,以及为新闻和社交平台建立强有力的错误信息防护措施。他们还呼吁建立实时测试环境(沙盒)、人工智能辅助审计以及在早期就让最终用户和伦理学家参与的参与式设计。对普通读者而言,关键的信息是:良好的人工智能政策不仅仅是为了阻止不良后果;它还旨在塑造这些强大工具,使其真正服务于人的需求、广泛分享收益,并在日常生活中传播时保持可理解性和问责性。

引用: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

关键词: 生成式人工智能治理, 行业人工智能政策, 人工智能伦理, 大型语言模型, 负责任的人工智能