Clear Sky Science · es

IA generativa y LLMs en la industria: un análisis de minería de texto y evaluación crítica de directrices y declaraciones de política en 14 sectores industriales

Por qué importa en la vida cotidiana

Herramientas de IA generativa como ChatGPT están irrumpiendo en oficinas, hospitales, bancos, redacciones e incluso en obras de construcción. Prometen servicios más rápidos, productos más baratos y nuevas formas de creatividad, pero también plantean preguntas difíciles sobre privacidad, seguridad y equidad. Este artículo examina en detalle cómo las grandes empresas de 14 sectores distintos están redactando realmente las reglas para estos sistemas, revelando dónde las empresas actúan con precaución, dónde asumen riesgos y qué significa eso para trabajadores, consumidores y ciudadanos.

Cómo usan las empresas la IA en el trabajo

En todos los sectores —desde la sanidad y las finanzas hasta la edición, la moda y los estudios de videojuegos— las empresas están integrando la IA generativa y los grandes modelos de lenguaje en las operaciones cotidianas. Estas herramientas ayudan a responder preguntas de clientes, redactar documentos, apoyar a médicos y científicos, detectar fraudes, traducir contenidos y diseñar productos. Los autores muestran que, aunque muchas organizaciones celebran las ganancias en velocidad y eficiencia, solo una minoría dispone de políticas formales que vayan más allá de experimentos y pilotos. Encuestas citadas en el artículo revelan que muchos empleados ya usan IA en el trabajo, a menudo sin permiso, y a veces presentan como propias obras generadas por IA. Esta brecha entre un uso rápido y una gobernanza lenta es la tensión central que investiga el estudio.

Qué hicieron los investigadores

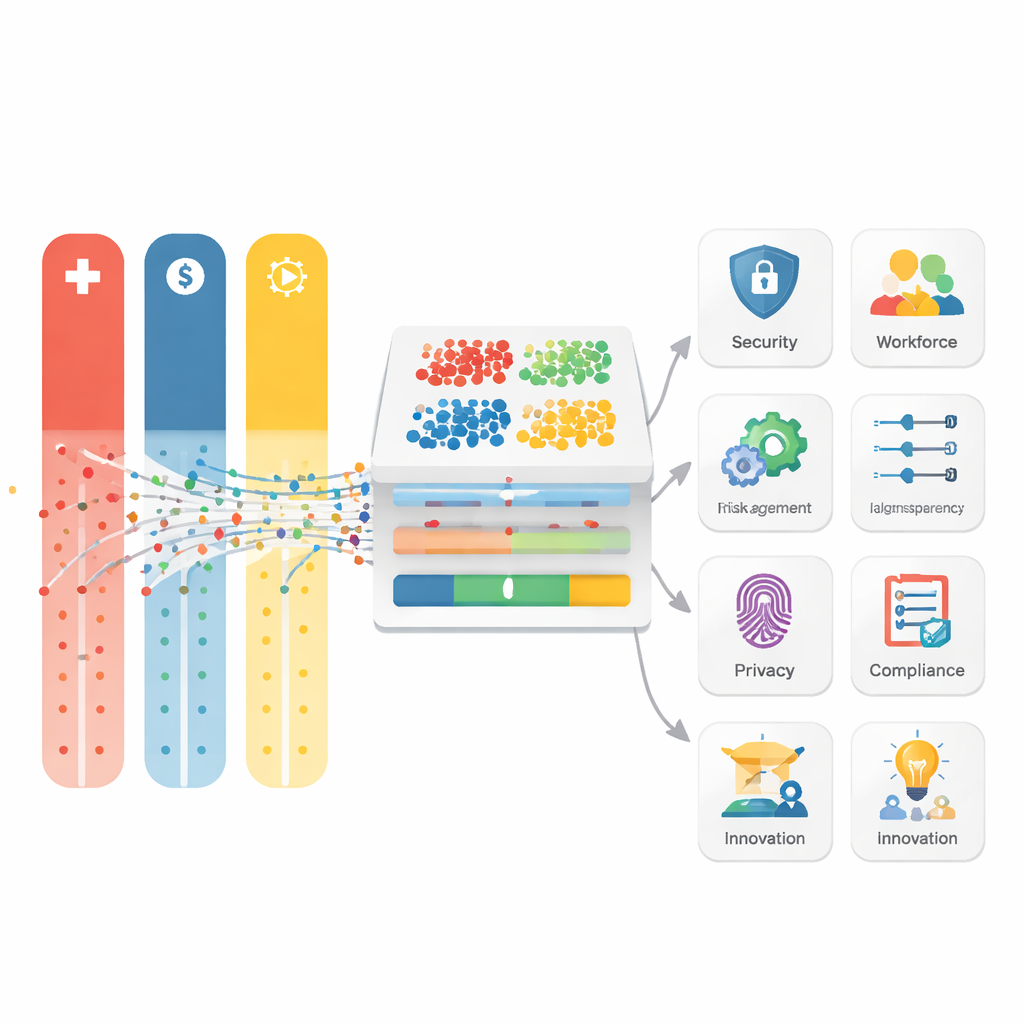

En lugar de centrarse en la tecnología en sí, los autores examinaron 160 directrices y declaraciones de política públicas de grandes empresas en 14 industrias alrededor del mundo. Trataron esos documentos como datos, empleando técnicas de minería de texto para ver qué ideas y preocupaciones aparecen con más frecuencia y cómo esos patrones varían según el sector y la región. Al descomponer las políticas en miles de palabras y frases, y aplicar TF–IDF (una forma de detectar términos inusualmente importantes) y clustering K-Means (un método para agrupar textos similares), descubrieron ocho temas principales que dominan el pensamiento corporativo: datos y privacidad, seguridad y supervisión humana, seguridad frente a usos indebidos, propiedad intelectual e integridad del contenido, transparencia y explicabilidad, riesgo y cumplimiento, gestión de la plantilla y del cambio, e innovación mediante experimentación controlada o “entornos de prueba” (sandboxes).

Diferentes reglas para distintos riesgos

El estudio concluye que los sectores no tratan la IA de la misma manera porque sus preocupaciones principales difieren. Salud y farmacéutica se centran en el consentimiento, la seguridad del paciente y la trazabilidad a lo largo del ciclo de vida de una herramienta, reflejando el temor a daños físicos. Bancos y entidades financieras insisten en el riesgo del modelo, las auditorías y la responsabilidad a nivel de consejo, preocupados por el potencial de que decisiones erróneas de la IA propaguen pérdidas en la economía. Editoriales y medios se enfocan en la propiedad intelectual, la autoría y la divulgación clara cuando se emplea IA en textos o imágenes. Las redes sociales y las empresas de telecomunicaciones lidian con la privacidad y la confianza del usuario a gran escala, mientras que campos creativos como el diseño, la moda y el entretenimiento enfatizan la IA como asistente, insistiendo en la revisión humana para que la automatización no socave la originalidad o la identidad de la marca. Los autores sostienen que estas diferencias tienen sentido, pero también generan un mosaico que puede confundir al público y a los reguladores.

Qué reveló la minería de texto

Al cuantificar qué palabras aparecen juntas, los autores muestran que algunas ideas reciben una gran protección mientras que otras obtienen sorprendentemente poca atención. “Privacidad” e “integridad” aparecen con frecuencia en varios sectores, especialmente en documentos legales y farmacéuticos, lo que sugiere una fuerte preocupación por el manejo de datos y la conducta ética. Los textos relacionados con finanzas dan mucho peso al análisis predictivo y a los mercados, subrayando su apetito por decisiones basadas en datos bajo controles estrictos. Sin embargo, términos vinculados con la apertura y el empoderamiento del usuario —como divulgación, diseño centrado en la persona, democratización, escepticismo y desinformación— son más raros, incluso en políticas de noticias y redes sociales. Esto sugiere que las empresas se sienten más cómodas prometiendo proteger datos que prometiendo explicar cómo funcionan los sistemas o compartir poder con los usuarios.

Hacia reglas de IA más inteligentes y justas

Sintetizando estos hallazgos, los autores recomiendan un enfoque “modular” para la gobernanza de la IA. Sostienen que cada industria debería compartir una línea base común: incorporar privacidad, equidad, transparencia y monitorización continua en los sistemas de IA desde el inicio. Sobre esa base, cada sector podría añadir sus propios módulos de riesgo —por ejemplo, ensayos de seguridad rigurosos para la IA médica, pruebas de resistencia para herramientas bancarias, etiquetas claras y reglas de PI para trabajos creativos, y salvaguardas robustas contra la desinformación para plataformas de noticias y sociales. También piden entornos de prueba en vivo (sandboxes), auditorías asistidas por IA y diseño participativo que involucre tempranamente a usuarios finales y ethicistas. Para un lector no especializado, el mensaje clave es que una buena política de IA no solo busca evitar resultados negativos; se trata de diseñar estas poderosas herramientas para que realmente sirvan a las necesidades humanas, compartan beneficios de forma amplia y permanezcan comprensibles y responsables a medida que se incorporan a la vida cotidiana.

Cita: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Palabras clave: gobernanza de la IA generativa, políticas de IA en la industria, ética de la IA, modelos de lenguaje grandes, IA responsable