Clear Sky Science · ru

Генеративный ИИ и большие языковые модели в промышленности: текстовый анализ и критическая оценка руководящих принципов и политических заявлений в 14 отраслях

Почему это важно для повседневной жизни

Генеративные ИИ-инструменты, такие как ChatGPT, стремительно проникают в офисы, больницы, банки, редакции и даже на строительные площадки. Они обещают более быстрое обслуживание, более дешёвые продукты и новые формы творчества — но также ставят серьёзные вопросы о конфиденциальности, безопасности и справедливости. В этой работе исследуется, как крупные компании в 14 различных отраслях формулируют правила для этих систем, выявляя, где бизнес действует осторожно, где принимает риски и что это означает для работников, потребителей и граждан.

Как компании используют ИИ на рабочем месте

Во всех секторах — от здравоохранения и финансов до издательств, моды и игровых студий — фирмы внедряют генеративный ИИ и большие языковые модели в повседневные операции. Эти инструменты помогают отвечать на вопросы клиентов, готовить документы, поддерживать врачей и учёных, выявлять мошенничество, переводить контент и разрабатывать продукты. Авторы показывают, что хотя многие организации радуются повышению скорости и эффективности, лишь меньшинство имеет формальные политики, выходящие за рамки экспериментов и пилотов. Опросы, цитируемые в статье, показывают, что многие сотрудники уже используют ИИ на работе, часто без разрешения, а иногда выдают материалы, созданные ИИ, за свои. Этот разрыв между быстрым применением и медленным регулированием и является основным напряжением, которое изучает исследование.

Что сделали исследователи

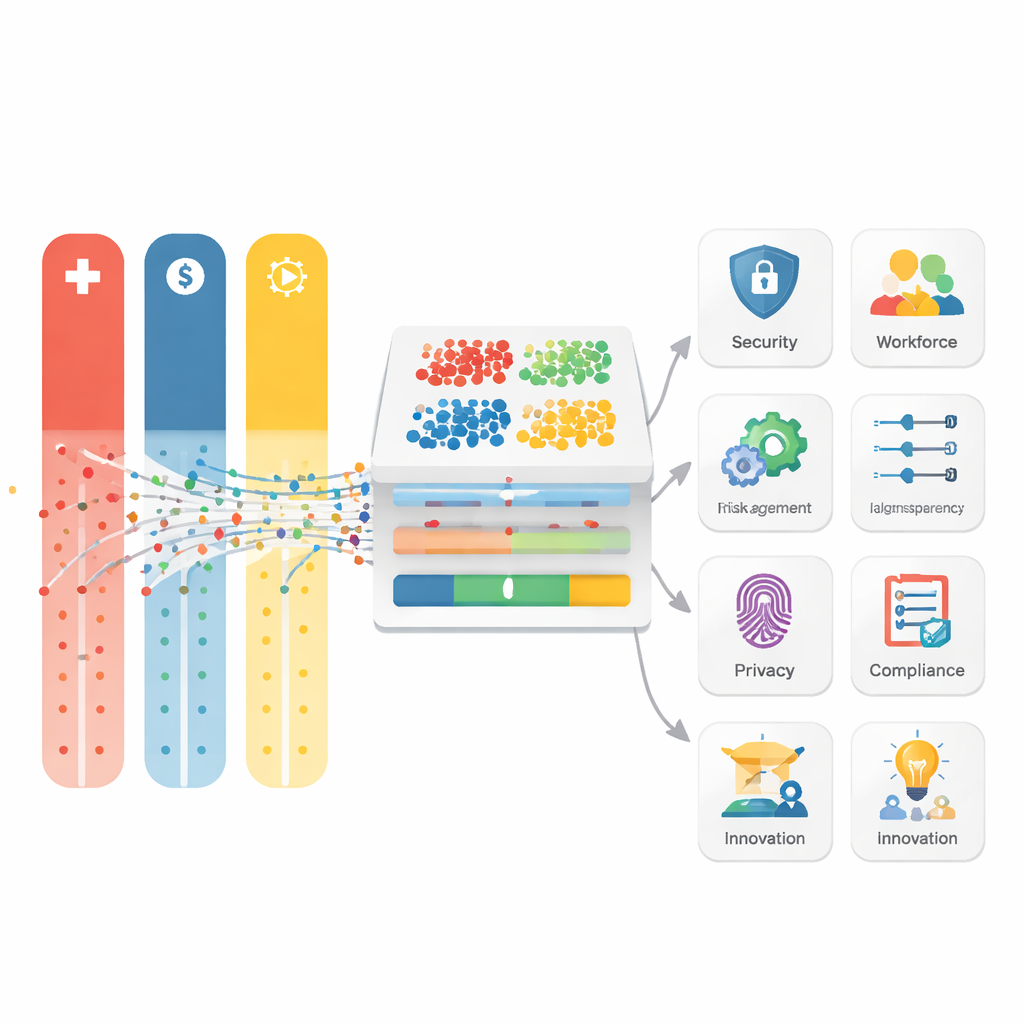

Вместо того чтобы изучать саму технологию, авторы проанализировали 160 публичных руководств и политических заявлений крупных компаний в 14 отраслях по всему миру. Они рассматривали эти документы как данные, применяя методы текстового майнинга, чтобы выяснить, какие идеи и опасения встречаются чаще всего и как эти шаблоны меняются в зависимости от сектора и региона. Разбив политики на тысячи слов и фраз, а затем применив TF–IDF (метод выявления особенно значимых терминов) и K-Means кластеризацию (метод группировки схожих текстов), они выявили восемь основных тем, доминирующих в корпоративном мышлении: данные и конфиденциальность, безопасность и человеческий надзор, безопасность и злоупотребления, интеллектуальная собственность и целостность контента, прозрачность и объяснимость, риск и соответствие требованиям, управление персоналом и изменениями, а также инновации через контролируемые эксперименты или «песочницы».

Разные правила для разных рисков

Исследование показывает, что отрасли по‑разному относятся к ИИ, потому что у них разные основные опасения. Здравоохранение и фармацевтика сосредоточены на согласии, безопасности пациентов и прослеживаемости на всех этапах жизненного цикла инструмента, отражая страхи причинения вреда человеческому здоровью. Банки и финансовые компании делают акцент на риске моделей, аудите и ответственности на уровне совета директоров, опасаясь, что ошибочные решения ИИ могут распространить убытки по экономике. Издательства и СМИ сосредоточивают внимание на интеллектуальной собственности, авторстве и ясном раскрытии факта использования ИИ в текстах или изображениях. Социальные сети и телекомы борются с проблемами конфиденциальности и доверия пользователей в огромных масштабах, тогда как креативные области — дизайн, мода и развлечения — подчёркивают роль ИИ как «ассистента», настаивая на человеческой проверке, чтобы автоматизация не подрывала оригинальность или идентичность бренда. Авторы считают, что эти различия обоснованы, но в то же время они создают разрозненную картину, которая может сбивать с толку общественность и регуляторов.

Что выявил текстовый анализ

Количественно изучив соотношение слов, авторы показывают, что некоторые идеи надёжно защищены, тогда как другим уделяется удивительно мало внимания. «Конфиденциальность» и «целостность» часто встречаются во многих секторах, особенно в юридических и фармацевтических документах, что указывает на серьёзную озабоченность обработкой данных и этическим поведением. Тексты, связанные с финансами, придают большое значение предиктивной аналитике и рынкам, подчёркивая их стремление к управлению решениями на основе данных под строгим контролем. Тем не менее термины, связанные с открытостью и расширением возможностей пользователей — такие как раскрытие информации, человеко‑ориентированный дизайн, демократизация, скептицизм и дезинформация — встречаются реже, даже в политиках новостных и социальных медиа. Это свидетельствует о том, что компании охотнее обещают защищать данные, чем объяснять работу систем или делиться властью с пользователями.

К более умным и справедливым правилам для ИИ

Суммируя эти результаты, авторы рекомендуют «модульный» подход к управлению ИИ. По их мнению, каждая отрасль должна иметь общий базовый набор требований: закладывать конфиденциальность, справедливость, прозрачность и непрерывный мониторинг в ИИ‑системы с самого начала. Поверх этого базиса каждый сектор может добавлять собственные модули риска — например, строгие испытания безопасности для медицинского ИИ, стресс‑тесты для банковских инструментов, чёткие маркировки и правила интеллектуальной собственности для творческих работ и надёжные механизмы против дезинформации для новостей и социальных платформ. Они также призывают к созданию сред для живого тестирования (песочниц), аудитов с поддержкой ИИ и участнического дизайна с вовлечением конечных пользователей и этиков на ранних этапах. Для непрофессионала главный посыл таков: хорошая политика в области ИИ — это не только предотвращение плохих последствий; это формирование этих мощных инструментов так, чтобы они действительно служили человеческим нуждам, справедливо распределяли выгоды и оставались понятными и подотчётными по мере их распространения в повседневной жизни.

Цитирование: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Ключевые слова: управление генеративным ИИ, корпоративная политика в отношении ИИ, этика ИИ, большие языковые модели, ответственный ИИ