Clear Sky Science · pl

Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors

Dlaczego to ma znaczenie dla codziennego życia

Narzędzia generatywnej sztucznej inteligencji, takie jak ChatGPT, wdzierają się do biur, szpitali, banków, redakcji, a nawet na place budowy. Obiecują szybszą obsługę, tańsze produkty i nowe rodzaje kreatywności — ale też stawiają trudne pytania o prywatność, bezpieczeństwo i sprawiedliwość. Artykuł bada, jak duże firmy z 14 różnych branż naprawdę formułują zasady dotyczące tych systemów, ujawniając, gdzie biznes zachowuje ostrożność, gdzie podejmuje ryzyko i co to oznacza dla pracowników, konsumentów i obywateli.

Jak firmy wykorzystują AI w pracy

W różnych sektorach — od opieki zdrowotnej i finansów po wydawnictwa, modę i studia gier — przedsiębiorstwa wplatają generatywną AI i duże modele językowe w codzienne operacje. Narzędzia te pomagają odpowiadać na pytania klientów, sporządzać dokumenty, wspierać lekarzy i naukowców, wykrywać oszustwa, tłumaczyć treści i projektować produkty. Autorzy wykazują, że chociaż wiele organizacji entuzjastycznie patrzy na korzyści w zakresie szybkości i efektywności, tylko mniejszość ma formalne polityki wykraczające poza eksperymenty i pilotaże. Cytowane w pracy badania pokazują, że wielu pracowników już używa AI w pracy, często bez zgody, a czasem przedstawia materiały stworzone przez AI jako własne. To rozbieżność między szybkim użytkowaniem a powolnym zarządzaniem jest zasadniczym napięciem badania.

Co zrobili badacze

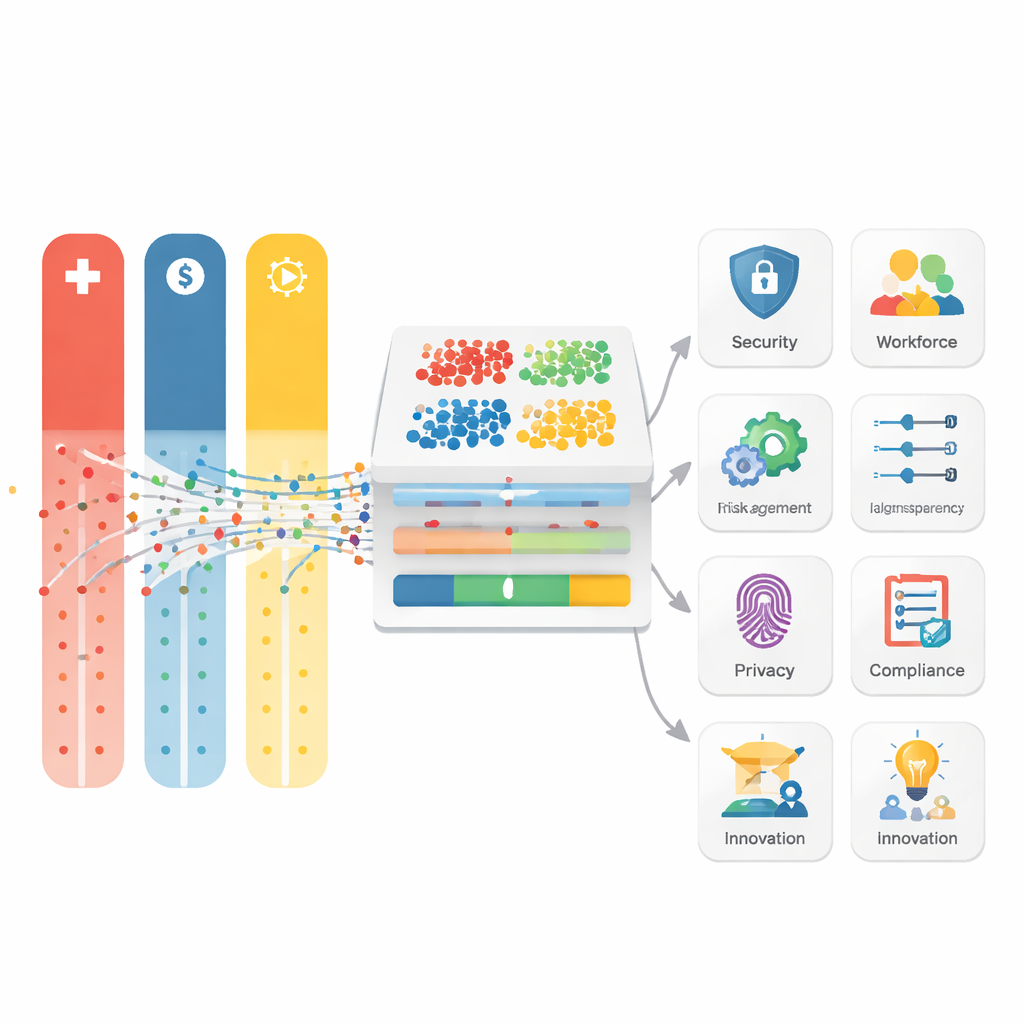

Zamiast skupiać się na technologii jako takiej, autorzy przeanalizowali 160 publicznych wytycznych i oświadczeń politycznych dużych firm z 14 branż na całym świecie. Traktowali te dokumenty jako dane, stosując techniki eksploatacji tekstu, by sprawdzić, które idee i obawy pojawiają się najczęściej oraz jak te wzorce zmieniają się w zależności od sektora i regionu. Dzieląc polityki na tysiące słów i fraz, a następnie stosując TF–IDF (metodę wykrywania nietypowo ważnych terminów) oraz grupowanie K-means (sposób grupowania podobnych tekstów), odkryli osiem głównych tematów dominujących w myśleniu korporacyjnym: dane i prywatność, bezpieczeństwo i nadzór ludzki, bezpieczeństwo i niewłaściwe użycie, własność intelektualna i integralność treści, przejrzystość i wyjaśnialność, ryzyko i zgodność, zarządzanie zasobami ludzkimi i zmianą oraz innowacje przez kontrolowane eksperymenty lub „piaskownice”.

Różne zasady dla różnych ryzyk

Badanie wykazuje, że branże nie traktują AI jednakowo, ponieważ ich główne obawy są różne. Opieka zdrowotna i farmacja koncentrują się na zgodzie, bezpieczeństwie pacjenta i śledzalności w całym cyklu życia narzędzia, co odzwierciedla obawy o szkody dla zdrowia. Banki i instytucje finansowe kładą nacisk na ryzyko modeli, audyty i odpowiedzialność na poziomie zarządu, obawiając się, że złe decyzje AI mogą rozprzestrzenić straty w gospodarce. Wydawnictwa i media skupiają się na własności intelektualnej, autorstwie i wyraźnym ujawnianiu informacji, gdy AI jest używana do tworzenia tekstów lub obrazów. Firmy z sektora mediów społecznościowych i telekomunikacji borykają się z prywatnością i zaufaniem użytkowników na ogromną skalę, podczas gdy dziedziny kreatywne, takie jak design, moda i rozrywka, podkreślają „AI jako asystent”, wymagając przeglądu ludzkiego, by automatyzacja nie podważała oryginalności ani tożsamości marki. Autorzy twierdzą, że te różnice są sensowne — ale jednocześnie tworzą mozaikę, która może mylić opinię publiczną i regulatorów.

Co ujawniła analiza tekstu

Poprzez ilościowe określenie, które słowa występują razem, autorzy pokazują, że niektóre idee są mocno chronione, podczas gdy inne otrzymują zaskakująco mało uwagi. „Prywatność” i „integralność” pojawiają się często w wielu sektorach, szczególnie w dokumentach prawnych i farmaceutycznych, co sugeruje silne zaniepokojenie przetwarzaniem danych i etycznym postępowaniem. Teksty związane z finansami mocno akcentują analitykę predykcyjną i rynki, podkreślając ich skłonność do podejmowania decyzji opartych na danych pod ścisłą kontrolą. Z kolei pojęcia związane z otwartością i upodmiotowieniem użytkownika — takie jak ujawnianie, projektowanie zorientowane na człowieka, demokratyzacja, sceptycyzm i dezinformacja — są rzadsze, nawet w politykach mediów informacyjnych i społecznościowych. Sugeruje to, że firmy chętniej obiecują chronić dane niż wyjaśniać, jak działają systemy, albo dzielić się władzą z użytkownikami.

W kierunku mądrzejszych, sprawiedliwszych zasad AI

Syntetyzując ustalenia, autorzy rekomendują podejście „modularne” do zarządzania AI. Każda branża, ich zdaniem, powinna dzielić wspólną bazę: wbudować prywatność, sprawiedliwość, przejrzystość i ciągły monitoring w systemy AI od samego początku. Na to powinny nakładać się moduły ryzyka specyficzne dla danego sektora — na przykład rygorystyczne próby bezpieczeństwa dla AI medycznej, testy obciążeniowe dla narzędzi bankowych, wyraźne etykiety i zasady własności intelektualnej dla pracy twórczej oraz solidne zabezpieczenia przeciw dezinformacji dla wiadomości i platform społecznościowych. Postulują także środowiska testowe na żywo (piaskownice), audyty wspomagane przez AI i partycypacyjne projektowanie z udziałem użytkowników końcowych oraz etyków już we wczesnych fazach. Dla laika kluczowy komunikat jest taki: dobra polityka AI to nie tylko zapobieganie złym skutkom; chodzi o kształtowanie tych potężnych narzędzi tak, by rzeczywiście służyły ludzkim potrzebom, szeroko dzieliły korzyści oraz pozostawały zrozumiałe i rozliczalne, gdy przenikają do codziennego życia.

Cytowanie: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Słowa kluczowe: generative AI governance, industry AI policies, AI ethics, large language models, responsible AI