Clear Sky Science · de

Generative KI und LLMs in der Industrie: Eine Text-Mining-Analyse und kritische Bewertung von Richtlinien und Stellungnahmen in 14 Branchen

Warum das für den Alltag wichtig ist

Generative KI-Werkzeuge wie ChatGPT dringen in Büros, Krankenhäuser, Banken, Redaktionen und sogar auf Baustellen vor. Sie versprechen schnelleren Service, günstigere Produkte und neue Formen von Kreativität – werfen aber auch schwierige Fragen zu Datenschutz, Sicherheit und Fairness auf. Diese Arbeit schaut unter die Haube, wie große Unternehmen in 14 verschiedenen Branchen tatsächlich die Regeln für diese Systeme formulieren, zeigt, wo Unternehmen vorsichtig vorgehen, wo sie Risiken eingehen, und welche Folgen das für Beschäftigte, Konsumenten und Bürger hat.

Wie Unternehmen KI am Arbeitsplatz einsetzen

Über Branchen hinweg – von Gesundheitswesen und Finanzsektor bis zu Verlagen, Mode und Spieleentwicklern – integrieren Firmen generative KI und große Sprachmodelle in den Alltag. Diese Werkzeuge helfen, Kundenfragen zu beantworten, Dokumente zu entwerfen, Ärztinnen und Wissenschaftler zu unterstützen, Betrug zu erkennen, Inhalte zu übersetzen und Produkte zu entwerfen. Die Autorinnen und Autoren zeigen, dass viele Organisationen zwar von Geschwindigkeits- und Effizienzgewinnen begeistert sind, nur eine Minderheit jedoch formelle Richtlinien hat, die über Experimente und Pilotprojekte hinausgehen. In der Studie zitierte Umfragen weisen darauf hin, dass viele Mitarbeitende KI bereits am Arbeitsplatz nutzen, oft ohne Erlaubnis, und manchmal KI-erstellte Inhalte als eigene ausgeben. Diese Lücke zwischen schneller Nutzung und langsamer Governance ist die zentrale Spannung, die die Studie untersucht.

Was die Forschenden getan haben

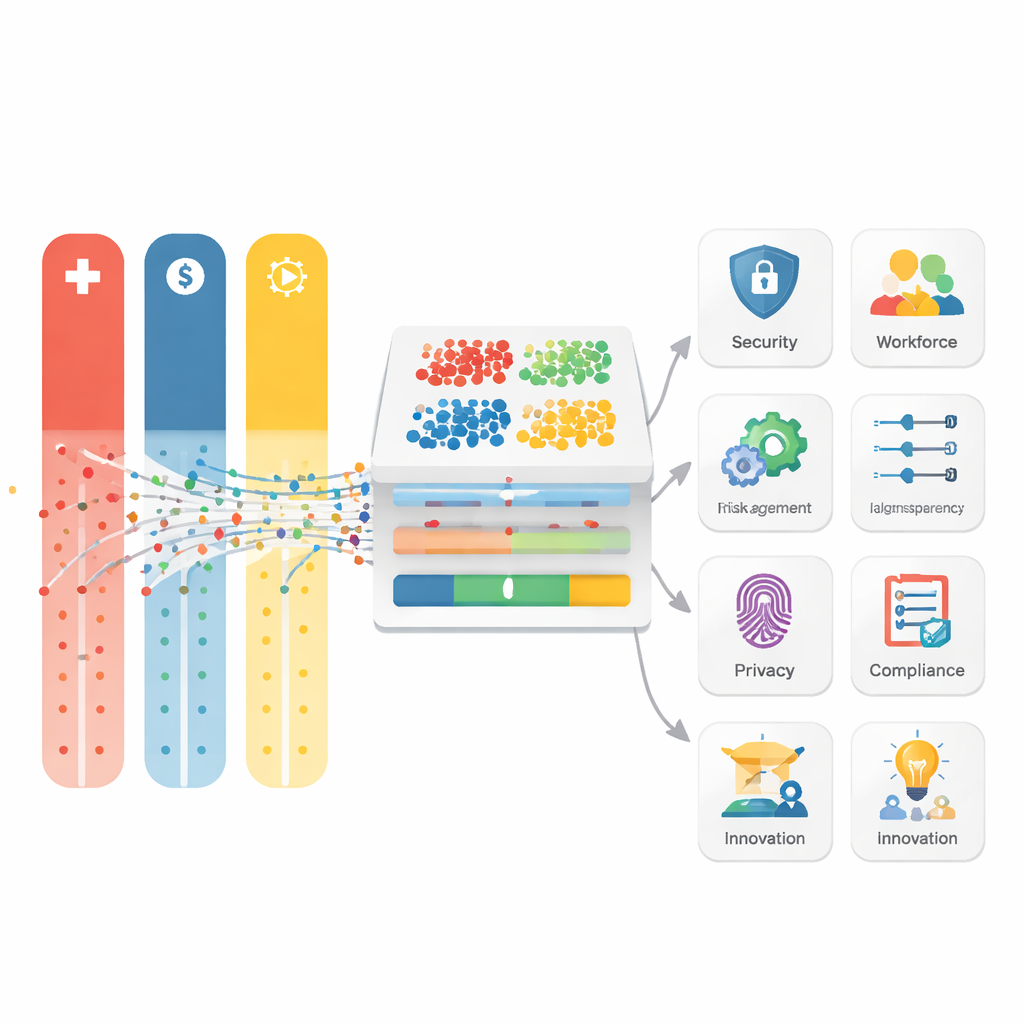

Anstatt die Technologie selbst zu untersuchen, haben die Autorinnen und Autoren 160 öffentliche Leitlinien und Stellungnahmen großer Unternehmen aus 14 Branchen weltweit analysiert. Sie behandelten diese Dokumente als Daten und nutzten Text-Mining-Techniken, um zu erkennen, welche Ideen und Anliegen am häufigsten vorkommen und wie sich diese Muster nach Sektor und Region unterscheiden. Indem sie Richtlinien in tausende Wörter und Phrasen zerlegten und dann TF–IDF (ein Verfahren zur Identifizierung besonders wichtiger Begriffe) sowie K-Means-Clustering (ein Verfahren zur Gruppierung ähnlicher Texte) anwandten, fanden sie acht Hauptthemen, die das unternehmerische Denken dominieren: Daten und Datenschutz, Sicherheit und menschliche Aufsicht, Sicherheit und Missbrauch, geistiges Eigentum und Inhaltsintegrität, Transparenz und Erklärbarkeit, Risiko und Compliance, Arbeitskräfte und Change Management sowie Innovation durch kontrollierte Experimente oder „Sandboxes“.

Unterschiedliche Regeln für unterschiedliche Risiken

Die Studie kommt zu dem Ergebnis, dass Branchen KI nicht gleich behandeln, weil ihre Hauptsorgen unterschiedlich sind. Gesundheitswesen und Pharma konzentrieren sich auf Einwilligung, Patientensicherheit und Rückverfolgbarkeit über den gesamten Lebenszyklus eines Werkzeugs hinweg – aus der Sorge vor Schäden am Körper von Menschen. Banken und Finanzunternehmen betonen Modellrisiken, Prüfungen und Verantwortung auf Vorstandsebene, da fehlerhafte KI-Entscheidungen Verluste in der Wirtschaft ausbreiten könnten. Verlage und Medienhäuser fokussieren auf geistiges Eigentum, Autorschaft und klare Kennzeichnung bei KI-gestützter Text- oder Bildproduktion. Soziale Netzwerke und Telekommunikationsunternehmen ringen mit Datenschutz und Nutzervertrauen im großen Maßstab, während kreative Bereiche wie Design, Mode und Unterhaltung „KI als Assistent“ betonen und menschliche Prüfung einfordern, damit Automatisierung Originalität oder Markenidentität nicht untergräbt. Die Autorinnen und Autoren argumentieren, dass diese Unterschiede sinnvoll sind – gleichzeitig erzeugen sie ein Flickwerk, das Öffentlichkeit und Regulierungsbehörden verwirren kann.

Was das Text-Mining offenbarte

Durch die Quantifizierung, welche Wörter zusammen auftreten, zeigen die Autorinnen und Autoren, dass manche Themen stark geschützt werden, während andere überraschend wenig Beachtung finden. „Privatsphäre“ und „Integrität“ treten branchenübergreifend häufig auf, besonders in juristischen und pharmazeutischen Dokumenten, was auf große Besorgnis über Datenverarbeitung und ethisches Verhalten hindeutet. Finanzttexte legen großen Wert auf prädiktive Analytik und Märkte und unterstreichen damit die Neigung zu datengetriebenen Entscheidungen unter strengen Kontrollen. Begriffe, die Offenheit und Nutzerermächtigung betreffen – wie Offenlegung, menschenzentriertes Design, Demokratisierung, Skepsis und Desinformation – sind hingegen seltener, selbst in Nachrichten- und Social-Media-Richtlinien. Das deutet darauf hin, dass Unternehmen eher bereit sind, den Schutz von Daten zu versprechen, als zu erklären, wie Systeme funktionieren oder Macht mit Nutzern zu teilen.

Auf dem Weg zu klügeren, gerechteren KI-Regeln

Aus den Ergebnissen leiten die Autorinnen und Autoren einen „modularen“ Ansatz für KI-Governance ab. Jede Branche sollte ihrer Ansicht nach eine gemeinsame Basis teilen: Datenschutz, Fairness, Transparenz und kontinuierliches Monitoring von Beginn an in KI-Systeme einbauen. Darauf aufbauend kann jeder Sektor eigene Risikomodule hinzufügen – zum Beispiel strenge Sicherheitstests für medizinische KI, Stresstests für Bankinstrumente, klare Kennzeichnungen und IP-Regeln für kreative Arbeit sowie robuste Schutzmechanismen gegen Desinformation für Nachrichten- und Social-Media-Plattformen. Sie fordern außerdem Live-Testumgebungen (Sandboxes), KI-gestützte Prüfungen und partizipatives Design, das Endnutzer und Ethikerinnen und Ethiker früh einbezieht. Für Laien lautet die Kernbotschaft: Gute KI-Politik geht über das Verhindern schlechter Ergebnisse hinaus; sie gestaltet diese mächtigen Werkzeuge so, dass sie den menschlichen Bedürfnissen dienen, Vorteile breit verteilen und verständlich sowie rechenschaftspflichtig bleiben, während sie in den Alltag vordringen.

Zitation: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Schlüsselwörter: Governance generativer KI, branchenbezogene KI-Politiken, KI-Ethik, große Sprachmodelle, verantwortliche KI