Clear Sky Science · he

בינה יוצרת ומודלים שפתיים גדולים בתעשייה: ניתוח כריית טקסט והערכה ביקורתית של קווים מנחים והצהרות מדיניות ב-14 מגזרי תעשייה

מדוע זה חשוב לחיי היומיום

כלי בינה יוצרת כמו ChatGPT תופסים מקום במשרדים, בתי חולים, בנקים, חדרי חדשות ואפילו באתרי בנייה. הם מציעים שירות מהיר יותר, מוצרים זולים יותר וצורות חדשות של יצירתיות — אך גם מעלים שאלות קשות לגבי פרטיות, בטיחות והגינות. מאמר זה בוחן לעומק כיצד חברות גדולות ב-14 תעשיות שונות מנסחות בפועל את הכללים לכלים אלה, חושף היכן העסקים נוקטים זהירות, היכן הם לוקחים סיכונים, ומה המשמעות של זה לעובדים, לצרכנים ולאזרחים.

כיצד חברות משתמשות ב-AI בעבודה

במגזרים שונים — מהבריאות והפיננסים ועד הוצאה לאור, אופנה וסטודיואים למשחקים — חברות משלבו בינה יוצרת ומודלים שפתיים גדולים בפעילות היומיומית. כלים אלה מסייעים במענה לפניות לקוחות, ניסוח מסמכים, תמיכה ברופאים ובמדענים, זיהוי הונאות, תרגום תוכן ועיצוב מוצרים. המחברים מציגים כי למרות שרבים מהארגונים נרגשים מהרווחים במהירות וביעילות, רק מיעוט מחזיק במדיניות פורמלית שמעבר לניסויים ופיילוטים. סקרים שמצוינים במאמר מראים שעובדים רבים כבר משתמשים ב-AI בעבודה, לעתים ללא אישור, ולפעמים מציגים חומר שנכתב על ידי AI כאילו נכתב על ידם. הפער בין שימוש מהיר לממשל איטי הוא המתח המרכזי שהמחקר חוקר.

מה עשו החוקרים

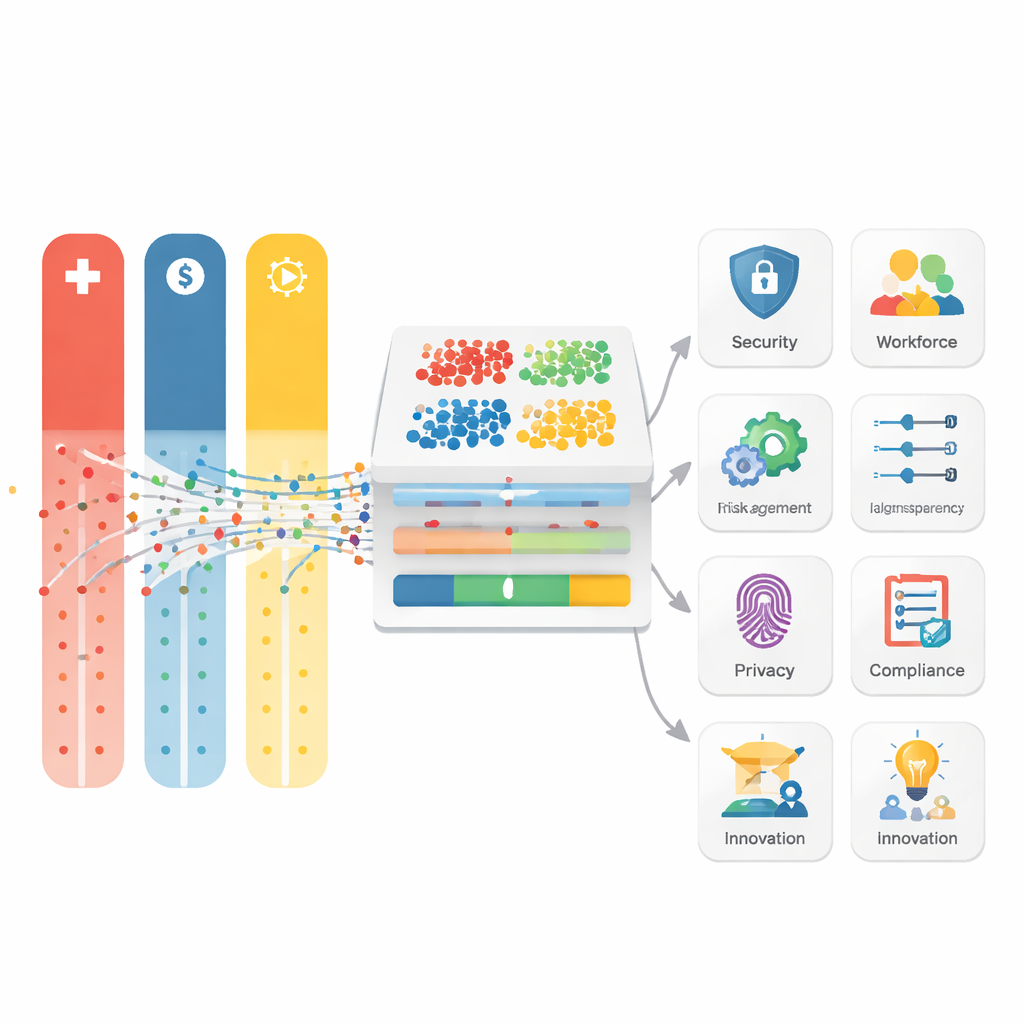

במקום לבחון את הטכנולוגיה עצמה, החוקרים ניתחו 160 קווים מנחים והצהרות מדיניות פומביות של חברות גדולות ב-14 תעשיות ברחבי העולם. הם התייחסו למסמכים אלה כאל נתונים, והשתמשו בטכניקות כריית טקסט כדי לזהות אילו רעיונות ודאגות מופיעים בתדירות הגבוהה ביותר וכיצד דפוסים אלה משתנים לפי מגזר ואזור. באמצעות פרוק המדיניות לאלפי מילים וביטויים, ולאחר יישום TF–IDF (שיטה לזיהוי מונחים בעלי חשיבות חריגה) ואשכולות K-Means (שיטה לקיבוץ טקסטים דומים), הם גילו שמונה נושאים עיקריים ששולטים בחשיבה התאגידית: נתונים ופרטיות, בטיחות ופיקוח אנושי, אבטחה ושימוש לרעה, קניין רוחני ושלמות התוכן, שקיפות והסבר, סיכון וציות, כוח עבודה וניהול שינוי, וחדשנות דרך ניסויים מבוקרים או "ארגזי חול".

כללים שונים לסיכונים שונים

המחקר מראה שהתעשיות אינן מטפלות בבינה מלאכותית באותו אופן, מכיוון שדאגותיהן העיקריות שונות. בריאות ופרמצבטיקה מתמקדות בהסכמה, בטיחות המטופל ויכולת מעקב לאורך כל מחזור החיים של המערכת, ההשתקפות מפחדים מפגיעה בגוף האדם. בנקים וחברות פיננסיות מדגישים סיכון למודל, ביקורת ואחריות ברמת הדירקטוריון, מתוך חשש שהחלטות AI שגויות עלולות להפיץ הפסדים בכלכלה. הוצאות לאור ובתי מדיה מתמקדות בקניין רוחני, מחבריות וודאיות גילוי כאשר נעשה שימוש ב-AI בכתיבה או בתמונות. חברות מדיה חברתית וטלקום נאבקות בפרטיות ובאמון משתמשים בקנה מידה עצום, בעוד שתחומי היצירה כמו עיצוב, אופנה ובידור מדגישים "AI ככלי עזר", ודורשים בחינה אנושית כדי שהאוטומציה לא תפגע במקוריות או בזהות המותג. המחברים טוענים שההבדלים האלה סבירים — אך הם גם יוצרים רצף פיצולים שעשוי לבלבל את הציבור והרגולטורים.

מה חשף כריית הטקסט

על ידי כימות אילו מילים מופיעות יחד, המחברים מראים שחלק מהרעיונות מוגנים מאוד בעוד שאחרים זוכים לתשומת לב מועטה מפתיעה. "פרטיות" ו"שלמות" מופיעות בתדירות גבוהה במגזרים שונים, במיוחד במסמכים משפטיים ופארמאцевטיים, מה שמעיד על דאגה חזקה לניהול נתונים ולתנהלות אתית. טקסטים הקשורים לפיננסים נותנים משקל כבד לאנליטיקה חזויה ולשווקים, ומדגישים את התיאבון להחלטות מונחות נתונים תחת בקרה הדוקה. עם זאת, מונחים הקשורים לשקיפות והעצמת משתמש — כמו גילוי, עיצוב ממוקד-אדם, דמוקרטיזציה, סקפטיות ומידע מטעה — נדירים יותר, אפילו במדיניות חדשות ומדיה חברתית. משמעות הדבר היא שחברות נוחות יותר להתחייב להגן על נתונים מאשר להתחייב להסביר כיצד המערכות עובדות או לחלוק כוח עם המשתמשים.

לקראת כללי AI חכמים והוגנים יותר

בסיכום הממצאים, המחברים ממליצים על גישה "מודולרית" לממשל בינה מלאכותית. כל תעשייה, הם טוענים, צריכה לחלוק בסיס משותף: לשלב פרטיות, הגינות, שקיפות וניטור מתמשך במערכות ה-AI כבר מההתחלה. בנוסף לכך, כל מגזר יכול להוסיף מודולי סיכון משלו — למשל ניסויי בטיחות חזקים ל-AI רפואי, מבחני עומס לכלי בנקאות, תוויות ברורות וכללי קניין רוחני לעבודה יצירתית, ואם-הגנות חזקות מפני מידע מטעה לחדשות ולפלטפורמות חברתיות. הם גם קוראים לסביבות בדיקה חיות (ארגזי חול), ביקורות בסיוע AI ועיצוב משתתף הכולל משתמשי קצה ואתיוקים כבר בשלבים המוקדמים. עבור הקורא הלא מומחה, המסר המרכזי הוא שמדיניות AI טובה אינה רק מניעת תוצאות רעות; היא עיצוב הכלים העוצמתיים האלה כך שיישרו באמת לצרכי האדם, יחלקו את היתרונות באופן רחב ויישארו מובנים ואחראים ככל שהם מתפשטים בחיי היומיום.

ציטוט: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

מילות מפתח: ממשל בינה יוצרת, מדיניות AI בתעשייה, אתיקה של בינה מלאכותית, מודלים שפתיים גדולים, אחריות ב-AI