Clear Sky Science · fr

L’IA générative et les LLM en entreprise : une analyse textuelle et une évaluation critique des lignes directrices et déclarations de politique dans 14 secteurs industriels

Pourquoi cela compte pour la vie quotidienne

Des outils d’IA générative comme ChatGPT investissent à grande vitesse les bureaux, hôpitaux, banques, salles de rédaction et même les chantiers. Ils promettent un service plus rapide, des produits moins coûteux et de nouvelles formes de créativité — mais soulèvent aussi des questions difficiles sur la vie privée, la sécurité et l’équité. Cet article examine en profondeur la façon dont de grandes entreprises de 14 secteurs différents rédigent réellement les règles pour ces systèmes, révélant où les entreprises se montrent prudentes, où elles prennent des risques, et ce que cela implique pour les travailleurs, les consommateurs et les citoyens.

Comment les entreprises utilisent l’IA au travail

Dans tous les secteurs — de la santé et la finance à l’édition, la mode et les studios de jeu — les entreprises intègrent l’IA générative et les grands modèles de langage dans les opérations quotidiennes. Ces outils aident à répondre aux questions des clients, rédiger des documents, assister médecins et chercheurs, détecter la fraude, traduire des contenus et concevoir des produits. Les auteurs montrent que, si de nombreuses organisations se réjouissent des gains de vitesse et d’efficacité, seule une minorité disposent de politiques formelles allant au‑delà des expérimentations et pilotes. Des enquêtes citées dans l’article révèlent que beaucoup d’employés utilisent déjà l’IA au travail, souvent sans autorisation, et parfois présentent des contenus rédigés par l’IA comme leur propre production. Ce fossé entre une utilisation rapide et une gouvernance lente constitue la tension centrale étudiée.

Ce que les chercheurs ont fait

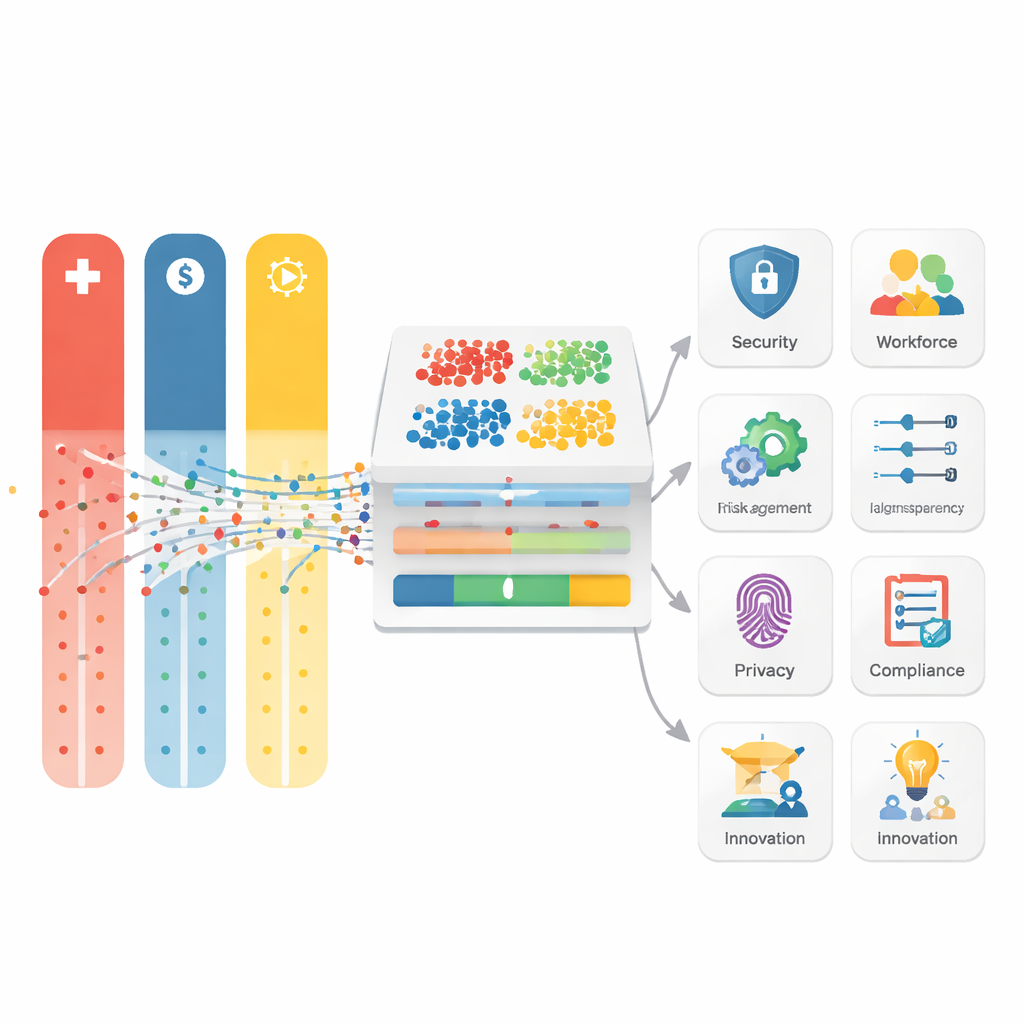

Plutôt que d’examiner la technologie elle‑même, les auteurs ont étudié 160 lignes directrices et déclarations de politique publiques émises par de grandes entreprises dans 14 industries à travers le monde. Ils ont traité ces documents comme des données, utilisant des techniques d’exploration de textes pour repérer les idées et préoccupations les plus récurrentes, et analyser comment ces schémas varient selon le secteur et la région. En décomposant les politiques en milliers de mots et expressions, puis en appliquant le TF–IDF (une méthode pour détecter les termes particulièrement importants) et le K‑Means (une méthode de regroupement de textes similaires), ils ont mis en évidence huit thèmes principaux qui dominent la réflexion des entreprises : données et vie privée, sécurité et supervision humaine, sécurité et mauvaise utilisation, propriété intellectuelle et intégrité du contenu, transparence et explicabilité, risques et conformité, gestion des effectifs et du changement, et innovation par expérimentation contrôlée ou « sandboxes ».

Des règles différentes selon les risques

L’étude montre que les industries ne traitent pas l’IA de la même manière, parce que leurs préoccupations principales diffèrent. La santé et l’industrie pharmaceutique mettent l’accent sur le consentement, la sécurité des patients et la traçabilité tout au long du cycle de vie d’un outil, reflétant la crainte de préjudices corporels. Les banques et établissements financiers insistent sur le risque lié aux modèles, les audits et la responsabilité au niveau du conseil d’administration, craignant que de mauvaises décisions algorithmiques ne propagent des pertes dans l’économie. Les éditeurs et médias se concentrent sur la propriété intellectuelle, l’auteur et la divulgation claire lorsque l’IA est utilisée pour écrire ou produire des images. Les entreprises de médias sociaux et de télécommunications luttent avec la vie privée et la confiance des utilisateurs à très grande échelle, tandis que les secteurs créatifs comme le design, la mode et le divertissement mettent en avant l’« IA en tant qu’assistant », exigeant une revue humaine pour que l’automatisation ne compromette pas l’originalité ou l’identité de la marque. Les auteurs soutiennent que ces différences sont sensées — mais qu’elles créent aussi un patchwork susceptible de semer la confusion parmi le public et les régulateurs.

Ce que la fouille de texte a révélé

En quantifiant les mots qui apparaissent ensemble, les auteurs montrent que certaines idées sont fortement protégées tandis que d’autres reçoivent étonnamment peu d’attention. « Vie privée » et « intégrité » apparaissent fréquemment dans de nombreux secteurs, en particulier dans les documents juridiques et pharmaceutiques, ce qui suggère une forte préoccupation pour la gestion des données et la conduite éthique. Les textes liés à la finance accordent un poids important à l’analyse prédictive et aux marchés, soulignant leur appétit pour des décisions fondées sur les données sous contrôles stricts. Pourtant, les termes liés à l’ouverture et à l’autonomisation des utilisateurs — comme divulgation, conception centrée sur l’humain, démocratisation, scepticisme et désinformation — sont plus rares, même dans les politiques des médias et des réseaux sociaux. Cela suggère que les entreprises sont plus enclines à promettre la protection des données qu’à promettre d’expliquer le fonctionnement des systèmes ou de partager le pouvoir avec les utilisateurs.

Vers des règles d’IA plus intelligentes et plus justes

En rassemblant ces résultats, les auteurs recommandent une approche « modulaire » de la gouvernance de l’IA. Chaque industrie, estiment‑ils, devrait partager un socle commun : intégrer dès le départ la vie privée, l’équité, la transparence et une surveillance continue dans les systèmes d’IA. Par dessus cela, chaque secteur peut ajouter ses propres modules de risque — par exemple, des essais de sécurité rigoureux pour l’IA médicale, des tests de résistance pour les outils bancaires, des étiquettes claires et des règles de PI pour le travail créatif, et des garde‑fous robustes contre la désinformation pour les médias d’information et les plateformes sociales. Ils préconisent également des environnements de test en direct (sandboxes), des audits assistés par l’IA et une conception participative impliquant utilisateurs finaux et chercheurs en éthique dès le début. Pour le grand public, le message clé est que bonne politique d’IA ne consiste pas seulement à empêcher de mauvais résultats ; il s’agit de façonner ces outils puissants pour qu’ils servent réellement les besoins humains, partagent largement les bénéfices et restent compréhensibles et responsables à mesure qu’ils se diffusent dans la vie quotidienne.

Citation: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Mots-clés: gouvernance de l’IA générative, politiques d’IA en entreprise, éthique de l’IA, grands modèles de langage, IA responsable