Clear Sky Science · ar

الذكاء التوليدي ونماذج اللغة الكبيرة في الصناعة: تحليل تنقيب نصي وتقييم نقدي للإرشادات والبيانات السياسية عبر 14 قطاعًا صناعيًا

لماذا يهم هذا في الحياة اليومية

تندفع أدوات الذكاء التوليدي مثل ChatGPT إلى المكاتب والمستشفيات والبنوك وغرف الأخبار وحتى مواقع البناء. تعد بخدمات أسرع ومنتجات أرخص وأنواع جديدة من الإبداع — لكنها تثير أيضًا أسئلة صعبة حول الخصوصية والسلامة والعدالة. تبحث هذه الورقة في كيفية صياغة الشركات الكبرى في 14 صناعة مختلفة للقواعد الخاصة بهذه الأنظمة، كاشفة أين تكون الشركات حذرة، وأين تخاطر، وماذا يعني ذلك للعمال والمستهلكين والمواطنين.

كيف تستخدم الشركات الذكاء الاصطناعي في العمل

عبر القطاعات — من الرعاية الصحية والتمويل إلى النشر والأزياء واستوديوهات الألعاب — تدمج الشركات الذكاء التوليدي ونماذج اللغة الكبيرة في العمليات اليومية. تساعد هذه الأدوات في الإجابة على أسئلة العملاء، وصياغة المستندات، ودعم الأطباء والعلماء، وكشف الاحتيال، وترجمة المحتوى، وتصميم المنتجات. يبيّن المؤلفون أنه بينما تتطلع كثير من المؤسسات إلى المكتسبات في السرعة والكفاءة، فإن أقلية فقط لديها سياسات رسمية تتعدى التجارب والمشروعات التجريبية. تكشف الاستطلاعات المذكورة في الورقة أن العديد من الموظفين يستخدمون الذكاء الاصطناعي بالفعل في العمل، غالبًا دون إذن، وأحيانًا يقدّمون مواد مكتوبة بواسطة الذكاء الاصطناعي على أنها أعمالهم. هذه الفجوة بين الاستخدام السريع والحوكمة البطيئة هي التوتر الأساسي الذي تبحثه الدراسة.

ما الذي فعله الباحثون

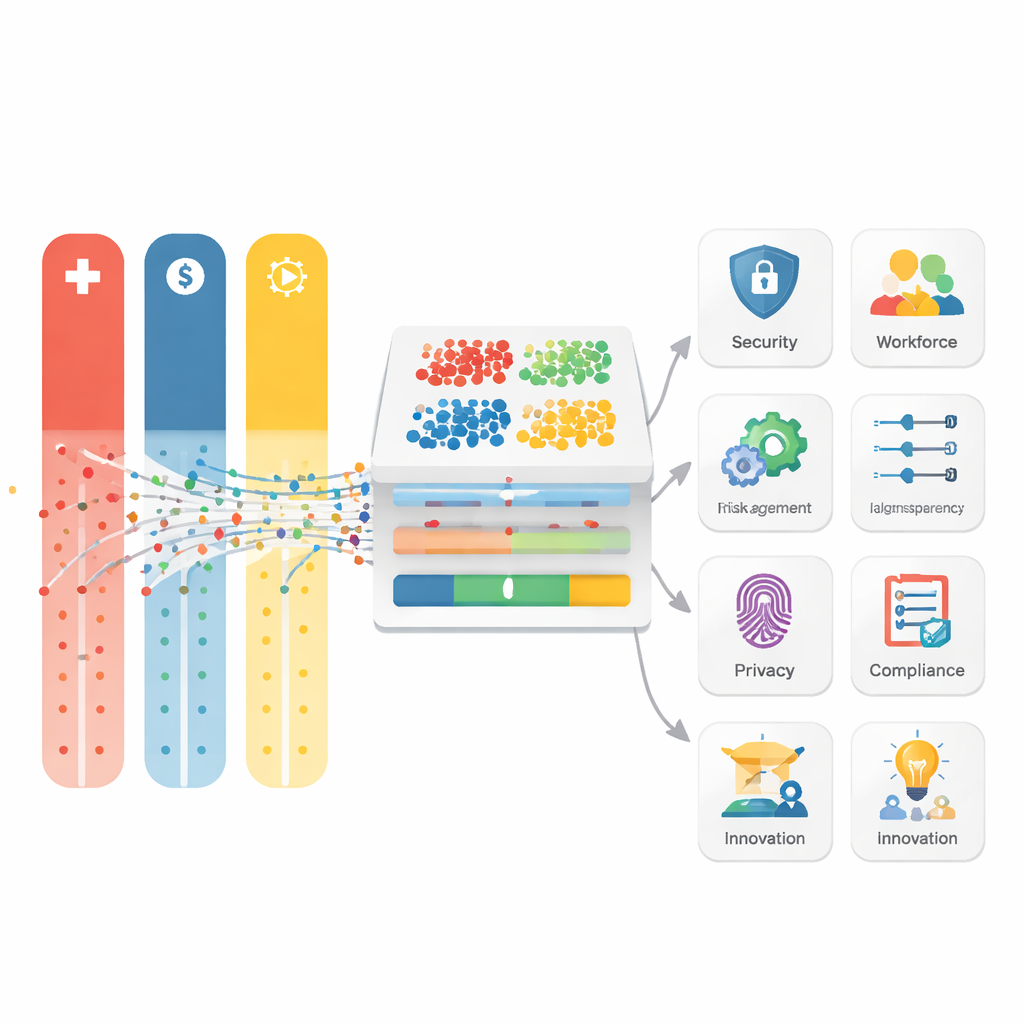

بدلاً من النظر إلى التكنولوجيا نفسها، فحص المؤلفون 160 إرشادًا عامًا وبيان سياسة منشورًا من شركات كبيرة في 14 صناعة حول العالم. عاملوا هذه الوثائق كبيانات، مستخدمين تقنيات تنقيب النصوص لمعرفة أي الأفكار والمخاوف تظهر بشكل متكرر، وكيف تتغير هذه الأنماط حسب القطاع والمنطقة. من خلال تقسيم السياسات إلى آلاف الكلمات والعبارات، ثم تطبيق TF–IDF (طريقة لاكتشاف المصطلحات ذات الأهمية غير العادية) وتقنية K-Means للتجميع (طريقة لضم النصوص المتشابهة)، كشفوا عن ثمانية مواضيع رئيسية تهيمن على تفكير الشركات: البيانات والخصوصية، والسلامة والإشراف البشري، والأمن وإساءة الاستخدام، والملكية الفكرية وسلامة المحتوى، والشفافية والقابلية للتفسير، والمخاطر والامتثال، وإدارة القوى العاملة والتغيير، والابتكار من خلال التجريب المُتحكم فيه أو «المربعات الرملية».

قواعد مختلفة لمخاطر مختلفة

تجد الدراسة أن الصناعات لا تتعامل مع الذكاء الاصطناعي بنفس الطريقة، لأن مخاوفها الرئيسية تختلف. تركز الرعاية الصحية والصناعات الدوائية على الموافقة وسلامة المرضى وقابلية التتبع عبر دورة حياة الأداة، مما يعكس مخاوف من الأذى لجسد الإنسان. تركز البنوك والمؤسسات المالية على مخاطر النماذج والتدقيق ومسؤولية مستوى المجلس، خشية أن تتسبب قرارات سيئة للذكاء الاصطناعي في نشر الخسائر عبر الاقتصاد. يركز الناشرون وبيوت الإعلام على الملكية الفكرية والتأليف والإفصاح الواضح عند استخدام الذكاء الاصطناعي في الكتابة أو الصور. تتعامل شركات وسائل التواصل والاتصالات مع الخصوصية وثقة المستخدم على نطاق هائل، بينما تؤكد مجالات الإبداع مثل التصميم والأزياء والترفيه على «الذكاء الاصطناعي كمساعد»، مشددة على المراجعة البشرية حتى لا يقوّض التشغيل الآلي الأصالة أو هوية العلامة التجارية. يجادل المؤلفون بأن هذه الاختلافات منطقية — لكنها أيضًا تخلق رقعة قوانين قد تربك الجمهور والمنظمين.

ما كشفه تنقيب النصوص

من خلال قياس تكرار ظهور الكلمات معًا، يبيّن المؤلفون أن بعض الأفكار تُحاط بحماية كبيرة بينما تحظى أفكار أخرى باهتمام مفاجئ قليل. تظهر "الخصوصية" و"النزاهة" بشكل متكرر عبر القطاعات، خاصة في الوثائق القانونية والدوائية، مما يوحي بقلق قوي بشأن معالجة البيانات والسلوك الأخلاقي. تولي النصوص المتعلقة بالتمويل وزنًا كبيرًا للتحليلات التنبؤية والأسواق، مما يؤكد حرصها على القرارات المدفوعة بالبيانات تحت ضوابط صارمة. ومع ذلك، فإن المصطلحات المرتبطة بالانفتاح وتمكين المستخدم — مثل الإفصاح، وتصميم محوري للإنسان، والديمقراطية، والتشكيك، والمعلومات المضللة — أقل شيوعًا، حتى في سياسات الأخبار ووسائل التواصل الاجتماعي. يشير هذا إلى أن الشركات أكثر راحة في الوعد بحماية البيانات من الوعد بشرح كيفية عمل الأنظمة أو مشاركة السلطة مع المستخدمين.

نحو قواعد ذكاء اصطناعي أكثر ذكاءً وعدلاً

بناءً على هذه النتائج، يوصي المؤلفون بنهج «وحدوي» لحوكمة الذكاء الاصطناعي. يجادلون بأن على كل صناعة أن تشترك في خط أساس مشترك: تضمين الخصوصية والعدالة والشفافية والمراقبة المستمرة في أنظمة الذكاء الاصطناعي من البداية. وعلى ذلك، يمكن لكل قطاع إضافة وحدات مخاطر خاصة به — على سبيل المثال، تجارب سلامة صارمة للذكاء الاصطناعي الطبي، واختبارات إجهاد لأدوات البنوك، وملصقات واضحة وقواعد ملكية فكرية للعمل الإبداعي، ودرع قوي ضد المعلومات المضللة للأخبار والمنصات الاجتماعية. كما يدعون إلى بيئات اختبار حية (مربعات رملية)، وتدقيقات بمساعدة الذكاء الاصطناعي، وتصميم تشاركي يضم المستخدمين النهائيين والأخلاقيين في مراحل مبكرة. للغير متخصص، الرسالة الأساسية هي أن سياسة الذكاء الاصطناعي الجيدة ليست مجرد منع النتائج السيئة؛ بل هي تشكيل هذه الأدوات القوية بحيث تخدم الاحتياجات الإنسانية حقًا، وتشارك المنافع على نطاق واسع، وتظل مفهومة ومسؤولة أثناء انتشارها في الحياة اليومية.

الاستشهاد: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

الكلمات المفتاحية: حوكمة الذكاء التوليدي, سياسات الذكاء الصناعي في الصناعة, أخلاقيات الذكاء الاصطناعي, نماذج اللغة الكبيرة, الذكاء الاصطناعي المسؤول