Clear Sky Science · nl

Generatieve AI en LLM’s in de industrie: een tekstanalyse en kritische evaluatie van richtlijnen en beleidsverklaringen in 14 industriële sectoren

Waarom dit van belang is voor het dagelijks leven

Generatieve AI-tools zoals ChatGPT stromen razendsnel binnen in kantoren, ziekenhuizen, banken, redacties en zelfs bouwplaatsen. Ze beloven snellere dienstverlening, goedkopere producten en nieuwe vormen van creativiteit—maar roepen ook lastige vragen op over privacy, veiligheid en billijkheid. Dit artikel kijkt onder de motorkap van hoe grote bedrijven in 14 verschillende sectoren daadwerkelijk de regels voor deze systemen opstellen, en onthult waar bedrijven voorzichtig zijn, waar ze risico’s nemen en wat dat betekent voor werknemers, consumenten en burgers.

Hoe bedrijven AI op het werk gebruiken

In alle sectoren—van gezondheidszorg en financiën tot uitgeverijen, mode en gamestudio’s—weven bedrijven generatieve AI en grote taalmodellen in dagelijkse processen. Deze hulpmiddelen beantwoorden klantvragen, schrijven documenten, ondersteunen artsen en wetenschappers, signaleren fraude, vertalen content en ontwerpen producten. De auteurs laten zien dat veel organisaties enthousiast zijn over winst in snelheid en efficiëntie, maar dat slechts een minderheid formele beleidsregels heeft die verder gaan dan experimenten en pilots. Enquêtes in het artikel tonen aan dat veel werknemers AI al op het werk gebruiken, vaak zonder toestemming, en soms door AI-gegenereerde tekst als hun eigen werk presenteren. Deze kloof tussen snel gebruik en trage governance is de kernspanning die de studie onderzoekt.

Wat de onderzoekers deden

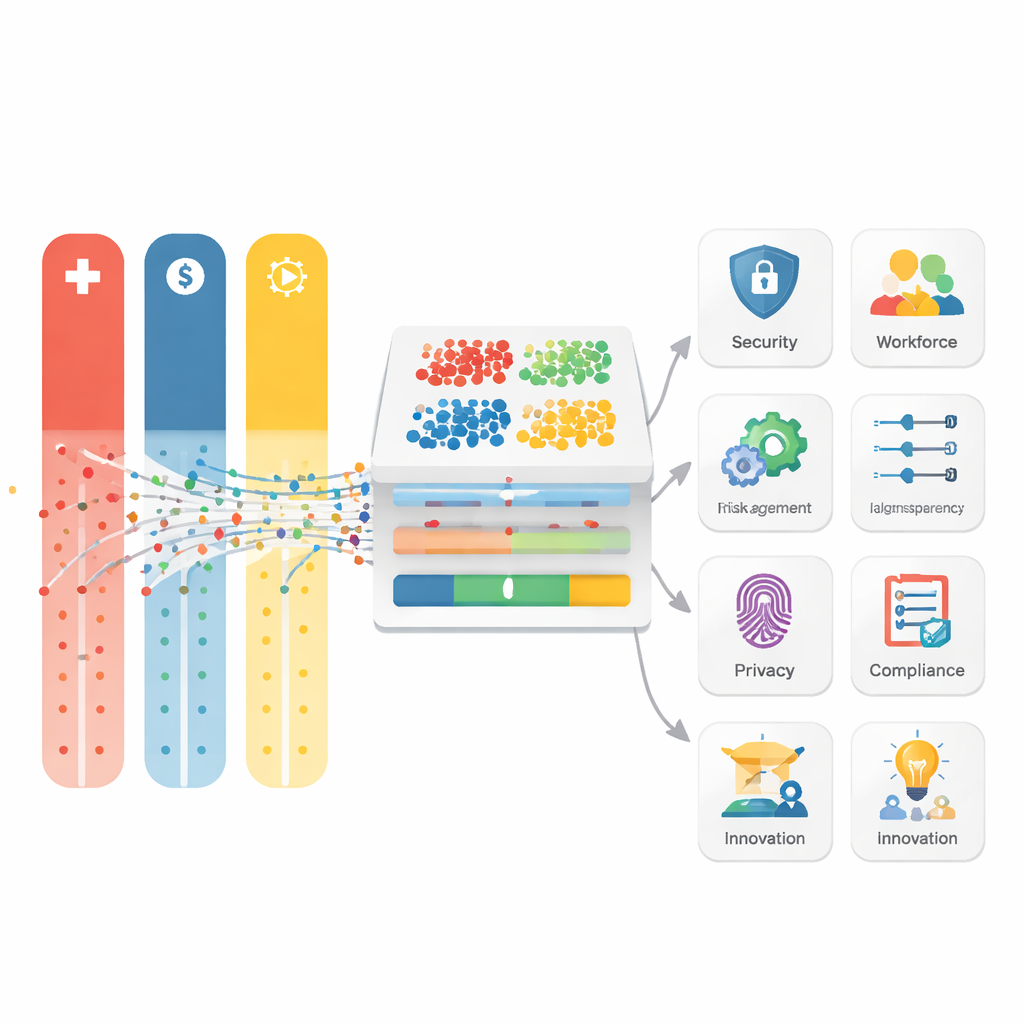

In plaats van naar de technologie zelf te kijken, onderzochten de auteurs 160 openbare richtlijnen en beleidsverklaringen van grote bedrijven in 14 sectoren wereldwijd. Ze behandelden deze documenten als data en gebruikten tekstminingtechnieken om te zien welke ideeën en zorgen het vaakst voorkomen en hoe die patronen per sector en regio variëren. Door beleidsdocumenten op te delen in duizenden woorden en zinnen en vervolgens TF–IDF (een methode om opvallend belangrijke termen te vinden) en K-Means-clustering (een manier om vergelijkbare teksten te groeperen) toe te passen, ontdekten ze acht hoofdthema’s die het denken in bedrijven domineren: gegevens en privacy, veiligheid en menselijke toezicht, beveiliging en misbruik, intellectueel eigendom en inhoudsintegriteit, transparantie en uitlegbaarheid, risico en compliance, arbeidskracht en verandermanagement, en innovatie via gecontroleerde experimenten of "sandboxes."

Verschillende regels voor verschillende risico’s

De studie stelt vast dat sectoren AI niet op dezelfde manier behandelen, omdat hun belangrijkste zorgen verschillen. De gezondheidszorg en farmacie richten zich op toestemming, patiëntveiligheid en traceerbaarheid gedurende de hele levenscyclus van een hulpmiddel, wat de vrees voor lichamelijke schade weerspiegelt. Banken en financiële instellingen leggen nadruk op modelrisico, audits en verantwoordelijkheid op bestuursniveau, omdat slechte AI-beslissingen verliezen door de economie zouden kunnen verspreiden. Uitgevers en media concentreren zich op intellectueel eigendom, auteurschap en duidelijke vermelding wanneer AI wordt gebruikt voor tekst of afbeeldingen. Socialmediabedrijven en telecomaanbieders worstelen met privacy en gebruikersvertrouwen op enorme schaal, terwijl creatieve sectoren zoals design, mode en entertainment “AI als assistent” benadrukken en menselijke controle eisen zodat automatisering originaliteit of merkkarakter niet ondermijnt. De auteurs betogen dat deze verschillen logisch zijn—maar ze creëren ook een lappendeken die het publiek en toezichthouders kan verwarren.

Wat de tekstanalyse onthulde

Door te kwantificeren welke woorden samen voorkomen, laten de auteurs zien dat sommige ideeën sterk beschermd worden terwijl andere verrassend weinig aandacht krijgen. “Privacy” en “integriteit” verschijnen frequent in meerdere sectoren, vooral in juridische en farmaceutische documenten, wat wijst op grote bezorgdheid over gegevensverwerking en ethisch gedrag. Finance-gerelateerde teksten geven veel gewicht aan voorspellende analyse en markten, en benadrukken hun honger naar data-gestuurde beslissingen onder strakke controles. Termen die verband houden met openheid en gebruikersmacht—zoals transparantie, mensgericht ontwerp, democratisering, scepsis en desinformatie—komen echter minder voor, zelfs in beleidsteksten van nieuws- en sociale mediabedrijven. Dit suggereert dat bedrijven zich meer op hun gemak voelen bij het beloven data te beschermen dan bij het beloven uit te leggen hoe systemen werken of macht te delen met gebruikers.

Naar slimmer en eerlijker AI-beleid

Op basis van deze bevindingen bevelen de auteurs een “modulaire” benadering van AI-governance aan. Elke sector, betogen zij, zou een gemeenschappelijke basis moeten delen: bouw privacy, eerlijkheid, transparantie en continue monitoring vanaf het begin in AI-systemen in. Daarbovenop kan elke sector eigen risicomodules toevoegen—bijvoorbeeld sterke veiligheidsproeven voor medische AI, stresstests voor bancaire hulpmiddelen, duidelijke labels en IE-regels voor creatief werk, en robuuste waarborgen tegen desinformatie voor nieuws- en sociale platforms. Ze pleiten ook voor live-testomgevingen (sandboxes), AI-geassisteerde audits en participatief ontwerp waarbij eindgebruikers en ethici vroeg betrokken worden. Voor een leek is de kernboodschap dat goed AI-beleid niet alleen draait om het voorkomen van slechte uitkomsten; het gaat erom deze krachtige hulpmiddelen zo te vormen dat ze daadwerkelijk menselijke behoeften dienen, voordelen breed delen en begrijpelijk en verantwoordelijk blijven naarmate ze in het dagelijks leven verspreid raken.

Bronvermelding: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Trefwoorden: governance van generatieve AI, AI-beleid in de industrie, AI-ethiek, grote taalmodellen, verantwoorde AI