Clear Sky Science · it

IA generativa e LLM nell'industria: un'analisi di text-mining e una valutazione critica di linee guida e dichiarazioni politiche in 14 settori industriali

Perché questo importa nella vita quotidiana

Strumenti di IA generativa come ChatGPT stanno facendo il loro ingresso negli uffici, negli ospedali, nelle banche, nelle redazioni e persino nei cantieri. Promettono servizi più rapidi, prodotti più economici e nuove forme di creatività—ma sollevano anche questioni difficili su privacy, sicurezza e equità. Questo articolo esplora come le grandi aziende in 14 settori diversi stanno effettivamente scrivendo le regole per questi sistemi, rivelando dove le imprese agiscono con cautela, dove assumono rischi e cosa ciò significa per lavoratori, consumatori e cittadini.

Come le aziende usano l'IA sul lavoro

Nei vari settori—dalla sanità e finanza all'editoria, alla moda e agli studi di videogiochi—le imprese stanno integrando l'IA generativa e i grandi modelli linguistici nelle operazioni quotidiane. Questi strumenti aiutano a rispondere alle domande dei clienti, redigere documenti, supportare medici e ricercatori, segnalare frodi, tradurre contenuti e progettare prodotti. Gli autori mostrano che, sebbene molte organizzazioni siano entusiaste dei guadagni in termini di velocità ed efficienza, solo una minoranza dispone di politiche formali che vadano oltre esperimenti e progetti pilota. Indagini citate nel testo rivelano che molti dipendenti già usano l'IA al lavoro, spesso senza autorizzazione, e talvolta presentano come proprie opere generate dall'IA. Questo divario tra uso rapido e governance lenta è la tensione centrale che lo studio indaga.

Cosa hanno fatto i ricercatori

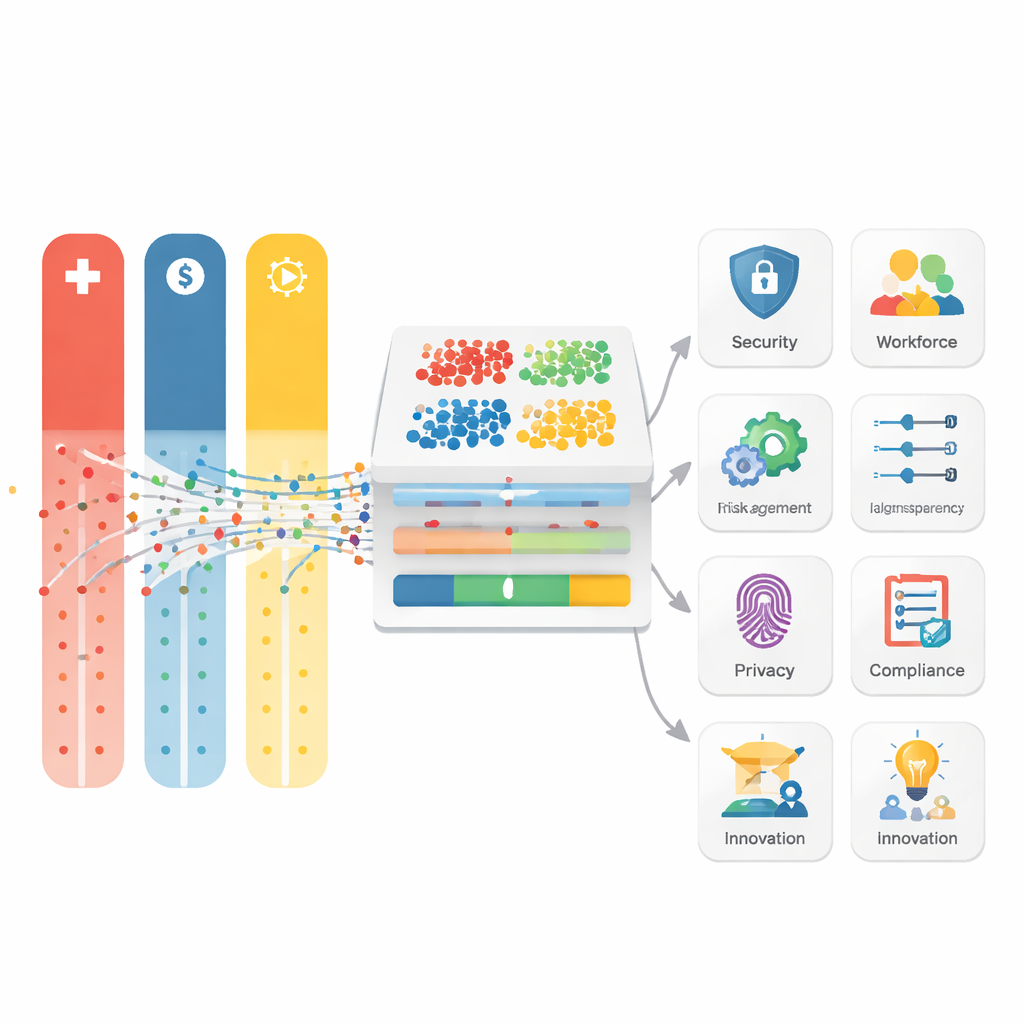

Invece di analizzare la tecnologia in sé, gli autori hanno esaminato 160 linee guida e dichiarazioni politiche pubbliche provenienti da grandi aziende in 14 settori nel mondo. Hanno trattato questi documenti come dati, utilizzando tecniche di text-mining per vedere quali idee e preoccupazioni ricorrono più spesso e come questi schemi varino per settore e regione. Suddividendo le politiche in migliaia di parole e frasi, e applicando poi TF–IDF (un metodo per individuare termini particolarmente rilevanti) e il clustering K-Means (un modo per raggruppare testi simili), hanno individuato otto temi principali che dominano il pensiero aziendale: dati e privacy, sicurezza e supervisione umana, sicurezza informatica e uso improprio, proprietà intellettuale e integrità dei contenuti, trasparenza e spiegabilità, rischio e conformità, forza lavoro e gestione del cambiamento, e innovazione attraverso sperimentazione controllata o “sandbox”.

Regole diverse per rischi diversi

Lo studio rileva che i settori non trattano l'IA allo stesso modo, perché le loro preoccupazioni principali differiscono. Sanità e industria farmaceutica si concentrano sul consenso, sulla sicurezza del paziente e sulla tracciabilità per l'intero ciclo di vita dello strumento, riflettendo il timore di danni al corpo delle persone. Banche e istituti finanziari pongono l'accento sul rischio del modello, sugli audit e sulla responsabilità a livello di consiglio di amministrazione, preoccupati che decisioni errate dell'IA possano propagare perdite nell'economia. Editori e case media si focalizzano su proprietà intellettuale, paternità e chiara divulgazione quando l'IA è usata per testi o immagini. Le società di social media e telecomunicazioni lottano con privacy e fiducia degli utenti su scala enorme, mentre i campi creativi come design, moda e intrattenimento enfatizzano l'“IA come assistente”, insistendo sulla revisione umana affinché l'automazione non comprometta originalità o identità del marchio. Gli autori sostengono che queste differenze sono sensate—ma creano anche un mosaico che può confondere il pubblico e i regolatori.

Cosa ha rivelato il text-mining

Quantificando quali parole appaiono insieme, gli autori mostrano che alcune idee sono fortemente protette mentre altre ricevono sorprendentemente poca attenzione. “Privacy” e “integrità” ricorrono frequentemente attraverso i settori, specialmente nei documenti legali e farmaceutici, indicando una forte preoccupazione per la gestione dei dati e per la condotta etica. I testi legati alla finanza danno grande peso ad analisi predittive e mercati, sottolineando la loro propensione a decisioni guidate dai dati sotto rigorosi controlli. Tuttavia termini legati all'apertura e all'empowerment degli utenti—come divulgazione, progettazione centrata sull'umano, democratizzazione, scetticismo e disinformazione—sono più rari, anche nelle politiche di news e social media. Questo suggerisce che le aziende sono più a loro agio a promettere la protezione dei dati che a promettere di spiegare come funzionano i sistemi o di condividere il potere con gli utenti.

Verso regole dell'IA più intelligenti e più giuste

Mettere insieme questi risultati, gli autori raccomandano un approccio “modulare” alla governance dell'IA. Ogni settore, sostengono, dovrebbe condividere una linea di base comune: integrare privacy, equità, trasparenza e monitoraggio continuo nei sistemi di IA fin dall'inizio. Su questa base, ogni settore può aggiungere i propri moduli di rischio—per esempio, rigorosi trial di sicurezza per l'IA medica, stress test per gli strumenti bancari, etichette chiare e regole di IP per il lavoro creativo, e solide protezioni contro la disinformazione per news e piattaforme social. Chiedono inoltre ambienti di test live (sandbox), audit assistiti dall'IA e progettazione partecipativa che coinvolga utenti finali ed esperti di etica fin dalle prime fasi. Per un lettore non specialista, il messaggio chiave è che una buona politica sull'IA non riguarda solo prevenire esiti negativi; riguarda plasmare questi potenti strumenti affinché servano davvero i bisogni umani, distribuiscano i benefici in modo ampio e restino comprensibili e responsabili mentre si diffondono nella vita quotidiana.

Citazione: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Parole chiave: governance dell'IA generativa, politiche aziendali sull'IA, etica dell'IA, modelli linguistici di grandi dimensioni, IA responsabile