Clear Sky Science · pt

IA generativa e LLMs na indústria: uma análise por mineração de texto e avaliação crítica de diretrizes e declarações de políticas em 14 setores industriais

Por que isto importa no dia a dia

Ferramentas de IA generativa como o ChatGPT estão se espalhando por escritórios, hospitais, bancos, redações e até canteiros de obras. Elas prometem atendimento mais rápido, produtos mais baratos e novas formas de criatividade — mas também levantam questões difíceis sobre privacidade, segurança e equidade. Este artigo examina nos bastidores como grandes empresas em 14 setores diferentes estão, de fato, escrevendo as regras para esses sistemas, revelando onde as empresas agem com cuidado, onde assumem riscos e o que isso significa para trabalhadores, consumidores e cidadãos.

Como as empresas usam IA no trabalho

Em diversos setores — da saúde e finanças à publicação, moda e estúdios de jogos — as empresas estão incorporando IA generativa e grandes modelos de linguagem às operações diárias. Essas ferramentas ajudam a responder perguntas de clientes, redigir documentos, apoiar médicos e cientistas, sinalizar fraudes, traduzir conteúdo e projetar produtos. Os autores mostram que, embora muitas organizações estejam entusiasmadas com ganhos de velocidade e eficiência, apenas uma minoria tem políticas formais que vão além de experimentos e pilotos. Pesquisas citadas no artigo revelam que muitos funcionários já usam IA no trabalho, frequentemente sem autorização, e às vezes apresentam material gerado por IA como se fosse próprio. Essa lacuna entre uso rápido e governança lenta é a tensão central que o estudo investiga.

O que os pesquisadores fizeram

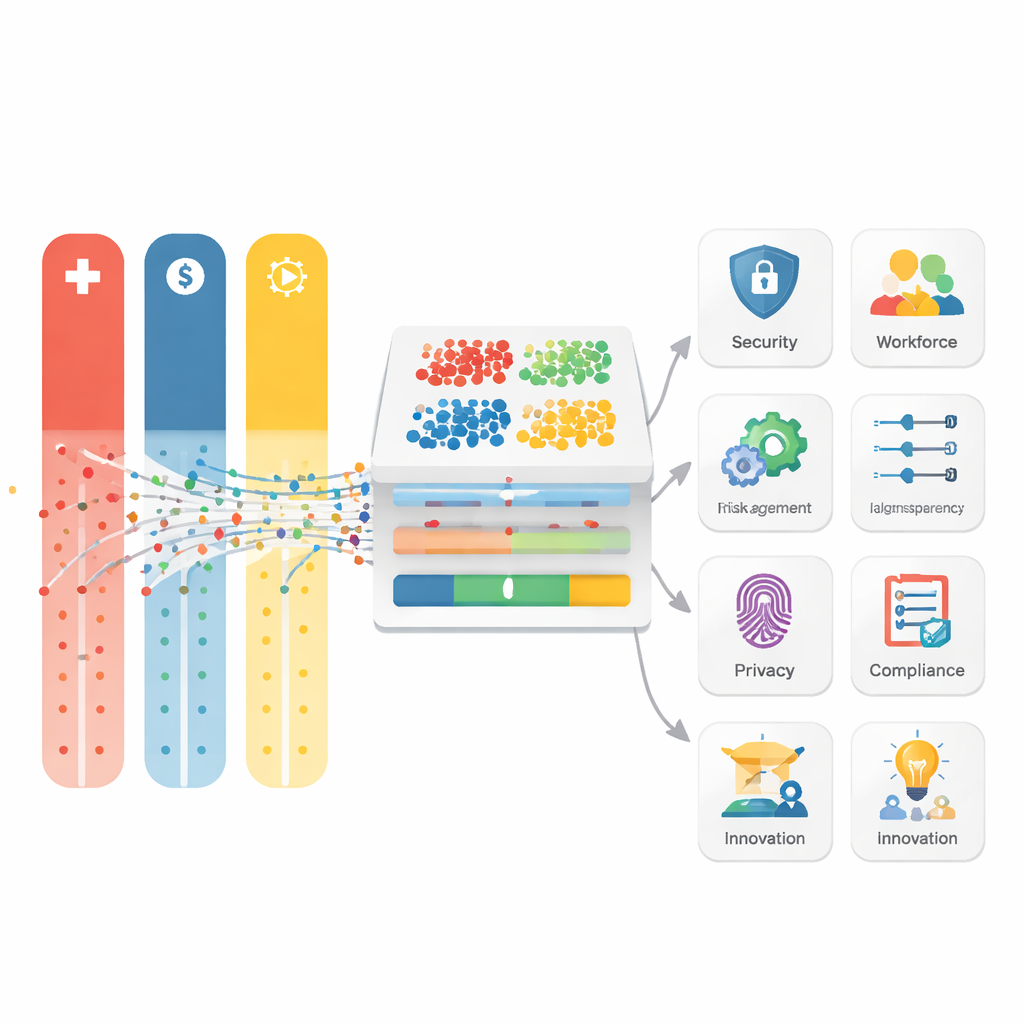

Em vez de analisar a tecnologia em si, os autores examinaram 160 diretrizes públicas e declarações de política de grandes empresas em 14 indústrias ao redor do mundo. Trataram esses documentos como dados, usando técnicas de mineração de texto para ver quais ideias e preocupações aparecem com mais frequência e como esses padrões mudam por setor e região. Ao dividir as políticas em milhares de palavras e expressões, e então aplicar TF–IDF (uma forma de identificar termos incomumente importantes) e K-Means clustering (um método para agrupar textos similares), eles descobriram oito temas principais que dominam o pensamento corporativo: dados e privacidade, segurança e supervisão humana, segurança e uso indevido, propriedade intelectual e integridade de conteúdo, transparência e explicabilidade, risco e conformidade, gestão da força de trabalho e mudança, e inovação por meio de experimentação controlada ou “sandboxes.”

Regras diferentes para riscos diferentes

O estudo conclui que os setores não tratam a IA da mesma forma, porque suas preocupações principais diferem. Saúde e farmacêutica se concentram em consentimento, segurança do paciente e rastreabilidade ao longo do ciclo de vida da ferramenta, refletindo temores sobre danos ao corpo humano. Bancos e instituições financeiras enfatizam risco de modelo, auditorias e responsabilidade ao nível do conselho, preocupados de que decisões ruins de IA possam propagar perdas pela economia. Editoras e veículos de mídia focam em propriedade intelectual, autoria e divulgação clara quando a IA é usada em textos ou imagens. Empresas de mídias sociais e telecomunicações lidam com privacidade e confiança do usuário em grande escala, enquanto áreas criativas como design, moda e entretenimento destacam a “IA como assistente”, insistindo em revisão humana para que a automação não comprometa originalidade ou identidade da marca. Os autores argumentam que essas diferenças fazem sentido — mas também criam um mosaico que pode confundir o público e os reguladores.

O que a mineração de texto revelou

Ao quantificar quais palavras aparecem juntas, os autores mostram que algumas ideias são fortemente protegidas enquanto outras recebem surpreendentemente pouca atenção. “Privacidade” e “integridade” aparecem com frequência entre os setores, especialmente em documentos jurídicos e farmacêuticos, sugerindo grande preocupação com o tratamento de dados e conduta ética. Textos relacionados a finanças dão ênfase a análises preditivas e mercados, sublinhando sua disposição por decisões orientadas por dados sob controles rígidos. Ainda assim, termos ligados à abertura e ao empoderamento do usuário — como divulgação, design centrado no humano, democratização, ceticismo e desinformação — são mais raros, mesmo em políticas de notícia e redes sociais. Isso sugere que as empresas se sentem mais à vontade em prometer proteger dados do que em prometer explicar como os sistemas funcionam ou em compartilhar poder com os usuários.

Rumo a regras de IA mais inteligentes e justas

Reunindo essas descobertas, os autores recomendam uma abordagem “modular” para a governança da IA. Todo setor, defendem, deve compartilhar uma linha de base comum: incorporar privacidade, equidade, transparência e monitoramento contínuo aos sistemas de IA desde o início. Sobre isso, cada setor pode adicionar seus próprios módulos de risco — por exemplo, testes de segurança rigorosos para IA médica, testes de estresse para ferramentas bancárias, rótulos claros e regras de PI para trabalho criativo, e salvaguardas robustas contra desinformação para notícias e plataformas sociais. Também pedem ambientes de testes ao vivo (sandboxes), auditorias assistidas por IA e design participativo que envolva usuários finais e especialistas em ética desde cedo. Para um leitor leigo, a mensagem-chave é que uma boa política de IA não se trata apenas de evitar resultados ruins; é sobre moldar essas ferramentas poderosas para que realmente sirvam às necessidades humanas, distribuam benefícios amplamente e permaneçam compreensíveis e responsabilizáveis à medida que se espalham pelo cotidiano.

Citação: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Palavras-chave: governança de IA generativa, políticas de IA na indústria, ética em IA, grandes modelos de linguagem, IA responsável