Clear Sky Science · sv

Generativ AI och stora språkmodeller i industrin: en textmineringsanalys och kritisk utvärdering av riktlinjer och policys över 14 industrisektorer

Varför detta spelar roll i vardagen

Generativa AI-verktyg som ChatGPT strömmar in i kontor, sjukhus, banker, redaktioner och till och med byggarbetsplatser. De lovar snabbare service, billigare produkter och nya former av kreativitet—men väcker också svåra frågor om integritet, säkerhet och rättvisa. Denna uppsats skruvar upp locket på hur stora företag i 14 olika branscher faktiskt formulerar reglerna för dessa system, och visar var företag är försiktiga, var de tar risker och vad det innebär för arbetstagare, konsumenter och medborgare.

Hur företag använder AI i arbetet

Över sektorer—från vård och finans till förlag, mode och spelstudios—väver företag in generativ AI och stora språkmodeller i dagliga arbetsflöden. Verktygen hjälper till att besvara kundfrågor, utarbeta dokument, stödja läkare och forskare, flagga bedrägerier, översätta innehåll och utforma produkter. Författarna visar att även om många organisationer är entusiastiska över vinster i hastighet och effektivitet, så har endast en minoritet formella policyer som går bortom experiment och pilotprojekt. Enkäter som citeras i artikeln visar att många anställda redan använder AI på jobbet, ofta utan tillåtelse, och ibland presenterar AI-skrivet material som sitt eget. Glappet mellan snabb användning och långsam styrning är den centrala spänningen studien undersöker.

Vad forskarna gjorde

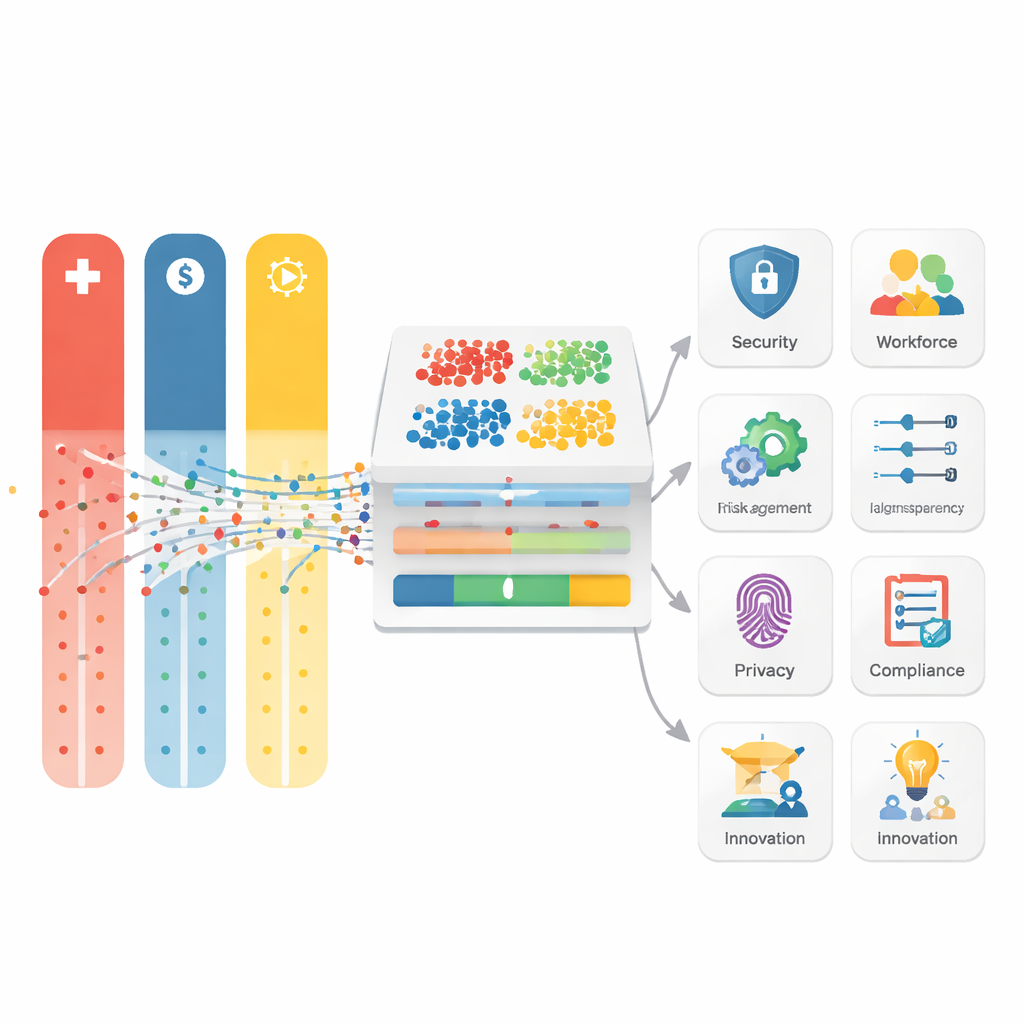

I stället för att studera tekniken i sig granskade författarna 160 offentliga riktlinjer och policydokument från stora företag i 14 branscher runt om i världen. De behandlade dessa dokument som data och använde textmineringstekniker för att se vilka idéer och oro som förekommer oftast, och hur dessa mönster varierar mellan sektorer och regioner. Genom att bryta ner policyerna i tusentals ord och fraser och sedan tillämpa TF–IDF (ett sätt att identifiera ovanligt viktiga termer) och K-Means-klustring (ett sätt att gruppera liknande texter) upptäckte de åtta huvudteman som dominerar företagsresonemang: data och integritet, säkerhet och mänsklig översyn, säkerhet mot missbruk, immateriella rättigheter och innehållsintegritet, transparens och förklarbarhet, risk och efterlevnad, arbetskraft och förändringshantering samt innovation genom kontrollerade experiment eller ”sandlådor”.

Olika regler för olika risker

Studien visar att industrier inte behandlar AI på samma sätt eftersom deras främsta bekymmer skiljer sig åt. Vård och läkemedel fokuserar på samtycke, patientsäkerhet och spårbarhet genom hela ett verktygs livscykel, vilket speglar rädslan för skada mot människors kroppar. Banker och finansföretag betonar modellrisk, revisioner och styrelsens ansvar, oroade över att dåliga AI-beslut kan sprida förluster i ekonomin. Förlag och mediehus zoomar in på immateriella rättigheter, upphovsskap och tydlig märkning när AI används i text eller bild. Sociala medier och telekomföretag brottas med integritet och användarförtroende i stor skala, medan kreativa fält som design, mode och underhållning framhåller ”AI som assistent” och insisterar på mänsklig granskning så att automatisering inte urholkar originalitet eller varumärkesidentitet. Författarna menar att dessa skillnader är rimliga—men att de också skapar ett lapptäcke som kan förvirra allmänheten och tillsynsmyndigheter.

Vad textmineringen avslöjade

Genom att kvantifiera vilka ord som förekommer tillsammans visar författarna att vissa idéer är starkt skyddade medan andra får förvånansvärt lite uppmärksamhet. ”Integritet” och ”integritet” (i meningen innehålls- eller dataintegritet) förekommer ofta över sektorer, särskilt i juridiska och farmaceutiska dokument, vilket tyder på stark oro för datahantering och etiskt beteende. Finansrelaterade texter lägger stor vikt vid prediktiv analys och marknader, vilket understryker deras aptit för datadrivna beslut under strikt kontroll. Ändå är termer knutna till öppenhet och användarmakt—som avslöjande, människocentrerad design, demokratisering, skepticism och desinformation—mer sällsynta, även i nyhets- och sociala mediapolicyer. Detta antyder att företag hellre lovar att skydda data än att förklara hur systemen fungerar eller att dela makt med användarna.

Mot smartare, rättvisare AI-regler

Sammantaget rekommenderar författarna en ”modulär” ansats till AI-styrning. Alla industrier, menar de, bör dela en gemensam basnivå: bygga in integritet, rättvisa, transparens och kontinuerlig övervakning i AI-system från början. Ovanpå detta kan varje sektor lägga till sina egna riskmoduler—till exempel starka säkerhetstester för medicinsk AI, stresstester för bankverktyg, tydliga etikett- och IP-regler för kreativt arbete samt robusta skydd mot desinformation för nyhets- och sociala plattformar. De efterlyser också levande testmiljöer (sandlådor), AI-assisterade revisioner och deltagande design som involverar slutanvändare och etiker tidigt. För en lekman är huvudbudskapet att god AI-policy inte bara handlar om att stoppa dåliga utfall; det handlar om att forma dessa kraftfulla verktyg så att de verkligen tjänar mänskliga behov, fördelar delas brett och systemen förblir begripliga och ansvarsskyldiga när de sprids i vardagslivet.

Citering: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

Nyckelord: styrning av generativ AI, industrins AI-policyer, AI-etik, stora språkmodeller, ansvarsfull AI