Clear Sky Science · ja

産業界における生成AIと大規模言語モデル:14業種にわたるガイドラインと政策声明のテキストマイニング分析と批判的評価

日常生活にとってなぜ重要か

ChatGPTのような生成AIツールは、オフィス、病院、銀行、編集部、さらには建設現場にまで急速に導入されています。これらはサービスの迅速化、コスト削減、新たな創造性をもたらす可能性がある一方で、プライバシー、安全性、公平性に関する難しい問題も提起します。本稿は、14の異なる産業分野で大手企業がこれらのシステムに対するルールを実際にどのように書いているかを詳しく調べ、企業がどこで慎重に対応し、どこでリスクを取っているか、そしてそれが労働者、消費者、市民に何を意味するかを明らかにします。

企業は職場でAIをどう使っているか

医療や金融から出版、ファッション、ゲームスタジオに至るまで、企業は生成AIや大規模言語モデルを日常業務に組み込んでいます。これらのツールは顧客の質問に答え、文書を作成し、医師や研究者を支援し、不正を検出し、コンテンツを翻訳し、製品を設計するのに役立ちます。著者らは、多くの組織が速度と効率の向上に期待を寄せている一方で、実験やパイロットを越えた正式な方針を持つのは少数にとどまることを示しています。論文で引用された調査は、多くの従業員がすでに許可なく職場でAIを使用しており、時にはAIが作成した資料を自分のものとして提出していることを明らかにしています。こうした急速な利用と遅れたガバナンスのギャップが、本研究が検討する核心的な緊張です。

研究者は何をしたか

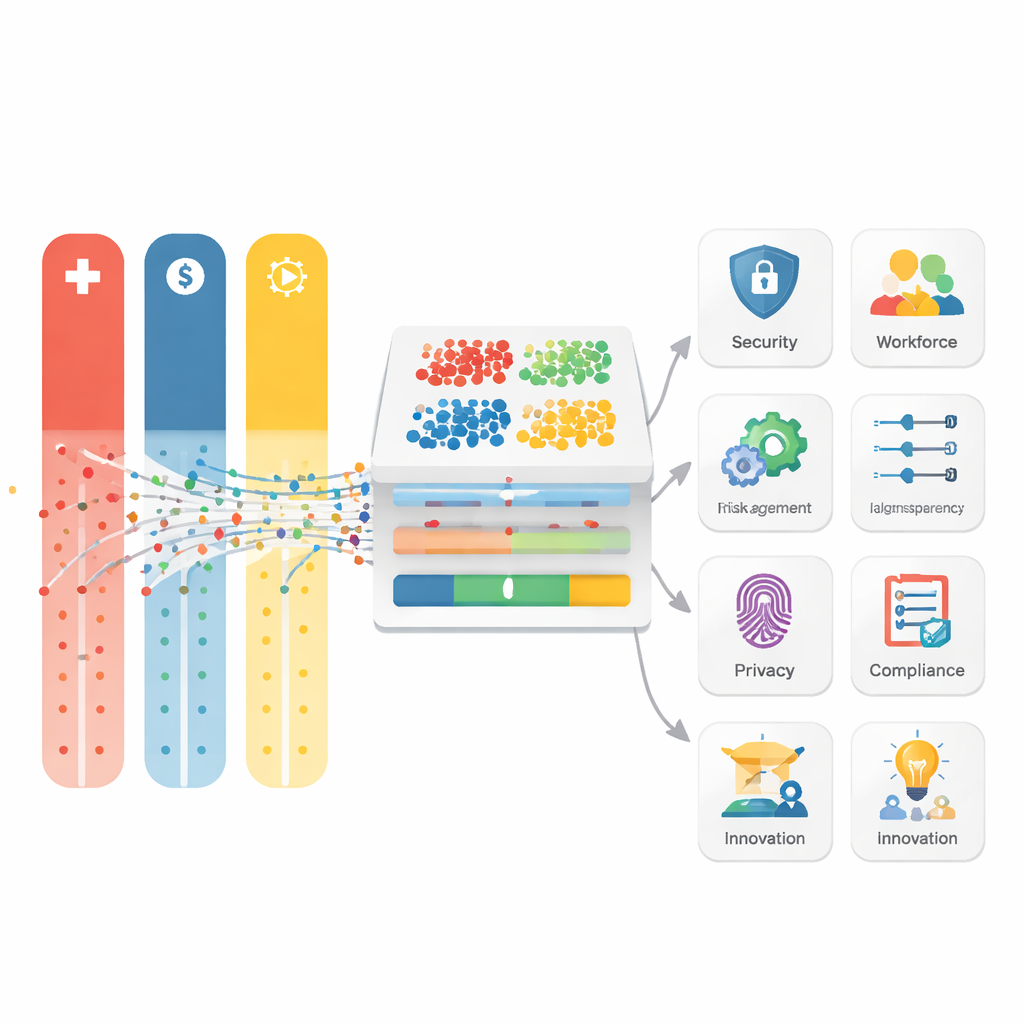

技術そのものを見るのではなく、著者らは世界各地の14業界の大手企業が公開している160件のガイドラインや政策声明を調査しました。これらの文書をデータとして扱い、どの考えや懸念がもっとも頻出するか、セクターや地域によってどのようにパターンが変わるかをテキストマイニング技術で解析しました。方針を数千の語句に分解し、TF–IDF(重要語を検出する手法)やK-Meansクラスタリング(類似したテキストをグループ化する手法)を適用することで、企業の思考を支配する8つの主要テーマを明らかにしました:データとプライバシー、安全性と人間による監督、セキュリティと悪用防止、知的財産とコンテンツの整合性、透明性と説明可能性、リスクとコンプライアンス、労働力と変革管理、そして管理された実験や「サンドボックス」を通じたイノベーションです。

リスクによって異なる規則

業界ごとに主たる懸念が異なるため、AIに対する扱いも同じではないと研究は示します。医療や製薬は同意、患者の安全性、ツールのライフサイクルにわたる追跡可能性に焦点を当て、人体への危害への懸念を反映しています。銀行や金融機関はモデルリスク、監査、取締役会レベルの責任を重視し、不適切なAI判断が経済に損失を波及させることを懸念しています。出版社やメディアは、執筆や画像にAIが使われる際の知的財産、著作者性、明確な開示に注目します。ソーシャルメディアや通信会社は大規模なプライバシーとユーザー信頼の問題に取り組んでおり、デザイン、ファッション、エンターテインメントのような創造分野は「AIはアシスタント」という立場を強調し、自動化が独創性やブランドアイデンティティを損なわないよう人間の査読を求めます。著者らはこれらの違いは妥当だと論じる一方で、それが公共や規制当局にとって混乱を招くパッチワークを生むことも指摘しています。

テキストマイニングが明らかにしたこと

語がどのように共起するかを数値化することで、著者らはある概念が強く保護されている一方、驚くほど注目されていない概念があることを示しています。「プライバシー」と「整合性」はセクターを超えて、特に法務や製薬文書で頻出し、データ取り扱いと倫理的行動に強い懸念があることを示唆します。金融関連の文書は予測分析や市場に大きな重みを置き、厳しい管理下でのデータ駆動型判断への欲求を強調しています。一方で、開示、人間中心設計、民主化、懐疑心、誤情報といったオープンネスや利用者のエンパワーメントに結びつく用語は、ニュースやソーシャルメディアの方針においてさえ希薄です。これは、企業がシステムの仕組みを説明することや利用者と権力を共有することよりも、データ保護を約束するほうをより快適に感じていることを示唆しています。

より賢く、公平なAI規則に向けて

これらの知見を踏まえ、著者らはAIガバナンスに対して「モジュール式」のアプローチを推奨します。各業界は共通の基盤を共有すべきであり、プライバシー、公平性、透明性、継続的な監視をAIシステムに初期から組み込むことが必要だと主張します。その上で、各セクターは固有のリスクモジュールを追加できます。例えば、医療AIには厳格な安全試験、銀行ツールにはストレステスト、創造的作業には明確なラベリングと知的財産ルール、ニュースやソーシャルプラットフォームには堅牢な誤情報対策などです。彼らはまた、ライブテスト環境(サンドボックス)、AI支援の監査、エンドユーザーや倫理学者を早期に巻き込む参加型設計を求めています。一般向けの要点は、良いAI方針とは単に悪い結果を防ぐことではなく、これらの強力なツールを人間のニーズに真に奉仕させ、利益を広く共有し、日常生活に広がる中で理解可能で説明責任のあるものに形づくることだ、ということです。

引用: Jiao, J., Afroogh, S., Chen, K. et al. Generative AI and LLMs in industry: a text-mining analysis and critical evaluation of guidelines and policy statements across 14 industrial sectors. Humanit Soc Sci Commun 13, 410 (2026). https://doi.org/10.1057/s41599-026-06598-1

キーワード: 生成AIガバナンス, 産業界のAI方針, AI倫理, 大規模言語モデル, 責任あるAI