Clear Sky Science · zh

评估不同版本 ChatGPT 在提供就医建议时的准确性

这项研究为何与日常健康选择相关

越来越多的人向像 ChatGPT 这样的工具提出看似简单但重要的问题:“我需要去急诊、去看医生,还是可以留在家里等?”本研究将 22 个 ChatGPT 版本针对这一决策进行测试。研究结果对任何有意用人工智能替代打电话给诊所、护士热线或可信医生的人都有重要意义。

研究人员如何测试 ChatGPT 的医疗建议

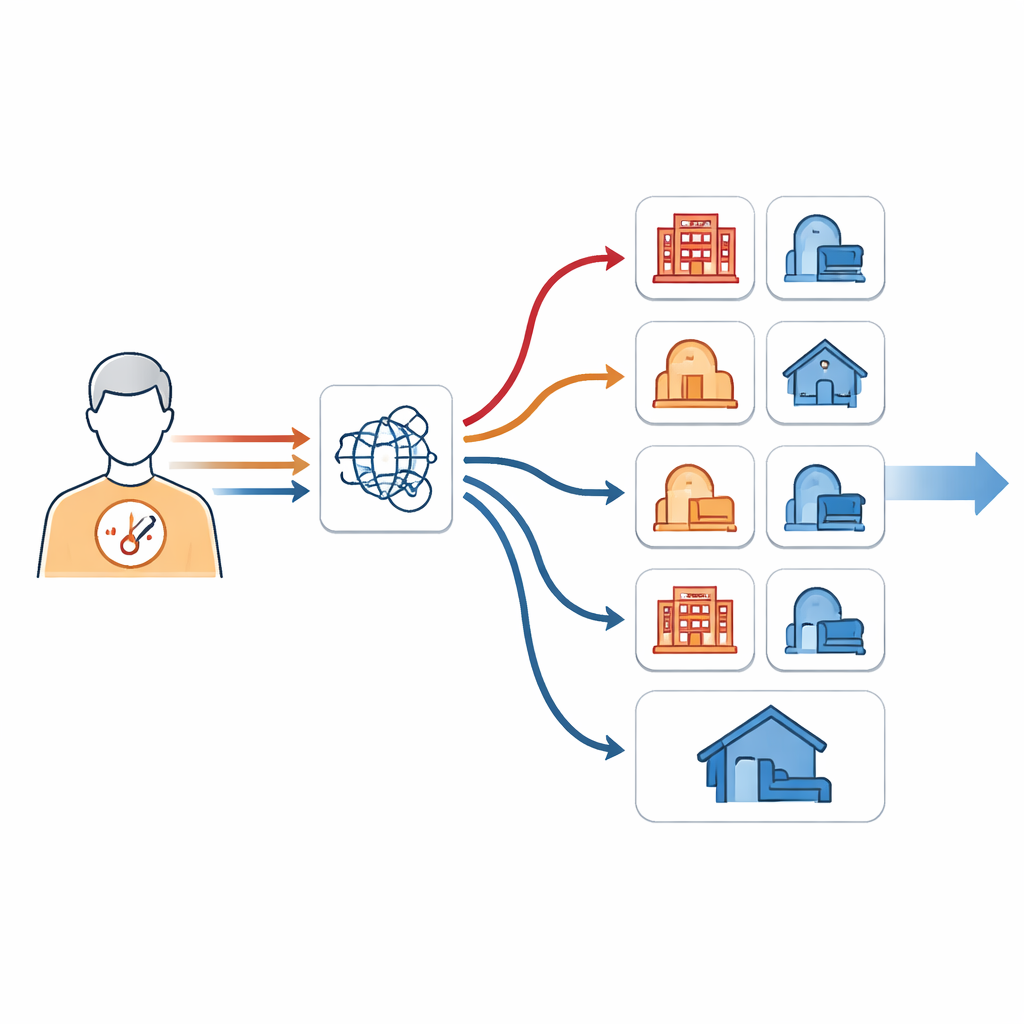

研究团队没有使用实时患者,而是用 45 个精心设计的患者病例或情景(vignettes),这些情景取自真实在网上询问就医去向的人群。每个故事都由两位医生评判并达成一致,判断其是否需要急诊、非紧急的医生就诊,或只是居家自我照护。研究人员随后让每个可用的 ChatGPT 版本——包括较旧模型和较新的“推理”模型——在这三种选项中做出选择。为评估模型的一致性,他们对每个病例和每个模型重复该过程十次,最终得到 9,900 条独立建议。

不同版本 ChatGPT 的准确率如何?

在研究中表现最好的模型 o1-mini 在大约四分之三的情况下(74%)选择了正确选项。一些更小或更轻量的模型表现明显较差,准确率降至约 44%。几乎所有模型在识别急症方面都非常出色;在有限的急症示例中,它们几乎总是在真正需要时建议紧急就医。它们在典型的非紧急医生就诊情形中也表现良好。最大的问题出现在居家自我照护上。即便是较好的模型,常常在本可通过休息、观察症状并等待几天的情况下仍建议就医。

为何 ChatGPT 倾向于“更安全”的建议

总体来看,模型倾向于比医生评判更为紧急的建议。较旧版本几乎不会建议不足的护理,许多较新的版本仍然严重偏向谨慎。从安全角度看,偏向谨慎似乎让人安心:送人去看医生通常优于漏诊真正的急症。但如果系统几乎总是建议某种形式的就医,其建议对日常决策就变得不太有用——并可能增加门诊和急诊的拥挤。它也可能加剧本已焦虑的人的担忧,让他们认为即便是轻微症状也总是需要专业处理。

利用不一致性以改善建议

令人惊讶的是,同一 ChatGPT 模型在面对相同患者故事时并不总是给出相同答案。在多次运行中,一些模型会在相同病例上于不同紧急程度之间切换。研究人员并没有将这种不一致性纯粹视为缺陷,而是尝试把它变为优势。他们将每个病例十次重复的答案以多种方式组合起来。当他们选择十次结果中出现的最低紧急程度建议时,整体准确率提高了约四个百分点,而正确的自我照护建议增加得更多。换言之,当模型对同一轻微病例有时建议自我照护、有时建议就医时,信任最低紧急度的建议往往更接近医生的判断。

这对使用 AI 做出健康决策的人意味着什么

研究的结论是:当前的 ChatGPT 模型在识别明确急症方面可能有帮助,但就单独指导就医决策而言仍不够可靠——尤其是在“看医生”与“留在家中”的抉择上。较新的“推理”模型在更愿意并且在某种程度上更能识别何时足以自我照护,但其表现仍远非完美。将同一模型的多个回答结合的技术,可能有助于开发者构建更安全的工具。就目前而言,人们应将 ChatGPT 的分诊式建议视为多种信息来源之一,而不是替代当地急救指示、专业医疗建议或自身常识的唯一依据。

引用: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

关键词: chatgpt, 自我分诊, 急诊护理, 健康建议, 人工智能