Clear Sky Science · es

Evaluación de la precisión de las versiones del modelo ChatGPT para dar consejos sobre búsqueda de atención

Por qué este estudio importa para las decisiones de salud cotidianas

Cada vez más personas preguntan a herramientas como ChatGPT una cuestión aparentemente simple: «¿Necesito ir a urgencias, visitar al médico o puedo quedarme en casa y esperar?». Este estudio pone a prueba 22 versiones de ChatGPT exactamente en esa decisión. Los hallazgos importan a cualquiera que esté tentado de fiarse de la inteligencia artificial en lugar de llamar a una clínica, una línea de enfermería o a un médico de confianza.

Cómo los investigadores evaluaron los consejos médicos de ChatGPT

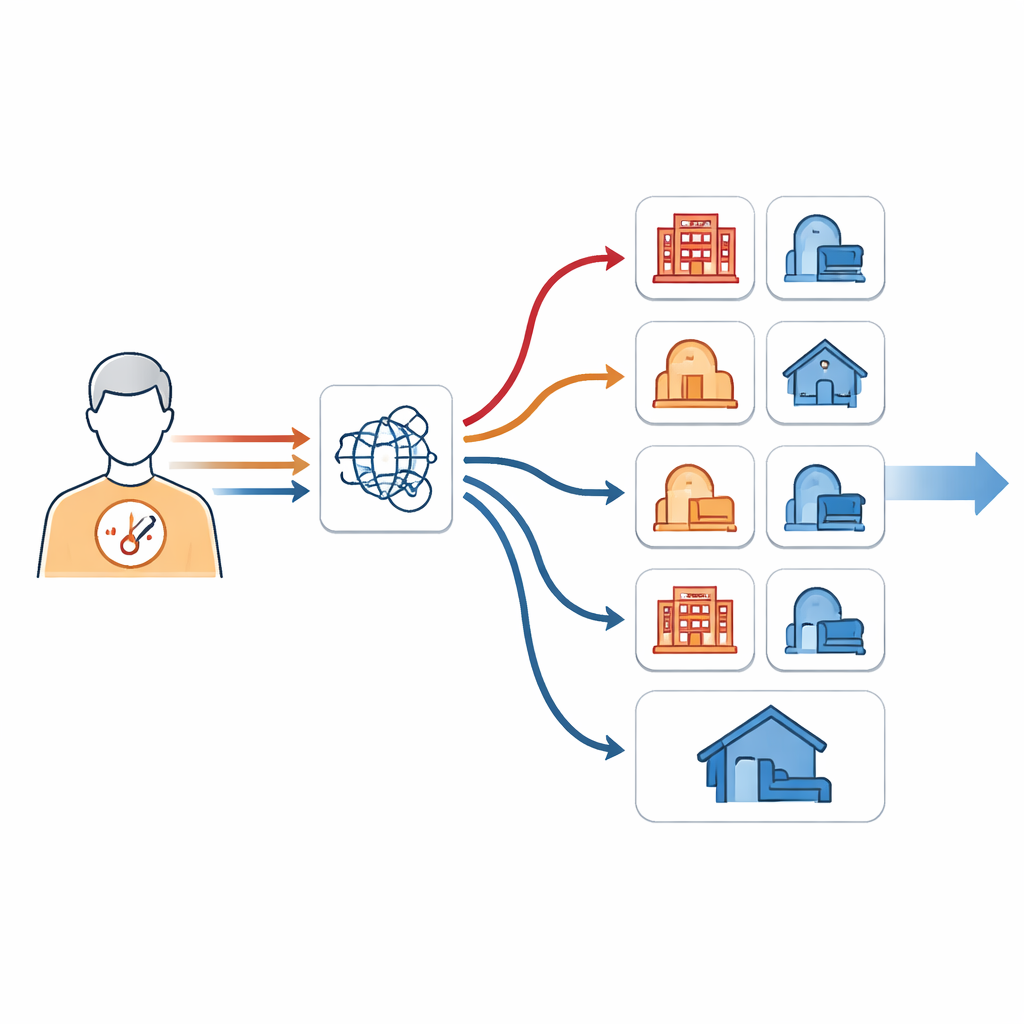

En lugar de pacientes reales, el equipo utilizó 45 historias de pacientes diseñadas con cuidado, o viñetas, extraídas de personas reales que habían preguntado en línea dónde debían buscar atención. Cada historia ya había sido juzgada por dos médicos, que coincidieron en si requería tratamiento de urgencia, una visita no urgente al médico o simplemente autocuidado en casa. Luego los investigadores pidieron a cada versión disponible de ChatGPT —incluyendo modelos antiguos y los modelos “de razonamiento” más recientes— que eligiera una de esas tres opciones. Para comprobar la consistencia de los modelos, repitieron este proceso diez veces por caso y por modelo, obteniendo al final 9.900 recomendaciones independientes.

¿Qué precisión alcanzaron las distintas versiones de ChatGPT?

El modelo con mejor rendimiento en el estudio, llamado o1-mini, eligió la opción correcta alrededor de tres cuartas partes de las veces (74%). Algunos modelos más pequeños o de menor capacidad lo hicieron notablemente peor, con la precisión cayendo hasta aproximadamente un 44%. Casi todos los modelos fueron muy buenos detectando emergencias; con los ejemplos limitados de urgencias disponibles, casi siempre sugerían atención urgente cuando realmente era necesaria. También funcionaron bien para las visitas médicas no urgentes típicas. La mayor dificultad fue el autocuidado. Incluso los modelos mejores con frecuencia recomendaron ver a un médico cuando lo apropiado habría sido simplemente descansar, vigilar los síntomas y esperar unos días.

Por qué ChatGPT tiende a «jugar a lo seguro»

En general, los modelos se inclinaron hacia un consejo más urgente del que los médicos consideraban necesario. Las versiones antiguas casi nunca sugirieron un nivel de atención insuficiente, y muchas de las más nuevas aún erraban por exceso de precaución. Desde un punto de vista de seguridad, favorecer la cautela puede parecer alentador: en general es mejor enviar a alguien al médico que perder una verdadera emergencia. Pero si un sistema casi siempre recomienda algún tipo de visita médica, su orientación pierde utilidad para las decisiones cotidianas —y podría aumentar la saturación en clínicas y servicios de urgencias. También puede aumentar la ansiedad en personas ya preocupadas, enseñándoles que incluso los síntomas leves siempre merecen atención profesional.

Usar la inconsistencia para mejorar el asesoramiento

Sorprendentemente, el mismo modelo de ChatGPT no siempre dio la misma respuesta ante la misma historia de paciente. En varias ejecuciones, algunos modelos variaron entre distintos niveles de urgencia para un caso idéntico. En lugar de tratar esa inconsistencia solo como un fallo, los investigadores intentaron aprovecharla. Combinaron las diez respuestas repetidas para cada caso de varias maneras. Cuando eligieron la recomendación de menor urgencia que apareció entre esas diez ejecuciones, la precisión global subió alrededor de cuatro puntos porcentuales, y las sugerencias correctas de autocuidado aumentaron aún más. En otras palabras, cuando un modelo a veces recomendaba autocuidado y a veces una visita al médico para un mismo caso leve, confiar en la sugerencia de menor urgencia a menudo acercaba el consejo al juicio de los médicos.

Qué significa esto para las personas que usan IA para decisiones de salud

La conclusión del estudio es que los modelos actuales de ChatGPT pueden ser útiles para reconocer emergencias claras, pero aún no son lo bastante fiables como para guiar por sí solos las decisiones sobre búsqueda de atención —especialmente cuando la elección es entre ver a un médico o quedarse en casa. Los modelos “de razonamiento” más recientes muestran más disposición y una ligera mejora para reconocer cuándo el autocuidado es suficiente, pero su rendimiento todavía está lejos de ser perfecto. Las técnicas que combinan múltiples respuestas del mismo modelo pueden ayudar a los desarrolladores a construir herramientas más seguras en el futuro. Por ahora, las personas deberían tratar los consejos de tipo triaje de ChatGPT como un insumo entre varios, no como un sustituto de las instrucciones locales de emergencia, de la atención médica profesional o del sentido común propio.

Cita: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Palabras clave: chatgpt, autotriage, atención de urgencias, consejos de salud, inteligencia artificial