Clear Sky Science · nl

Evaluatie van de nauwkeurigheid van ChatGPT-modelversies bij het geven van advies over zorgkeuze

Waarom deze studie ertoe doet voor alledaagse gezondheidskeuzes

Steeds meer mensen stellen aan tools zoals ChatGPT een schijnbaar eenvoudige vraag: “Moet ik naar de spoedeisende hulp, naar de huisarts, of kan ik thuis blijven en afwachten?” Deze studie test 22 versies van ChatGPT precies op die beslissing. De bevindingen zijn van belang voor iedereen die geneigd is op kunstmatige intelligentie te vertrouwen in plaats van een kliniek, een verpleegkundig informatienummer of een vertrouwde arts te bellen.

Hoe de onderzoekers het medische advies van ChatGPT testten

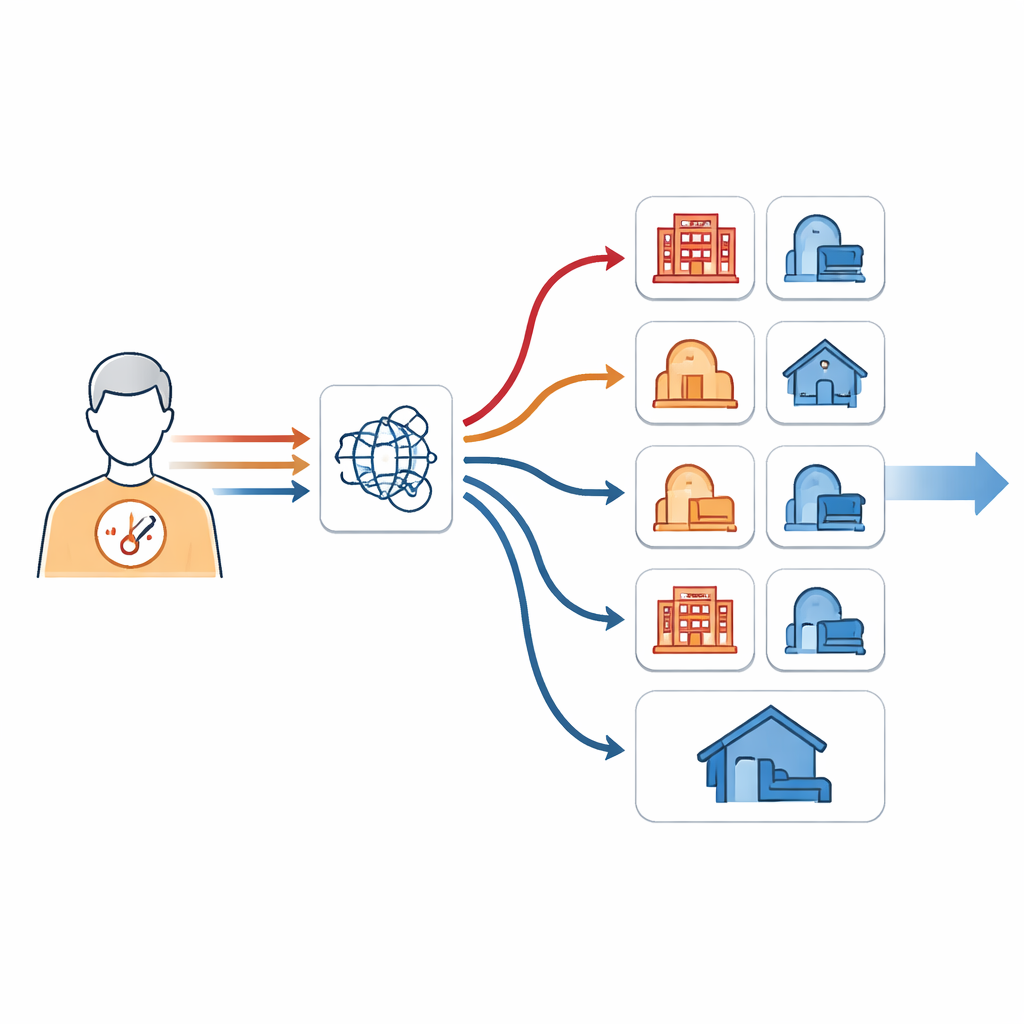

In plaats van realtimepatiënten gebruikte het team 45 zorgvuldig opgebouwde patiëntverhalen, of vignetten, afkomstig van echte mensen die online hadden gevraagd waar ze zorg moesten zoeken. Elk verhaal was eerder door twee artsen beoordeeld, die het eens waren over of het spoedeisend behandeld moest worden, een niet-spoedige doktersafspraak vereiste, of volstond met zelfzorg thuis. De onderzoekers vroegen vervolgens elke beschikbare ChatGPT-versie—inclusief oudere modellen en nieuwere “reasoning”-modellen—om één van deze drie opties te kiezen. Om te zien hoe consistent de modellen waren, herhaalden ze dit proces tien keer per casus en per model, wat leidde tot 9.900 afzonderlijke aanbevelingen.

Hoe nauwkeurig waren de verschillende versies van ChatGPT?

Het best presterende model in de studie, genaamd o1-mini, koos ongeveer driekwart van de tijd (74%) de juiste optie. Sommige kleinere of lichtere modellen deden het duidelijk slechter, met een nauwkeurigheid die daalde tot ongeveer 44%. Bijna alle modellen waren zeer goed in het herkennen van spoedeisende situaties; gezien het beperkte aantal spoedgevallen in de voorbeelden suggereerden ze vrijwel altijd urgente zorg wanneer die echt nodig was. Ze waren ook sterk bij typische niet-spoedeisende doktersbezoeken. Het grootste probleem lag bij zelfzorg. Zelfs de betere modellen raadpleegden vaak een arts wanneer rustig afwachten, symptomen in de gaten houden en een paar dagen wachten passend zou zijn geweest.

Waarom ChatGPT de neiging heeft om “veilige” adviezen te geven

Over het geheel genomen neigden de modellen naar dringender advies dan artsen nodig achtten. Oudere versies suggereerden bijna nooit te weinig zorg, en veel nieuwere versies neigden nog steeds sterk naar voorzichtigheid. Vanuit een veiligheidsstandpunt lijkt voorkeur voor voorzichtigheid geruststellend: het is doorgaans beter iemand naar een arts te sturen dan een echt noodgeval te missen. Maar als een systeem bijna altijd een vorm van medisch consult adviseert, wordt de begeleiding minder bruikbaar voor alledaagse beslissingen—en kan het bijdragen aan drukte in klinieken en spoedeisende hulp. Het kan ook angst aanwakkeren bij mensen die al bezorgd zijn, door hen te leren dat zelfs milde symptomen altijd professionele aandacht verdienen.

Inconsistentie gebruiken om het advies te verbeteren

Verrassend genoeg gaf hetzelfde ChatGPT-model niet altijd hetzelfde antwoord wanneer het hetzelfde patiëntverhaal te zien kreeg. Over meerdere runs wisselden sommige modellen tussen verschillende urgentieniveaus voor dezelfde casus. In plaats van deze inconsistentie louter als een defect te beschouwen, probeerden de onderzoekers deze in hun voordeel te benutten. Ze combineerden de tien herhaalde antwoorden per casus op verschillende manieren. Toen ze de minst urgente aanbeveling kozen die in die tien runs verscheen, steeg de algehele nauwkeurigheid met ongeveer vier procentpunt, en de correcte zelfzorgaanbevelingen namen zelfs nog meer toe. Met andere woorden: wanneer een model soms zelfzorg en soms een doktersbezoek voor dezelfde milde casus aanraadde, bracht het vertrouwen op de laagste-urgentie suggestie het advies vaak dichter bij het oordeel van de artsen.

Wat dit betekent voor mensen die AI gebruiken voor gezondheidsbeslissingen

De kernboodschap van de studie is dat de huidige ChatGPT-modellen nuttig kunnen zijn bij het herkennen van duidelijke noodgevallen, maar nog niet betrouwbaar genoeg zijn om op zichzelf zorgkeuzebeslissingen te sturen—vooral wanneer de keuze ligt tussen een dokter bezoeken en thuis blijven. Nieuwere “reasoning”-modellen zijn eerder bereid en iets beter in staat te herkennen wanneer zelfzorg voldoende is, maar hun prestatie is nog ver van perfect. Technieken die meerdere antwoorden van hetzelfde model combineren kunnen ontwikkelaars helpen veiliger tools te bouwen in de toekomst. Voor nu moeten mensen het triage-achtige advies van ChatGPT als één input onder vele behandelen, en het niet zien als een vervanging voor lokale noodinstructies, professioneel medisch advies of hun eigen gezond verstand.

Bronvermelding: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Trefwoorden: chatgpt, zelf-triage, spoedeisende hulp, gezondheidsadvies, kunstmatige intelligentie