Clear Sky Science · he

הערכת הדיוק של גרסאות מודל ChatGPT במתן ייעוץ על חיפוש טיפול

מדוע המחקר הזה חשוב להחלטות בריאות יומיומיות

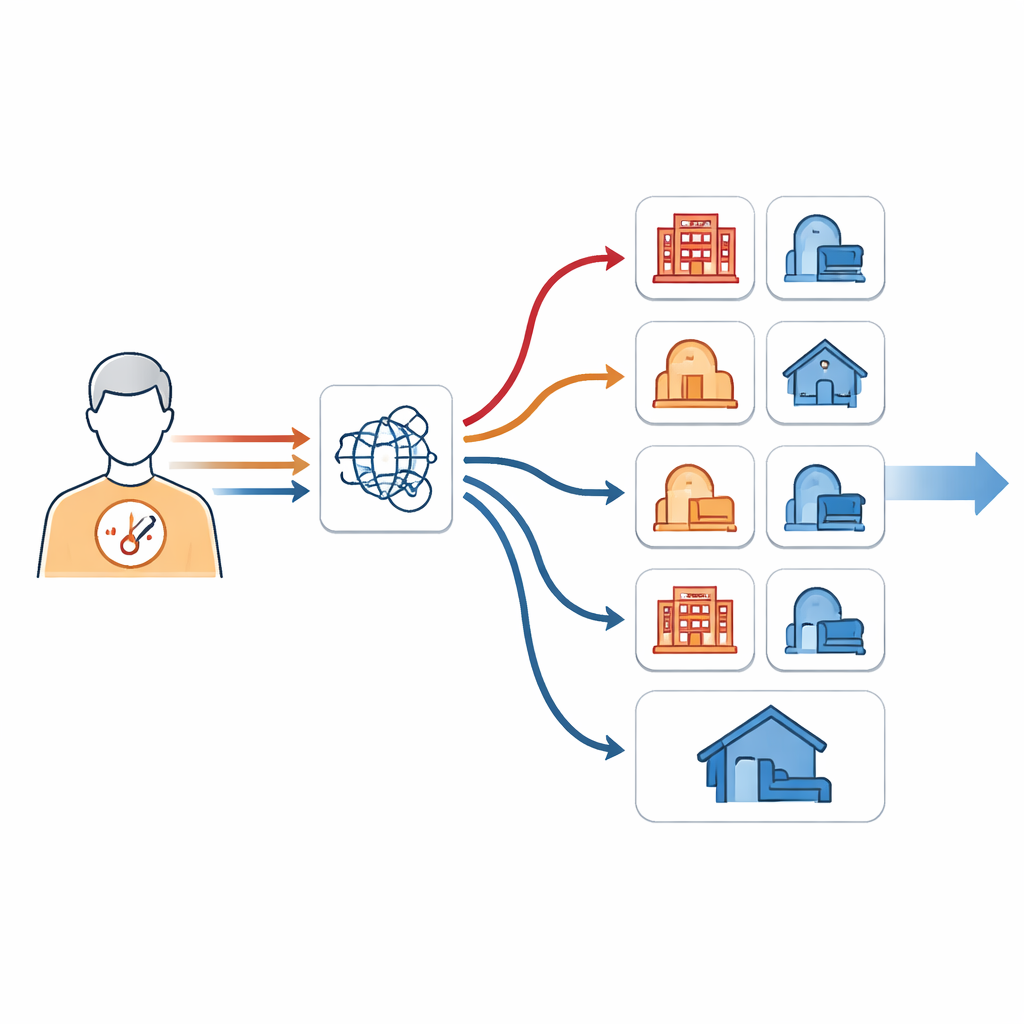

יותר ויותר אנשים שואלים כלים כמו ChatGPT שאלה שנראית פשוטה אך עשויה להיות קריטית: "האם אני צריך חדר מיון, ביקור אצל רופא, או שאני יכול להישאר בבית ולהמתין?" מחקר זה בודק 22 גרסאות של ChatGPT בדיוק על שאלה זו. הממצאים רלוונטיים לכל מי שמטיל ספק האם להסתמך על בינה מלאכותית במקום להתקשר לקליניקה, לקו חירום של אחיות או לרופא מהימן.

כיצד החוקרים בחנו את הייעוץ הרפואי של ChatGPT

במקום מטופלים בזמן אמת, הצוות השתמש ב-45 סיפורי מטופלים מתוכננים בקפידה, או וינייטות, שנלקחו מאנשים אמיתיים שפנו ברשת כדי לשאול היכן עליהם לפנות לטיפול. כל סיפור כבר הוערך על-ידי שני רופאים שהסכימו האם הוא מחייב טיפול חירום, ביקור אצל רופא לא דחוף, או טיפול עצמי בבית. החוקרים שאלו כל גרסה זמינה של ChatGPT — כולל מודלים ישנים וגרסאות "היסק" חדשות — לבחור באחת משלוש האפשרויות הללו. כדי לבדוק עד כמה המודלים עקביים, הם חזרו על התהליך עשר פעמים לכל מקרה ולכל מודל, וקיבלו בסך הכל 9,900 המלצות נפרדות.

כמה מדויקות היו גרסאות שונות של ChatGPT?

המודל שהשיג את התוצאה הטובה ביותר במחקר, שנקרא o1-mini, בחר באופציה הנכונה בערך בשלושה רבעים מהמקרים (74%). כמה מהמודלים הקלים או הקטנים יותר עמדו בביצועים פחות טובים באופן ניכר, עם דיוק שירד לכ-44%. כמעט כל המודלים היו טובים מאוד בזיהוי מצבי חירום; בהתחשב בדוגמאות החירום המוגבלות במחקר, הם כמעט תמיד המליצו על טיפול דחוף כשהיה צורך אמיתי בכך. הם גם היו חזקים בזיהוי מקרים אופייניים הדורשים ביקור לא-חירומי אצל רופא. הקושי הגדול ביותר היה בטיפול עצמי. גם המודלים הטובים יותר לעיתים קרובות המליצו לראות רופא כאשר מנוחה, צפייה בסימפטומים והמתנה לכמה ימים היו הולמים.

מדוע ChatGPT נוטה ל"לשחק בזהירות"

בכל המודלים נצפתה נטייה להמלצות דחופות יותר ממה שהרופאים שיפוטו כנדרש. בגרסאות ישנות כמעט שלא הופיעה המלצה על טיפול מועט מדי, והרבה גרסאות חדשות עדיין נטו להרחיק עד זהירות מוגזמת. מבחינת בטיחות, עדיף בדרך כלל להפנות מישהו לרופא מאשר לפספס חירום אמיתי — וזה עשוי להיראות מרגיע. אבל אם מערכת כמעט תמיד תמליץ על איזשהו ביקור רפואי, ההנחיה שלה תהיה פחות שימושית להחלטות היומיומיות — והיא עלולה גם להעמיס על קליניקות ומחלקות חרום. היא עשויה גם להגביר חרדה אצל אנשים שכבר מודאגים, וללמד אותם שגם תסמינים קלים מצדיקים פנייה מקצועית תמידית.

ניצול חוסר העקביות כדי לשפר את הייעוץ

באופן מפתיע, אותו מודל של ChatGPT לא תמיד נתן את אותה תשובה כשהוצג לו אותו סיפור מטופל. על פני מספר ריצות, חלק מהמודלים זזו בין רמות דחיפות שונות עבור אותו מקרה זהה. במקום לראות את חוסר העקביות הזאת רק כחיסרון, החוקרים ניסו לנצל אותה לטובתם. הם שילבו את עשר התשובות החוזרות עבור כל מקרה בכמה דרכים. כאשר בחרו את ההמלצה הפחות דחופה שהופיעה בין אותן עשר ריצות, הדיוק הכולל עלה בכארבע נקודות אחוז בערך, וההמלצות הנכונות לטיפול עצמי זינקו אף יותר. במילים אחרות, כאשר מודל לעיתים המליץ על טיפול עצמי ולעיתים על ביקור אצל רופא עבור מקרה קל זהה, אמון בהצעה בעלת רמת הדחיפות הנמוכה ביותר הביא לעיתים קרובות את הייעוץ להיות קרוב יותר לשיקול דעת הרופאים.

מה משמעות הדבר לאנשים המשתמשים בבינה מלאכותית לקבלת החלטות בריאותיות

המסקנה העיקרית של המחקר היא שמודלים של ChatGPT כיום יכולים לסייע בזיהוי מצבי חירום ברורים, אך הם עדיין אינם אמינים דיים כדי להנחות החלטות חיפוש טיפול באופן עצמאי — במיוחד כאשר הבחירה היא בין לראות רופא להישאר בבית. מודלים "היסקיים" חדשים יותר נוטים יותר ומעט טובים יותר בזיהוי מקרים שבהם טיפול עצמי מספיק, אך הביצועים שלהם עדיין רחוקים ממושלמים. טכניקות שמאחדות מספר תשובות מאותו מודל עשויות לעזור למפתחים לבנות כלים בטוחים יותר בעתיד. לעת עתה, אנשים צריכים להתייחס לייעוץ בסגנון מיון של ChatGPT כאמצעי מידע אחד מתוך רבים, ולא כמחליף להוראות חירום מקומיות, לייעוץ רפואי מקצועי או לשיקול דעת אישי.

ציטוט: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

מילות מפתח: chatgpt, מיון עצמי, טיפול בחירום, ייעוץ בריאותי, בינה מלאכותית