Clear Sky Science · pt

Avaliação da precisão das versões do modelo ChatGPT ao dar conselhos sobre busca de atendimento

Por que este estudo importa para decisões de saúde do dia a dia

Cada vez mais pessoas fazem a ferramentas como o ChatGPT uma pergunta aparentemente simples: “Preciso ir à emergência, consultar um médico ou posso ficar em casa e esperar?” Este estudo coloca 22 versões do ChatGPT à prova exatamente nessa decisão. As descobertas interessam a qualquer pessoa tentada a confiar na inteligência artificial em vez de ligar para uma clínica, uma linha de enfermagem ou um médico de confiança.

Como os pesquisadores testaram os conselhos médicos do ChatGPT

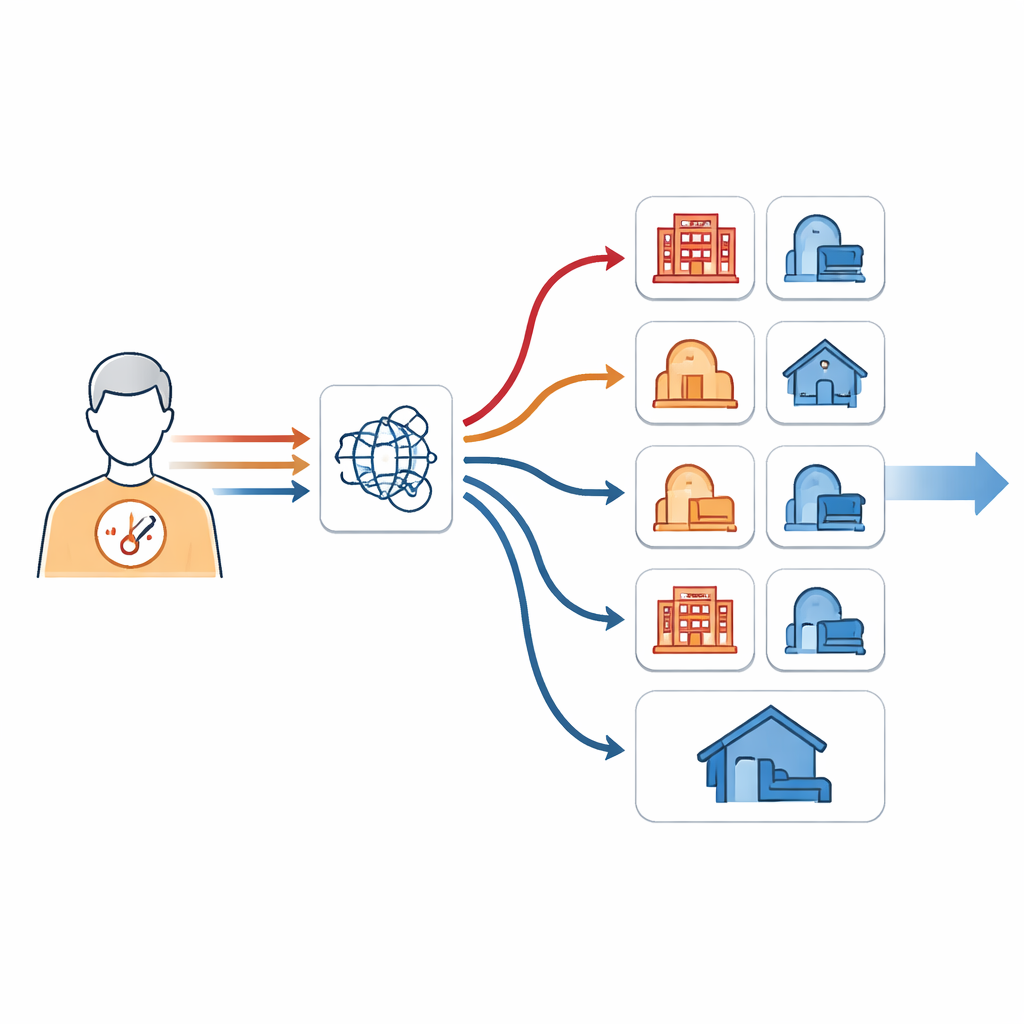

Em vez de pacientes em tempo real, a equipe usou 45 relatos de pacientes cuidadosamente elaborados, ou vinhetas, extraídos de pessoas reais que haviam procurado online onde deveriam buscar atendimento. Cada história já havia sido avaliada por dois médicos, que concordaram se o caso demandava atendimento de emergência, uma consulta médica não urgente ou autocuidado simples em casa. Os pesquisadores então pediram a todas as versões disponíveis do ChatGPT — incluindo modelos mais antigos e os mais recentes com “capacidade de raciocínio” — que escolhessem uma entre essas três opções. Para avaliar a consistência dos modelos, repetiram esse processo dez vezes por caso e por modelo, totalizando 9.900 recomendações separadas.

Quão precisas foram as diferentes versões do ChatGPT?

O modelo com melhor desempenho no estudo, chamado o1-mini, escolheu a opção correta em cerca de três quartos das vezes (74%). Alguns modelos menores ou mais leves tiveram desempenho visivelmente inferior, com a acurácia caindo para cerca de 44%. Quase todos os modelos foram muito bons em identificar emergências; com os exemplos de emergência disponíveis, eles quase sempre sugeriram atendimento urgente quando isso realmente era necessário. Também foram eficazes em casos típicos de consultas médicas não emergenciais. A maior dificuldade ocorreu com o autocuidado. Mesmo os modelos melhores frequentemente recomendaram ver um médico quando descansar, observar os sintomas e esperar alguns dias teria sido apropriado.

Por que o ChatGPT tende a “jogar pelo seguro”

De maneira geral, os modelos tenderam a aconselhar ações mais urgentes do que os médicos consideraram necessárias. Versões mais antigas quase nunca sugeriam cuidados insuficientes, e muitas das mais novas ainda erraram fortemente pelo lado da cautela. Do ponto de vista da segurança, favorecer a cautela pode parecer tranquilizador: em geral é melhor encaminhar alguém a um médico do que deixar passar uma emergência verdadeira. Mas se um sistema quase sempre aconselha algum tipo de visita médica, sua orientação se torna menos útil para decisões do cotidiano — e pode contribuir para a lotação de clínicas e serviços de emergência. Também pode aumentar a ansiedade de pessoas já preocupadas, ensinando-as a acreditar que até sintomas leves sempre merecem atenção profissional.

Aproveitando a inconsistência para melhorar os conselhos

Surpreendentemente, o mesmo modelo do ChatGPT nem sempre deu a mesma resposta quando recebeu a mesma história de paciente. Em execuções múltiplas, alguns modelos oscilaram entre diferentes níveis de urgência para o mesmo caso idêntico. Em vez de tratar essa inconsistência apenas como um defeito, os pesquisadores tentaram usá-la a seu favor. Eles combinaram as dez respostas repetidas para cada caso de várias maneiras. Quando selecionaram a recomendação de menor urgência que apareceu entre aquelas dez execuções, a acurácia geral aumentou em cerca de quatro pontos percentuais, e as sugestões corretas de autocuidado subiram ainda mais. Em outras palavras, quando um modelo às vezes recomendava autocuidado e às vezes uma consulta médica para o mesmo caso leve, confiar na sugestão de menor urgência frequentemente aproximava o conselho do julgamento dos médicos.

O que isso significa para quem usa IA em decisões de saúde

A conclusão do estudo é que os modelos atuais do ChatGPT podem ser úteis para reconhecer emergências claras, mas ainda não são suficientemente confiáveis para orientar decisões sobre busca de atendimento por conta própria — especialmente quando a escolha é entre ver um médico ou permanecer em casa. Modelos mais recentes com “capacidade de raciocínio” mostram maior disposição e alguma melhora em reconhecer quando o autocuidado basta, mas seu desempenho ainda está longe do ideal. Técnicas que combinam múltiplas respostas do mesmo modelo podem ajudar desenvolvedores a criar ferramentas mais seguras no futuro. Por enquanto, as pessoas devem tratar o aconselhamento do ChatGPT estilo triagem como uma entre várias entradas, e não como substituto das instruções locais de emergência, do aconselhamento médico profissional ou do próprio bom senso.

Citação: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Palavras-chave: chatgpt, auto-triagem, atendimento de emergência, aconselhamento em saúde, inteligência artificial