Clear Sky Science · de

Bewertung der Genauigkeit von ChatGPT-Modellversionen bei der Beratung zur Inanspruchnahme von medizinischer Versorgung

Warum diese Studie für alltägliche Gesundheitsentscheidungen wichtig ist

Immer mehr Menschen stellen Werkzeugen wie ChatGPT eine scheinbar einfache Frage: „Brauche ich die Notaufnahme, einen Arzttermin oder kann ich zu Hause bleiben und abwarten?“ Diese Studie prüft 22 Versionen von ChatGPT genau bei dieser Entscheidung. Die Ergebnisse sind relevant für alle, die versucht sind, sich auf künstliche Intelligenz zu verlassen statt eine Klinik, eine Pflegehotline oder einen vertrauten Arzt anzurufen.

Wie die Forschenden ChatGPTs medizinische Beratung getestet haben

Anstatt Echtpatienten zu verwenden, nutzte das Team 45 sorgfältig gestaltete Patientengeschichten, sogenannte Vignetten, die von realen Personen stammten, die online gefragt hatten, wo sie Hilfe suchen sollten. Jede Geschichte war bereits von zwei Ärztinnen oder Ärzten beurteilt worden, die sich darauf geeinigt hatten, ob sie eine Notfallbehandlung, einen nicht dringlichen Arztbesuch oder einfache Selbstversorgung zu Hause erforderte. Die Forschenden baten dann jede verfügbare ChatGPT-Version – einschließlich älterer Modelle und neuerer „Reasoning“-Modelle – eine dieser drei Optionen zu wählen. Um die Konsistenz der Modelle zu prüfen, wiederholten sie diesen Prozess zehnmal pro Fall und pro Modell, was am Ende 9.900 separate Empfehlungen ergab.

Wie genau waren die verschiedenen ChatGPT-Versionen?

Das im Studium am besten abschneidende Modell, genannt o1-mini, wählte in etwa dreiviertel der Fälle die richtige Option (74 %). Einige kleinere oder weniger leistungsstarke Modelle schnitten deutlich schlechter ab, mit einer Genauigkeit von nur etwa 44 %. Fast alle Modelle waren sehr gut darin, Notfälle zu erkennen; angesichts der begrenzten Anzahl von Notfallbeispielen schlugen sie fast immer eine dringende Versorgung vor, wenn diese tatsächlich nötig war. Sie zeigten auch starke Leistungen bei typischen nicht dringenden Arztbesuchen. Die größte Schwierigkeit bestand bei der Selbstversorgung: Selbst die besseren Modelle empfahlen oft einen Arztbesuch, obwohl Ausruhen, Beobachten der Symptome und Abwarten von einigen Tagen angemessen gewesen wären.

Warum ChatGPT dazu neigt, „auf Nummer sicher zu gehen“

Über alle Modelle hinweg tendierten die Empfehlungen zu dringenderen Maßnahmen als von den Ärztinnen und Ärzten beurteilt. Ältere Versionen schlugen fast nie zu wenig Versorgung vor, und viele neuere wichen weiterhin stark auf der Seite der Vorsicht aus. Aus Sicherheitsgesichtspunkten mag eine vorsichtige Haltung beruhigend wirken: Es ist in der Regel besser, jemanden zu einem Arzt zu schicken, als einen echten Notfall zu übersehen. Wenn ein System jedoch nahezu immer irgendeine Form von medizinischem Besuch empfiehlt, wird seine Anleitung für Alltagsentscheidungen weniger nützlich – und kann zur Überfüllung von Kliniken und Notaufnahmen beitragen. Zudem kann es Ängste bei bereits besorgten Menschen schüren, indem es ihnen vermittelt, dass selbst leichte Symptome immer professionelle Aufmerksamkeit erfordern.

Die Inkonsistenz nutzen, um die Beratung zu verbessern

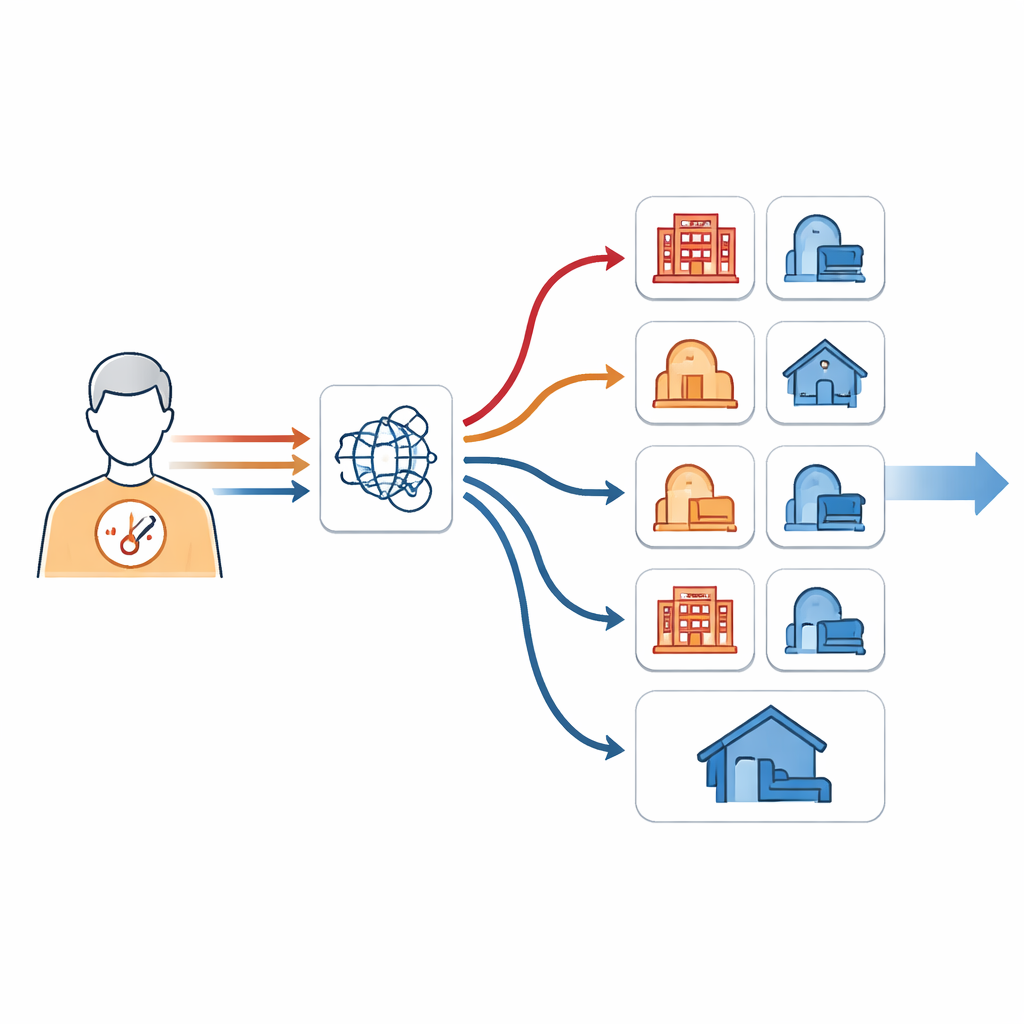

Unerwartet gab dasselbe ChatGPT-Modell nicht immer dieselbe Antwort, wenn ihm dieselbe Patientengeschichte erneut gezeigt wurde. Bei mehreren Durchläufen wechselten einige Modelle zwischen verschiedenen Dringlichkeitsstufen für denselben Fall. Statt diese Inkonsistenz nur als Fehler zu betrachten, versuchten die Forschenden, sie zu ihrem Vorteil zu nutzen. Sie kombinierten die zehn wiederholten Antworten pro Fall auf verschiedene Weisen. Wenn sie die am wenigsten dringliche Empfehlung auswählten, die in diesen zehn Durchläufen vorkam, stieg die Gesamtgenauigkeit um etwa vier Prozentpunkte, und die korrekten Selbstversorgungs-Empfehlungen nahmen noch stärker zu. Anders gesagt: Wenn ein Modell für denselben milden Fall manchmal Selbstversorgung und manchmal einen Arztbesuch empfahl, kam man der ärztlichen Einschätzung oft näher, wenn man der niedrigsten Dringlichkeitsstufe vertraute.

Was das für Menschen bedeutet, die KI für Gesundheitsentscheidungen nutzen

Die Quintessenz der Studie ist, dass aktuelle ChatGPT-Modelle beim Erkennen klarer Notfälle hilfreich sein können, aber noch nicht zuverlässig genug sind, um Entscheidungen zur Inanspruchnahme von Versorgung allein zu treffen – besonders wenn die Wahl zwischen Arztbesuch und Zu-Hause-Bleiben besteht. Neuere „Reasoning“-Modelle zeigen eher und etwas besser an, wann Selbstversorgung ausreicht, aber ihre Leistung ist noch weit von perfekt entfernt. Techniken, die mehrere Antworten desselben Modells kombinieren, könnten Entwicklerinnen und Entwicklern helfen, künftig sicherere Werkzeuge zu bauen. Bis dahin sollten Menschen ChatGPT-Triage-Ratschläge als einen von mehreren Informationsquellen ansehen, nicht als Ersatz für lokale Notfallhinweise, professionelle medizinische Beratung oder den eigenen gesunden Menschenverstand.

Zitation: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Schlüsselwörter: chatgpt, selbsttriage, Notfallversorgung, gesundheitsberatung, künstliche intelligenz