Clear Sky Science · it

Valutare l’accuratezza delle versioni del modello ChatGPT nel dare consigli su dove cercare cure

Perché questo studio è importante per le scelte di salute di tutti i giorni

Sempre più persone pongono a strumenti come ChatGPT una domanda apparentemente semplice: “Devo andare al pronto soccorso, a una visita medica o posso restare a casa e aspettare?” Questo studio mette alla prova 22 versioni di ChatGPT proprio su quella decisione. I risultati sono rilevanti per chiunque sia tentato di affidarsi all’intelligenza artificiale invece di chiamare una clinica, una linea infermieristica o un medico di fiducia.

Come i ricercatori hanno testato i consigli medici di ChatGPT

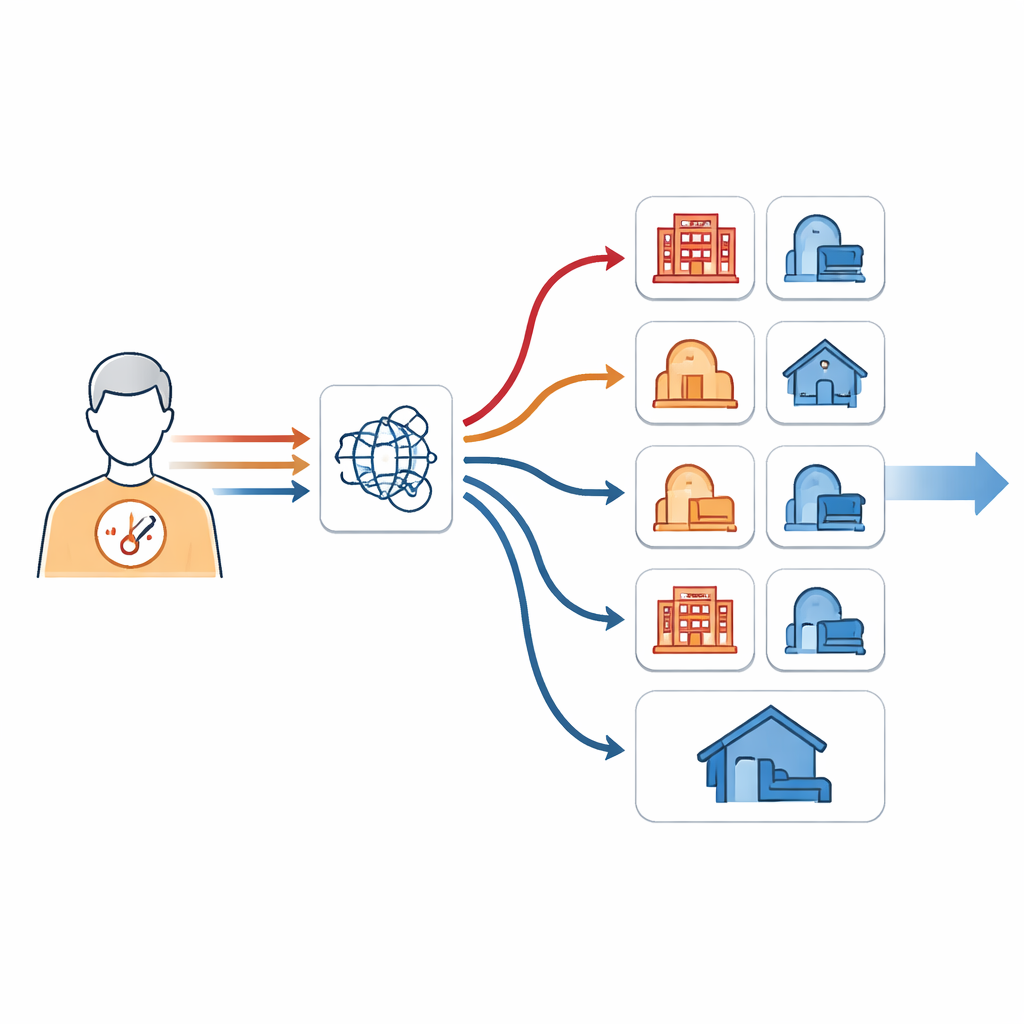

Al posto di pazienti reali, il team ha usato 45 storie-paziente curate, o vignette, ricavate da persone reali che avevano chiesto online dove rivolgersi per le cure. Ogni storia era già stata valutata da due medici, che concordavano se richiedeva un trattamento d’emergenza, una visita non urgente dal medico o semplice auto-cura a casa. I ricercatori hanno quindi chiesto a ogni versione disponibile di ChatGPT — incluse versioni più vecchie e modelli più recenti “con capacità di ragionamento” — di scegliere una delle tre opzioni. Per verificare la consistenza dei modelli, hanno ripetuto il processo dieci volte per caso e per modello, ottenendo in totale 9.900 raccomandazioni separate.

Quanto erano accurate le diverse versioni di ChatGPT?

Il modello con le migliori prestazioni nello studio, chiamato o1-mini, ha scelto l’opzione corretta circa tre quarti delle volte (74%). Alcuni modelli più piccoli o leggeri hanno fatto peggio, con l’accuratezza che scende fino a circa il 44%. Quasi tutti i modelli sono stati molto bravi a individuare le emergenze; con il numero limitato di esempi di emergenza a disposizione, quasi sempre suggerivano cure urgenti quando erano davvero necessarie. Si sono comportati bene anche nelle visite mediche non urgenti tipiche. La difficoltà maggiore è emersa per l’auto-cura: anche i modelli migliori spesso raccomandavano di vedere un medico quando sarebbe stato appropriato limitarsi a riposare, osservare i sintomi e attendere qualche giorno.

Perché ChatGPT tende a «giocare sul sicuro»

In generale, i modelli tendono a fornire consigli più urgenti di quanto i medici ritengano necessari. Le versioni più vecchie quasi mai suggerivano cure insufficienti, e molte delle versioni più recenti continuano a sbilanciarsi verso un eccesso di cautela. Da un punto di vista della sicurezza, favorire la prudenza può risultare rassicurante: in genere è meglio mandare qualcuno dal medico che non riconoscere una vera emergenza. Ma se un sistema consiglia quasi sempre qualche forma di visita medica, la sua guida diventa meno utile per le decisioni quotidiane — e potrebbe aumentare l’affollamento in ambulatori e pronto soccorso. Può anche alimentare l’ansia in persone già preoccupate, insegnando loro che anche sintomi lievi richiedono sempre attenzione professionale.

Usare l’incoerenza per migliorare i consigli

Sorprendentemente, lo stesso modello ChatGPT non sempre dava la stessa risposta quando gli veniva presentata la stessa storia-paziente. Su più esecuzioni, alcuni modelli oscillavano tra diversi livelli di urgenza per lo stesso caso identico. Invece di considerare quest’incoerenza solo come un difetto, i ricercatori hanno provato a sfruttarla. Hanno combinato le dieci risposte ripetute per ciascun caso in diversi modi. Quando hanno scelto la raccomandazione meno urgente comparsa tra quelle dieci esecuzioni, l’accuratezza complessiva è aumentata di circa quattro punti percentuali, e i suggerimenti corretti di auto-cura sono cresciuti ancora di più. In altre parole, quando un modello a volte raccomandava l’auto-cura e a volte la visita medica per lo stesso caso lieve, fidarsi della proposta a minore urgenza spesso avvicinava il consiglio al giudizio dei medici.

Cosa significa per chi usa l’IA per decisioni sanitarie

La conclusione dello studio è che gli attuali modelli di ChatGPT possono essere utili per riconoscere emergenze chiare, ma non sono ancora abbastanza affidabili da guidare da soli le decisioni su dove cercare cure — specialmente quando la scelta è tra vedere un medico e restare a casa. I modelli più recenti “con capacità di ragionamento” sono più inclini e leggermente migliori nel riconoscere quando l’auto-cura è sufficiente, ma le loro prestazioni sono ancora lontane dalla perfezione. Tecniche che combinano più risposte dallo stesso modello potrebbero aiutare gli sviluppatori a costruire strumenti più sicuri in futuro. Per ora, le persone dovrebbero considerare i consigli di triage forniti da ChatGPT come un elemento informativo tra molti, non come un sostituto delle istruzioni locali per le emergenze, del parere medico professionale o del proprio buon senso.

Citazione: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Parole chiave: chatgpt, auto-triage, pronto soccorso, consigli sanitari, intelligenza artificiale