Clear Sky Science · pl

Ocena dokładności wersji modelu ChatGPT w udzielaniu porad dotyczących zgłaszania się po pomoc medyczną

Dlaczego to badanie ma znaczenie dla codziennych decyzji zdrowotnych

Coraz więcej osób zadaje narzędziom takim jak ChatGPT pozornie proste pytanie: „Czy muszę iść na ostry dyżur, do lekarza, czy mogę zostać w domu i poczekać?” To badanie wystawia na próbę 22 wersje ChatGPT właśnie w tej decyzji. Wyniki są istotne dla każdego, kto rozważa poleganie na sztucznej inteligencji zamiast dzwonić do przychodni, infolinii pielęgniarskiej czy zaufanego lekarza.

Jak badacze testowali porady medyczne ChatGPT

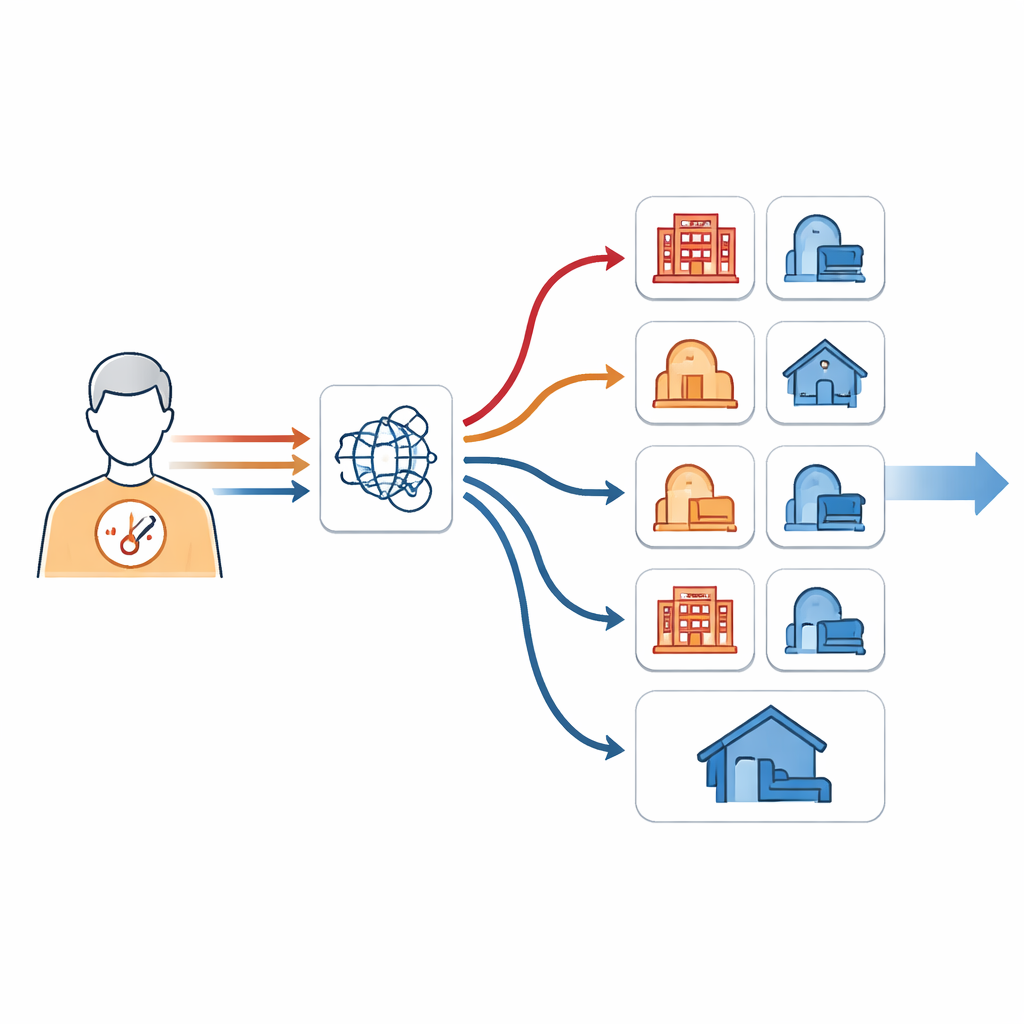

Zamiast pacjentów w czasie rzeczywistym zespół użył 45 starannie opracowanych historii pacjentów, czyli winiet, zaczerpniętych od prawdziwych osób, które pytały online, gdzie powinny szukać pomocy. Każdą historię ocenili wcześniej dwaj lekarze, którzy zgodzili się, czy wymaga ona leczenia w trybie nagłym, pilnej wizyty lekarskiej, czy prostego samodzielnego postępowania w domu. Badacze poprosili następnie każdą dostępną wersję ChatGPT — w tym starsze modele i nowsze modele „rozumujące” — o wybranie jednej z tych trzech opcji. Aby sprawdzić spójność modeli, powtórzyli ten proces dziesięć razy dla każdego przypadku i modelu, uzyskując w sumie 9 900 oddzielnych rekomendacji.

Jak dokładne były różne wersje ChatGPT?

Najlepiej radzący sobie model w badaniu, o nazwie o1-mini, wybrał prawidłową opcję około trzech czwartych przypadków (74%). Niektóre mniejsze lub lżejsze modele wypadły wyraźnie gorzej, ze spadkiem dokładności do około 44%. Prawie wszystkie modele bardzo dobrze rozpoznawały stany nagłe; przy ograniczonej liczbie przykładów nagłych sytuacji niemal zawsze sugerowały pilną opiekę, gdy była ona faktycznie potrzebna. Były też silne w typowych, niepilnych wizytach lekarskich. Największym problemem była opieka domowa. Nawet lepsze modele często zalecały wizytę u lekarza, gdy odpowiednie byłoby po prostu odpoczywanie, obserwacja objawów i odczekanie kilku dni.

Dlaczego ChatGPT ma tendencję do „grania bezpiecznie”

Modele generalnie skłaniały się ku bardziej pilnym zaleceniom niż oceniali to lekarze. Starsze wersje prawie nigdy nie sugerowały zbyt małej opieki, a wiele nowszych nadal mocno chybiło w stronę ostrożności. Z punktu widzenia bezpieczeństwa faworyzowanie ostrożności może wydawać się uspokajające: na ogół lepiej skierować kogoś do lekarza, niż przegapić prawdziwy stan nagły. Jednak jeśli system niemal zawsze doradza jakąś formę wizyty medycznej, jego wskazania stają się mniej użyteczne w codziennych decyzjach — i mogą zwiększać zatłoczenie w przychodniach i oddziałach ratunkowych. Może to także podsycać niepokój u osób już zmartwionych, ucząc ich, że nawet łagodne objawy zawsze wymagają profesjonalnej uwagi.

Wykorzystanie niespójności do poprawy porad

Zaskakująco, ten sam model ChatGPT nie zawsze dawał tę samą odpowiedź na tę samą historię pacjenta. W kolejnych uruchomieniach niektóre modele przełączały się między różnymi poziomami pilności dla identycznego przypadku. Zamiast traktować tę niespójność wyłącznie jako wadę, badacze próbowali wykorzystać ją na swoją korzyść. Połączyli dziesięć powtórzonych odpowiedzi dla każdego przypadku na kilka sposobów. Gdy wybierali najmniej pilne zalecenie, które pojawiło się w tych dziesięciu uruchomieniach, ogólna dokładność wzrosła o około cztery punkty procentowe, a prawidłowe sugestie samopomocy wzrosły jeszcze bardziej. Innymi słowy, gdy model czasami rekomendował samopomoc, a czasami wizytę u lekarza dla tego samego łagodnego przypadku, zaufanie najniżej pilnej sugestii często przybliżało poradę do oceny lekarzy.

Co to oznacza dla osób korzystających z AI przy decyzjach zdrowotnych

Wniosek z badania jest taki, że obecne modele ChatGPT mogą być pomocne w rozpoznawaniu wyraźnych stanów nagłych, ale nie są jeszcze wystarczająco wiarygodne, by samodzielnie kierować decyzjami o poszukaniu pomocy — zwłaszcza gdy wybór dotyczy wizyty u lekarza lub pozostania w domu. Nowsze modele „rozumujące” są bardziej skłonne i nieco lepsze w rozpoznawaniu, kiedy samodzielna opieka wystarczy, ale ich wydajność wciąż jest daleka od ideału. Techniki łączące wiele odpowiedzi z tego samego modelu mogą pomóc deweloperom w tworzeniu bezpieczniejszych narzędzi w przyszłości. Na razie ludzie powinni traktować porady triage-owe ChatGPT jako jedno z wielu źródeł informacji, a nie jako zastępstwo lokalnych instrukcji dotyczących nagłych wypadków, profesjonalnej porady medycznej czy zdrowego rozsądku.

Cytowanie: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Słowa kluczowe: chatgpt, samotriage, opieka ratunkowa, porady zdrowotne, sztuczna inteligencja