Clear Sky Science · ar

تقييم دقة إصدارات نموذج ChatGPT في تقديم نصائح طلب الرعاية

لماذا تهم هذه الدراسة قرارات الصحة اليومية

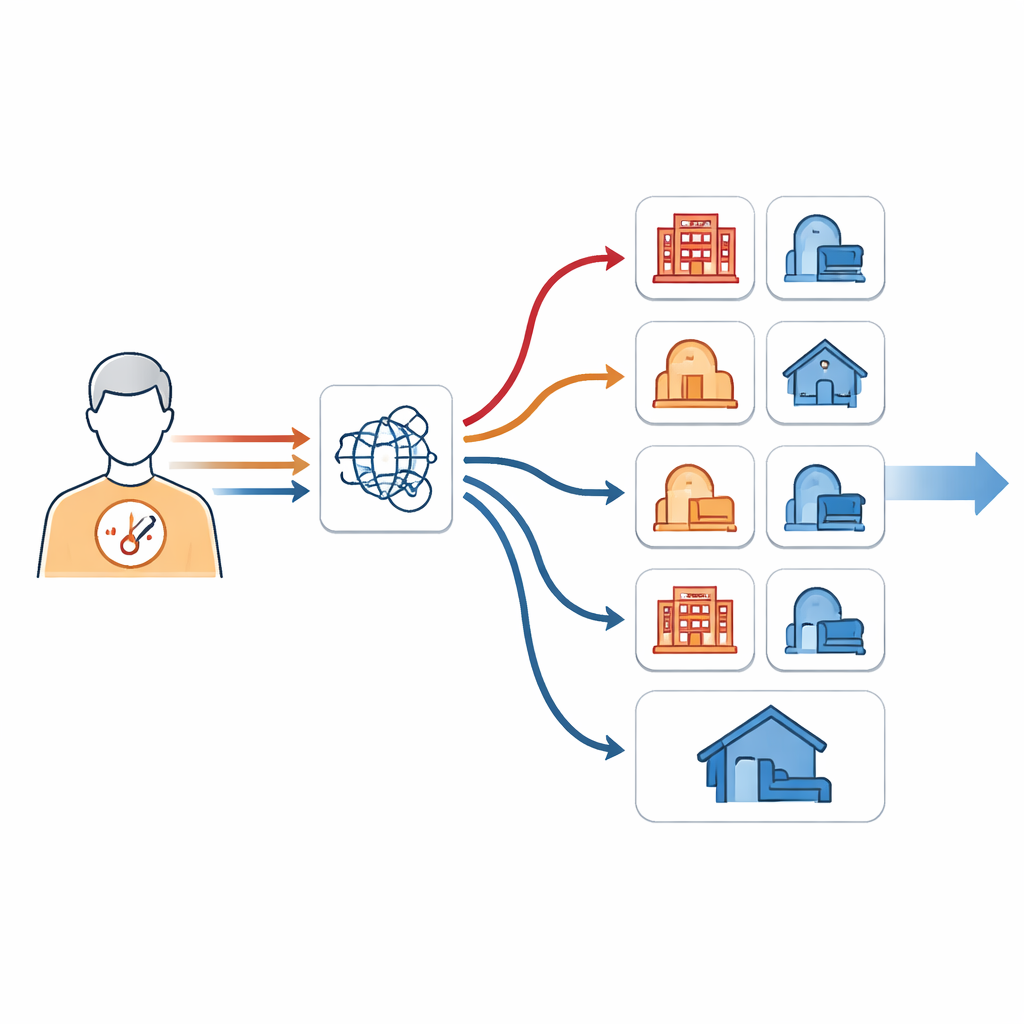

يزداد عدد الأشخاص الذين يطرحون على أدوات مثل ChatGPT سؤالاً يبدو بسيطًا: «هل أحتاج إلى غرفة الطوارئ، زيارة الطبيب، أم يمكنني البقاء في المنزل والانتظار؟» تختبر هذه الدراسة 22 إصدارًا من ChatGPT على هذا القرار بالذات. النتائج تهم أي شخص يفكر في الاعتماد على الذكاء الاصطناعي بدلًا من الاتصال بعيادة، خط مساعدة التمريض، أو الطبيب الموثوق.

كيف اختبر الباحثون نصائح ChatGPT الطبية

بدلاً من استخدام مرضى في الوقت الحقيقي، اعتمد الفريق على 45 قصة مريض مصممة بعناية، أو حالات افتراضية، مأخوذة من أشخاص حقيقيين الذين توجهوا عبر الإنترنت ليسألوا أين عليهم طلب الرعاية. كل قصة كانت قد حُكم عليها سابقًا من قِبل طبيبين متفقين على ما إذا كانت تستدعي علاجًا طارئًا، زيارة غير عاجلة للطبيب، أم رعاية ذاتية بسيطة في المنزل. ثم طلب الباحثون من كل إصدار متاح من ChatGPT — بما في ذلك النماذج الأقدم والنماذج «المنطقية» الأحدث — أن يختار واحدًا من هذه الخيارات الثلاثة. وللتحقق من اتساق النماذج، كرروا هذه العملية عشر مرات لكل حالة ولكل نموذج، فنتج عن ذلك 9,900 توصية منفصلة.

ما مدى دقة إصدارات ChatGPT المختلفة؟

النموذج الأفضل أداءً في الدراسة، المسمى o1-mini، اختار الخيار الصحيح حوالي ثلاثة أرباع الوقت (74%). بعض النماذج الأصغر أو الأخف وزناً أدت أداءً أقل بشكل ملحوظ، حيث انحدرت الدقة إلى حوالي 44%. كانت معظم النماذج جيدة جدًا في اكتشاف الحالات الطارئة؛ مع عدد محدود من أمثلة الطوارئ المتاحة، كانت تقترح العناية العاجلة تقريبًا دائماً عندما كانت مطلوبة فعلاً. كما كانت قوية بالنسبة لزيارات الأطباء غير الطارئة الاعتيادية. أما أكبر صعوبة فكانت مع الرعاية الذاتية. حتى النماذج الأفضل كانت كثيرًا ما توصي بزيارة الطبيب حينما كان الراحة ومراقبة الأعراض والانتظار لبضعة أيام سيكون مناسبًا.

لماذا يميل ChatGPT إلى «اللعب بأمان»

عموماً، الميول كانت نحو تقديم نصائح أكثر إلحاحًا مما حكم عليه الأطباء بأنه ضروري. الإصدارات الأقدم نادراً ما اقترحت رعاية أقل من اللازم، والعديد من الإصدارات الأحدث لا تزال تميل إلى الحذر الشديد. من منظور السلامة، قد يبدو تفضيل الحذر مطمئناً: فغالبًا ما يكون أفضل إرسال شخص إلى الطبيب من تفويت حالة طارئة حقيقية. لكن إذا كان النظام ينصح تقريبًا دائمًا بزيارة طبية، فإن توجيهاته تصبح أقل فائدة للقرارات اليومية — وقد يزيد ذلك من الازدحام في العيادات وغرف الطوارئ. كما يمكن أن يثير قلقًا لدى الأشخاص الذين هم بالفعل قلقون، فيعلمهم أن حتى الأعراض الخفيفة تستلزم دائمًا اهتمامًا مهنيًا.

الاستفادة من عدم الاتساق لتحسين النصائح

بشكل مفاجئ، نفس نموذج ChatGPT لم يكن دائمًا يقدم نفس الإجابة عند عرض قصة مريض متماثلة. عبر عدة محاولات، تحوّلت إجابات بعض النماذج بين مستويات إلحاح مختلفة للحالة نفسها. بدلًا من اعتبار هذا التذبذب خطأً بحتًا، حاول الباحثون استغلاله لصالحهم. جمّعوا الإجابات العشر المتكررة لكل حالة بعدة طرق. عندما اختاروا أقل توصية إلحاحية ظهرت بين تلك المحاولات العشر، ارتفعت الدقة العامة بحوالي أربع نقاط مئوية، وزادت اقتراحات الرعاية الذاتية الصحيحة أكثر من ذلك. بعبارة أخرى، عندما كان النموذج أحيانًا يقترح الرعاية الذاتية وأحيانًا زيارة الطبيب لنفس الحالة الخفيفة، فإن الثقة بأقل مستوى إلحاح غالبًا ما جعلت النصيحة أقرب إلى حكم الأطباء.

ماذا يعني هذا للأشخاص الذين يستخدمون الذكاء الاصطناعي لاتخاذ قرارات صحية

الخلاصة أن نماذج ChatGPT الحالية قد تكون مفيدة في التعرف على الطوارئ الواضحة، لكنها ليست موثوقة بعد لتوجيه قرارات طلب الرعاية بمفردها — خصوصًا عندما يكون الخيار بين رؤية الطبيب والبقاء في المنزل. النماذج «المنطقية» الأحدث أكثر ميلاً وإلى حد ما أفضل في تمييز متى تكفي الرعاية الذاتية، لكن أداؤها لا يزال بعيدًا عن الكمال. قد تساعد تقنيات جمع عدة إجابات من نفس النموذج المطورين على بناء أدوات أكثر أمانًا في المستقبل. في الوقت الحالي، ينبغي على الناس اعتبار نصائح ChatGPT ذات طراز تصنيف الأولويات كإدخال واحد من عدة مداخل، لا كبديل للتعليمات الطارئة المحلية، أو النصيحة الطبية المهنية، أو الحس السليم الشخصي.

الاستشهاد: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

الكلمات المفتاحية: chatgpt, التصنيف الذاتي للحالات, الرعاية الطارئة, نصيحة صحية, الذكاء الاصطناعي