Clear Sky Science · fr

Évaluation de la précision des versions du modèle ChatGPT pour donner des conseils sur où chercher des soins

Pourquoi cette étude compte pour les choix de santé quotidiens

De plus en plus de personnes posent à des outils comme ChatGPT une question apparemment simple : « Dois-je aller aux urgences, consulter un médecin ou puis‑je rester chez moi et attendre ? » Cette étude soumet 22 versions de ChatGPT à l’épreuve de cette décision précise. Les résultats concernent quiconque serait tenté de s’en remettre à l’intelligence artificielle plutôt que d’appeler une clinique, une ligne téléphonique infirmière ou un médecin de confiance.

Comment les chercheurs ont testé les conseils médicaux de ChatGPT

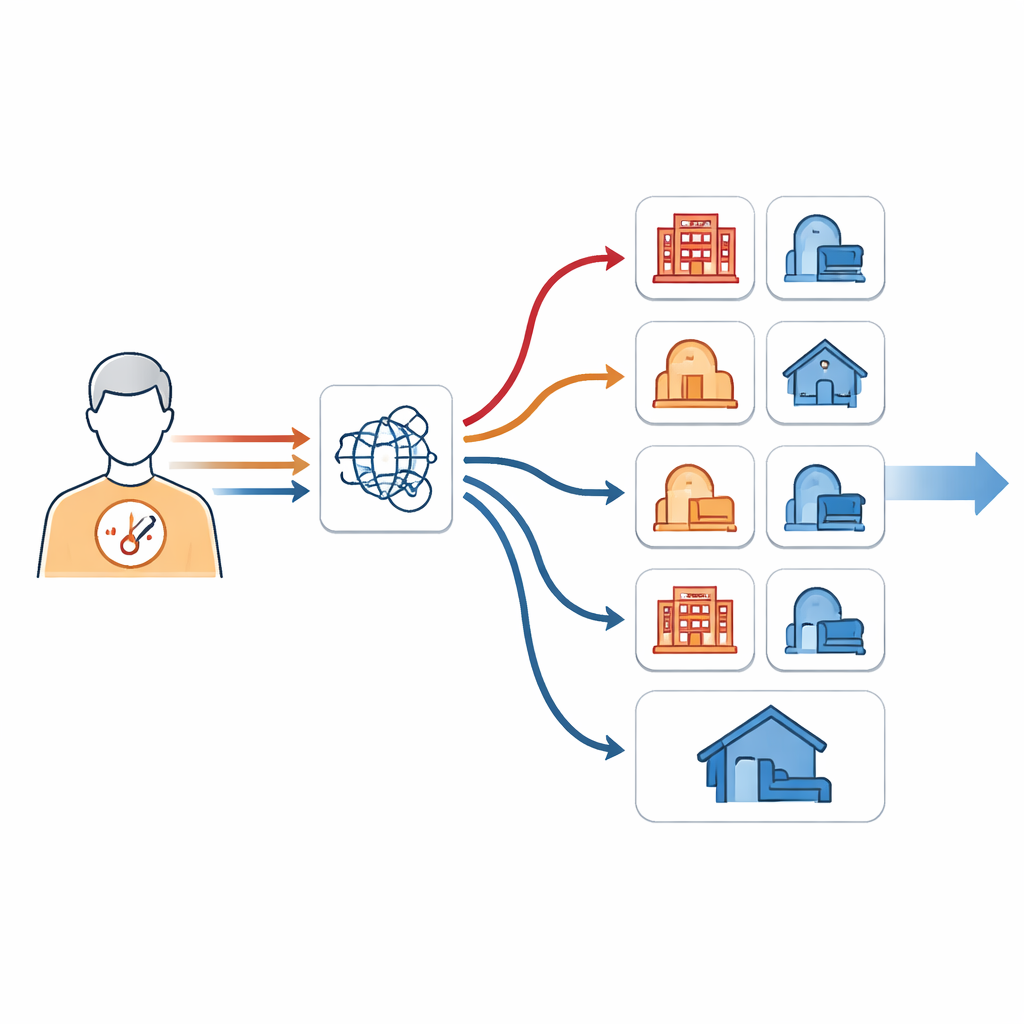

Plutôt que d’utiliser des patients en temps réel, l’équipe a employé 45 récits patients soigneusement conçus, ou vignettes, tirés de personnes réelles ayant demandé en ligne où elles devaient chercher des soins. Chaque histoire avait déjà été évaluée par deux médecins, qui s’étaient accordés pour dire si elle nécessitait un traitement d’urgence, une consultation non urgente chez le médecin, ou simplement des soins à domicile. Les chercheurs ont ensuite demandé à chaque version disponible de ChatGPT — y compris des modèles plus anciens et des modèles « de raisonnement » récents — de choisir l’une de ces trois options. Pour mesurer la cohérence des modèles, ils ont répété ce processus dix fois par cas et par modèle, obtenant au total 9 900 recommandations distinctes.

Quelle a été la précision des différentes versions de ChatGPT ?

Le modèle le plus performant de l’étude, nommé o1-mini, a choisi l’option correcte environ les trois quarts du temps (74 %). Certains modèles plus petits ou plus légers ont fait sensiblement pire, avec une précision tombant autour de 44 %. Presque tous les modèles étaient très performants pour repérer les urgences ; compte tenu du nombre limité d’exemples d’urgence disponibles, ils ont presque toujours recommandé des soins urgents quand c’était réellement nécessaire. Ils étaient également fiables pour les consultations médicales non urgentes typiques. La plus grande difficulté concernait les soins à domicile. Même les meilleurs modèles ont souvent recommandé de consulter un médecin alors que se reposer, surveiller les symptômes et attendre quelques jours aurait été approprié.

Pourquoi ChatGPT a tendance à « jouer la sécurité »

Globalement, les modèles penchaient vers des conseils plus urgents que ce que les médecins jugeaient nécessaires. Les versions anciennes suggéraient presque jamais des soins insuffisants, et beaucoup de versions récentes restaient fortement prudentes. Du point de vue de la sécurité, privilégier la prudence peut sembler rassurant : il vaut généralement mieux orienter quelqu’un vers un médecin que de manquer une véritable urgence. Mais si un système conseille presque toujours une forme de visite médicale, son utilité pour les décisions quotidiennes diminue — et cela peut contribuer à la congestion des cabinets et des services d’urgence. Cela peut aussi alimenter l’anxiété de personnes déjà inquiètes, en leur apprenant que même des symptômes mineurs nécessitent toujours une attention professionnelle.

Utiliser l’incohérence pour améliorer les conseils

De façon surprenante, un même modèle ChatGPT ne donnait pas toujours la même réponse face à la même vignette patient. Sur plusieurs exécutions, certains modèles basculaient entre différents niveaux d’urgence pour un cas identique. Plutôt que de considérer cette incohérence uniquement comme un défaut, les chercheurs ont essayé d’en tirer parti. Ils ont combiné les dix réponses répétées pour chaque cas de plusieurs manières. Quand ils retenaient la recommandation la moins urgente apparaissant parmi ces dix exécutions, la précision globale augmentait d’environ quatre points de pourcentage, et les suggestions correctes de soins à domicile progressaient davantage. Autrement dit, lorsqu’un modèle recommandait parfois les soins à domicile et parfois la visite chez le médecin pour un même cas bénin, faire confiance à la suggestion de moindre urgence rapprochait souvent le conseil du jugement médical.

Ce que cela signifie pour les personnes qui utilisent l’IA pour des décisions de santé

La conclusion de l’étude est que les modèles ChatGPT actuels peuvent aider à reconnaître les urgences évidentes, mais ne sont pas encore suffisamment fiables pour orienter seuls des décisions de recherche de soins — en particulier lorsqu’il s’agit de choisir entre consulter un médecin et rester chez soi. Les modèles « de raisonnement » plus récents sont plus enclins et un peu meilleurs pour reconnaître quand les soins à domicile suffisent, mais leurs performances restent loin d’être parfaites. Des techniques combinant plusieurs réponses du même modèle pourraient aider les développeurs à créer des outils plus sûrs à l’avenir. Pour l’instant, les utilisateurs devraient considérer les conseils de triage de ChatGPT comme une information parmi d’autres, et non comme un substitut aux consignes locales d’urgence, à un avis médical professionnel ou à leur propre bon sens.

Citation: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Mots-clés: chatgpt, auto-triage, soins d'urgence, conseils de santé, intelligence artificielle