Clear Sky Science · ja

ケア受診アドバイスを行うChatGPTモデルのバージョン別精度の評価

日常の健康判断でこの研究が重要な理由

ますます多くの人々がChatGPTのようなツールに一見単純な質問を投げかけています:「救急外来に行くべきか、医師の受診が必要か、それとも自宅で様子を見てよいか?」本研究は正確にその判断を、22のChatGPTバージョンで検証しました。この結果は、診療所や看護師のホットライン、信頼できる医師に電話する代わりに人工知能に頼ろうとしている人々にとって重要です。

研究者たちはどのようにChatGPTの医療アドバイスを検証したか

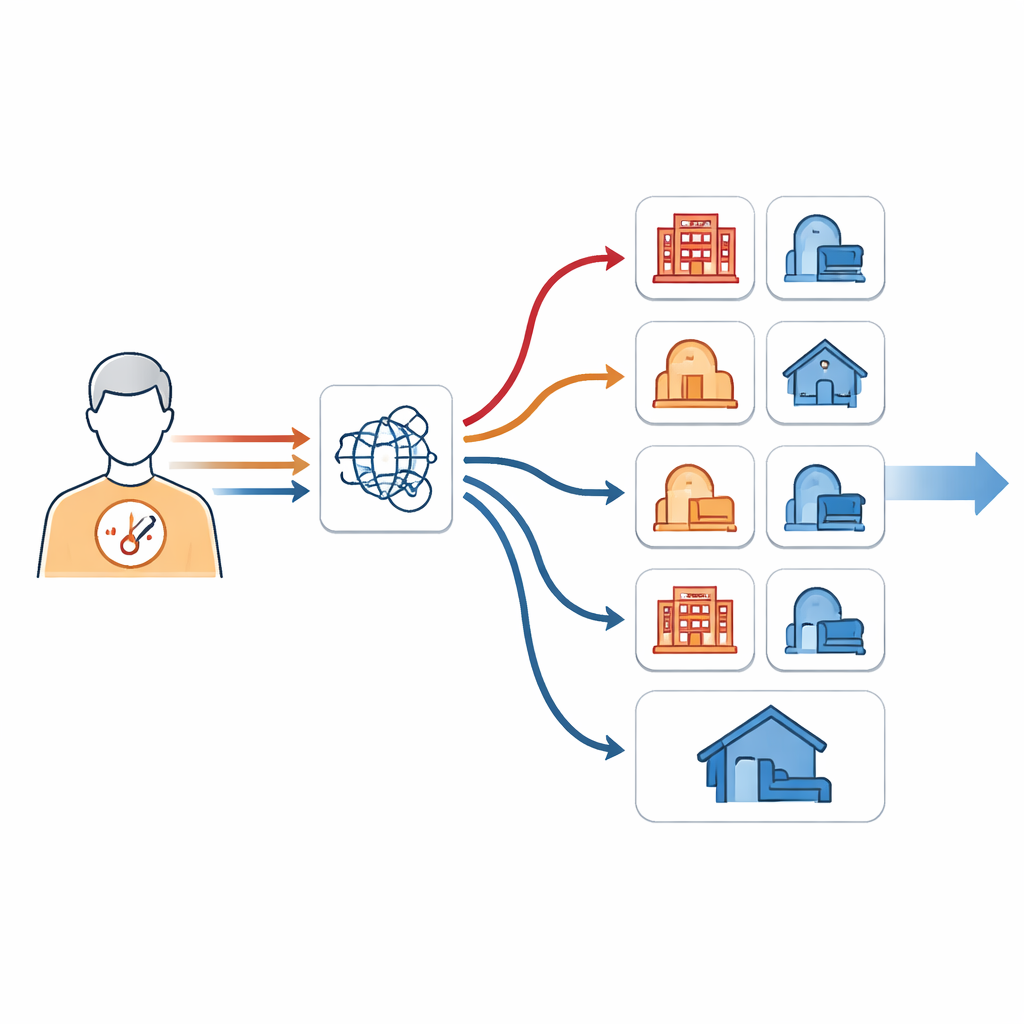

リアルタイムの患者ではなく、研究チームはオンラインで受診先を尋ねた実際の人々に基づく、注意深く作成された45の患者ストーリー(ヴィネット)を用いました。それぞれのストーリーは二人の医師が審査し、救急治療が必要か、緊急性の低い医師受診が必要か、あるいは家庭での自己管理でよいかのいずれかに合意していました。研究者は次に、旧モデルや新しい「推論」モデルを含む利用可能なすべてのChatGPTバージョンに対して、これら三つの選択肢のいずれかを選ばせました。モデルの一貫性を確認するために、各ケースと各モデルでこの手順を10回繰り返し、合計9,900件の別々の推奨を得ました。

ChatGPTの各バージョンはどれくらい正確だったか?

研究で最も良好だったモデル「o1-mini」は、約4分の3(74%)の確率で正しい選択肢を選びました。より小型や軽量のモデルでは精度が大きく低下し、おおむね44%程度まで落ちるものもありました。ほとんどのモデルは救急の見分けには非常に優れており、限られた救急例においては真に緊急を要するときにほぼ常に緊急対応を勧めました。典型的な非緊急の医師受診についても強みを示しました。最も苦戦したのは自己管理の判断で、より優れたモデルでも、安静にし症状を観察して数日待つだけでよい場合に医師受診を勧めてしまうことがしばしばありました。

なぜChatGPTは「安全側」を取る傾向があるのか

全体として、モデルは医師の評価よりもより緊急度の高い助言に偏る傾向がありました。古いバージョンはほとんど過小な助言を示さず、多くの新しいバージョンも依然として過度に慎重に振る舞っていました。安全性の観点からは、注意深くすることは安心材料に思えるかもしれません:真の緊急事態を見逃すよりも医師に送る方が一般に良いからです。しかし、システムがほぼ常に何らかの受診を勧めるならば、日常の判断に対する有用性は低くなり、診療所や救急部門の混雑を助長する可能性があります。また、もともと不安を感じている人々に対しては、軽度の症状でも常に専門家の診察が必要だと教え、不必要に不安を煽ることにもつながりかねません。

不一致を利用して助言を改善する方法

驚くべきことに、同じChatGPTモデルが同じ患者ストーリーに対して常に同一の回答を出すわけではありませんでした。複数回の実行で、あるモデルは同一ケースに対して異なる緊急度の間を行き来しました。研究者たちはこの不一致を単なる欠点と見なすのではなく、利点として活用しようとしました。各ケースの10回の回答をいくつかの方法で組み合わせたのです。その結果、10回のうち最も緊急度の低い推奨を採用すると、全体の精度が約4ポイント向上し、正しい自己管理の提案はさらに大きく増加しました。言い換えれば、あるモデルが同じ軽度のケースで時に自己管理を、時に受診を勧めるならば、最も低い緊急度の提案を信頼することで医師の判断に近づくことが多かったのです。

健康判断にAIを使う人々への意味

研究の結論は、現行のChatGPTモデルは明らかな救急事態を見分けるうえでは役立つ可能性がある一方で、特に「医師に行くか自宅で過ごすか」の判断を単独で導くにはまだ十分に信頼できない、ということです。新しい「推論」モデルは自己管理が十分な場合を認識する傾向がありやや優れていますが、それでも性能は完璧からは程遠いままです。同一モデルからの複数回答を組み合わせる手法は、将来的により安全なツールを開発する助けになるかもしれません。現時点では、ChatGPTのトリアージ型助言を地域の救急指示、専門的な医療助言、あるいは自身の常識に代わるものとして扱うべきではなく、複数の情報源の一つとして取り扱うべきです。

引用: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

キーワード: chatgpt, 自己トリアージ, 救急医療, 健康アドバイス, 人工知能