Clear Sky Science · ru

Оценка точности версий модели ChatGPT при выдаче рекомендаций по обращению за медицинской помощью

Почему это исследование важно для повседневных медицинских решений

Все больше людей обращаются к инструментам вроде ChatGPT с на вид простым вопросом: «Нужно ли мне в отделение неотложной помощи, к врачу или можно остаться дома и подождать?» Это исследование проверяет 22 версии ChatGPT именно на таком выборе. Результаты важны для каждого, кто подумывает полагаться на искусственный интеллект вместо звонка в клинику, на линию медсестры или к проверенному врачу.

Как исследователи проверяли медицинские советы ChatGPT

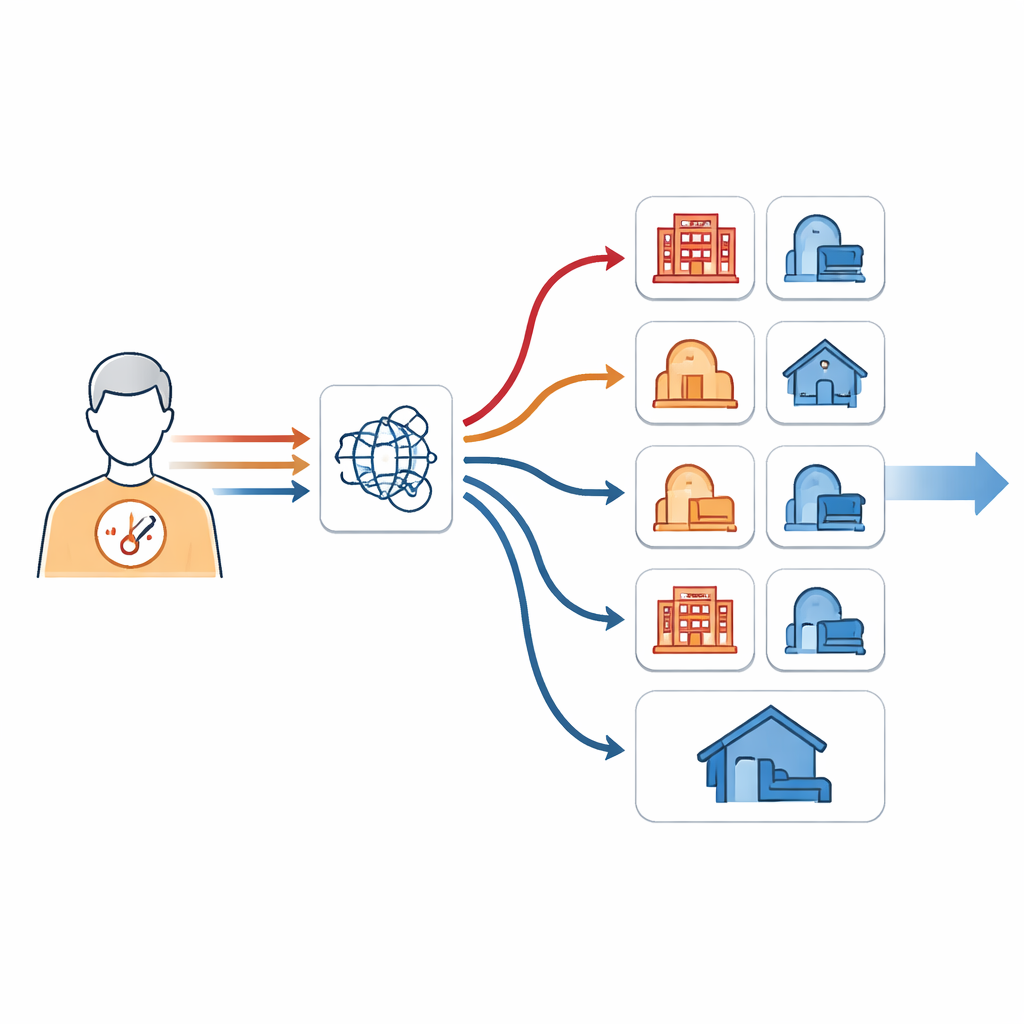

Вместо реальных пациентов команда использовала 45 тщательно составленных историй пациентов, или виньеток, взятых из реальных обращений людей в сети с вопросом, куда им следует обратиться за помощью. Каждую историю заранее оценивали два врача, которые сходились во мнении, требует ли она неотложного лечения, неэкстренного визита к врачу или простого ухода дома. Затем исследователи просили каждую доступную версию ChatGPT — включая старые модели и новые «reasoning»-модели — выбрать один из этих трёх вариантов. Чтобы оценить стабильность моделей, они повторяли этот процесс по десять раз для каждого случая и каждой модели, в результате получив 9900 отдельных рекомендаций.

Насколько точны были разные версии ChatGPT?

Лучшей в исследовании оказалась модель o1-mini: она выбирала правильный вариант примерно в трёх четвертях случаев (74%). Некоторые облегчённые модели показывали заметно худшие результаты, с точностью около 44%. Почти все модели очень хорошо распознавали неотложные состояния: при ограниченном числе примеров экстренных случаев они почти всегда предлагали срочную помощь, когда она действительно была нужна. Они также хорошо справлялись с типичными неэкстренными визитами к врачу. Самая большая проблема возникала с советом по уходу на дому. Даже лучшие модели часто рекомендовали обратиться к врачу, тогда как уместным было бы просто отдохнуть, наблюдать за симптомами и подождать несколько дней.

Почему ChatGPT склонен «играть в безопасность»

Во всех версиях модели наблюдалась тенденция выбирать более срочные рекомендации, чем считали нужным врачи. Старые версии почти никогда не рекомендовали недостаточный уровень помощи, а многие новые всё ещё сильно перестраховывались. С точки зрения безопасности такой подход может казаться обнадёживающим: обычно лучше направить человека к врачу, чем пропустить настоящую неотложную ситуацию. Но если система почти всегда советует посещение врача, её указания становятся менее полезными для повседневных решений — и могут увеличивать загруженность клиник и отделений неотложной помощи. Это также может усиливать тревогу у людей, которые и так обеспокоены, внушая им, что даже лёгкие симптомы всегда требуют профессионального внимания.

Использование непоследовательности во благо улучшения советов

Удивительно, но одна и та же модель ChatGPT не всегда давала одинаковый ответ на одну и ту же историю пациента. При многократных запусках некоторые модели переключались между разными уровнями срочности для идентичного случая. Вместо того чтобы рассматривать эту непоследовательность только как недостаток, исследователи попытались обратить её в пользу. Они комбинировали десять повторных ответов для каждого случая несколькими способами. Когда они выбирали наименее срочный вариант из появившихся в этих десяти запусках, общая точность выросла примерно на четыре процентных пункта, а правильные рекомендации по уходу на дому увеличились ещё сильнее. Иными словами, если модель порой советовала уход на дому, а порой визит к врачу для одного и того же лёгкого случая, доверие самому низкому уровню срочности часто приближало совет к оценке врачей.

Что это значит для людей, использующих ИИ при принятии медицинских решений

Главный вывод исследования таков: современные модели ChatGPT могут быть полезны для распознавания явных неотложных состояний, но пока они недостаточно надёжны, чтобы самостоятельно руководить решением о том, куда обращаться за помощью — особенно когда выбор стоит между визитом к врачу и оставаться дома. Новые «reasoning»-модели чаще и лучше распознают, когда достаточно ухода на дому, но их работа по-прежнему далека от идеальной. Методики, которые объединяют несколько ответов от одной и той же модели, могут помочь разработчикам создавать более безопасные инструменты в будущем. Пока же людям следует рассматривать триаж-подобные советы ChatGPT как один из источников информации, а не как замену местным инструкциям по неотложной помощи, профессиональной медицинской консультации или собственному здравому смыслу.

Цитирование: Kopka, M., He, L. & Feufel, M.A. Evaluating the accuracy of ChatGPT model versions for giving care-seeking advice. Commun Med 6, 171 (2026). https://doi.org/10.1038/s43856-026-01466-0

Ключевые слова: chatgpt, самотриаж, неотложная помощь, медицинские советы, искусственный интеллект