Clear Sky Science · zh

通过基于RoBERTa的集成模型实现自动化题目分类以增强教育评估

为现代课堂打造更聪明的测验

每年,教师会编写数以千计的考试题目来评估学生的学习情况——不仅是他们记住了哪些事实,还包括他们能以多深的思维层次进行思考。判断哪些题目测试的是简单记忆,哪些需要真正的问题解决能力很重要,但手工完成这项工作既缓慢又常常不一致。本文介绍了一种人工智能系统,能够自动根据题目对学生思维能力的要求对试题进行分类,有望带来更公平的测验并为教学节省时间。

思维层次为何重要

几十年来,教育工作者依赖一种被称为布鲁姆认知目标分类法的框架来设计课程和试题。它描述了六个思维层次,从记忆基础事实、理解、应用、分析、评价,到创造新的事物。好的考试应覆盖这一完整范围,而不是集中在最容易的层次上。但将每道题归入某一层次是主观判断,不同教师可能有不同意见。将这一环节自动化可以使评估更客观,并能迅速揭示一份试卷是真正挑战学生思维还是仅仅检验记忆。

教机器读懂考试题

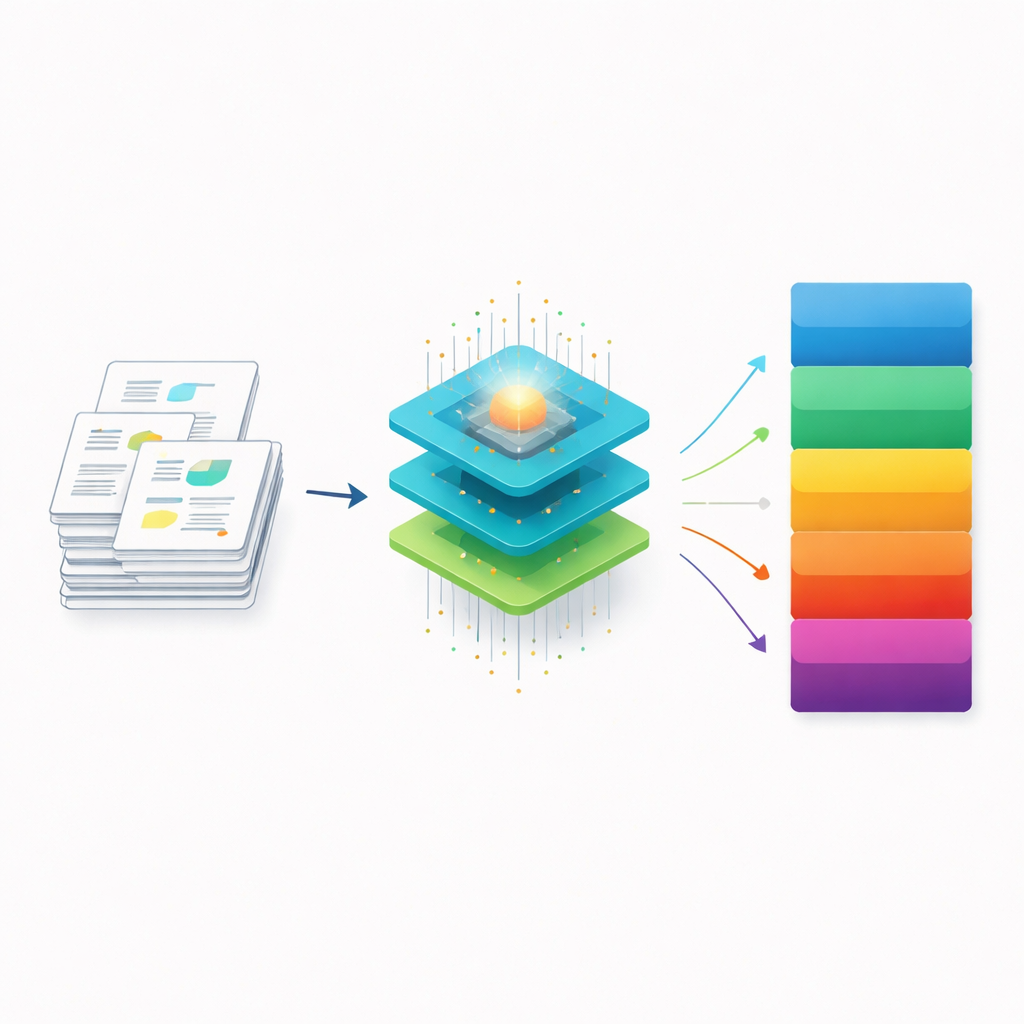

作者基于一种称为RoBERTa的强大语言模型构建了他们的系统,该模型通过大量文本训练以捕捉细微的语义差别。当模型读取一道试题时,它将每个词转换为反映其与周围词语关系的丰富数值表示。这些表示随后输入到三个专门的神经网络中:一个侧重于句子中信息按顺序展开的方式,另一个追踪长期模式,第三个寻找关键的局部短语。它们协同学习以识别那些提示题目是在要求学生回忆、解释、应用或创新的措辞特征。

融合不同的AI视角

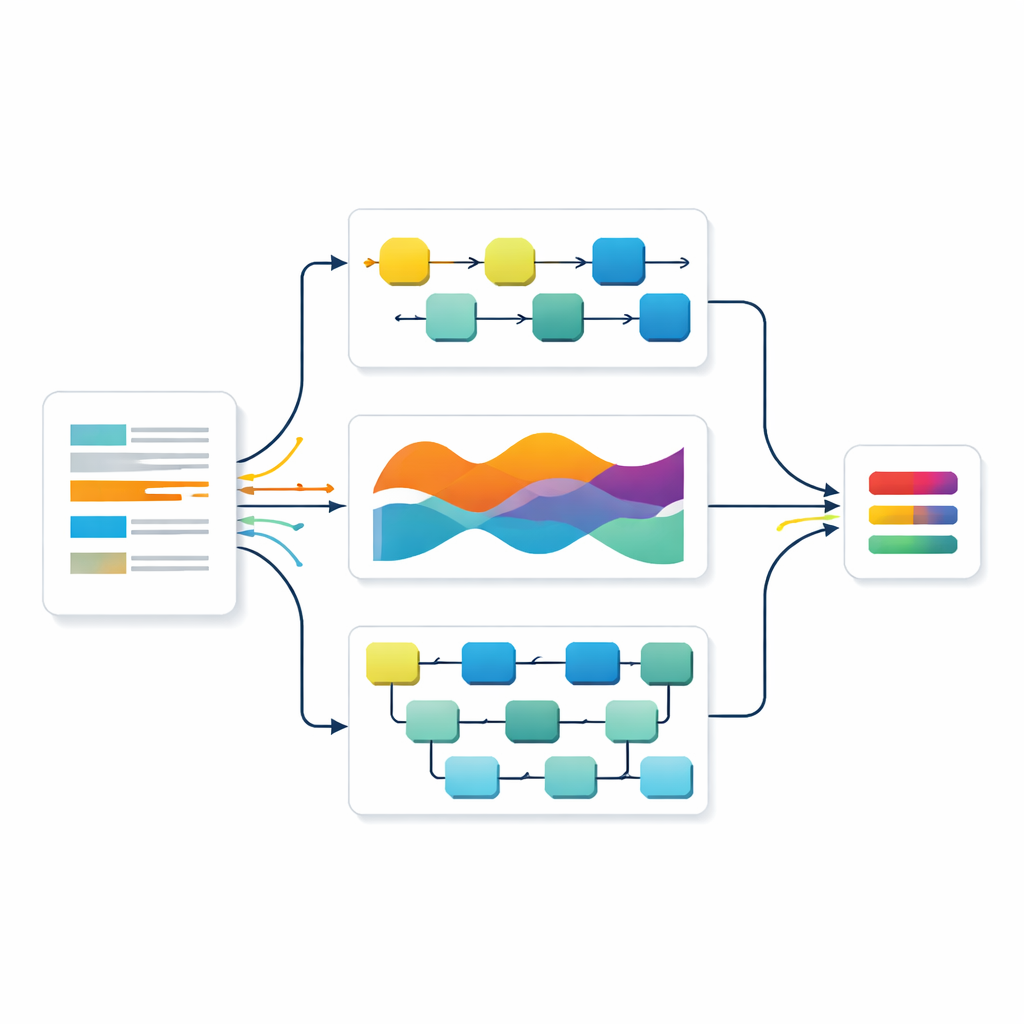

研究者没有仅信任单一网络,而是采用借鉴自投票系统的策略将三者结合起来。每个模型都会给出对题目层次的预测以及一个置信度值。这些预测随后被平均,但并非等权——在独立的验证集上表现更准确的模型会获得更高的权重。这种“加权集成”方法使得某一模型的强项可以弥补另一模型的弱点。团队还对数据进行了严格准备,通过仔细校验的释义扩充了公开的试题数据集,从而让系统在不引入噪声的情况下从更多示例中学习。

效果如何?

在一个在训练过程中模型从未见过的留出测试集上,三个单独网络的题目分类准确率均超过90%,已超越研究文献中许多早期方法。集成模型表现更佳,正确标注了约92%的题目,并在所有六个思维层次上保持了平衡的性能,包括更高级的层次。统计检验表明,这一较单一最佳模型的提升不太可能是偶然。对错误的详细分析显示,集成方法减少了相邻思维层次之间的混淆——这些往往也是人类最难区分的。

这对教师和学生意味着什么

通过自动将试题分类到不同的思维层次,该系统可帮助教师快速检查其试卷是否真正衡量了从基础记忆到创造性问题解决等多种能力。它能够标出空白——例如试卷是否包含过多简单题而缺乏促进深层推理的题目——并有助于学校随时间设计出更一致的评估工具。虽然该工具不能取代专业判断,但它提供了一个快速且有证据支持的起点,从而减少工作量和人为偏见。展望未来,作者计划将此类系统整合到在线学习平台中,并将其扩展到将在学生与AI协作时代变得重要的新型技能。

引用: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

关键词: 教育评估, 布鲁姆认知目标分类法, 自动化试题分类, 教育中的深度学习, 语言模型