Clear Sky Science · nl

Verbetering van onderwijsbeoordeling door automatische vraagclassificatie met een RoBERTa-gebaseerd ensemblemodel

Slimmere toetsen voor moderne klaslokalen

Elk jaar schrijven docenten duizenden examenvragen om te meten hoe goed leerlingen leren — niet alleen welke feiten ze onthouden, maar ook hoe diepgaand ze kunnen denken. Bepalen welke vragen eenvoudige reproductie testen en welke echt probleemoplossend denken vereisen is belangrijk, maar handmatig beoordelen is traag en vaak inconsistent. Dit artikel introduceert een systeem voor kunstmatige intelligentie dat examenvragen automatisch kan indelen op basis van de mate van denkbelasting die ze van leerlingen vragen, met beloftes van eerlijkere toetsen en meer tijd voor lesgeven.

Waarom niveaus van denken ertoe doen

Decennialang vertrouwen opvoeders op een raamwerk dat bekendstaat als Bloom’s Taxonomy om lessen en toetsen vorm te geven. Het beschrijft zes lagen van denken, van het onthouden van basisfeiten via begrijpen, toepassen, analyseren en evalueren, tot het creëren van iets nieuws. Een goede toets zou dit volledige spectrum moeten bestrijken in plaats van te concentreren op de gemakkelijkste niveaus. Maar elke vraag aan één van deze niveaus toewijzen is een beoordelingskwestie, en leraren kunnen het daarover oneens zijn. Het automatiseren van deze stap kan beoordelingen objectiever maken en snel laten zien of een toets leerlingen echt uitdaagt in plaats van alleen geheugen te controleren.

Een machine leren examenvragen te lezen

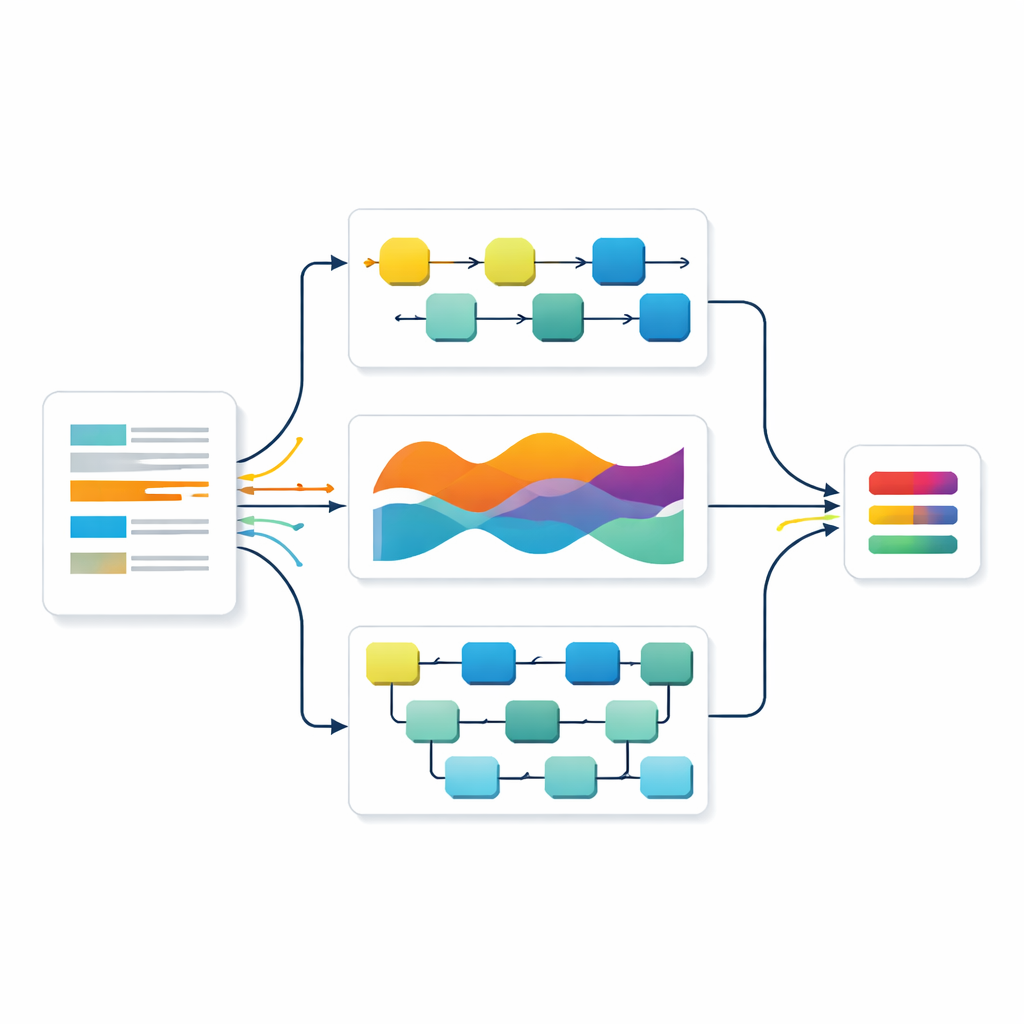

De auteurs bouwden hun systeem op een krachtig taalmodel genaamd RoBERTa, dat is getraind op enorme hoeveelheden tekst om subtiele betekenisnuances vast te leggen. Wanneer het model een examenvraag leest, zet het elk woord om in een rijke numerieke representatie die weergeeft hoe het zich verhoudt tot de omliggende woorden. Deze representaties voeren vervolgens in drie gespecialiseerde neurale netwerken. Eén richt zich op hoe informatie zich in volgorde door een zin ontvouwt, een ander volgt langetermijnpatronen en een derde zoekt naar belangrijke lokale zinswendingen. Samen leren ze woordkeuzes te herkennen die aangeven of een vraag van leerlingen vraagt te reproduceren, uit te leggen, toe te passen of te vernieuwen.

Het samenbrengen van verschillende AI-visies

In plaats van op één enkel netwerk te vertrouwen, combineerden de onderzoekers alle drie met een strategie die is afgeleid van stemsystemen. Elk model geeft zijn eigen voorspelling over het denkniveau van een vraag, samen met een maat voor vertrouwen. Deze voorspellingen worden vervolgens gemiddeld, maar niet gelijkmatig — modellen die op een aparte validatieset nauwkeuriger blijken worden zwaarder gewogen. Deze "gewogen ensemble"-aanpak laat de sterke punten van het ene model de zwaktes van een ander compenseren. Het team heeft ook hun data rigoureus voorbereid, door een openbare dataset van examenvragen uit te breiden met zorgvuldig gecontroleerde parafrasen, zodat het systeem van meer voorbeelden kon leren zonder ruis toe te voegen.

Hoe goed werkt het?

Op een apart testbestand dat de modellen tijdens training nooit zagen, classificeerden alle drie de individuele netwerken vragen met meer dan 90 procent nauwkeurigheid, en overtroffen daarmee al veel eerdere benaderingen in de vakliteratuur. Het gecombineerde ensemble deed het nog beter en labelde ongeveer 92 procent van de vragen correct, terwijl het een uitgebalanceerde prestatie over alle zes denkniveaus behield, inclusief de meer gevorderde. Een statistische test bevestigde dat deze verbetering ten opzichte van het beste enkele model waarschijnlijk niet door toeval verklaard kon worden. Gedetailleerde foutanalyses toonden aan dat het ensemble verwarring tussen aangrenzende denkniveaus verminderde, die ook voor mensen vaak het moeilijkst te onderscheiden zijn.

Wat dit betekent voor leraren en leerlingen

Door examenvragen automatisch in denkniveaus in te delen, kan dit systeem leraren snel helpen controleren of hun toetsen echt een reeks vaardigheden meten, van basisherinnering tot creatief probleemoplossen. Het kan hiaten signaleren — bijvoorbeeld als een toets te veel makkelijke vragen bevat en te weinig vragen die dieper redeneren bevorderen — en scholen helpen consistenter toetsen te ontwerpen in de loop van de tijd. Hoewel het hulpmiddel vakmanschap niet vervangt, biedt het een snel, op bewijs gebaseerd startpunt dat werklast en menselijke vooringenomenheid vermindert. Vooruitkijkend zijn de auteurs van plan zulke systemen te integreren in online leerplatforms en ze uit te breiden naar nieuwe soorten vaardigheden die belangrijk zullen zijn in een tijdperk waarin leerlingen steeds vaker naast AI werken.

Bronvermelding: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

Trefwoorden: onderwijsbeoordeling, Bloom’s Taxonomy, automatische vraagclassificatie, deep learning in onderwijs, taalmodellen